从输入到回复:大模型靠 Token 接龙 “猜” 出你的答案

原创大模型作为人工智能领域的明星产物,其诞生与迭代始终以人类语言及行为数据的深度学习为核心。通过吸纳书面文字、影音字幕、日常对话等海量多元数据,借助数百亿甚至上千亿级参数构建起庞大的数学模型(本质是语言规律与语义关联的编码网络),大模型得以实现对语言逻辑的高效习得与灵活运用 —— 这便是人们常说的 “大力出奇迹”,但这并非单纯的 “以量取胜”,而是数据、参数与核心架构的协同赋能。

不过,AI 在神经网络内部构建文字关联的具体过程,仍带有 “黑箱特性”—— 中间计算逻辑极为复杂,难以逐节点还原,但并非完全不可解释,通过注意力热力图等可解释性技术,能部分追溯关联建立的脉络。

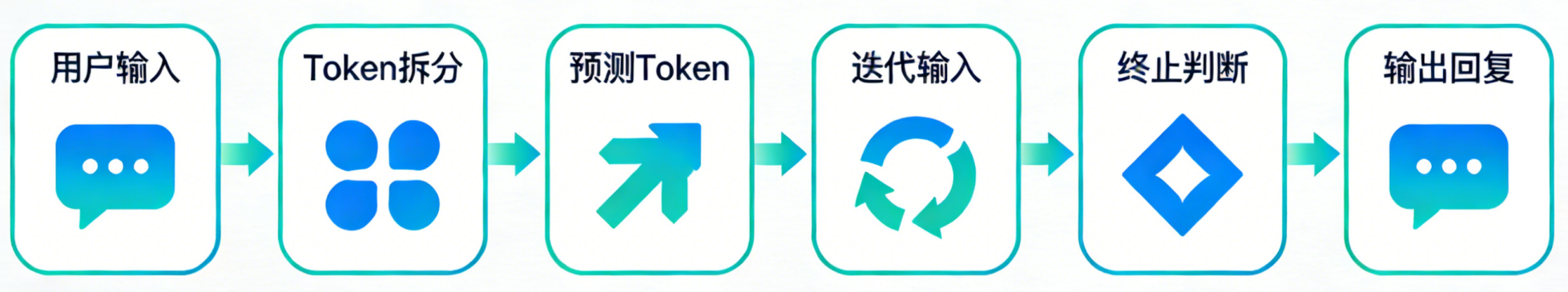

回归核心,理解了大模型的训练逻辑,便不难发现其对话输出、多模态输出的本质:一场 “文字接龙”,而在模型内部,这一过程以 Token(语义最小单元)为单位展开,具体流程如下图所示:

大模型对话流程图

- 用户输入自然语言(如 “推荐一本科幻小说”);

- 模型将自然语言拆解为 Token 序列(如中文场景:[推荐,一本,科幻,小说]);

- 基于输入 Token 序列与自身参数,预测回复的首个 Token;

- 把 “原始输入 Token 序列 + 已生成 Token 序列” 作为新输入,迭代预测下一个 Token;

- 当预测到结束标志(核心为模型词表预设的 EOS 特殊标记,“啊” 等自然语言终止词仅为辅助信号),或回复 Token 长度达到预设阈值时,生成终止,模型整理完整 Token 序列;

- 按模型发布时的词表,将 Token 序列解码为自然语言,最终返回给用户。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读