吃透大模型系统:提示工程、符号推理、智能体实战全解

三掌柜赠书活动第六十三期丨关注我丨文末赠书

Part.0

前言

真正的技术壁垒,从来不是会写 Prompt(提示词),下半场拼的是:任务更清楚、推理更可控、系统能持续变强。

两年前,我们还会为 AI 写出一首诗、生成一段代码而惊叹不已。但如今,在一线技术从业者眼中,大模型已逐渐褪去神秘面纱,成为像水和电一样触手可及的基础设施。

但“能用”和“能落地”之间,隔着一条鸿沟:系统不稳定、不可控、不可复现、难调试、难扩展。

很多人误以为差距在于“会不会用工具”,但其实下半场真正拉开差距的是:

你能不能让 AI 记得住、用得上、越用越好。

核心不是让模型“知道更多”,而是让系统把知识和经验组织起来:该用时精准可用,遇到复杂问题不偏离目标,用过一次就能沉淀复用,下次运行更稳定。

人民邮电出版社的新书《深入大模型系统:提示工程、符号推理与智能体实践》,就是围绕这条主线来讲的。作者白钰长期在亚马逊、阿里云做大规模 AI 系统研发与落地,书中传递的核心观点十分明确:这不是教你“怎么跟大模型聊天”,而是教你“怎么搭建一个能跑的 AI 系统”。

图片

下面通过三个你最关心的问题,为你厘清这本书的核心主线。

Part.1

高级推理的本质是状态空间的搜索

把一次性续写,变成工程式“搜索 + 校验”,推理才会稳。

图片

在真实的工程场景中,你一定遇到过这类问题:模型能补全一个看似合规的代码函数,但一进入复杂场景——接口要对齐、依赖要兼容、单测要通过、回归要稳定,成功率就会明显下降。

原因并不玄学:我们总把大模型视作“文本续写器”,希望它一次写对。但工程问题更像在很多中间方案里做选择:哪条路径能走通?哪条路径会出问题?需要边走边验证。

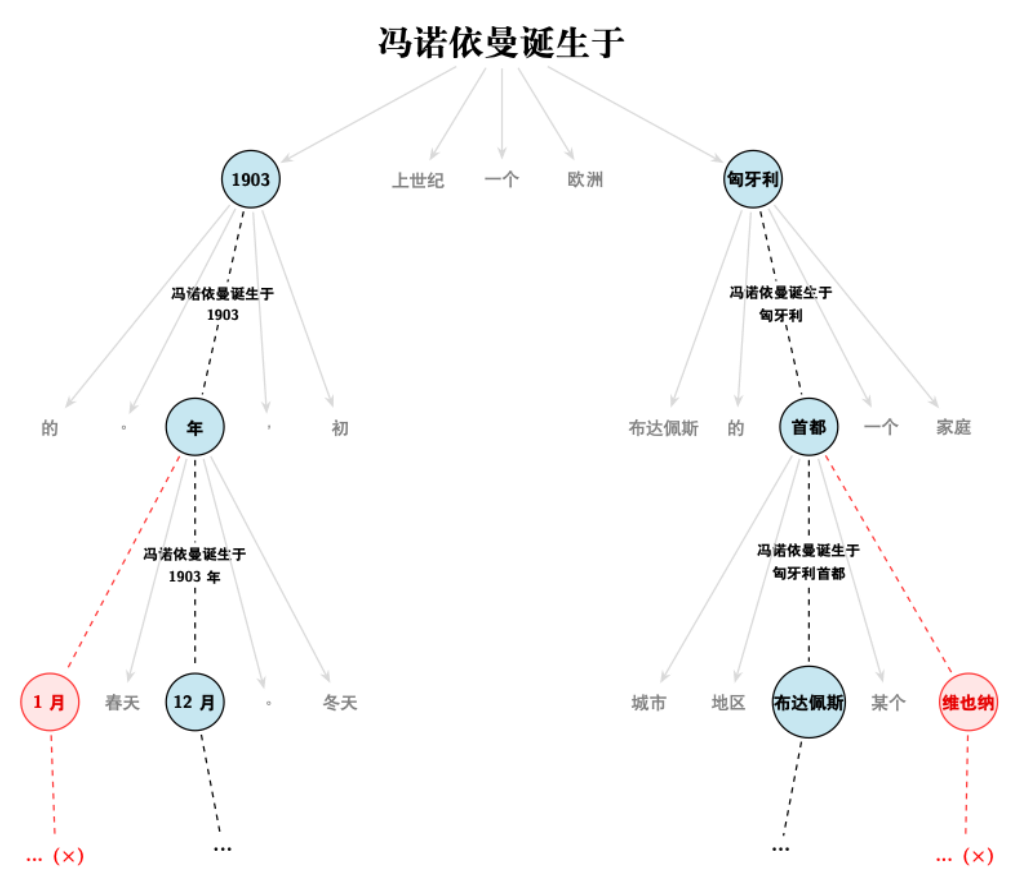

书中第 7 章用“状态空间搜索”的视角把这件事讲得很清楚:

把每个中间步骤当成一个“状态”,把下一步修改或推导当成一次“行动”,如此一来,推理就变成一个可以打分、可以回溯、可以剪枝的过程。

图片

▲合法路径和非法路径对比(原书图7-2)

图片解读:传统生成像“一条路走到黑”;结构化推理像“多条路同时探”,用评估保留能闭环的“合法路径”,及时剪掉明显不行的“非法分支”。

在这个框架下,书中先介绍了一个非常实用且容易上手的增强方案:自一致性(self-consistency)。

• 思维链(Chain of Thought,CoT)的问题:

CoT 把步骤写出来了,但很多时候还是“只走一条路”。如果前面假设偏了,后面会越写越偏,中途也没有机制横向对比备选分支。

• 自一致性更贴合工程实践:

无须修改模型参数,直接“多采样几条推理路径”,最后对终点答案投票/整合。你可以把它理解成:多试几条路,选最常出现、最稳的那个答案。这一步能显著提升稳定性。

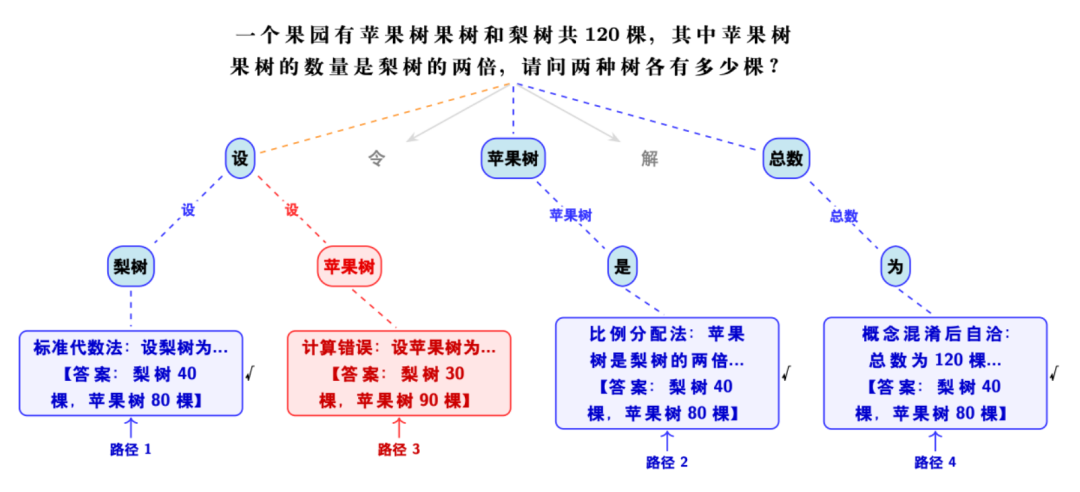

图片

▲合法路径和非法路径对比(原书图7-5)

图片解读:自一致性把推理从“单次续写”,拉回“多分支搜索 + 轻量校验”,所以在复杂任务中更稳定、更可控。

书中接着顺理成章再往下走:自一致性主要看“终点答案”,对“过程质量”的控制有限,所以才进一步引入“过程级评估/剪枝/回溯”的显式搜索策略(参见 7.4 节)。

一句话总结这一递进逻辑:先把微观的答案稳住,再把宏观的过程管住。

Part.2

你想秒懂 Skills?先把上下文工程读明白

Skills 不是“写更好的 Prompt”,而是把上下文工程的高频闭环封装出来。

图片

最近大家都在聊 Skills。很多人的第一反应是:是不是又有一种“更强的 Prompt 写法”?

但有过 Agent 落地经验的人会告诉你:难点从来不是某一句 Prompt的写法,而在于解决以下四件事:

上下文怎么组织?

工具怎么发现?

资源怎么同步?

结果怎么流转?

这四件事决定了你做出来的是“能演示的 demo”,还是“能长期稳定运行的系统”。

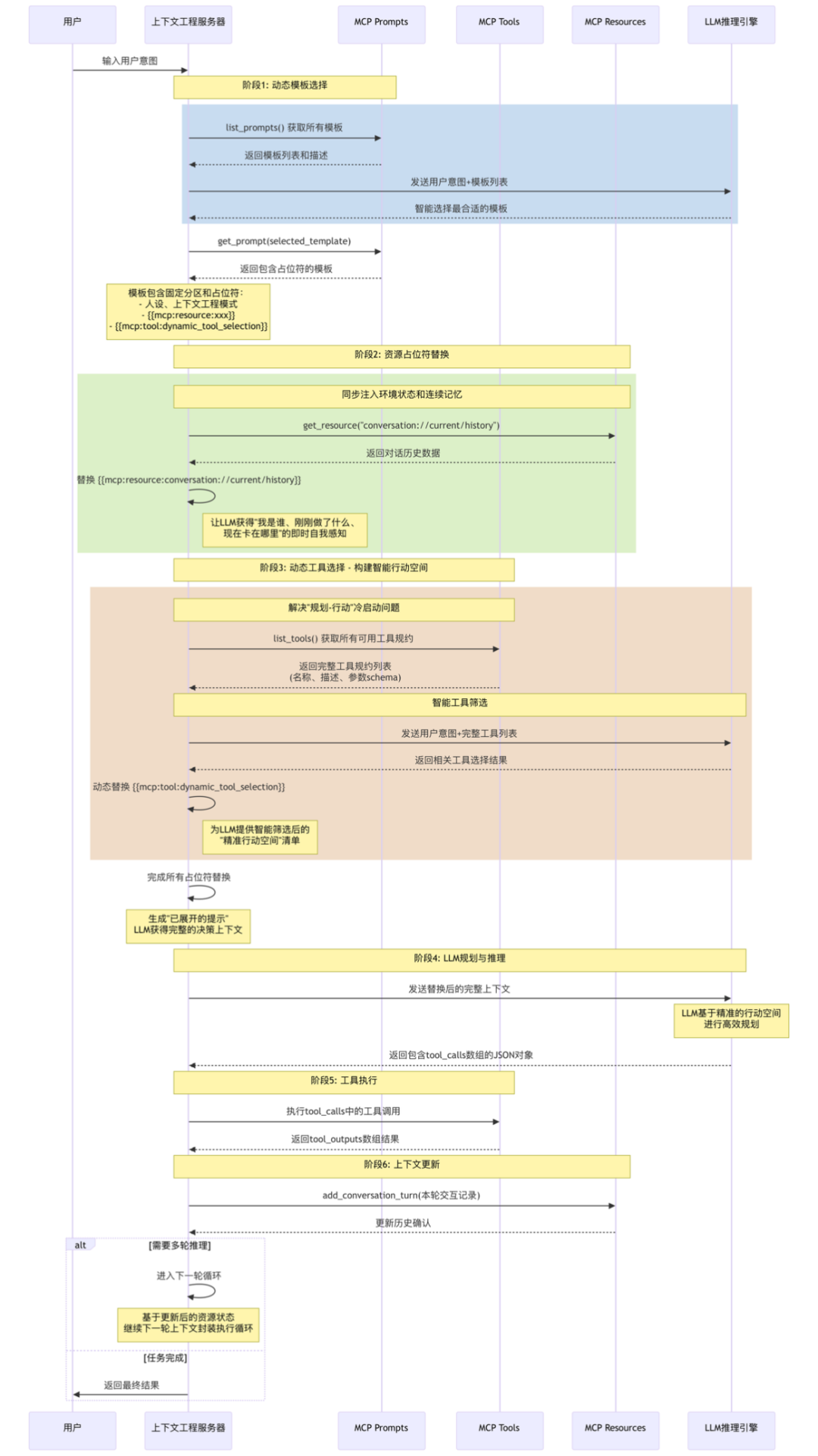

书中我最喜欢的内容之一,是 9.5 节对 MCP(模型上下文协议)的解读。它把“上下文工程”讲得非常透彻,而且不是停留在概念层面,作者直接用图 9-5 把一条最常走、最高频的工程动线画出来了:

每一轮推理开始前,系统先把“可用的决策上下文”拼装好,将所需的模板、资源、工具、状态一次性拉齐,再交给模型去想、去做。

图片

▲上下文工程的 MCP 最佳实现(原书图 9-5)

如果跳过这一步,智能体甚至不知道自己能干什么、该用什么、现在处在什么状态,更谈不上稳定规划和可靠执行。结合图 9-5,这条动线其实就是一套非常清晰的四步闭环:

1.选择适配当前任务的上下文模板(逻辑分区)

先把上下文结构定型:身份/目标/约束/输出格式如何分区,历史记录与状态存放在哪一块分区,工具与资源放在哪一块分区。没有逻辑分区,就没有稳定的可控推理过程。

2. 对模板中声明的宏进行宏展开(拉取资源和工具)

模板不会把内容写死,而是声明“我需要什么”:会话历史、任务状态、工具清单、权限边界、外部数据入口……这些必须在运行时拉齐,不然模型只会盲猜。

3. 执行资源和工具调用(执行资源和工具)

上下文补齐后才开始干活:按标准契约调用工具、读取资源、获取结构化返回结果,让推理建立在证据上。

4. 回填上下文并生成最终响应(完成上下文工程)

把工具返回结果、证据、推理结论回填至上下文,再生成最终答案或下一步行动指令——闭环完成。

你现在就能看懂:Skills 为什么长得像“一个目录 + 一份模板 + 一段脚本”。

它本质上是在覆盖这条上下文工程的高频动线:

模板负责“逻辑分区”

宏展开负责“把资源/工具拉齐”

脚本负责“执行工具”

所以别只盯 Skills 这个外壳,上下文工程才是主体。吃透这套闭环,你既能自主设计更稳定的 Skills/工作流,也能一眼定位问题根源(究竟出在模板、资源、工具契约还是回填环节),还能把零散的工具调用升级成可规模化、可治理的工程系统,这才叫“一通百通”。

Part.3

智能体不缺框架,

缺的是“越用越强”的认知架构

预训练给底子,上下文工程给临时加成;认知架构负责把经验沉淀下来。

图片

很多Agent框架的即时生成效果很强,但任务一拉长、环境一变,或者需要失败纠偏时,就容易掉链子。

原因也不复杂:它缺的不是某个技巧,而是一套让系统知道怎么想、怎么做、怎么记、怎么变得更好的顶层结构。

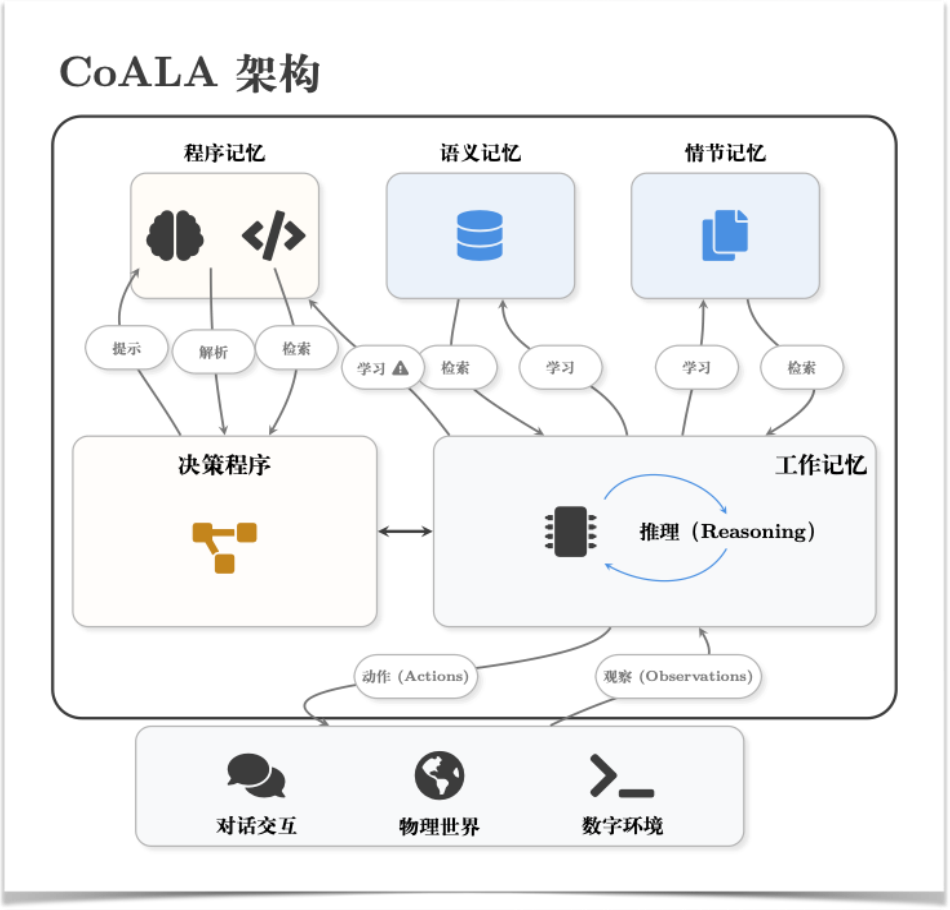

第 9 章的 CoALA(语言智能体认知架构)就在做这件事。它把全书前面讲的各项能力“收束”成一个系统:

大模型预训练:给你一个通用的“底子”(模型内置大量世界知识)。

上下文工程:给你“临时加成”(把这次任务需要的资料、工具、状态在测试时整合进上下文)。

认知架构:把运行中的经验“沉淀下来”(让系统下次更稳定,更像一个能长期工作的智能体)。

图片

CoALA 中一个非常直观的设计是“记忆分工”:

程序记忆(智能体的“固件/操作系统):内置核心指令、通用规则与行为护栏边界。你可以理解成把团队最佳实践、合规要求“固化成系统底线”,让智能体不容易越界、不容易人格分裂。

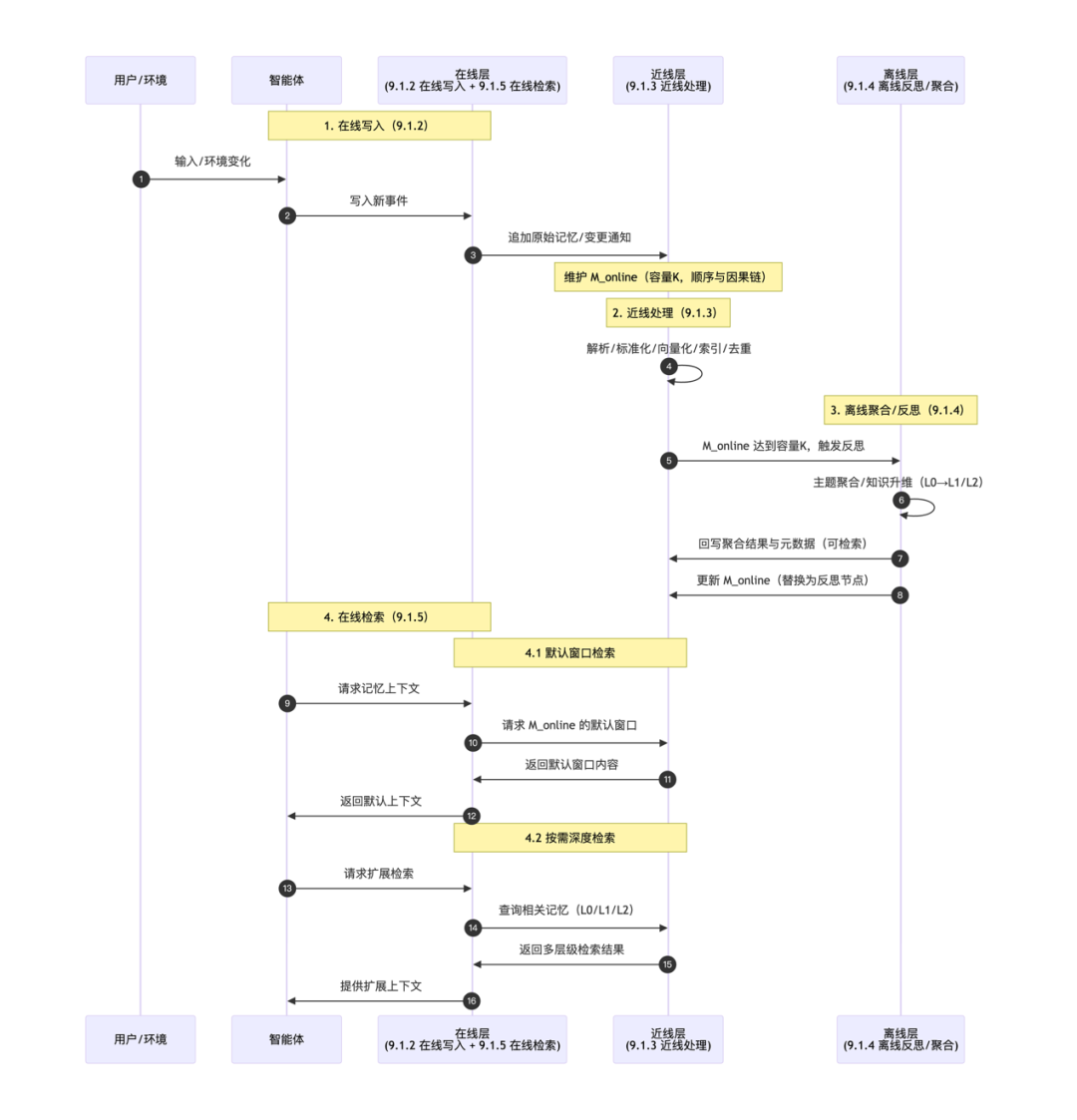

情节记忆(智能体的“成长经历”): 存储成功经验、踩坑教训与失败反思。书中提出“在线—近线—离线”:先记住信息,再整理成好用的形态,最后在合适的时候沉淀成“方法”。

图片

更关键的是,书中强调记忆不是越多越好,而是要“管起来”:

用符合遗忘曲线的压缩机制形成可控窗口;在信息不足、证据不全、决策不确定时,再按需触发持久化记忆的查取与回填。

这样记忆就不会“泛滥导致稀释”,但关键时刻又能“顶上去”。

最终效果很直观:智能体不只“记住发生了什么”,还开始“学会下次怎么做”。

这就是把经验变成能力——系统越用越稳、越跑越强。

Part.4

结语

AI 变化太快,天天追新 Prompt 技巧确实很累,而且很难形成真正的护城河。更稳的路,是把底层系统逻辑吃透:把生成当成可控的搜索过程,把上下文工程做成可复用的闭环,把记忆与规划做成可治理的认知架构。如此一来,无论工具怎么换、框架怎么迭代,你都能抓住不变的核心主线。

《深入大模型系统:提示工程、符号推理与智能体实践》讲的正是这条主线:从“底子怎么来”,到“上下文工程怎么补齐”,再到“经验怎么沉淀成能力”。搭配随书附赠的视频与完整源代码,读完不仅能“懂”,更能把方法落成可运行的系统。

如果你希望从“大模型使用者”进阶为“大模型系统架构师”,这本书绝对值得你认真读一遍。

图片

说说你对大模型系统的看法?

在留言区参与互动,并点击在看和转发活动到朋友圈,将选1名读者获得赠书1本,截止时间3月18日。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读