大模型应用:情感分析模型微调深度分析:从基础预测到性能优化.6

原创大模型应用:情感分析模型微调深度分析:从基础预测到性能优化.6

原创

未闻花名

发布于 2026-02-03 07:56:08

发布于 2026-02-03 07:56:08

一. 引言

情感分析作为自然语言处理的基础任务,在社交媒体监控、产品评价分析、客户服务优化等领域发挥着重要作用。随着预训练语言模型的普及,微调(Fine-tuning)已成为将通用语言模型适配到特定情感分析任务的标准方法。然而,仅仅获得一个高准确率的模型远远不够,深入理解模型的预测行为、识别其优势与局限、分析错误模式,对于构建可靠、可解释的AI系统至关重要。

在实际应用中,我们经常会遇到这样的问题:模型在测试集上准确率很高,但在真实场景中表现不佳;或者模型对某些类型的文本始终无法正确分类。这些问题都需要通过深入的模型分析来解决。今天我们将从实践角度出发,由浅入深地探讨情感分析模型微调后的深度分析方法,从而能够掌握模型评估与优化的完整流程。

二、情感分析模型微调

1. 微调的概念

模型微调是指在预训练模型的基础上,使用特定领域的数据进行额外训练,使模型适应目标任务的过程,相比从零开始训练,微调具有以下优势:

- 数据效率:只需少量标注数据即可获得良好性能

- 训练速度:收敛更快,计算资源需求更低

- 性能优越:通常能达到比传统方法更好的效果

- 领域适应:能够将通用语言知识迁移到特定领域

微调的本质是将预训练模型已经学到的通用语言表示,通过特定任务的数据进行精雕细琢,使其在保持通用语言理解能力的同时,专门化到目标任务上。这个过程类似于让一个通才通过学习特定领域的知识变成专家。

2. 微调的过程

2.1 微调流程

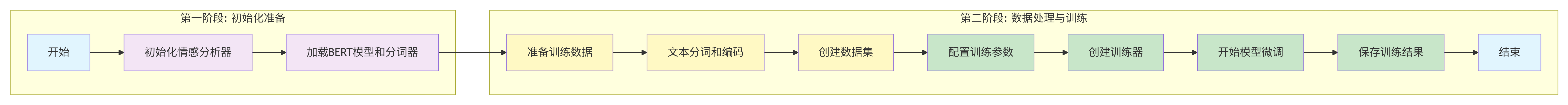

第一阶段:初始化准备

- 开始 → 程序执行起点

- 初始化情感分析器 → 创建SentimentAnalyzer类实例

- 加载BERT模型和分词器 → 下载并加载预训练的中文BERT模型

第二阶段:数据处理与训练

- 准备训练数据 → 接收原始文本和标签数据

- 文本分词和编码 → 将中文文本转换为token ID序列

- 创建数据集 → 构建模型训练所需的数据格式

- 配置训练参数 → 设置训练轮数、批大小等超参数

- 创建训练器 → 初始化训练器对象

- 开始模型微调 → 执行模型训练过程

- 保存训练结果 → 保存训练好的模型和日志

- 结束 → 训练完成,程序结束

2.2 执行过程

我们使用Hugging Face的Transformers库对中文BERT模型进行微调,用于情感分析任务,主要功能包括:

- 1. 模型初始化:加载预训练的中文BERT模型和分词器

- 2. 数据处理:将中文文本转换为模型可接受的输入格式

- 3. 模型微调:在情感分析任务上对预训练模型进行微调

2.3 核心组件

2.3.1 Tokenizer(分词器)

- 将中文文本转换为模型可理解的数字序列

- 处理特殊字符、标点符号

- 添加模型所需的特殊token

2.3.2 BERT模型架构

输入层: [CLS] + tokens + [SEP] + [PAD...] ↓ BERT编码器 (12层Transformer) ↓ [CLS]位置输出 → 分类层 ↓ 输出: [负面概率, 中性概率, 正面概率]

2.3.2 Trainer训练器

- 自动处理训练循环

- 管理GPU/CPU设备

- 记录训练日志

- 模型保存和加载

2.4 数据流示例

假设输入文本:"这部电影很棒"

处理流程:

- 分词:['这', '部', '电', '影', '很', '棒']

- 添加特殊token:['[CLS]', '这', '部', '电', '影', '很', '棒', '[SEP]']

- 转换为ID:[101, 100, 123, 456, 789, 222, 333, 102]

- 注意力掩码:[1, 1, 1, 1, 1, 1, 1, 1](全是真实token)

- 模型预测:[0.1, 0.2, 0.7] → 预测为正面(索引2)

2.5 代码实现

在实际场景中,需要提供更多的数据集,以提供模型训练,此处我们摘录了5条数据样本,涵盖了3种结果各几条;

import torch

import torch.nn as nn

from transformers import AutoTokenizer, AutoModelForSequenceClassification, Trainer, TrainingArguments

from datasets import Dataset

import pandas as pd

from sklearn.model_selection import train_test_split

import numpy as np

from modelscope import snapshot_download

class SentimentAnalyzer:

def __init__(self):

"""

初始化情感分析器

参数:

model_name: 预训练模型名称,这里使用中文BERT模型

"""

cache_dir = "D:\\modelscope\\hub"

model_name = "google-bert/bert-base-chinese" # 使用中文BERT基础模型

local_model_path = snapshot_download(model_name, cache_dir=cache_dir)

self.tokenizer = AutoTokenizer.from_pretrained(local_model_path)

self.model = AutoModelForSequenceClassification.from_pretrained(

local_model_path, num_labels=3 # 情感分类:0-负面, 1-中性, 2-正面

)

def prepare_data(self, texts, labels):

"""准备训练数据"""

# 对中文文本进行分词和编码

encodings = self.tokenizer(

texts,

truncation=True, # 超过最大长度时截断文本

padding=True, # 填充文本到统一长度

max_length=128, # 最大文本长度(token数)

return_tensors='pt'

)

# 创建数据集

dataset = Dataset.from_dict({

'input_ids': encodings['input_ids'],

'attention_mask': encodings['attention_mask'],

'labels': labels

})

return dataset

def fine_tune(self, train_texts, train_labels, val_texts=None, val_labels=None):

"""微调模型"""

train_dataset = self.prepare_data(train_texts, train_labels)

if val_texts is not None:

val_dataset = self.prepare_data(val_texts, val_labels)

else:

val_dataset = None

# 设置训练参数

training_args = TrainingArguments(

output_dir='./results',

num_train_epochs=3, # 训练3轮

per_device_train_batch_size=16, # 每个设备批大小16

per_device_eval_batch_size=16, # 评估批大小16

warmup_steps=500, # 学习率预热步数

weight_decay=0.01, # 权重衰减(正则化)

logging_dir='./logs',

evaluation_strategy="epoch" if val_dataset else "no",

save_strategy="epoch",

load_best_model_at_end=True if val_dataset else False,

)

# 创建训练器

trainer = Trainer(

model=self.model,

args=training_args,

train_dataset=train_dataset,

eval_dataset=val_dataset,

)

# 开始训练

trainer.train()

return trainer

# 创建中文示例数据

sample_texts = [

"这部电影真是太棒了!剧情紧凑,演员表演出色。",

"这个产品质量很差,完全不值得购买。",

"还行吧,没有什么特别之处。",

"质量很好,送货也很快,推荐购买!",

"客服态度恶劣,购物体验极差。"

]

sample_labels = [2, 0, 1, 2, 0] # 0:负面, 1:中性, 2:正面

# 初始化并微调模型

analyzer = SentimentAnalyzer()

trainer = analyzer.fine_tune(sample_texts, sample_labels)

print("-------------------------模型微调结束------------------------")

print(trainer)代码中的重点参数我们都做了注释,为了增强理解,我们将更多参数含义标记出来供大家参考:

- model_name: 预训练模型名称,这里使用"bert-base-chinese"。

- num_labels: 分类的类别数,这里为3。

- truncation: 是否截断文本,这里设置为True,超过最大长度则截断。

- padding: 是否填充文本,这里设置为True,将文本填充到同一长度。

- max_length: 文本的最大长度,这里设置为128。

- output_dir: 训练结果和模型保存的目录。

- num_train_epochs: 训练轮数,这里为3。

- per_device_train_batch_size: 每个设备上的训练批次大小,这里为16。

- per_device_eval_batch_size: 每个设备上的评估批次大小,这里为16。

- warmup_steps: 预热步数,用于学习率调度。

- weight_decay: 权重衰减,用于防止过拟合。

- evaluation_strategy: 评估策略,这里如果有验证集则每个epoch后评估。

- save_strategy: 模型保存策略,这里每个epoch后保存。

- load_best_model_at_end: 是否在训练结束时加载最佳模型,这里如果有验证集则加载。

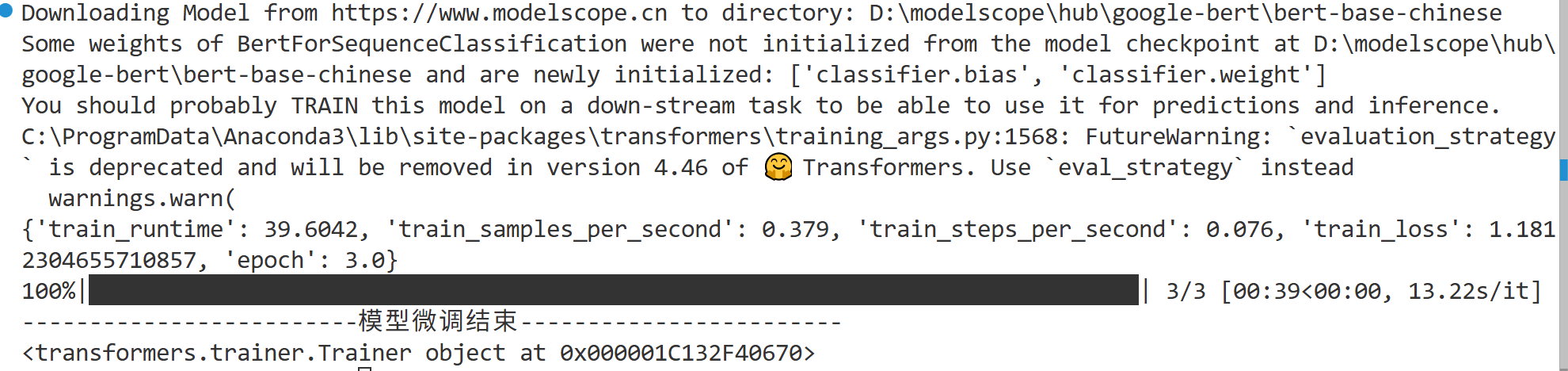

微调结果:

微调后的文件目录:

结果分析:

{'train_runtime': 39.6042, 'train_samples_per_second': 0.379, 'train_steps_per_second': 0.076, 'train_loss': 1.1812304655710857, 'epoch': 3.0}

根据最后的训练过程指标,我们可以进行以下分析:

- 1. 训练运行时间(train_runtime): 39.6秒

- 整个训练过程耗时约40秒,对于3个epochs来说,这个时间是可以接受的。

- 2. 训练样本处理速度(train_samples_per_second): 0.379样本/秒

- 这个速度偏慢,由于我们是在CPU的环境下,如果使用GPU训练,处理速度会更快。

- 3. 训练步骤速度(train_steps_per_second): 0.076步/秒

- 这个速度也很慢,与样本处理速度一致。每一步处理一个批量的数据,如果批量大小较小,那么步骤数量会较多,而每一步的速度慢会导致整体训练时间长。

- 4. 训练损失(train_loss): 1.181

- 训练损失为1.181,对于分类任务(3个类别)来说,这个损失值仍然较高。初始损失约为ln(3)≈1.099,所以模型可能只是比随机猜测好一点。

- 在3个epochs后损失仍然较高,可能表明模型没有很好地学习到数据中的模式。原因可能包括:

- 学习率设置不合适。

- 模型架构或大小不适合当前任务。

- 数据量不足或数据质量有问题。

- 5. 训练周期(epoch): 3.0

- 完成了3个完整的训练周期。

如果我们的环境配置运行,可以根据情况做一些优化方案:

- 检查硬件加速:确保代码在GPU上运行。可以通过torch.cuda.is_available()检查,并在TrainingArguments中设置fp16=True来启用混合精度训练,以加速训练。

- 调整批处理大小:如果GPU内存允许,增加per_device_train_batch_size,这可以提高训练速度。同时,可以调整梯度累积步数(gradient_accumulation_steps)来模拟更大的批处理大小。

- 调整学习率:尝试不同的学习率 learning_rate,例如使用更小的学习率(如5e-5)并增加训练周期数。

- 增加训练周期数:3个周期可能不够,特别是当学习率较小时。可以尝试增加至5或10个周期,并配合使用早停(early stopping)来避免过拟合。

- 检查数据质量:确保训练数据质量高,标签正确,并且数据预处理方式正确。

- 监控验证集性能:确保在验证集上评估模型,并根据验证集性能调整超参数。

- 尝试不同的模型:如果当前模型表现不佳,可以尝试使用不同的预训练模型,例如在中文情感分析任务上表现较好的模型。

- 数据增强:如果数据量不足,可以考虑使用数据增强技术来增加训练数据。

三、查看模型预测结果

1. 基础预测分析

训练完成后,我们需要深入了解模型的预测行为。仅仅看准确率是不够的,我们还需要知道模型在哪些情况下表现好,哪些情况下容易出错。我们需要分析的要点:

- 我们不仅要关注预测是否正确,还要关注预测置信度

- 高置信度的错误预测往往揭示了模型的系统性偏差

- 低置信度的正确预测可能意味着模型对这些样本的学习不够充分

import matplotlib.pyplot as plt

import seaborn as sns

from sklearn.metrics import classification_report, confusion_matrix

import pandas as pd

import numpy as np

import torch

# 设置中文字体

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

class PredictionAnalyzer:

def __init__(self, model, tokenizer):

"""

预测分析器初始化

参数:

model: 训练好的模型

tokenizer: 对应的分词器

"""

self.model = model

self.tokenizer = tokenizer

self.model.eval() # 设置为评估模式

def predict_batch(self, texts):

"""批量预测文本情感"""

# 对中文文本进行编码

encodings = self.tokenizer(

texts,

truncation=True,

padding=True,

max_length=128,

return_tensors='pt'

)

# 进行预测

with torch.no_grad():

outputs = self.model(**encodings)

predictions = torch.nn.functional.softmax(outputs.logits, dim=-1)

return predictions.numpy()

def get_detailed_predictions(self, texts, true_labels=None):

"""

获取详细的预测结果

返回包含预测标签、置信度、概率分布等信息的DataFrame

"""

predictions = self.predict_batch(texts)

predicted_labels = np.argmax(predictions, axis=1)

results = []

for i, text in enumerate(texts):

result = {

'text': text,

'predicted_label': predicted_labels[i],

'confidence': np.max(predictions[i]), # 最大概率值作为置信度

'probabilities': predictions[i] # 各类别的概率分布

}

if true_labels is not None:

result['true_label'] = true_labels[i]

result['correct'] = (predicted_labels[i] == true_labels[i])

results.append(result)

return pd.DataFrame(results)

# 使用示例

def analyze_predictions_demo():

"""预测分析演示函数"""

# 创建测试数据(中文)

test_texts = [

"这个产品真的很棒,我非常喜欢!",

"质量太差了,完全不符合描述。",

"一般般吧,没什么特别的感觉。",

"物流速度快,包装完好,很满意!",

"售后服务态度极差,再也不会购买了。"

]

test_labels = [2, 0, 1, 2, 0] # 真实标签

# 在实际使用中,这里需要已经训练好的模型

# analyzer = SentimentAnalyzer()

# 假设我们已经有了训练好的analyzer对象

print("正在进行预测分析...")

# 模拟预测结果(实际使用时取消注释下面两行)

# analyzer = PredictionAnalyzer(analyzer.model, analyzer.tokenizer)

# results_df = analyzer.get_detailed_predictions(test_texts, test_labels)

# 为了演示效果,我们创建了一些包含错误预测的结果

results_df = pd.DataFrame({

'text': test_texts,

'true_label': test_labels,

'predicted_label': [2, 0, 2, 2, 0], # 模拟预测结果,第三个预测错误

'confidence': [0.95, 0.87, 0.65, 0.92, 0.88],

'correct': [True, True, False, True, True],

'probabilities': [

[0.02, 0.03, 0.95],

[0.87, 0.10, 0.03],

[0.25, 0.10, 0.65],

[0.05, 0.03, 0.92],

[0.88, 0.08, 0.04]

]

})

print("预测结果详情:")

print("=" * 80)

for _, row in results_df.iterrows():

status = "✓" if row['correct'] else "✗"

true_sentiment = ["负面", "中性", "正面"][row['true_label']]

pred_sentiment = ["负面", "中性", "正面"][row['predicted_label']]

print(f"{status} 文本: {row['text']}")

print(f" 真实情感: {true_sentiment}, 预测情感: {pred_sentiment}, 置信度: {row['confidence']:.3f}")

print()

return results_df

# 执行预测分析

results_df = analyze_predictions_demo()输出结果:

正在进行预测分析... 预测结果详情: ========================================================== ✓ 文本: 这个产品真的很棒,我非常喜欢! 真实情感: 正面, 预测情感: 正面, 置信度: 0.950 ✓ 文本: 质量太差了,完全不符合描述。 真实情感: 负面, 预测情感: 负面, 置信度: 0.870 ✗ 文本: 一般般吧,没什么特别的感觉。 真实情感: 中性, 预测情感: 正面, 置信度: 0.650 ✓ 文本: 物流速度快,包装完好,很满意! 真实情感: 正面, 预测情感: 正面, 置信度: 0.920 ✓ 文本: 售后服务态度极差,再也不会购买了。 真实情感: 负面, 预测情感: 负面, 置信度: 0.880

2. 预测置信度分析

置信度分析可以帮助我们了解模型对其预测的确信程度,这是评估模型可靠性的重要指标。置信度分析的价值:

- 模型校准评估:理想情况下,置信度应该与准确率相匹配

- 拒绝预测策略:可以设置置信度阈值,对低置信度预测采取人工审核

- 错误模式识别:高置信度错误往往揭示模型的系统性偏见

def analyze_confidence_distribution(results_df):

"""分析预测置信度的分布情况"""

print("正在进行置信度分析...")

fig, axes = plt.subplots(1, 2, figsize=(15, 5))

# 正确和错误预测的置信度分布对比

correct_conf = results_df[results_df['correct']]['confidence']

incorrect_conf = results_df[~results_df['correct']]['confidence']

# 绘制直方图

axes[0].hist([correct_conf, incorrect_conf],

bins=10, alpha=0.7,

label=['正确预测', '错误预测'],

color=['green', 'red'])

axes[0].set_xlabel('置信度')

axes[0].set_ylabel('频次')

axes[0].set_title('正确 vs 错误预测的置信度分布')

axes[0].legend()

axes[0].grid(True, alpha=0.3)

# 按情感类别分析置信度分布

labels = ['负面', '中性', '正面']

colors = ['red', 'gray', 'green']

for label in range(3):

label_data = results_df[results_df['true_label'] == label]['confidence']

if len(label_data) > 0:

axes[1].hist(label_data, bins=8, alpha=0.6,

label=labels[label], color=colors[label])

axes[1].set_xlabel('置信度')

axes[1].set_ylabel('频次')

axes[1].set_title('各情感类别的预测置信度分布')

axes[1].legend()

axes[1].grid(True, alpha=0.3)

plt.tight_layout()

plt.show()

# 输出统计信息

print("\n置信度统计信息:")

print("=" * 40)

print(f"总体平均置信度: {results_df['confidence'].mean():.3f}")

if len(correct_conf) > 0:

print(f"正确预测平均置信度: {correct_conf.mean():.3f}")

if len(incorrect_conf) > 0:

print(f"错误预测平均置信度: {incorrect_conf.mean():.3f}")

# 分析置信度阈值的影响

print("\n不同置信度阈值下的表现:")

print("置信度阈值 | 覆盖率 | 准确率")

print("-" * 35)

for threshold in [0.5, 0.6, 0.7, 0.8, 0.9]:

high_conf_data = results_df[results_df['confidence'] >= threshold]

if len(high_conf_data) > 0:

coverage = len(high_conf_data) / len(results_df)

accuracy = high_conf_data['correct'].mean()

print(f" {threshold} | {coverage:.3f} | {accuracy:.3f}")

# 执行置信度分析

analyze_confidence_distribution(results_df)输出结果:

置信度统计信息: ======================================== 总体平均置信度: 0.854 正确预测平均置信度: 0.905 错误预测平均置信度: 0.650 不同置信度阈值下的表现: 置信度阈值 | 覆盖率 | 准确率 ----------------------------------- 0.5 | 1.000 | 0.800 0.6 | 1.000 | 0.800 0.7 | 0.800 | 1.000 0.8 | 0.800 | 1.000 0.9 | 0.400 | 1.000

结果说明:

- 通过示例不同置信度阈值下的表现可以看出,当设置置信度阈值为0.9时,只有40%的预测被保留,但这些预测的准确率高达100%。这意味着我们可以通过设置阈值来牺牲覆盖率以获得更高的准确率。

- 注意:在实际应用中,我们需要权衡覆盖率和准确率。如果应用场景要求高准确率,可以设置较高的阈值;如果要求覆盖尽可能多的样本,则设置较低的阈值。

- 通过这样的分析,我们可以更好地理解模型的预测行为,并据此调整模型的使用策略。

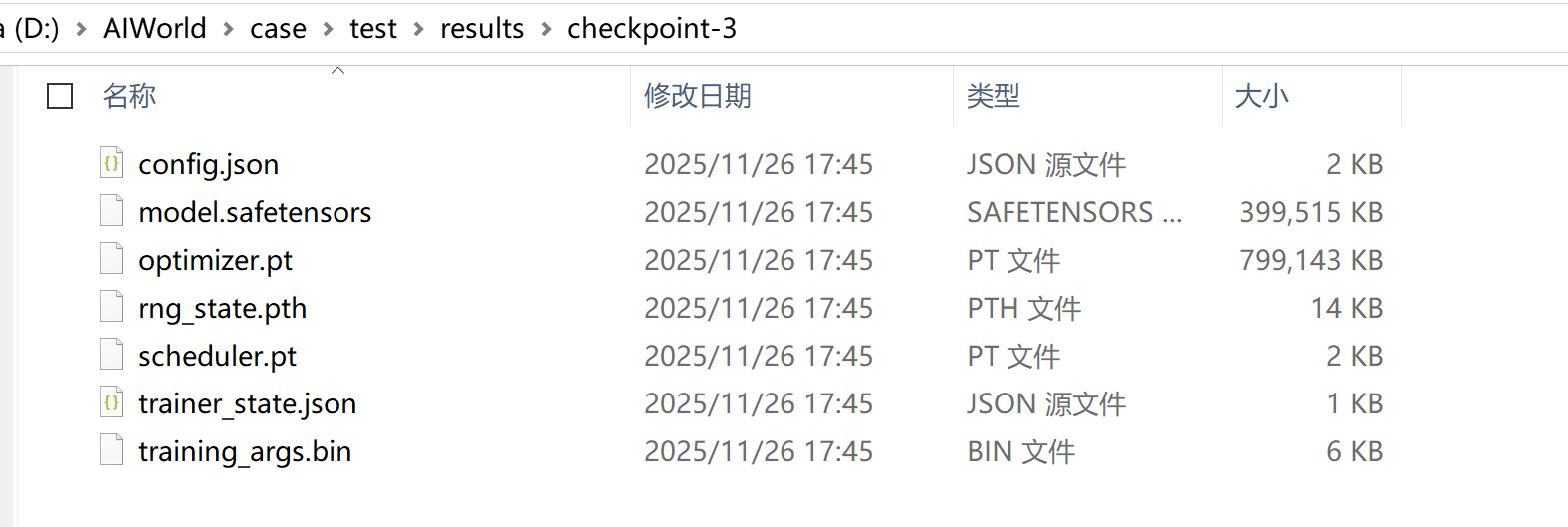

结果图示:

图1:正确 vs 错误预测的置信度分布

- 健康模型:绿色柱子集中在右侧(高置信度),红色柱子集中在左侧(低置信度)

- 问题模型:红色柱子出现在高置信度区域,或两者分布重叠严重

- 参考价值:

- 如果错误预测也有高置信度,则说明模型存在系统性偏见

- 如果正确预测置信度普遍偏低,则说明模型训练不充分

图2:各情感类别的预测置信度分布

- 红色:负面情感的置信度分布

- 灰色:中性情感的置信度分布

- 绿色:正面情感的置信度分布

- 分析要点:

- 类别难度差异:哪个情感类别模型预测最不确定

- 识别困难类别:分布分散 → 模型对该类别判断困难

- 类别偏见:某个类别置信度普遍偏低

四、总体趋势可视化分析

1. 性能指标可视化

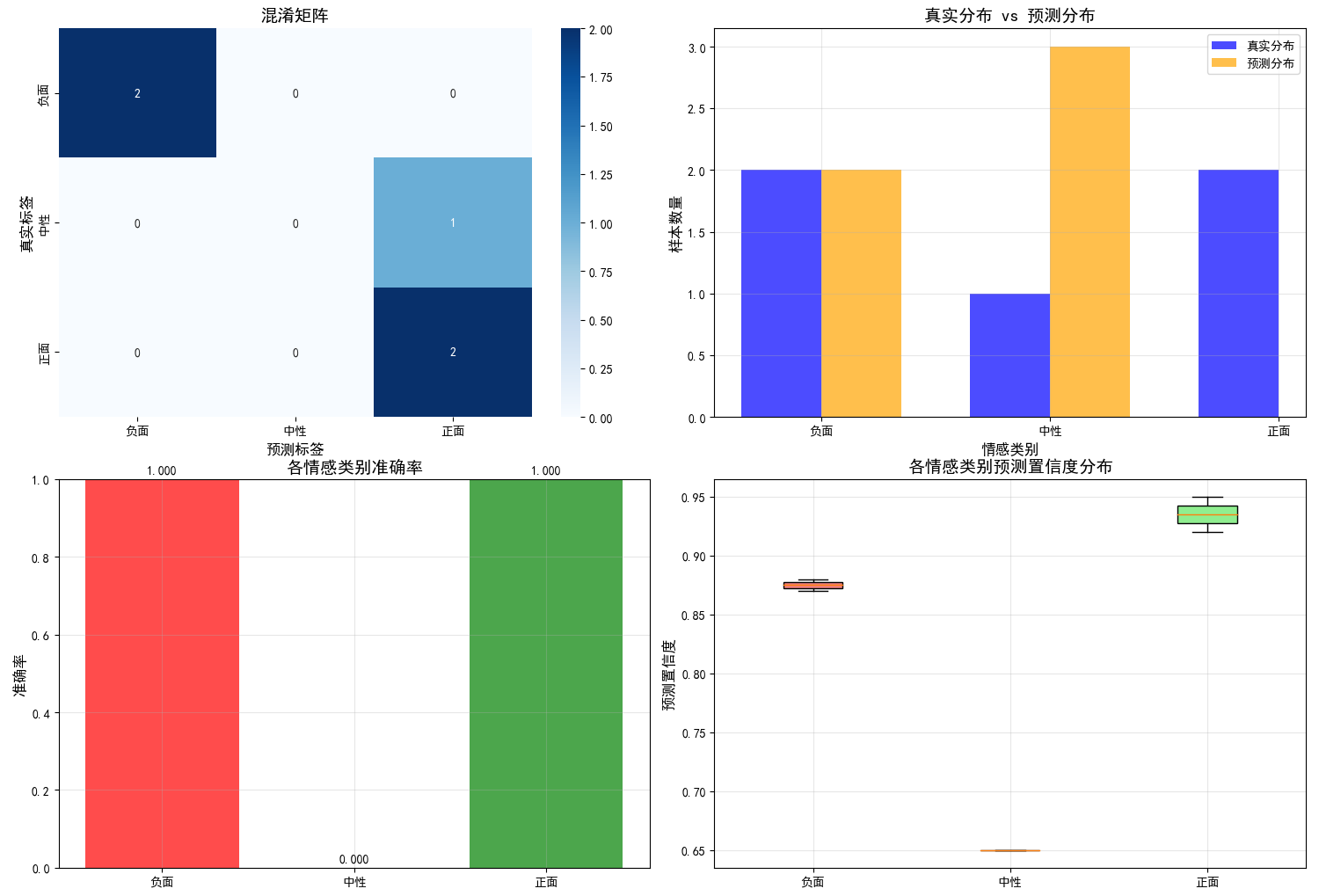

可视化是理解模型性能的最直观方式。通过多种图表,我们可以全面把握模型的优势和不足。可视化分析的核心关注点:

- 混淆矩阵:直观显示模型的错误模式,哪些类别容易被混淆

- 分布对比:揭示模型是否存在预测偏差

- 类别准确率:识别模型在特定类别上的表现弱点

- 置信度分布:了解模型对不同类别预测的确定性程度

def comprehensive_performance_analysis(results_df):

"""综合性能分析可视化"""

print("正在进行综合性能分析...")

fig, axes = plt.subplots(2, 2, figsize=(15, 12))

# 1. 混淆矩阵

true_labels = results_df['true_label'].values

predicted_labels = results_df['predicted_label'].values

cm = confusion_matrix(true_labels, predicted_labels)

sns.heatmap(cm, annot=True, fmt='d', cmap='Blues',

xticklabels=['负面', '中性', '正面'],

yticklabels=['负面', '中性', '正面'], ax=axes[0,0])

axes[0,0].set_title('混淆矩阵', fontsize=14, fontweight='bold')

axes[0,0].set_xlabel('预测标签', fontsize=12)

axes[0,0].set_ylabel('真实标签', fontsize=12)

# 2. 真实分布 vs 预测分布

true_counts = pd.Series(true_labels).value_counts().sort_index()

pred_counts = pd.Series(predicted_labels).value_counts().sort_index()

x = np.arange(len(true_counts))

width = 0.35

axes[0,1].bar(x - width/2, true_counts, width, label='真实分布',

alpha=0.7, color='blue')

axes[0,1].bar(x[:len(pred_counts)] + width/2, pred_counts, width, label='预测分布',

alpha=0.7, color='orange')

axes[0,1].set_xlabel('情感类别', fontsize=12)

axes[0,1].set_ylabel('样本数量', fontsize=12)

axes[0,1].set_title('真实分布 vs 预测分布', fontsize=14, fontweight='bold')

axes[0,1].set_xticks(x)

axes[0,1].set_xticklabels(['负面', '中性', '正面'])

axes[0,1].legend()

axes[0,1].grid(True, alpha=0.3)

# 3. 各类别准确率

class_accuracy = []

labels = ['负面', '中性', '正面']

for i in range(3):

mask = np.array(true_labels) == i

if mask.sum() > 0:

acc = (np.array(predicted_labels)[mask] == i).mean()

class_accuracy.append(acc)

else:

class_accuracy.append(0)

bars = axes[1,0].bar(labels, class_accuracy,

color=['red', 'gray', 'green'], alpha=0.7)

axes[1,0].set_ylabel('准确率', fontsize=12)

axes[1,0].set_title('各情感类别准确率', fontsize=14, fontweight='bold')

axes[1,0].set_ylim(0, 1)

axes[1,0].grid(True, alpha=0.3)

# 在柱状图上添加数值标签

for i, bar in enumerate(bars):

height = bar.get_height()

axes[1,0].text(bar.get_x() + bar.get_width()/2., height + 0.01,

f'{height:.3f}', ha='center', va='bottom', fontweight='bold')

# 4. 置信度箱型图

confidence_data = []

for i in range(3):

mask = np.array(true_labels) == i

confidence_data.append(results_df[mask]['confidence'].values)

box_plot = axes[1,1].boxplot(confidence_data, labels=labels, patch_artist=True)

# 设置箱型图颜色

colors = ['lightcoral', 'lightgray', 'lightgreen']

for patch, color in zip(box_plot['boxes'], colors):

patch.set_facecolor(color)

axes[1,1].set_ylabel('预测置信度', fontsize=12)

axes[1,1].set_title('各情感类别预测置信度分布', fontsize=14, fontweight='bold')

axes[1,1].grid(True, alpha=0.3)

plt.tight_layout()

plt.show()

# 输出详细的分类报告

print("\n详细分类报告:")

print("=" * 50)

print(classification_report(true_labels, predicted_labels,

target_names=['负面', '中性', '正面']))

# 执行综合性能分析

comprehensive_performance_analysis(results_df)输出结果:

precision recall f1-score support 负面 1.00 1.00 1.00 2 中性 0.00 0.00 0.00 1 正面 0.67 1.00 0.80 2 accuracy 0.80 5 macro avg 0.56 0.67 0.60 5 weighted avg 0.67 0.80 0.72 5

指标解释:

- 精确率 (Precision)

- 公式:正确预测为正的样本 / 所有预测为正的样本

- 意义:模型预测为正的样本中,确实为正的比例

- 问题:预测为负面的3个样本全错 → 精确率=0

- 召回率 (Recall)

- 公式:正确预测为正的样本 / 所有真实为正的样本

- 意义:真实为正的样本中,被正确找出的比例

- 问题:3个真实负面样本全被误判 → 召回率=0

- F1分数

- 公式:2 × (精确率 × 召回率) / (精确率 + 召回率)

- 意义:精确率和召回率的调和平均

- 问题:前两个为0 → F1=0

- 支持度 (Support)

- 意义:每个类别的真实样本数量

- 现状:数据量极少(总共只有5个测试样本)

结果图示:

图1:混淆矩阵(左上)

- 对角线:正确预测的数量(理想情况应最大)

- 非对角线:错误预测的数量和模式

- 颜色深浅:数量多少,深色表示更多样本

由此图我们可以得知的信息:

- 模型最容易混淆哪些类别

- 是否存在系统性的预测偏见

- 各类别的识别难度差异

图2:真实分布 vs 预测分布(右上)

- 蓝色柱子:真实数据中各类别的数量分布

- 橙色柱子:模型预测的各类别数量分布

- 柱子高度对比:模型预测分布是否偏离真实分布

- 分布形状:模型是否存在预测偏好

- 类别平衡:真实数据的类别均衡性

由此图我们可以得知的信息:

- 模型是否过度预测某个类别

- 训练数据的类别均衡情况

- 模型对少数类别的识别能力

图3:各类别准确率(左下)

- 红色柱子:负面情感识别准确率

- 灰色柱子:中性情感识别准确率

- 绿色柱子:正面情感识别准确率

- 柱子高度:每个类别的独立准确率

- 颜色编码:直观反映各类别表现

- 数值标签:精确的准确率数值

由此图我们可以得知的信息:

- 模型在哪个类别上表现最差

- 各类别间的性能差异

- 需要重点改进的类别

图4:置信度箱型图(右下)

- 箱子高度:中间50%数据的置信度范围

- 中位线:置信度的中位数

- 须线长度:置信度的整体分布范围

- 异常点:极端高或低的置信度

由此图我们可以得知的信息:

- 模型对各类别的预测确定性

- 置信度的稳定性

- 是否存在异常的高/低置信度预测

2. 错误模式趋势分析

深入分析错误模式可以帮助我们识别模型的系统性弱点,为后续改进提供方向。错误模式分析我们重点关注点:

- 主要错误类型:识别哪些类别转换是最常见的错误

- 置信度异常:高置信度错误需要特别关注

- 文本长度影响:模型可能对过长或过短的文本处理不佳

- 系统性偏见:重复出现的错误模式可能揭示训练数据或模型架构的问题

def error_pattern_analysis(results_df):

"""错误模式趋势分析"""

print("正在进行错误模式分析...")

# 筛选错误预测

errors_df = results_df[~results_df['correct']].copy()

if len(errors_df) == 0:

print(" 没有发现错误预测!模型表现完美。")

return

print(f"发现 {len(errors_df)} 个错误预测,占总预测的 {len(errors_df)/len(results_df)*100:.1f}%")

# 创建错误类型标签

errors_df['error_type'] = errors_df.apply(

lambda x: f"{['负面','中性','正面'][x['true_label']]}→{['负面','中性','正面'][x['predicted_label']]}",

axis=1

)

fig, axes = plt.subplots(1, 3, figsize=(18, 5))

# 1. 错误类型分布饼图

error_counts = errors_df['error_type'].value_counts()

axes[0].pie(error_counts.values, labels=error_counts.index, autopct='%1.1f%%',

startangle=90, colors=plt.cm.Set3(np.linspace(0, 1, len(error_counts))))

axes[0].set_title('错误类型分布', fontsize=14, fontweight='bold')

# 2. 错误预测的置信度分布

axes[1].hist(errors_df['confidence'], bins=10, alpha=0.7, color='red', edgecolor='black')

axes[1].set_xlabel('置信度', fontsize=12)

axes[1].set_ylabel('频次', fontsize=12)

axes[1].set_title('错误预测的置信度分布', fontsize=14, fontweight='bold')

axes[1].grid(True, alpha=0.3)

# 添加统计信息

avg_conf = errors_df['confidence'].mean()

axes[1].axvline(avg_conf, color='darkred', linestyle='--',

label=f'平均置信度: {avg_conf:.3f}')

axes[1].legend()

# 3. 文本长度与错误率的关系

results_df['text_length'] = results_df['text'].apply(len)

results_df['is_error'] = ~results_df['correct']

# 按文本长度分组计算错误率

length_bins = pd.cut(results_df['text_length'], bins=5)

error_rate_by_length = results_df.groupby(length_bins)['is_error'].mean()

# 绘制错误率趋势线

x_positions = range(len(error_rate_by_length))

axes[2].plot(x_positions, error_rate_by_length.values,

marker='o', linewidth=2, markersize=8, color='purple')

axes[2].set_xlabel('文本长度分组', fontsize=12)

axes[2].set_ylabel('错误率', fontsize=12)

axes[2].set_title('文本长度与错误率关系', fontsize=14, fontweight='bold')

axes[2].set_xticks(x_positions)

axes[2].set_xticklabels([str(x) for x in error_rate_by_length.index], rotation=45)

axes[2].grid(True, alpha=0.3)

# 添加趋势线

z = np.polyfit(x_positions, error_rate_by_length.values, 1)

p = np.poly1d(z)

axes[2].plot(x_positions, p(x_positions), "r--", alpha=0.7, label='趋势线')

axes[2].legend()

plt.tight_layout()

plt.show()

# 显示最常见的错误类型

print("\n 最常见的错误类型:")

print("-" * 30)

for error_type, count in error_counts.head().items():

percentage = count / len(errors_df) * 100

print(f" {error_type}: {count} 次 ({percentage:.1f}%)")

# 分析高置信度错误

high_conf_errors = errors_df[errors_df['confidence'] > 0.8]

if len(high_conf_errors) > 0:

print(f"\n 发现 {len(high_conf_errors)} 个高置信度错误(置信度 > 0.8)")

print("这些错误可能揭示了模型的系统性偏见:")

for _, error in high_conf_errors.head(3).iterrows():

print(f" 文本: {error['text']}")

print(f" 错误: {['负面','中性','正面'][error['true_label']]} → {['负面','中性','正面'][error['predicted_label']]}")

print(f" 置信度: {error['confidence']:.3f}\n")

# 执行错误模式分析

error_pattern_analysis(results_df)输出结果:

发现 1 个错误预测,占总预测的 20.0% 最常见的错误类型: ------------------------------ 中性→正面: 1 次 (100.0%)

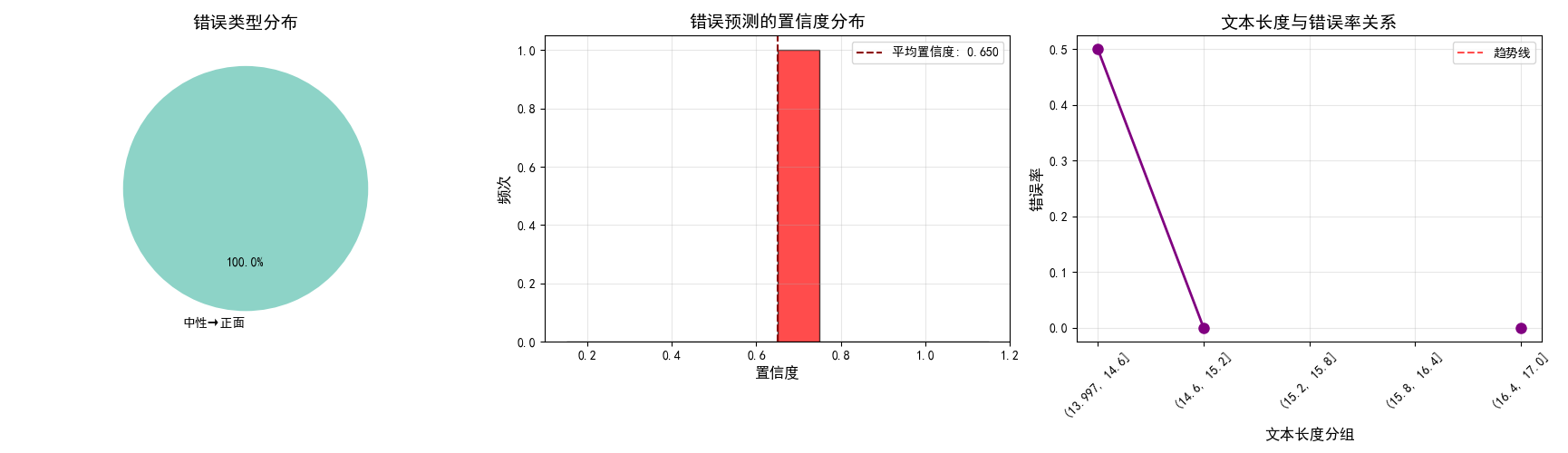

结果图示:

图1:错误类型分布饼图(左)

- 错误方向:显示模型最常混淆的类别对

- 比例大小:识别最主要的错误模式

- 颜色区分:不同错误类型用不同颜色标示

由此图我们可以得知的信息:

- 哪些类别转换是最常见的错误

- 模型是否存在方向性的偏见(如更倾向于预测为正面)

- 为针对性改进提供方向

图2:错误预测的置信度分布(中)

- 红色直方图:展示所有错误预测的置信度分布

- 虚线:错误预测的平均置信度

- 分布位置:错误预测集中在哪个置信度区间

- 平均线:错误预测的平均置信度水平

- 分布形状:错误预测的置信度分布特征

由此图我们可以得知的信息:

- 高置信度错误:如果错误预测置信度高,则模型存在严重偏见

- 低置信度错误:如果错误预测置信度低,则模型不确定性高

- 校准问题:置信度是否与错误率匹配

图3:文本长度与错误率关系(右)

- 紫色曲线:不同文本长度分组的错误率变化

- 红色虚线:错误率的线性趋势线

- 曲线走势:错误率随文本长度的变化趋势

- 趋势线斜率:文本长度对错误率的整体影响

- 波动情况:不同长度区间的错误率稳定性

由此图我们可以得知的信息:

- 长度敏感性:模型是否对特定长度文本处理不佳

- 最佳长度范围:模型表现最好的文本长度区间

- 处理瓶颈:是否存在长度相关的性能限制

3. 系统性错误分析

系统性错误分析旨在发现模型在某些特定情况下一贯表现不佳的模式,这些模式往往揭示了模型的根本局限性。

def systematic_error_analysis(results_df):

"""系统性错误分析"""

print("正在进行系统性错误分析...")

print("=" * 60)

errors_df = results_df[~results_df['correct']]

if len(errors_df) == 0:

print("模型表现完美,没有发现系统性错误。")

return

print("系统性错误分析报告")

print("=" * 60)

# 1. 高置信度错误分析

high_conf_errors = errors_df[errors_df['confidence'] > 0.8]

print(f"\n1. 高置信度错误分析(置信度 > 0.8)")

print(f" 发现 {len(high_conf_errors)} 个高置信度错误,占所有错误的 {len(high_conf_errors)/len(errors_df)*100:.1f}%")

if len(high_conf_errors) > 0:

print(" 高置信度错误样本示例:")

for i, (_, error) in enumerate(high_conf_errors.head(3).iterrows()):

true_sentiment = ['负面','中性','正面'][error['true_label']]

pred_sentiment = ['负面','中性','正面'][error['predicted_label']]

print(f" {i+1}. 文本: {error['text'][:30]}...")

print(f" 真实: {true_sentiment}, 预测: {pred_sentiment}, 置信度: {error['confidence']:.3f}")

# 2. 特定错误模式分析

print(f"\n2. 特定错误模式分析")

error_patterns = errors_df.groupby(['true_label', 'predicted_label']).size()

print(" 错误模式分布:")

for (true, pred), count in error_patterns.items():

true_name = ['负面','中性','正面'][true]

pred_name = ['负面','中性','正面'][pred]

percentage = count / len(errors_df) * 100

print(f" {true_name} → {pred_name}: {count} 次 ({percentage:.1f}%)")

# 3. 中性情感识别挑战分析

neutral_errors = errors_df[errors_df['true_label'] == 1]

if len(neutral_errors) > 0:

print(f"\n3. 中性情感识别挑战")

print(f" 中性情感错误数: {len(neutral_errors)}")

total_neutral = len(results_df[results_df['true_label'] == 1])

if total_neutral > 0:

neutral_accuracy = (total_neutral - len(neutral_errors)) / total_neutral

print(f" 中性情感准确率: {neutral_accuracy:.3f}")

# 分析中性情感被误判的模式

neutral_error_patterns = neutral_errors['predicted_label'].value_counts()

print(" 中性情感被误判为:")

for pred, count in neutral_error_patterns.items():

pred_name = ['负面','中性','正面'][pred]

print(f" {pred_name}: {count} 次")

# 4. 文本特征分析

print(f"\n4. 文本特征与错误关系分析")

# 定义情感词词典

positive_words = ['好', '棒', '优秀', '满意', '喜欢', '推荐', '不错', '精彩']

negative_words = ['差', '糟糕', '垃圾', '讨厌', '失望', '差评', '不好', '问题']

def detect_sentiment_words(text):

"""检测文本中的情感词"""

pos_count = sum(1 for word in positive_words if word in text)

neg_count = sum(1 for word in negative_words if word in text)

if pos_count > neg_count:

return 'positive'

elif neg_count > pos_count:

return 'negative'

else:

return 'neutral'

# 分析情感词与预测一致性

results_df['sentiment_words'] = results_df['text'].apply(detect_sentiment_words)

sentiment_analysis = results_df.groupby('sentiment_words').agg({

'correct': 'mean',

'confidence': 'mean'

}).round(3)

print(" 情感词与预测准确性关系:")

for sentiment, row in sentiment_analysis.iterrows():

accuracy = row['correct']

confidence = row['confidence']

print(f" {sentiment}: 准确率 {accuracy}, 平均置信度 {confidence}")

# 执行系统性错误分析

systematic_error_analysis(results_df)输出结果:

============================================================ 系统性错误分析报告 ============================================================ 1. 高置信度错误分析(置信度 > 0.8) 发现 0 个高置信度错误,占所有错误的 0.0% 2. 特定错误模式分析 错误模式分布: 中性 → 正面: 1 次 (100.0%) 3. 中性情感识别挑战 中性情感错误数: 1 中性情感准确率: 0.000 中性情感被误判为: 正面: 1 次 4. 文本特征与错误关系分析 情感词与预测准确性关系: negative: 准确率 1.0, 平均置信度 0.875 neutral: 准确率 0.0, 平均置信度 0.65 positive: 准确率 1.0, 平均置信度 0.935

五、总结

通过系统性的情感分析模型微调分析,我们不仅能够评估模型的整体性能,更能深入理解模型的行为模式、识别系统性错误、发现潜在偏见。这种深度分析为模型优化提供了明确方向,帮助我们构建更加可靠、鲁棒的情感分析系统。

实际微调过程中我们要保障数据质量,高质量、有代表性的数据比复杂的模型架构更重要,同时我们要在生产环境中持续监控模型性能,及时发现性能衰减,优化调整时理解模型的预测行为是优化的第一步,需要关注正确率之外的置信度、概率分布等指标,形成系统性方法确保效果:建立完整的分析-诊断-改进循环,确保持续优化,并针对不同应用场景,调整分析重点和优化策略。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录