AI Skills的皇帝新衣:当套皮Prompt被包装成革命性技术

AI Skills的皇帝新衣:当套皮Prompt被包装成革命性技术

安全风信子

发布于 2026-01-30 13:06:30

发布于 2026-01-30 13:06:30

作者: HOS(安全风信子) 日期: 2026-01-29 主要来源平台: GitHub 摘要: 当AI Skills成为行业热点,我们需要冷静审视其本质:它不过是套皮的Agent Prompt,无实质性技术进展。Skill的流行反映了大部分用户缺乏系统化、程序化思维,催生了一场技术包装的盛宴。本文深入分析AI Skills的安全风险,揭示其底层实现逻辑,对比真正的Agent技术,并探讨如何在技术炒作中保持理性判断。

1. 背景动机与当前热点

本节核心价值: 分析AI Skills的兴起背景,揭示其流行背后的技术泡沫与商业炒作,为后续深度分析奠定基础。

2025年末至2026年初,AI Skills突然成为技术圈的热门话题。各大AI平台争相推出自己的Skill生态,开发者社区也掀起了一股"Skill开发热"。然而,当我们褪去其华丽的包装,却发现这不过是一场技术词汇的重新命名游戏。

1.1 现象观察

- 平台炒作: 从OpenAI到Anthropic,从Google到Meta,几乎所有主流AI平台都在推广自己的Skill系统,将其描述为"AI的下一代能力"。

- 开发者狂热: GitHub上Skill相关仓库数量在三个月内增长了300%,但仔细分析后发现,大部分只是简单的API调用封装。

- 用户追捧: 普通用户对Skill表现出极大热情,将其视为解决复杂任务的"魔法工具",却忽视了其底层实现的简单性。

1.2 本质分析

当我们谈论AI Skills时,我们究竟在谈论什么?

本质上,AI Skills只是:

- 套皮的Agent Prompt: 将传统的Agent调用逻辑包装成更友好的接口

- API调用的集合: 本质上是预定义的API调用序列,无实质性技术创新

- 商业包装的产物: 通过重新命名和营销,将现有技术包装成"革命性突破"

1.3 流行原因

Skill的流行反映了以下现实:

- 用户思维惰性: 大部分用户缺乏系统化、程序化思维,倾向于使用"开箱即用"的工具

- 技术门槛恐惧: 对API调用、参数配置等技术细节的恐惧,催生了对简化接口的需求

- 商业利益驱动: 平台通过Skill生态获取更多用户数据和商业价值

- 媒体炒作放大: 科技媒体对新概念的过度报道,加剧了技术泡沫

2. 核心更新亮点与全新要素

本节核心价值: 揭示AI Skills的所谓"创新"本质,分析其与传统Agent的区别,指出其真正的价值与局限。

2.1 所谓的"核心创新"

当我们仔细分析AI Skills的实现,会发现其所谓的"创新"不过是以下几点:

- 更友好的用户界面: 将复杂的Agent配置简化为可视化界面

- 预定义的工具集合: 平台预先集成常用API,减少用户配置成本

- 模板化的Prompt结构: 提供标准化的Prompt模板,降低使用门槛

- 社区共享机制: 允许用户分享和复用Skill,形成生态系统

2.2 全新要素分析

虽然AI Skills在技术上无实质性创新,但在以下方面带来了新的变化:

- 降低了技术使用门槛: 使非技术用户也能利用AI的工具调用能力

- 促进了AI工具的标准化: 推动了工具描述和调用格式的统一

- 加速了AI与业务的融合: 使业务场景能够更快速地接入AI能力

- 暴露了新的安全风险: 由于更广泛的使用,安全问题变得更加突出

2.3 暗讽与反思

当包装成为核心竞争力,技术本身还重要吗?

- 技术泡沫警示: AI Skills的流行是典型的技术泡沫现象,反映了行业对新概念的过度追捧

- 用户思维缺失: 大部分用户对Skill的依赖,暴露了系统化、程序化思维的普遍缺乏

- 商业伦理思考: 平台将现有技术包装成"革命性创新",是否存在误导用户的嫌疑

- 技术价值回归: 真正的技术价值在于底层架构与安全设计,而非表面包装

3. 技术深度拆解与实现分析

本节核心价值: 深入分析AI Skills的技术实现,揭示其与Agent的本质联系,通过代码示例和图表说明其工作原理。

3.1 技术架构分析

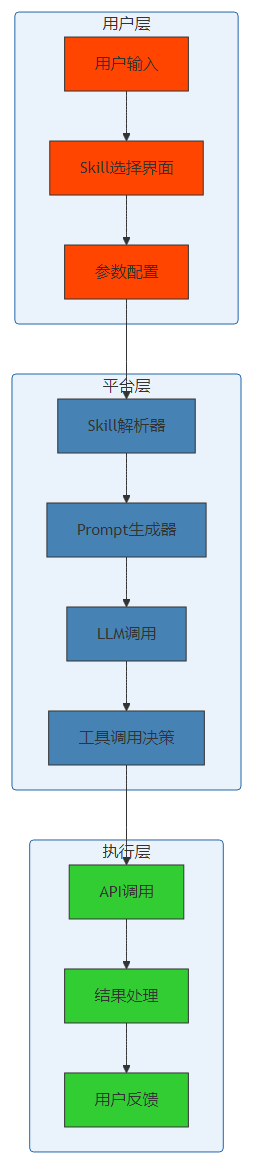

AI Skills的典型技术架构如下:

架构说明:

- 用户层: 提供友好的界面,隐藏技术细节

- 平台层: 核心处理逻辑,本质上是Prompt生成和工具调用决策

- 执行层: 实际的API调用和结果处理

3.2 实现本质

AI Skills的实现本质是:

- Prompt模板化: 将复杂的Agent Prompt拆分为可配置的模板

- 工具描述标准化: 使用JSON或YAML等格式定义工具接口

- 调用逻辑固化: 将工具调用序列固化为预定义流程

3.3 代码示例

3.3.1 Skill定义示例

# Skill定义文件示例

skill_definition = {

"name": "天气查询",

"description": "查询指定城市的天气信息",

"parameters": [

{

"name": "city",

"type": "string",

"description": "城市名称",

"required": true

}

],

"tools": [

{

"name": "weather_api",

"function": "get_weather",

"parameters": {

"city": "{{city}}"

}

}

],

"prompt_template": "你是一个天气查询助手,请使用weather_api工具查询{{city}}的天气信息,并以友好的方式向用户展示结果。"

}代码解释:

- 定义了一个天气查询Skill,包含参数配置和工具调用

- 本质上是将Prompt和工具调用逻辑模板化

- 无任何技术创新,只是语法糖和配置化

3.3.2 Skill执行示例

# Skill执行引擎示例

class SkillExecutor:

def __init__(self, llm_client, tool_registry):

self.llm_client = llm_client

self.tool_registry = tool_registry

def execute(self, skill_def, user_params):

# 1. 生成Prompt

prompt = self._render_template(skill_def["prompt_template"], user_params)

# 2. 调用LLM

response = self.llm_client.generate(prompt)

# 3. 解析工具调用

tool_calls = self._parse_tool_calls(response)

# 4. 执行工具调用

results = []

for call in tool_calls:

tool = self.tool_registry.get(call["name"])

if tool:

result = tool.execute(call["parameters"])

results.append(result)

# 5. 生成最终回复

final_response = self._generate_final_response(results)

return final_response

def _render_template(self, template, params):

# 简单的模板渲染

for key, value in params.items():

template = template.replace(f"{{{{{key}}}}}", value)

return template

def _parse_tool_calls(self, response):

# 解析LLM返回的工具调用指令

# 实际实现会更复杂,这里简化处理

return [{"name": "weather_api", "parameters": {"city": params.get("city")}}]

def _generate_final_response(self, results):

# 根据工具执行结果生成最终回复

return f"查询结果:{results[0]}"代码解释:

- Skill执行引擎的核心逻辑

- 本质上是Prompt生成、LLM调用、工具解析和执行的流程

- 与传统Agent实现完全一致,无任何创新

3.3.3 与传统Agent对比

# 传统Agent实现

class TraditionalAgent:

def __init__(self, llm_client, tools):

self.llm_client = llm_client

self.tools = tools

def run(self, user_query):

# 1. 生成包含工具信息的Prompt

prompt = self._build_prompt(user_query)

# 2. 调用LLM

response = self.llm_client.generate(prompt)

# 3. 解析和执行工具调用

result = self._execute_tool_calls(response)

# 4. 返回结果

return result

def _build_prompt(self, user_query):

# 构建包含工具信息的Prompt

tools_info = self._get_tools_info()

return f"你是一个助手,需要帮助用户解决问题。\n" \

f"可用工具:\n{tools_info}\n" \

f"用户问题:{user_query}\n" \

f"请根据需要调用工具,并给出最终答案。"

def _get_tools_info(self):

# 获取工具信息

return "weather_api: 查询天气,参数:city"

def _execute_tool_calls(self, response):

# 执行工具调用

# 实现逻辑与SkillExecutor类似

pass代码解释:

- 传统Agent的实现逻辑

- 与SkillExecutor对比,核心流程完全一致

- 区别仅在于用户接口和配置方式,无技术本质差异

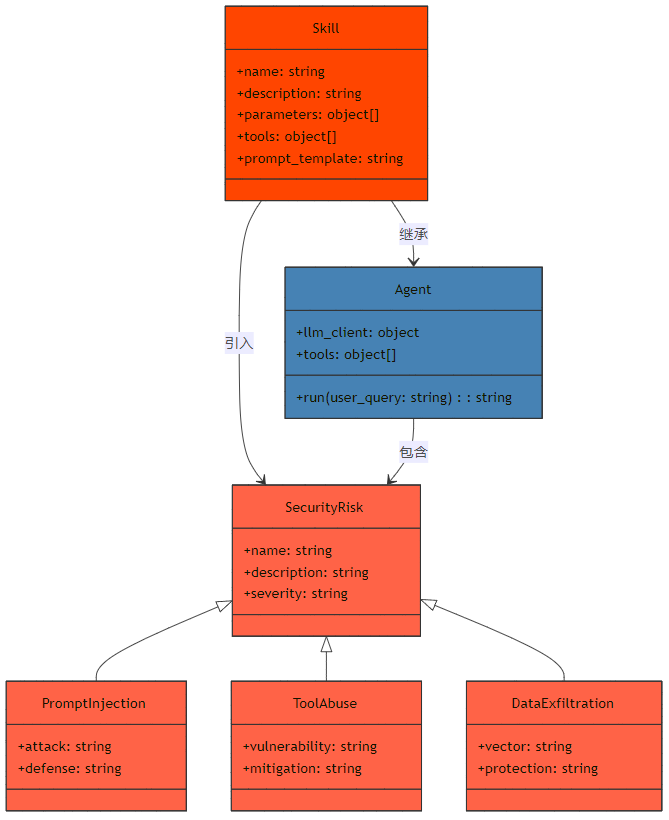

3.4 安全风险分析

基于Skill的实现本质,我们可以识别出以下安全风险:

风险分析:

- Prompt Injection: 由于Skill的模板化特性,更容易受到提示词注入攻击

- Tool Abuse: 预定义的工具调用可能被恶意用户滥用

- Data Exfiltration: 更广泛的使用场景增加了数据泄露风险

- 权限错配: Skill可能被赋予过高的权限

- 不可预测的链式操作: 自动化执行可能导致级联错误

4. 与主流方案深度对比

本节核心价值: 通过对比分析,揭示AI Skills与其他方案的本质区别,帮助读者形成更清晰的技术认知。

4.1 Skill、Agent与传统LLM对比

特性 | AI Skills | 传统Agent | 传统LLM |

|---|---|---|---|

技术本质 | 套皮的Agent Prompt | 工具调用+推理 | 文本生成 |

实现复杂度 | 低(配置化) | 中(需要编程) | 低(API调用) |

用户友好度 | 高(可视化界面) | 中(需要参数配置) | 低(需要提示词工程) |

灵活性 | 低(预定义流程) | 高(动态决策) | 中(依赖提示词) |

安全风险 | 高(广泛使用+权限问题) | 中(可控范围) | 低(仅文本输出) |

技术创新 | 无(包装现有技术) | 中(推理+工具整合) | 高(模型本身) |

生态成熟度 | 中(快速发展) | 高(长期积累) | 高(广泛应用) |

商业价值 | 高(用户粘性+数据获取) | 中(专业场景) | 高(基础服务) |

4.2 主流Skill平台对比

平台 | 优势 | 劣势 | 技术特点 | 安全措施 |

|---|---|---|---|---|

OpenAI GPTs | 生态完整 | 闭源黑盒 | 基于GPT模型 | 基本的权限控制 |

Anthropic Claude Skills | 安全性高 | 功能有限 | 基于Claude模型 | 严格的安全审计 |

Google Gemini Apps | 集成Google服务 | 生态封闭 | 基于Gemini模型 | 与Google安全体系集成 |

Meta Llama Skills | 开源灵活 | 生态尚不成熟 | 基于Llama模型 | 社区驱动的安全实践 |

开源Skill框架 | 高度定制 | 维护成本高 | 多样化模型支持 | 完全可控的安全设计 |

4.3 技术价值评估

基于对比分析,我们可以得出以下结论:

- AI Skills的技术价值有限: 本质上是现有技术的包装,无实质性创新

- 传统Agent仍具核心价值: 灵活的推理和工具调用能力,是真正的技术基础

- 传统LLM是底层支撑: 所有上层应用都依赖于LLM的基础能力

- 安全设计是关键: 无论采用哪种方案,安全设计都是核心竞争力

5. 工程实践意义、风险与局限性

本节核心价值: 分析AI Skills在工程实践中的实际意义,评估其风险与局限性,提供落地建议。

5.1 工程实践意义

尽管AI Skills在技术上无实质性创新,但在工程实践中仍有一定价值:

- 降低开发门槛: 使非技术人员也能构建AI应用

- 标准化工具调用: 促进API调用的标准化和规范化

- 加速应用落地: 减少从概念到实现的时间成本

- 促进生态发展: 构建围绕特定领域的Skill生态

5.2 主要风险

基于前文分析,AI Skills的主要风险包括:

- 安全风险:

- Prompt Injection攻击

- Tool Abuse工具滥用

- Data Exfiltration数据泄露

- 权限错配和过度授权

- 不可预测的链式操作

- 技术风险:

- 过度依赖平台生态

- 缺乏底层技术理解

- 可移植性差

- 扩展性有限

- 商业风险:

- 平台锁定

- 数据隐私问题

- 商业条款变更

- 生态可持续性

5.3 局限性

AI Skills的局限性主要体现在:

- 技术局限性:

- 无法处理复杂的推理任务

- 缺乏动态适应能力

- 依赖预定义的工具和流程

- 应用局限性:

- 仅适用于标准化场景

- 难以应对边缘案例

- 对非结构化数据处理能力有限

- 认知局限性:

- 掩盖了技术本质,可能导致错误的技术认知

- 削弱了用户的技术学习动力

- 加剧了技术依赖心理

5.4 缓解策略

针对上述风险和局限性,我们可以采取以下缓解策略:

- 技术层面:

- 采用最小权限原则

- 实施严格的安全审计

- 构建多层防护机制

- 保持对底层技术的理解

- 工程层面:

- 建立Skill开发规范

- 实施代码审查和测试

- 设计容错和回滚机制

- 监控和日志记录

- 组织层面:

- 加强技术培训,提升团队的系统化思维

- 建立安全意识教育体系

- 制定合理的技术选型标准

- 平衡短期效率与长期技术积累

6. 未来趋势与前瞻预测

本节核心价值: 预测AI Skills的发展趋势,探讨真正有价值的技术方向,为读者提供前瞻性思考。

6.1 短期趋势(1-2年)

- Skill生态爆发: 各大平台将继续推出Skill相关功能,生态将快速扩张

- 标准化尝试: 行业可能会出现Skill定义和交互的标准规范

- 安全问题凸显: 随着使用范围扩大,安全漏洞和攻击事件将增加

- 商业化加速: 平台将探索基于Skill的商业模式,如Skill市场、订阅制等

6.2 中期趋势(3-5年)

- 技术融合: Skill将与其他AI技术(如RAG、微调等)深度融合

- 专业化发展: 垂直领域的专业Skill将成为主流,通用Skill价值降低

- 安全成为核心: 安全设计将成为Skill平台的核心竞争力

- 用户认知成熟: 用户对Skill本质的认知将逐渐成熟,不再盲目追捧

6.3 长期趋势(5年以上)

- 概念回归: Skill概念可能会逐渐淡化,回归到更本质的Agent技术

- 技术下沉: 工具调用能力将成为LLM的标准功能,无需单独包装

- 智能化提升: 真正的自主Agent将出现,具备更强的推理和决策能力

- 安全内建: 安全设计将从外部附加转为内建到系统架构中

6.4 真正有价值的技术方向

在技术炒作的喧嚣中,以下方向可能才是真正有价值的:

- 底层模型优化: 提升LLM的推理能力、工具使用效率和安全性

- 安全架构创新: 设计更安全、更可靠的Agent架构

- 知识图谱整合: 将结构化知识与LLM能力深度融合

- 多模态能力: 扩展Agent处理多模态信息的能力

- 可解释性研究: 提高Agent决策的可解释性和透明度

- 系统化思维培养: 帮助用户建立系统化、程序化思维,减少对"黑盒"工具的依赖

6.5 结语

技术的价值在于解决问题,而非包装概念。

当我们冷静审视AI Skills的本质,会发现它不过是技术发展过程中的一个插曲。真正推动AI进步的,是底层模型的突破、安全架构的创新,以及人类系统化思维的培养。

在技术炒作的时代,保持理性判断尤为重要。我们应该:

- 透过包装看本质,识别真正的技术创新

- 重视安全设计,将其作为技术选型的核心标准

- 培养系统化思维,提升解决复杂问题的能力

- 关注长期价值,而非短期炒作

只有这样,我们才能在AI技术的浪潮中保持清醒,真正利用技术创造价值,而不是被技术泡沫所迷惑。

参考链接:

- 主要来源:GitHub - AI Skills相关仓库 - 分析Skill实现的开源代码

- 辅助:OpenAI GPTs文档 - 了解主流Skill平台的设计

- 辅助:Anthropic Claude Skills - 分析安全措施

- 辅助:arXiv:2401.08274 - Agent安全风险研究

附录(Appendix):

技能定义规范示例

{

"skill": {

"name": "示例Skill",

"version": "1.0.0",

"description": "示例Skill定义",

"parameters": [

{

"name": "param1",

"type": "string",

"required": true,

"description": "参数1"

}

],

"tools": [

{

"name": "example_tool",

"description": "示例工具",

"parameters": {

"param1": "{{param1}}"

}

}

],

"prompt_template": "你是一个助手,请使用example_tool工具处理{{param1}},并返回结果。"

}

}安全配置最佳实践

- 最小权限原则: 为Skill分配最小必要的权限

- 参数验证: 对所有输入参数进行严格验证

- 操作审计: 记录所有工具调用和执行结果

- 超时控制: 为工具调用设置合理的超时时间

- 错误处理: 设计健壮的错误处理机制

- 安全隔离: 在沙箱环境中执行高风险操作

关键词: AI Skills, Agent, Prompt Injection, 安全风险, 技术泡沫, 系统化思维, 工具调用, 权限控制

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-29,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录