当全世界都在谈论千亿大模型,工厂里的流水线却只相信 YOLO

原创当全世界都在谈论千亿大模型,工厂里的流水线却只相信 YOLO

原创

CoovallyAIHub

修改于 2026-01-23 09:52:18

修改于 2026-01-23 09:52:18

2026年刚刚开始还没站稳脚跟,YOLO26就悄无声息地更新了。

YOLO26就这样出现在我们眼前——结构更轻、推理更快、工程表现也更稳了。它似乎又一次拽着“实时目标检测”的衣角,把它拉回到工厂的流水线、监控室的屏幕边,拉回到那些真实存在、尘土与电流交织的工业场景里。

可另一边,科技界的叙事却朝着完全不同的方向狂奔。

多模态大模型早已迈进百亿、千亿参数的俱乐部,视觉语言模型被不少人奉为“新范式”,一句话生成检测结果、跨任务泛化,听起来仿佛无所不能。

于是很多人不禁想问:这明明是个大模型的时代,为什么工业界还在乐此不疲地用YOLO?

ChatGPT Image 2026年1月22日 16_45_52.png

甚至不只是YOLO——大量工业里的判别式任务,似乎都默契地走着“小模型”路线。

直到我自己算了一笔账,才忽然明白:沉默,但合理。

工业界的账本,比我们想象中更现实

其实道理并不复杂。工业界不是不知道大模型厉害,而是算盘打得太清楚——在很多判别式任务里,大模型的性价比,往往低得让人摇头。

单次API成本就需要1美分,那么一天8小时工作时间,价值就超过千元每天,关键还是美元哦!

screenshot_2026-01-22_16-00-39.png

YOLO们之所以还能被大规模使用,背后无非是一句朴实的话:工业要的是确定性、可控性和可规模化落地,而不是“看起来聪明”。这次YOLO26的进化更是让部署推理成本降低到一个新维度。

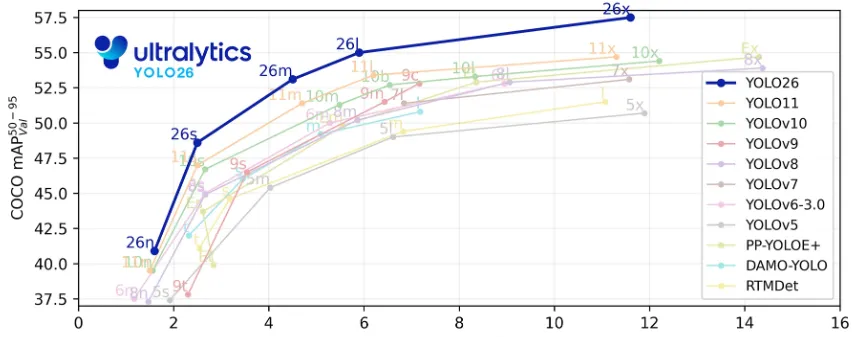

YOLO26进化了什么?

screenshot_2026-01-22_16-22-36.png

YOLO26没去追“多模态”或“语言理解”的时髦,反倒继续在三件“旧事”上打磨:

- 速度——更激进的算子融合、对TensorRT/ONNX更友好的部署,哪怕在边缘设备上,也要跑满帧。

- 稳定——训练范式越发成熟,对小样本、带噪声的数据更加宽容。

- 可控——模型规模能裁剪、推理路径可预测,而且从不依赖额外的模态。

说起来,它的目标从来不是“变得更聪明”,而是“变得更像一个即插即用的工业零件”。

更重要的是,YOLO26这次升级并不孤立。它隐约指向了2026年整个工业视觉的发展逻辑——那是一种沉默而务实的选择。

藏在YOLO26背后的三个趋势

如果你把它放回行业背景里看,会发现它其实已经替工业界投了票。

- 趋势一:模型不再盲目求大,而是专心“变精、变轻”

2026年的工业现场,关键词早就不再是参数量。大家更关心的是:单位算力下性能能否榨到极限?能不能在边缘端稳稳跑起来?真实的吞吐率到底怎样?

screenshot_2026-01-22_16-16-43.png

YOLO26一路朝着轻量化、本地化优化,其实就是在说:工业视觉的主战场,依然在边缘,在端侧,在那些不会说话却常年轰鸣的设备里。

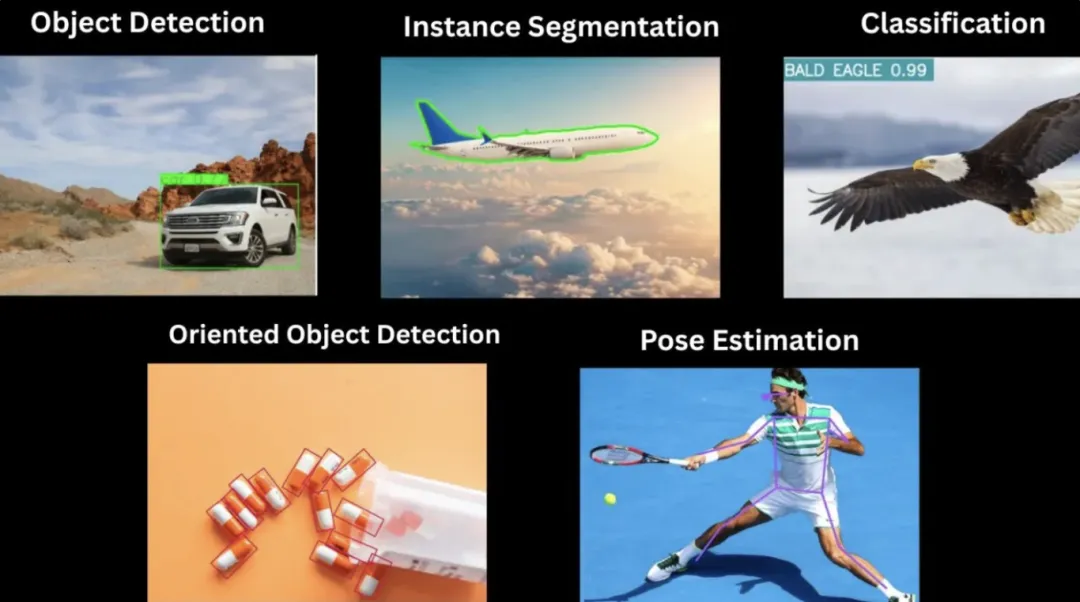

- 趋势二:判别式任务,依然是主力军

今年真正能规模化落地的,还是那些“老面孔”:检测、定位、分类、计数……

Screenshot-2025-10-20-at-10.19.05---AM.png

这些任务对“语言理解”几乎毫无需求,却对稳定性、可复现性和响应速度敏感得要命。

YOLO26继续在检测范式上打磨,仿佛在传递一个信号:工业界并不急着让机器“理解世界”,它只希望机器把眼前的问题判得清清楚楚。

- 趋势三:工程确定性,正在压倒模型想象力

比起“模型能不能做更多事”,现在的工业界更关心:行为是否可预测?升级会不会翻车?出了问题能不能快速回滚?

YOLO26的演进,本质上就是在不断强化一个不等式:

确定性 > 想象力

而这,恰好是大模型目前最难满足的工业红线。

90%的工业任务,本质都是“判断题”

必须承认,绝大多数工业视觉问题,其实是判别式问题。

有没有缺陷?位置在哪?属于哪一类?是否合格?

screenshot_2026-01-22_16-28-07.png

它们的共同点很明显:输入明确(图像/视频)、输出空间有限(框、类别、分数),根本不需要开放式语义理解。

而YOLO,生来就是为这类问题服务的。

大模型 vs YOLO:真正拉开差距的,是隐性成本

很多人只看准确率那张成绩单,却忽略了工业界心里那本厚厚的成本账。

- 推理成本:YOLO一张卡能跑数十路视频,边缘设备就能部署;大模型呢?GPU占用高,推理延迟还不稳定。工业系统可不是只跑一次,而是7×24小时连轴转。

- 稳定性与可解释性:工业现场最怕什么?今天还好好的,明天突然“抽风”。YOLO行为高度确定,输出分布稳定;大模型却容易受prompt、上下文、随机性影响,难以完全复现。在质检、安防这些场合,这种不确定性几乎是致命的。

- 数据与训练成本:YOLO几百张图就能收敛,也兼容传统数据增强;大模型微调成本高,标注、算力、时间全线翻倍——不是每家企业都烧得起这个钱。

- 部署与维护:老设备、弱算力、多型号混用……这才是很多工业现场的常态。YOLO模型小、依赖少、升级风险可控,这些优势在这样的环境里被无限放大。

很多任务,“小模型真的够了”

说句实在话,不少工业视觉问题用大模型,反而有点“技术过剩”。

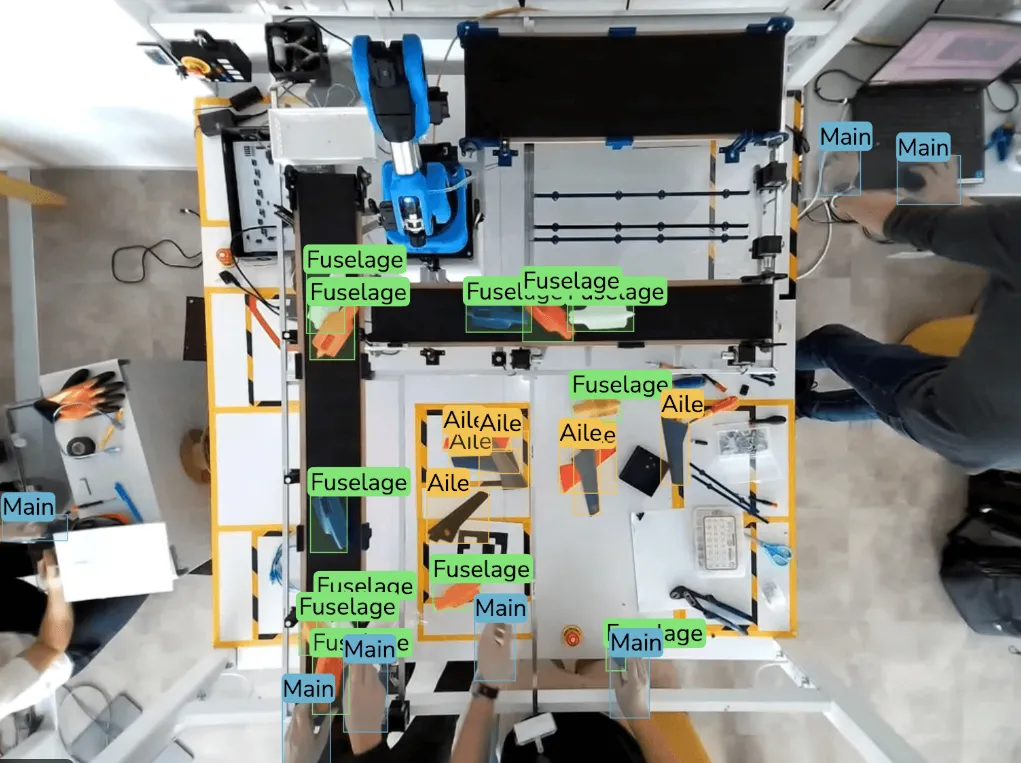

比如表面缺陷检测、零部件定位、计数测量、状态识别(开/关、有/无)……

这些任务真正的难点,往往不在模型本身,而在数据质量、标注一致性、场景变化和工程闭环。

在这些问题面前,一个调教良好的YOLO,常常比“通用大模型”更靠谱、更让人安心。

AI-in-Machine-Vision.jpg

大模型不是没用,只是别放错地方

当然,我并不是要唱衰大模型。

它在开放世界理解、复杂语义推理、跨任务泛化、少样本冷启动这些场景里,价值毋庸置疑。但它更适合扮演“上游能力提供者”,而不是“生产线上的一线工人”。

而YOLO,更像那个每天准时到岗、从不掉链子的老师傅——话不多,但活干得踏实。

总结

当我们站在PPT和论文里看世界时,大模型的确令人震撼。

可当你真正走进工厂、贴在产线边、站在机房嗡嗡作响的风扇前,才会发现,那里被反复依赖的,永远是那些算得清、跑得久、修得起的模型。

这大概就是YOLO们在大模型时代依然活得不错的原因。

不是时代没变,而是工业太现实。

如果你也在做工业视觉、目标检测或相关应用,不妨在评论区聊聊:

你现在的项目里,用的是大模型,还是YOLO?

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录