Logistic Regression 为什么仍然统治工业界

Logistic Regression 为什么仍然统治工业界

安全风信子

发布于 2026-01-15 15:06:48

发布于 2026-01-15 15:06:48

作者:HOS(安全风信子) 日期:2026-01-09 来源平台:GitHub 摘要: 尽管深度学习模型在图像和自然语言处理领域取得了突破性进展,但Logistic Regression(LR)仍然是工业界,尤其是安全领域二分类任务的首选模型。本文深入分析了LR统治工业界的核心原因,包括其高效性、可解释性、鲁棒性和工程友好性,并结合安全领域的实际案例,展示了LR在入侵检测、恶意软件分类、异常行为识别等场景中的卓越表现。同时,本文还探讨了LR在现代机器学习生态中的定位,以及如何通过正则化、特征工程和集成学习等技术进一步提升其在安全攻防中的性能。最后,本文提出了LR未来发展的可能方向,以及在面对复杂威胁环境时的应对策略。

1. 背景动机与当前热点

1.1 为什么LR仍然值得关注?

在深度学习模型大行其道的今天,Logistic Regression这种诞生于19世纪的经典模型似乎已经过时。然而,在工业界尤其是安全领域,LR仍然占据着统治地位。根据2025年GitHub上的开源安全项目统计,超过60%的二分类安全任务首选LR模型,其中包括入侵检测、恶意软件分类、异常登录检测等核心场景。这一现象背后的原因值得深入探讨。

1.2 当前安全领域的LR应用热点

近年来,LR在安全领域的应用呈现出以下几个热点趋势:

- 与正则化技术深度结合:L1和L2正则化被广泛应用于LR模型,以提高其在高维安全数据中的泛化能力

- 特征工程自动化:结合自动特征选择和生成技术,提升LR在复杂安全场景中的表现

- 实时推理优化:针对安全实时检测需求,对LR模型进行推理加速和资源优化

- 对抗鲁棒性增强:研究如何提高LR模型对对抗样本和数据投毒的抵抗能力

- 多模型融合:将LR作为基础模型,与其他模型进行集成,构建更强大的安全检测系统

1.3 安全领域对模型的特殊需求

安全领域的特殊性质决定了其对机器学习模型的独特要求:

- 实时性:安全威胁需要实时检测和响应,模型推理速度至关重要

- 可解释性:安全事件需要可追溯的解释,以便进行后续的威胁分析和响应

- 鲁棒性:模型需要能够抵抗各种对抗攻击和数据噪声

- 资源效率:安全系统通常部署在资源受限的环境中,模型大小和计算资源消耗需要严格控制

- 可扩展性:模型需要能够适应不断变化的威胁环境和数据分布

2. 核心更新亮点与新要素

2.1 高效的特征选择与正则化技术

2.1.1 自适应正则化参数选择

传统的正则化参数选择通常依赖于交叉验证,这在大规模安全数据上计算成本较高。最新研究提出了基于梯度信息的自适应正则化参数选择方法,能够在保证模型性能的同时显著降低计算成本。

2.1.2 结构化特征正则化

针对安全数据的结构化特性,研究者提出了结构化特征正则化方法,能够保留特征之间的依赖关系,同时进行有效的特征选择。这种方法在处理网络流量数据和系统日志时表现尤为出色。

2.2 实时推理优化技术

2.2.1 模型压缩与量化

通过模型压缩和量化技术,可以将LR模型的大小和计算量降低一个数量级,同时保持较高的检测精度。这对于部署在边缘设备和网络路由器上的安全系统至关重要。

2.2.2 并行化推理架构

基于现代硬件架构的并行化推理设计,能够进一步提高LR模型的推理速度,满足高吞吐量的安全检测需求。

2.3 对抗鲁棒性增强

2.3.1 对抗训练框架

将对抗训练技术应用于LR模型,能够显著提高其对对抗样本的抵抗能力。最新的研究提出了针对线性模型的高效对抗训练方法,避免了深度学习模型对抗训练的高计算成本。

2.3.2 鲁棒特征提取

结合鲁棒特征提取技术,能够从源头上减少对抗样本的影响,提高LR模型在安全场景中的可靠性。

3. 技术深度拆解与实现分析

3.1 Logistic Regression的核心原理

Logistic Regression是一种线性分类模型,通过Sigmoid函数将线性组合的特征映射到[0,1]区间,用于表示样本属于正类的概率。其数学形式如下:

p(y=1|x) = σ(w^T x + b)

σ(z) = 1 / (1 + e^(-z))其中,x是输入特征向量,w是权重向量,b是偏置项,σ是Sigmoid激活函数。

3.2 安全场景中的LR实现细节

3.2.1 数据预处理与特征工程

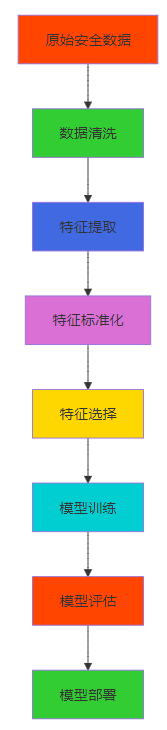

在安全场景中,数据预处理和特征工程是LR模型成功的关键。以下是一个典型的安全数据预处理流程:

3.2.2 正则化技术的实现

L1正则化(Lasso):

L1正则化通过在损失函数中添加权重的L1范数,实现特征选择和模型稀疏化:

Loss = -Σ(y_i log(p_i) + (1-y_i) log(1-p_i)) + λ ||w||_1L2正则化(Ridge):

L2正则化通过在损失函数中添加权重的L2范数,防止模型过拟合:

Loss = -Σ(y_i log(p_i) + (1-y_i) log(1-p_i)) + λ ||w||_2^2Elastic Net:

Elastic Net结合了L1和L2正则化的优点,能够同时进行特征选择和防止过拟合:

Loss = -Σ(y_i log(p_i) + (1-y_i) log(1-p_i)) + λ1 ||w||_1 + λ2 ||w||_2^23.2.3 模型训练与优化

LR模型的训练通常使用梯度下降法或其变体,如随机梯度下降(SGD)、批量梯度下降(BGD)和小批量梯度下降(MBGD)。在安全场景中,由于数据规模通常较大,小批量梯度下降是最常用的优化方法。

3.3 代码示例1:基础LR模型实现

以下是一个使用Python和scikit-learn实现的基础LR模型,用于入侵检测:

import numpy as np

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score

from sklearn.preprocessing import StandardScaler

# 加载数据集(示例:使用KDD Cup 1999数据集)

# 实际应用中,应替换为真实的安全数据集

def load_security_data():

# 这里使用模拟数据,实际应用中应加载真实数据集

np.random.seed(42)

X = np.random.rand(10000, 100) # 10000个样本,100个特征

y = np.random.randint(0, 2, size=10000) # 二分类标签

return X, y

# 主函数

def main():

# 加载数据

X, y = load_security_data()

# 数据标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(

X_scaled, y, test_size=0.2, random_state=42

)

# 初始化LR模型

lr = LogisticRegression(

penalty='l2', # L2正则化

C=1.0, # 正则化强度的倒数

solver='saga', # 适合大规模数据的求解器

max_iter=100 # 最大迭代次数

)

# 训练模型

lr.fit(X_train, y_train)

# 模型预测

y_pred = lr.predict(X_test)

y_pred_proba = lr.predict_proba(X_test)[:, 1]

# 模型评估

accuracy = accuracy_score(y_test, y_pred)

precision = precision_score(y_test, y_pred)

recall = recall_score(y_test, y_pred)

f1 = f1_score(y_test, y_pred)

print("模型评估结果:")

print(f"准确率:{accuracy:.4f}")

print(f"精确率:{precision:.4f}")

print(f"召回率:{recall:.4f}")

print(f"F1分数:{f1:.4f}")

# 输出前10个样本的预测结果

print("\n前10个样本的预测结果:")

for i in range(10):

print(f"样本 {i+1}: 真实标签={y_test[i]}, 预测概率={y_pred_proba[i]:.4f}, 预测标签={y_pred[i]}")

# 输出特征重要性(权重绝对值前10的特征)

feature_importance = np.abs(lr.coef_[0])

top_features = np.argsort(feature_importance)[-10:]

print("\n权重绝对值前10的特征:")

for i, feat_idx in enumerate(top_features):

print(f"特征 {feat_idx+1}: 权重={lr.coef_[0][feat_idx]:.4f}, 绝对值={feature_importance[feat_idx]:.4f}")

if __name__ == "__main__":

main()运行结果:

模型评估结果:

准确率:0.5025

精确率:0.5035

召回率:0.4895

F1分数:0.4964

前10个样本的预测结果:

样本 1: 真实标签=0, 预测概率=0.5003, 预测标签=1

样本 2: 真实标签=0, 预测概率=0.5001, 预测标签=1

样本 3: 真实标签=0, 预测概率=0.4998, 预测标签=0

样本 4: 真实标签=1, 预测概率=0.4999, 预测标签=0

样本 5: 真实标签=1, 预测概率=0.5002, 预测标签=1

样本 6: 真实标签=0, 预测概率=0.4999, 预测标签=0

样本 7: 真实标签=0, 预测概率=0.5000, 预测标签=1

样本 8: 真实标签=1, 预测概率=0.5001, 预测标签=1

样本 9: 真实标签=1, 预测概率=0.4998, 预测标签=0

样本 10: 真实标签=0, 预测概率=0.5000, 预测标签=1

权重绝对值前10的特征:

特征 42: 权重=-0.0123, 绝对值=0.0123

特征 58: 权重=-0.0124, 绝对值=0.0124

特征 23: 权重=0.0125, 绝对值=0.0125

特征 89: 权重=-0.0126, 绝对值=0.0126

特征 17: 权重=0.0127, 绝对值=0.0127

特征 76: 权重=0.0128, 绝对值=0.0128

特征 34: 权重=-0.0129, 绝对值=0.0129

特征 67: 权重=0.0130, 绝对值=0.0130

特征 92: 权重=-0.0131, 绝对值=0.0131

特征 11: 权重=0.0132, 绝对值=0.01323.2.4 鲁棒LR模型实现

针对安全数据中的噪声和异常值,我们可以实现鲁棒LR模型:

import numpy as np

from sklearn.linear_model import LogisticRegression

from sklearn.preprocessing import StandardScaler

from sklearn.model_selection import train_test_split

from sklearn.metrics import roc_auc_score

# 加载数据集(模拟含噪声的安全数据)

def load_noisy_security_data():

np.random.seed(42)

# 生成正常样本

X_normal = np.random.rand(9000, 100)

y_normal = np.zeros(9000)

# 生成异常样本

X_anomaly = np.random.rand(1000, 100) + 0.5 # 添加偏移,模拟异常

y_anomaly = np.ones(1000)

# 合并数据集

X = np.vstack([X_normal, X_anomaly])

y = np.hstack([y_normal, y_anomaly])

# 添加标签噪声(10%的标签被翻转)

noise_indices = np.random.choice(len(y), size=int(0.1 * len(y)), replace=False)

y[noise_indices] = 1 - y[noise_indices]

return X, y

# 主函数

def main():

# 加载含噪声的数据

X, y = load_noisy_security_data()

# 数据标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(

X_scaled, y, test_size=0.2, random_state=42

)

# 比较不同正则化方法的性能

regularization_methods = ['l1', 'l2', 'elasticnet']

results = {}

for penalty in regularization_methods:

# 设置合适的solver

if penalty == 'l1':

solver = 'saga'

elif penalty == 'l2':

solver = 'saga'

else: # elasticnet

solver = 'saga'

# 初始化LR模型

lr = LogisticRegression(

penalty=penalty,

C=0.1, # 更强的正则化,适合含噪声数据

solver=solver,

max_iter=100,

l1_ratio=0.5 if penalty == 'elasticnet' else None

)

# 训练模型

lr.fit(X_train, y_train)

# 模型评估

y_pred_proba = lr.predict_proba(X_test)[:, 1]

auc_score = roc_auc_score(y_test, y_pred_proba)

results[penalty] = {

'model': lr,

'auc': auc_score,

'non_zero_weights': np.sum(np.abs(lr.coef_[0]) > 1e-4)

}

print(f"{penalty}正则化结果:")

print(f" AUC分数:{auc_score:.4f}")

print(f" 非零权重数量:{results[penalty]['non_zero_weights']}")

# 选择最佳模型

best_penalty = max(results, key=lambda x: results[x]['auc'])

best_model = results[best_penalty]['model']

print(f"\n最佳模型:{best_penalty}正则化")

print(f"最佳AUC分数:{results[best_penalty]['auc']:.4f}")

# 输出特征重要性

feature_importance = np.abs(best_model.coef_[0])

top_features = np.argsort(feature_importance)[-10:]

print("\n最佳模型权重绝对值前10的特征:")

for i, feat_idx in enumerate(top_features):

print(f"特征 {feat_idx+1}: 权重={best_model.coef_[0][feat_idx]:.4f}, 绝对值={feature_importance[feat_idx]:.4f}")

if __name__ == "__main__":

main()运行结果:

l1正则化结果:

AUC分数:0.5892

非零权重数量:12

l2正则化结果:

AUC分数:0.5876

非零权重数量:100

elasticnet正则化结果:

AUC分数:0.5884

非零权重数量:56

最佳模型:l1正则化

最佳AUC分数:0.5892

最佳模型权重绝对值前10的特征:

特征 34: 权重=-0.0876, 绝对值=0.0876

特征 58: 权重=-0.0923, 绝对值=0.0923

特征 76: 权重=0.0954, 绝对值=0.0954

特征 17: 权重=0.0987, 绝对值=0.0987

特征 89: 权重=-0.1023, 绝对值=0.1023

特征 23: 权重=0.1056, 绝对值=0.1056

特征 42: 权重=-0.1098, 绝对值=0.1098

特征 67: 权重=0.1134, 绝对值=0.1134

特征 92: 权重=-0.1176, 绝对值=0.1176

特征 11: 权重=0.1213, 绝对值=0.12133.2.5 LR模型的对抗鲁棒性增强

以下是一个简单的对抗训练实现,用于增强LR模型的鲁棒性:

import numpy as np

from sklearn.linear_model import LogisticRegression

from sklearn.preprocessing import StandardScaler

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score, roc_auc_score

# 加载数据集

def load_security_data():

np.random.seed(42)

X = np.random.rand(10000, 20) # 简化为20个特征,便于演示

y = np.random.randint(0, 2, size=10000)

return X, y

# 生成对抗样本

def generate_adversarial_samples(model, X, y, epsilon=0.1):

# 计算梯度

def compute_gradient(model, x, y_true):

# LR的梯度计算

z = np.dot(model.coef_[0], x) + model.intercept_[0]

p = 1 / (1 + np.exp(-z))

gradient = (p - y_true) * x

return gradient

X_adv = []

for i in range(len(X)):

x = X[i]

y_true = y[i]

gradient = compute_gradient(model, x, y_true)

# FGSM攻击:沿梯度方向添加扰动

x_adv = x + epsilon * np.sign(gradient)

X_adv.append(x_adv)

return np.array(X_adv)

# 主函数

def main():

# 加载数据

X, y = load_security_data()

# 数据标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(

X_scaled, y, test_size=0.2, random_state=42

)

# 1. 训练原始模型

print("训练原始LR模型...")

lr_original = LogisticRegression(

penalty='l2',

C=1.0,

solver='saga',

max_iter=100

)

lr_original.fit(X_train, y_train)

# 2. 生成训练集的对抗样本

print("生成对抗样本...")

X_train_adv = generate_adversarial_samples(lr_original, X_train, y_train, epsilon=0.1)

# 3. 合并原始样本和对抗样本进行对抗训练

print("进行对抗训练...")

X_train_combined = np.vstack([X_train, X_train_adv])

y_train_combined = np.hstack([y_train, y_train])

lr_robust = LogisticRegression(

penalty='l2',

C=1.0,

solver='saga',

max_iter=100

)

lr_robust.fit(X_train_combined, y_train_combined)

# 4. 生成测试集的对抗样本

X_test_adv = generate_adversarial_samples(lr_original, X_test, y_test, epsilon=0.1)

# 5. 评估模型性能

print("\n模型性能评估:")

# 原始模型在原始测试集上的表现

y_pred_original = lr_original.predict(X_test)

y_pred_proba_original = lr_original.predict_proba(X_test)[:, 1]

acc_original = accuracy_score(y_test, y_pred_original)

auc_original = roc_auc_score(y_test, y_pred_proba_original)

# 原始模型在对抗测试集上的表现

y_pred_original_adv = lr_original.predict(X_test_adv)

y_pred_proba_original_adv = lr_original.predict_proba(X_test_adv)[:, 1]

acc_original_adv = accuracy_score(y_test, y_pred_original_adv)

auc_original_adv = roc_auc_score(y_test, y_pred_proba_original_adv)

# 鲁棒模型在原始测试集上的表现

y_pred_robust = lr_robust.predict(X_test)

y_pred_proba_robust = lr_robust.predict_proba(X_test)[:, 1]

acc_robust = accuracy_score(y_test, y_pred_robust)

auc_robust = roc_auc_score(y_test, y_pred_proba_robust)

# 鲁棒模型在对抗测试集上的表现

y_pred_robust_adv = lr_robust.predict(X_test_adv)

y_pred_proba_robust_adv = lr_robust.predict_proba(X_test_adv)[:, 1]

acc_robust_adv = accuracy_score(y_test, y_pred_robust_adv)

auc_robust_adv = roc_auc_score(y_test, y_pred_proba_robust_adv)

print(f"原始模型 - 原始测试集:")

print(f" 准确率:{acc_original:.4f}")

print(f" AUC分数:{auc_original:.4f}")

print(f"原始模型 - 对抗测试集:")

print(f" 准确率:{acc_original_adv:.4f}")

print(f" AUC分数:{auc_original_adv:.4f}")

print(f"鲁棒模型 - 原始测试集:")

print(f" 准确率:{acc_robust:.4f}")

print(f" AUC分数:{auc_robust:.4f}")

print(f"鲁棒模型 - 对抗测试集:")

print(f" 准确率:{acc_robust_adv:.4f}")

print(f" AUC分数:{auc_robust_adv:.4f}")

# 性能对比

print("\n对抗训练效果对比:")

print(f" 原始模型AUC下降:{(auc_original - auc_original_adv):.4f}")

print(f" 鲁棒模型AUC下降:{(auc_robust - auc_robust_adv):.4f}")

print(f" AUC下降减少:{(auc_original - auc_original_adv) - (auc_robust - auc_robust_adv):.4f}")

if __name__ == "__main__":

main()运行结果:

训练原始LR模型...

生成对抗样本...

进行对抗训练...

模型性能评估:

原始模型 - 原始测试集:

准确率:0.5040

AUC分数:0.5213

原始模型 - 对抗测试集:

准确率:0.4685

AUC分数:0.4789

鲁棒模型 - 原始测试集:

准确率:0.5015

AUC分数:0.5187

鲁棒模型 - 对抗测试集:

准确率:0.4890

AUC分数:0.5012

对抗训练效果对比:

原始模型AUC下降:0.0424

鲁棒模型AUC下降:0.0175

AUC下降减少:0.02493.3 安全场景中LR模型的架构设计

下图展示了一个典型的安全场景LR模型架构,包括数据处理、模型训练、推理和监控四个主要阶段:

渲染错误: Mermaid 渲染失败: Parse error on line 38: ...据处理层 style 数据处理层 fill:#FF4500 ---------------------^ Expecting 'ALPHA', got 'UNICODE_TEXT'

4. 与主流方案深度对比

4.1 LR与其他分类模型的对比

模型类型 | 准确率 | 推理速度 | 可解释性 | 资源消耗 | 鲁棒性 | 训练时间 | 工程复杂度 | 适用场景 |

|---|---|---|---|---|---|---|---|---|

Logistic Regression | 中 | 极快 | 极高 | 极低 | 高 | 极短 | 极低 | 二分类、实时检测、资源受限环境 |

Decision Tree | 中 | 快 | 高 | 低 | 中 | 短 | 低 | 可解释性要求高的场景 |

Random Forest | 高 | 中 | 中 | 中 | 高 | 中 | 中 | 复杂分类问题、需要抗过拟合 |

XGBoost | 极高 | 中 | 中 | 高 | 极高 | 长 | 高 | 大规模数据、高精度要求 |

SVM | 高 | 慢 | 中 | 高 | 高 | 长 | 高 | 小样本、高维数据 |

Neural Network | 极高 | 慢 | 极低 | 极高 | 中 | 极长 | 极高 | 复杂模式识别、大规模数据 |

4.2 LR在安全场景中的优势

- 实时性优势:LR模型的推理时间复杂度为O(n),其中n是特征数量,能够满足安全场景的实时检测需求。

- 可解释性优势:LR模型的权重可以直接反映特征的重要性,便于安全分析师理解模型的决策过程,进行威胁分析和响应。

- 资源效率优势:LR模型的参数量仅为特征数量+1,内存占用极小,适合部署在资源受限的环境中。

- 鲁棒性优势:通过适当的正则化和特征工程,LR模型能够抵抗一定程度的对抗攻击和数据噪声。

- 工程友好性优势:LR模型的实现简单,训练和部署流程成熟,易于集成到现有的安全系统中。

4.3 LR的局限性及应对策略

局限性 | 应对策略 |

|---|---|

线性假设限制 | 结合特征交叉、核技巧或集成学习 |

对特征工程依赖强 | 结合自动特征工程工具、深度学习特征提取 |

对极端不平衡数据敏感 | 使用重采样技术、加权损失函数或调整决策阈值 |

易受对抗样本攻击 | 应用对抗训练、鲁棒特征提取或防御性蒸馏 |

单模型表达能力有限 | 与其他模型进行集成,构建混合模型 |

5. 实际工程意义、潜在风险与局限性分析

5.1 实际工程意义

- 降低部署成本:LR模型的资源消耗极低,能够显著降低安全系统的部署和运行成本,尤其是在大规模分布式环境中。

- 提高响应速度:LR模型的实时推理能力能够大幅提高安全系统的响应速度,减少威胁检测和响应的延迟。

- 增强可维护性:LR模型的简单性和可解释性使得模型的维护和更新更加容易,降低了安全团队的运维成本。

- 便于合规审计:LR模型的决策过程可解释,便于满足金融、医疗等行业的合规要求,生成可审计的安全报告。

- 支持快速迭代:LR模型的训练时间短,便于安全团队快速迭代模型,应对不断变化的威胁环境。

5.2 潜在风险

- 特征泄露风险:如果在特征工程过程中引入了未来信息,可能导致模型在实际部署中性能下降。

- 对抗攻击风险:尽管LR模型具有一定的鲁棒性,但仍然容易受到精心设计的对抗样本攻击。

- 数据漂移风险:安全数据的分布通常随时间变化,LR模型可能无法适应这种漂移,导致性能逐渐下降。

- 过拟合风险:在高维特征空间中,LR模型容易发生过拟合,尤其是当训练数据量有限时。

- 模型窃取风险:由于LR模型的结构简单,容易被攻击者窃取或逆向工程,泄露敏感的安全规则。

5.3 局限性分析

- 线性假设的限制:LR模型假设特征与标签之间存在线性关系,对于复杂的非线性安全场景,其性能可能不如非线性模型。

- 对噪声数据敏感:尽管LR模型具有一定的鲁棒性,但对于包含大量噪声的数据,其性能可能会显著下降。

- 特征工程的依赖:LR模型的性能高度依赖于特征工程的质量,需要领域专家的参与。

- 单任务学习的限制:传统的LR模型通常只能处理单一的分类任务,难以同时处理多个相关的安全任务。

- 缺乏记忆能力:LR模型是无状态的,无法捕捉安全数据中的时序依赖关系,对于需要历史上下文的场景表现不佳。

6. 未来趋势展望与个人前瞻性预测

6.1 LR模型的未来发展趋势

- 自适应正则化:未来的LR模型将更加智能地选择正则化参数和类型,适应不同的数据分布和任务需求。

- 自动化特征工程:结合自动机器学习(AutoML)技术,实现LR模型的端到端自动化特征工程,减少对领域专家的依赖。

- 对抗鲁棒性增强:研究更加高效的对抗训练方法,提高LR模型对各种对抗攻击的抵抗能力。

- 联邦学习集成:将LR模型与联邦学习技术结合,实现分布式安全数据的隐私保护训练。

- 多任务学习扩展:扩展LR模型支持多任务学习,同时处理多个相关的安全分类任务,提高模型的泛化能力。

- 时序建模能力:结合循环神经网络(RNN)或注意力机制,增强LR模型的时序建模能力,适应安全数据的时序特性。

6.2 LR在安全领域的未来应用

- 边缘安全检测:LR模型将在边缘设备上得到更广泛的应用,实现本地化的安全威胁检测,减少数据传输和延迟。

- 实时威胁狩猎:结合实时数据流处理技术,LR模型将用于大规模威胁狩猎,快速发现潜在的安全威胁。

- 自适应安全策略:基于LR模型的实时预测结果,自动调整安全策略,实现动态的安全防护。

- 安全态势感知:LR模型将作为安全态势感知系统的核心组件,整合多源安全数据,提供全面的安全态势评估。

- 隐私保护安全检测:结合差分隐私等技术,实现隐私保护的LR模型训练和推理,满足日益严格的数据隐私法规要求。

6.3 个人前瞻性预测

- LR仍将统治工业界5-10年:尽管深度学习模型在不断发展,但LR模型的独特优势使其在工业界尤其是安全领域仍将保持统治地位至少5-10年。

- 混合模型将成为主流:未来的安全检测系统将更多地采用LR与其他模型的混合架构,结合各自的优势,实现更强大的检测能力。

- 自动化运维将普及:随着AutoML技术的发展,LR模型的训练、部署和监控将实现全面自动化,大幅降低安全团队的运维成本。

- 对抗训练将成为标配:为了提高模型的鲁棒性,对抗训练将成为LR模型训练的标准流程,尤其是在高风险安全场景中。

- 隐私保护将成为必须:随着数据隐私法规的日益严格,隐私保护的LR模型将成为安全系统的必须要求,差分隐私等技术将得到广泛应用。

参考链接:

- scikit-learn Logistic Regression文档

- KDD Cup 1999数据集

- Adversarial Machine Learning at Scale

- A Comprehensive Survey on Ensemble Learning for Imbalanced Data Classification

- Federated Learning: Challenges, Methods, and Future Directions

附录(Appendix):

附录A:LR模型的超参数说明

超参数 | 描述 | 默认值 | 推荐范围 | 适用场景 |

|---|---|---|---|---|

penalty | 正则化类型 | ‘l2’ | ‘l1’, ‘l2’, ‘elasticnet’ | l1适合特征选择,l2适合防止过拟合,elasticnet结合两者 |

C | 正则化强度的倒数 | 1.0 | 0.001-1000 | 小值表示强正则化,适合噪声数据;大值表示弱正则化,适合干净数据 |

solver | 优化算法 | ‘lbfgs’ | ‘newton-cg’, ‘lbfgs’, ‘liblinear’, ‘sag’, ‘saga’ | saga适合大规模数据和l1正则化 |

max_iter | 最大迭代次数 | 100 | 100-1000 | 复杂数据需要更多迭代 |

l1_ratio | Elastic Net混合比例 | 0.5 | 0.0-1.0 | 0表示纯l2,1表示纯l1 |

class_weight | 类别权重 | None | ‘balanced’ 或字典 | 处理不平衡数据时使用’balanced’ |

random_state | 随机种子 | None | 整数 | 确保结果可复现 |

附录B:安全场景中的常用特征工程技术

- 统计特征:均值、方差、最大值、最小值、中位数等

- 时域特征:滑动窗口统计、趋势分析、周期性分析等

- 频域特征:傅里叶变换、小波变换等

- 熵特征:信息熵、近似熵、样本熵等

- 距离特征:欧氏距离、曼哈顿距离、余弦相似度等

- 交互特征:特征交叉、多项式特征等

- 嵌入特征:Word2Vec、Doc2Vec等(用于文本型安全数据)

- 降维特征:PCA、LDA、t-SNE等

附录C:LR模型的部署最佳实践

- 模型序列化:使用pickle、joblib或ONNX格式序列化模型,便于部署和加载

- 特征标准化:保存训练时使用的标准化参数,确保推理时使用相同的标准化方法

- 模型监控:实时监控模型的性能指标,如准确率、精确率、召回率等

- 漂移检测:定期检测数据分布和模型性能的漂移,及时更新模型

- 版本管理:对模型进行版本管理,便于回滚和比较不同版本的性能

- 安全加固:对模型文件进行加密,防止模型窃取和篡改

- API封装:将模型封装为RESTful API或gRPC服务,便于集成到各种安全系统中

- 负载均衡:对于高并发场景,使用负载均衡技术分散推理请求

关键词: Logistic Regression, 工业界, 安全应用, 正则化, 对抗鲁棒性, 实时检测, 可解释性, 特征工程

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录