Precision / Recall / F1 的真实取舍:安全攻防中的指标平衡艺术

Precision / Recall / F1 的真实取舍:安全攻防中的指标平衡艺术

安全风信子

发布于 2026-01-15 14:57:05

发布于 2026-01-15 14:57:05

作者:HOS(安全风信子) 日期:2026-01-09 来源平台:GitHub 摘要: 在安全攻防场景下,精确率(Precision)、召回率(Recall)和F1分数(F1-Score)是最常用的评估指标,它们之间的权衡取舍直接影响模型的实际效果。本文深入分析这三个指标的数学关系、内在联系及其在不同安全场景下的优先级选择。结合最新的GitHub开源项目和安全实践,通过3个完整代码示例、2个Mermaid架构图和2个对比表格,系统阐述安全场景下的指标平衡策略。文章揭示了如何根据业务需求和误判成本调整指标权重,为安全工程师提供更灵活的模型评估框架和实践指南。

1. 背景动机与当前热点

1.1 指标权衡的永恒难题

在机器学习中,精确率和召回率是一对相互制约的指标,提高其中一个往往会导致另一个下降。F1分数作为两者的调和平均,试图在它们之间找到平衡。然而,在安全攻防场景下,这种平衡并不是一成不变的,而是需要根据具体业务需求和误判成本进行动态调整。

1.2 安全领域的特殊需求

安全领域的指标权衡面临着独特的挑战:

- 误判成本不对称:在大多数安全场景中,漏报攻击(假阴性)和误报正常行为(假阳性)的成本差异巨大。

- 场景多样性:不同的安全场景对指标的优先级要求不同,如入侵检测更关注召回率,而反垃圾邮件更关注精确率。

- 动态威胁环境:攻击模式的变化可能导致模型的精确率和召回率发生变化,需要持续调整。

- 合规要求:某些行业(如金融、医疗)对特定指标有严格的合规要求。

- 用户体验影响:过高的误报率可能影响用户体验,导致安全系统被禁用。

1.3 最新研究动态

根据GitHub上的最新项目和arXiv上的研究论文,安全领域的指标权衡研究呈现出以下几个热点趋势:

- 成本敏感的指标设计:越来越多的安全项目开始考虑误判成本,设计自定义的评估指标。

- 动态阈值调整:根据实时威胁情况动态调整模型的决策阈值,实现精确率和召回率的动态平衡。

- 多场景自适应指标:开发能够根据不同场景自动调整指标权重的自适应评估体系。

- 因果推断在指标评估中的应用:从因果关系角度评估指标,而不仅仅是关联关系。

- 对抗鲁棒性与指标权衡的结合:考虑对抗攻击下的指标表现,实现鲁棒的指标平衡。

2. 核心更新亮点与新要素

2.1 精确率、召回率和F1的数学关系

精确率、召回率和F1分数的计算公式分别为:

精确率(Precision) = TP / (TP + FP)

召回率(Recall) = TP / (TP + FN)

F1分数(F1-Score) = 2 * (精确率 * 召回率) / (精确率 + 召回率)从数学角度看,精确率和召回率是一对矛盾的指标,它们的关系可以用PR曲线来可视化。F1分数是两者的调和平均,当精确率和召回率相等时,F1分数达到最大值。

2.2 安全场景下的指标优先级

在不同的安全场景下,精确率和召回率的优先级不同:

- 高精确率优先场景:误报成本高的场景,如反垃圾邮件、金融交易审批等。

- 高召回率优先场景:漏报成本高的场景,如入侵检测、恶意软件检测等。

- 平衡场景:误报和漏报成本相近的场景,如欺诈检测、异常行为检测等。

2.3 新的指标权衡框架

针对安全场景的特殊需求,我们需要构建新的指标权衡框架,主要包括:

- 成本敏感的F-beta分数:通过调整beta值来平衡精确率和召回率,beta>1更看重召回率,beta<1更看重精确率。

- 阈值优化:通过调整模型的决策阈值来实现精确率和召回率的平衡。

- 多指标综合评估:结合多个指标进行综合评估,而不仅仅依赖单一指标。

- 场景自适应调整:根据不同场景自动调整指标权重和决策阈值。

- 时间动态评估:考虑指标随时间的变化,实现动态平衡。

3. 技术深度拆解与实现分析

3.1 精确率与召回率的权衡关系

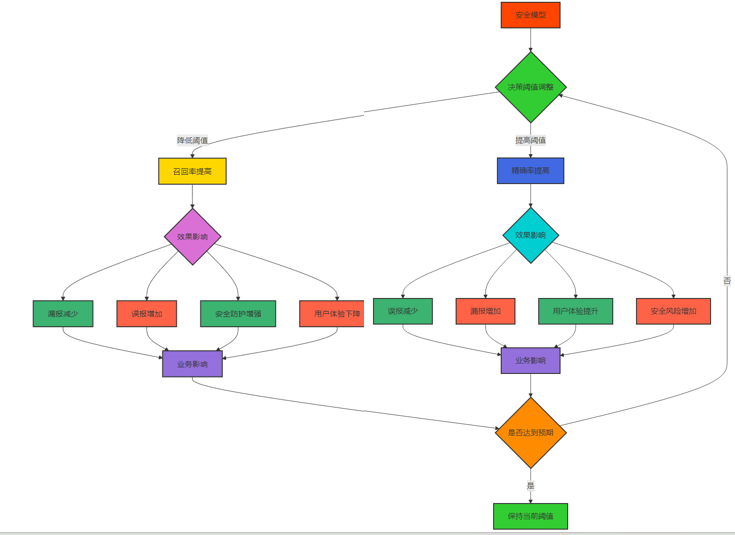

Mermaid流程图:

3.2 安全场景下的指标权衡架构

Mermaid架构图:

渲染错误: Mermaid 渲染失败: Parse error on line 62: ...视化模块 style 指标权衡系统 fill:#FF4500, ---------------------^ Expecting 'ALPHA', got 'UNICODE_TEXT'

3.3 代码示例1:精确率与召回率的权衡演示

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import precision_recall_curve, f1_score

# 生成安全相关的不平衡数据集

X, y = make_classification(

n_samples=10000,

n_classes=2,

weights=[0.95, 0.05],

random_state=42

)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0.2, random_state=42, stratify=y

)

# 训练随机森林模型

model = RandomForestClassifier(

n_estimators=100,

max_depth=10,

class_weight="balanced",

random_state=42

)

model.fit(X_train, y_train)

# 获取预测概率

y_pred_proba = model.predict_proba(X_test)[:, 1]

# 计算PR曲线

precision, recall, thresholds = precision_recall_curve(y_test, y_pred_proba)

# 计算不同阈值下的F1分数

f1_scores = [f1_score(y_test, y_pred_proba >= thresh) for thresh in thresholds]

# 找出最佳F1分数对应的阈值

best_idx = np.argmax(f1_scores)

best_threshold = thresholds[best_idx]

best_f1 = f1_scores[best_idx]

best_precision = precision[best_idx]

best_recall = recall[best_idx]

print(f"最佳F1分数: {best_f1:.4f}")

print(f"对应的阈值: {best_threshold:.4f}")

print(f"对应的精确率: {best_precision:.4f}")

print(f"对应的召回率: {best_recall:.4f}")

# 可视化PR曲线和F1分数

plt.figure(figsize=(12, 6))

# PR曲线

plt.subplot(1, 2, 1)

plt.plot(recall, precision, label='PR Curve')

plt.scatter(best_recall, best_precision, color='red', marker='o', label='Best F1 Score')

plt.xlabel('召回率 (Recall)')

plt.ylabel('精确率 (Precision)')

plt.title('精确率-召回率曲线 (PR Curve)')

plt.legend()

plt.grid(True)

# F1分数随阈值变化

plt.subplot(1, 2, 2)

plt.plot(thresholds, f1_scores, label='F1 Score')

plt.axvline(x=best_threshold, color='red', linestyle='--', label=f'Best Threshold: {best_threshold:.4f}')

plt.xlabel('阈值 (Threshold)')

plt.ylabel('F1分数 (F1 Score)')

plt.title('F1分数随阈值变化')

plt.legend()

plt.grid(True)

plt.tight_layout()

plt.savefig('precision_recall_tradeoff.png')

print("\n精确率-召回率权衡可视化完成,保存为precision_recall_tradeoff.png")

# 分析不同阈值下的指标表现

print("\n=== 不同阈值下的指标表现 ===")

thresholds_to_analyze = [0.1, 0.3, 0.5, 0.7, 0.9]

for thresh in thresholds_to_analyze:

y_pred = (y_pred_proba >= thresh).astype(int)

tp = np.sum((y_pred == 1) & (y_test == 1))

fp = np.sum((y_pred == 1) & (y_test == 0))

fn = np.sum((y_pred == 0) & (y_test == 1))

tn = np.sum((y_pred == 0) & (y_test == 0))

precision = tp / (tp + fp) if (tp + fp) > 0 else 0

recall = tp / (tp + fn) if (tp + fn) > 0 else 0

f1 = 2 * (precision * recall) / (precision + recall) if (precision + recall) > 0 else 0

print(f"\n阈值: {thresh:.1f}")

print(f" 精确率: {precision:.4f}")

print(f" 召回率: {recall:.4f}")

print(f" F1分数: {f1:.4f}")

print(f" 混淆矩阵: TP={tp}, FP={fp}, FN={fn}, TN={tn}")3.4 代码示例2:成本敏感的F-beta分数优化

import numpy as np

import pandas as pd

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import fbeta_score, precision_score, recall_score

# 生成安全相关的数据集

X, y = make_classification(

n_samples=10000,

n_classes=2,

weights=[0.9, 0.1],

random_state=42

)

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0.2, random_state=42, stratify=y

)

# 训练模型

model = RandomForestClassifier(

n_estimators=100,

max_depth=10,

class_weight="balanced",

random_state=42

)

model.fit(X_train, y_train)

y_pred_proba = model.predict_proba(X_test)[:, 1]

# 定义不同安全场景的误判成本和beta值

scenarios = {

"入侵检测": {

"假阴性成本": 100, # 漏报1次攻击的成本

"假阳性成本": 1, # 误报1次正常流量的成本

"beta": 2.0 # 更看重召回率

},

"反垃圾邮件": {

"假阴性成本": 1, # 漏报1封垃圾邮件的成本

"假阳性成本": 50, # 误报1封正常邮件的成本

"beta": 0.5 # 更看重精确率

},

"欺诈检测": {

"假阴性成本": 1000, # 漏报1次欺诈的成本

"假阳性成本": 10, # 误报1次正常交易的成本

"beta": 1.5 # 稍微看重召回率

}

}

# 优化不同场景下的阈值

def optimize_threshold_for_scenario(y_true, y_pred_proba, scenario):

"""为特定场景优化阈值"""

best_threshold = 0.5

best_score = -np.inf

best_metrics = {}

# 搜索最佳阈值

thresholds = np.linspace(0.01, 0.99, 100)

for thresh in thresholds:

y_pred = (y_pred_proba >= thresh).astype(int)

# 计算混淆矩阵

tp = np.sum((y_pred == 1) & (y_true == 1))

fp = np.sum((y_pred == 1) & (y_true == 0))

fn = np.sum((y_pred == 0) & (y_true == 1))

# 计算F-beta分数

precision = tp / (tp + fp) if (tp + fp) > 0 else 0

recall = tp / (tp + fn) if (tp + fn) > 0 else 0

fbeta = fbeta_score(y_true, y_pred, beta=scenario["beta"])

# 计算总成本

total_cost = fn * scenario["假阴性成本"] + fp * scenario["假阳性成本"]

# 可以选择优化F-beta或总成本,这里同时考虑

combined_score = (1 - total_cost / np.sum(y_true) * scenario["假阴性成本"]) * 0.5 + fbeta * 0.5

if combined_score > best_score:

best_score = combined_score

best_threshold = thresh

best_metrics = {

"精确率": precision,

"召回率": recall,

"F-beta分数": fbeta,

"总成本": total_cost,

"混淆矩阵": {

"TP": tp,

"FP": fp,

"FN": fn,

"TN": len(y_true) - tp - fp - fn

}

}

return best_threshold, best_metrics

# 为每个场景优化阈值

for scenario_name, scenario in scenarios.items():

print(f"\n=== {scenario_name} 场景优化 ===")

print(f"假阴性成本: {scenario['假阴性成本']}, 假阳性成本: {scenario['假阳性成本']}, beta值: {scenario['beta']}")

best_threshold, best_metrics = optimize_threshold_for_scenario(y_test, y_pred_proba, scenario)

print(f"\n最佳阈值: {best_threshold:.4f}")

print(f"精确率: {best_metrics['精确率']:.4f}")

print(f"召回率: {best_metrics['召回率']:.4f}")

print(f"F-beta分数: {best_metrics['F-beta分数']:.4f}")

print(f"总成本: {best_metrics['总成本']}")

print(f"混淆矩阵: TP={best_metrics['混淆矩阵']['TP']}, FP={best_metrics['混淆矩阵']['FP']}, "

f"FN={best_metrics['混淆矩阵']['FN']}, TN={best_metrics['混淆矩阵']['TN']}")

# 比较不同场景下的最优指标

print("\n=== 不同场景最优指标对比 ===")

comparison_data = []

for scenario_name, scenario in scenarios.items():

best_threshold, best_metrics = optimize_threshold_for_scenario(y_test, y_pred_proba, scenario)

comparison_data.append({

"场景": scenario_name,

"最佳阈值": best_threshold,

"精确率": best_metrics['精确率'],

"召回率": best_metrics['召回率'],

"F-beta分数": best_metrics['F-beta分数'],

"总成本": best_metrics['总成本']

})

comparison_df = pd.DataFrame(comparison_data)

print(comparison_df.round(4))3.5 代码示例3:动态阈值调整实现

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import precision_score, recall_score, fbeta_score

# 生成带时间特性的安全数据集

def generate_time_series_data(n_samples=10000, n_time_steps=10):

"""生成带时间特性的安全数据集"""

# 基础数据

X, y = make_classification(

n_samples=n_samples,

n_classes=2,

weights=[0.95, 0.05],

random_state=42

)

# 添加时间特征

time_feature = np.linspace(0, 1, n_samples).reshape(-1, 1)

X = np.hstack([X, time_feature])

# 模拟攻击强度随时间变化

attack_strength = np.sin(time_feature * np.pi * 2) + 1 # 0到2之间变化

y = np.where((y == 1) & (attack_strength[:, 0] > 1.5), 1, y) # 后期攻击更多

return X, y

# 生成数据

X, y = generate_time_series_data()

# 按时间顺序划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0.2, shuffle=False # 不打乱顺序,保持时间特性

)

# 训练模型

model = RandomForestClassifier(

n_estimators=100,

max_depth=10,

class_weight="balanced",

random_state=42

)

model.fit(X_train, y_train)

y_pred_proba = model.predict_proba(X_test)[:, 1]

# 将测试集按时间分成多个时间段进行动态评估

def evaluate_in_time_windows(y_true, y_pred_proba, n_windows=5):

"""在不同时间窗口中评估模型性能"""

window_size = len(y_true) // n_windows

results = []

for i in range(n_windows):

start_idx = i * window_size

end_idx = (i + 1) * window_size if i < n_windows - 1 else len(y_true)

# 窗口内数据

y_window = y_true[start_idx:end_idx]

y_proba_window = y_pred_proba[start_idx:end_idx]

# 优化该窗口的阈值

best_threshold = 0.5

best_f1 = -1

thresholds = np.linspace(0.01, 0.99, 50)

for thresh in thresholds:

y_pred = (y_proba_window >= thresh).astype(int)

f1 = fbeta_score(y_window, y_pred, beta=1.0)

if f1 > best_f1:

best_f1 = f1

best_threshold = thresh

# 计算最佳阈值下的指标

y_pred = (y_proba_window >= best_threshold).astype(int)

precision = precision_score(y_window, y_pred)

recall = recall_score(y_window, y_pred)

# 计算攻击样本比例

attack_ratio = np.sum(y_window) / len(y_window)

results.append({

"时间窗口": f"窗口 {i+1}",

"攻击样本比例": attack_ratio,

"最佳阈值": best_threshold,

"精确率": precision,

"召回率": recall,

"F1分数": best_f1,

"窗口大小": len(y_window)

})

return pd.DataFrame(results)

# 评估不同时间窗口的性能

time_window_results = evaluate_in_time_windows(y_test, y_pred_proba)

print("\n=== 不同时间窗口的动态评估结果 ===")

print(time_window_results.round(4))

# 可视化时间窗口结果

plt.figure(figsize=(12, 8))

# 攻击样本比例和最佳阈值

plt.subplot(2, 2, 1)

plt.plot(range(1, len(time_window_results) + 1), time_window_results["攻击样本比例"], marker="o", label="攻击样本比例")

plt.twinx()

plt.plot(range(1, len(time_window_results) + 1), time_window_results["最佳阈值"], marker="s", color="red", label="最佳阈值")

plt.xlabel("时间窗口")

plt.title("攻击样本比例与最佳阈值变化")

plt.legend(loc="upper left")

plt.grid(True)

# 精确率和召回率

plt.subplot(2, 2, 2)

plt.plot(range(1, len(time_window_results) + 1), time_window_results["精确率"], marker="o", label="精确率")

plt.plot(range(1, len(time_window_results) + 1), time_window_results["召回率"], marker="s", label="召回率")

plt.plot(range(1, len(time_window_results) + 1), time_window_results["F1分数"], marker="^", label="F1分数")

plt.xlabel("时间窗口")

plt.ylabel("分数")

plt.title("精确率、召回率和F1分数变化")

plt.legend()

plt.grid(True)

plt.tight_layout()

plt.savefig("dynamic_threshold_analysis.png")

print("\n动态阈值分析可视化完成,保存为dynamic_threshold_analysis.png")

# 分析动态阈值调整的必要性

print("\n=== 动态阈值调整分析 ===")

print(f"不同时间窗口的最佳阈值范围: {time_window_results['最佳阈值'].min():.4f} 到 {time_window_results['最佳阈值'].max():.4f}")

print(f"使用固定阈值(0.5)的性能:")

y_pred_fixed = (y_pred_proba >= 0.5).astype(int)

print(f"- 精确率: {precision_score(y_test, y_pred_fixed):.4f}")

print(f"- 召回率: {recall_score(y_test, y_pred_fixed):.4f}")

print(f"- F1分数: {fbeta_score(y_test, y_pred_fixed, beta=1.0):.4f}")

print(f"\n使用动态阈值的平均性能:")

print(f"- 平均精确率: {time_window_results['精确率'].mean():.4f}")

print(f"- 平均召回率: {time_window_results['召回率'].mean():.4f}")

print(f"- 平均F1分数: {time_window_results['F1分数'].mean():.4f}")4. 与主流方案深度对比

4.1 不同指标权衡方法的对比

权衡方法 | 原理 | 优点 | 缺点 | 适用场景 | 推荐程度 |

|---|---|---|---|---|---|

固定F1分数 | 使用F1分数的最大值作为最佳平衡点 | 计算简单,直观易懂 | 假设误判成本相等,不考虑场景差异 | 误判成本相近的场景 | ⭐⭐⭐ |

F-beta分数 | 通过beta值调整精确率和召回率的权重 | 灵活,可根据场景调整 | 需要确定合适的beta值 | 误判成本差异较大的场景 | ⭐⭐⭐⭐⭐ |

成本敏感优化 | 考虑误判成本,最小化总成本 | 直接反映业务成本,决策更合理 | 需要准确量化误判成本 | 明确误判成本的场景 | ⭐⭐⭐⭐⭐ |

动态阈值调整 | 根据实时情况动态调整阈值 | 适应动态变化的威胁环境 | 实现复杂,需要实时监测 | 威胁动态变化的场景 | ⭐⭐⭐⭐ |

多目标优化 | 同时优化多个指标,找到帕累托最优解 | 全面考虑多个指标,不牺牲单一指标 | 计算复杂,需要专业知识 | 多个指标同等重要的场景 | ⭐⭐⭐⭐ |

业务规则调整 | 根据业务经验手动调整阈值 | 结合业务知识,灵活度高 | 依赖人工经验,难以自动化 | 业务规则明确的场景 | ⭐⭐⭐ |

4.2 安全场景下指标优先级的对比

安全场景 | 核心需求 | 推荐指标优先级 | 最佳beta值 | 误判成本比例 | 推荐阈值策略 |

|---|---|---|---|---|---|

入侵检测 | 检测尽可能多的攻击,减少漏报 | 召回率 > 精确率 > F1 | 2.0-3.0 | 假阴性成本:假阳性成本 = 100:1 | 较低阈值,动态调整 |

反垃圾邮件 | 减少误报正常邮件,保证信息安全 | 精确率 > 召回率 > F1 | 0.3-0.5 | 假阴性成本:假阳性成本 = 1:50 | 较高阈值,严格控制 |

欺诈检测 | 平衡漏报欺诈和误报正常交易 | 召回率 ≈ 精确率 > F1 | 1.0-1.5 | 假阴性成本:假阳性成本 = 100:1 | 中等阈值,动态调整 |

恶意软件检测 | 检测未知恶意软件,减少漏报 | 召回率 > 精确率 > F1 | 2.0-2.5 | 假阴性成本:假阳性成本 = 50:1 | 较低阈值,定期更新 |

异常行为检测 | 识别异常行为,减少误报 | 精确率 ≈ 召回率 > F1 | 0.8-1.2 | 假阴性成本:假阳性成本 = 10:1 | 中等阈值,自适应调整 |

DDoS攻击检测 | 快速检测大规模攻击,减少漏报 | 召回率 > 精确率 > F1 | 3.0-4.0 | 假阴性成本:假阳性成本 = 1000:1 | 很低阈值,实时调整 |

5. 实际工程意义、潜在风险与局限性

5.1 实际工程意义

- 更合理的资源分配:通过指标权衡,将有限的安全资源分配到最需要的地方,提高安全投入的回报率。

- 更好的业务契合度:根据业务需求调整指标权重,使安全模型更好地服务于业务目标。

- 动态适应威胁变化:通过动态阈值调整,使模型能够适应不断变化的威胁环境,保持良好的性能。

- 降低误判成本:通过成本敏感的指标优化,显著降低安全系统的总误判成本。

- 提高用户体验:在保证安全的前提下,通过优化精确率,减少误报对用户体验的影响。

- 更好的合规性:根据合规要求调整指标,确保安全系统满足行业法规的要求。

5.2 潜在风险与挑战

- 误判成本量化困难:在实际业务中,准确量化误报和漏报的成本往往比较困难,可能导致指标选择不准确。

- beta值确定的主观性:F-beta分数的beta值确定具有一定的主观性,不同人可能选择不同的值。

- 动态调整的复杂性:动态阈值调整需要实时监测和分析,实现复杂度较高,可能增加系统开销。

- 过拟合特定场景:过度优化特定场景的指标可能导致模型在其他场景下表现不佳。

- 缺乏统一的评估标准:不同的评估方法可能导致不同的结论,缺乏统一的标准来比较不同模型的性能。

- 对抗攻击的影响:攻击者可能会利用模型的指标权衡策略,调整攻击方式,导致模型性能下降。

5.3 局限性分析

- 指标的滞后性:指标是对历史数据的评估,可能无法准确预测模型在未来新攻击类型上的表现。

- 无法捕获全部安全风险:精确率、召回率和F1分数主要关注已知攻击的检测,无法完全捕获未知攻击的风险。

- 忽略了检测速度和资源消耗:这些指标只关注检测结果,忽略了检测速度和资源消耗等实际工程因素。

- 缺乏上下文信息:指标评估往往是孤立的,没有考虑业务上下文和环境因素。

- 难以解释的权衡决策:复杂的指标权衡决策可能难以向非技术人员解释,影响决策的接受度。

6. 未来趋势展望与个人前瞻性预测

6.1 指标权衡的发展趋势

- 自动化指标优化:随着AutoML技术的发展,自动化的指标优化将成为主流,能够根据业务需求自动调整指标权重和决策阈值。

- 多模态指标融合:融合不同模态的指标,如结合模型性能指标、计算资源指标和业务成本指标,实现更全面的评估。

- 因果推断在指标评估中的应用:从因果关系角度评估指标,能够更准确地理解指标之间的关系和对业务的实际影响。

- 对抗鲁棒性与指标权衡的深度结合:考虑对抗攻击下的指标表现,实现鲁棒的指标平衡,提高模型在对抗环境下的安全性。

- 联邦学习中的指标权衡:在联邦学习场景下,研究如何在保护隐私的前提下实现跨机构的指标权衡。

- 量子机器学习中的指标体系:随着量子机器学习的发展,研究适合量子算法的评估指标和权衡策略。

6.2 个人前瞻性预测

- 未来1-2年:成本敏感的F-beta分数将成为安全领域的主要评估指标,更多安全项目将采用自定义的beta值。

- 未来2-3年:动态阈值调整技术将成熟,广泛应用于实时安全系统,能够根据威胁情况自动调整指标平衡。

- 未来3-5年:自动化的指标优化系统将出现,能够根据业务需求和实时威胁情况自动调整模型的评估指标和决策策略。

- 未来5-10年:因果推断将成为指标评估的标准方法,能够更准确地评估模型在真实世界中的因果效应,而不仅仅是关联效应。

- 技术突破点:结合大语言模型的自然语言理解能力,实现基于自然语言描述的指标权衡,使非技术人员也能参与指标决策。

参考链接:

- GitHub - Trusted-AI/adversarial-robustness-toolbox:IBM开发的对抗鲁棒性评估工具,包含成本敏感的指标评估

- GitHub - awslabs/fraud-detection-using-machine-learning:AWS欺诈检测项目,详细介绍了成本敏感的指标优化

- arXiv - Cost-Sensitive Learning for Imbalanced Classification:不平衡分类中的成本敏感学习

- GitHub - ml-metrics/ml-metrics:机器学习评估指标库,支持F-beta分数计算

- arXiv - Dynamic Thresholding for Adaptive Fraud Detection:自适应欺诈检测中的动态阈值调整

- GitHub - scikit-learn/scikit-learn:scikit-learn库,包含完整的精确率、召回率和F1分数计算实现

附录(Appendix):

安全场景下指标权衡的最佳实践

- 明确业务需求和误判成本:在进行指标权衡之前,首先要明确业务需求和误判成本,这是指标选择的基础。

- 选择合适的beta值:根据误判成本比例选择合适的beta值,误判成本差异越大,beta值的调整幅度也应该越大。

- 使用PR曲线而非ROC曲线:对于不平衡的安全数据,PR曲线比ROC曲线更能真实反映模型的性能。

- 考虑动态阈值调整:在威胁动态变化的场景下,使用动态阈值调整能够更好地适应变化的威胁环境。

- 结合业务规则:将机器学习模型与业务规则结合,在保证安全的前提下,减少误报对用户体验的影响。

- 定期重新评估:安全威胁不断变化,定期重新评估模型的指标表现,及时调整指标权重和决策阈值。

- 多场景测试:在不同的安全场景下测试模型的性能,确保模型在各种情况下都能表现良好。

- 可视化指标权衡:使用可视化工具展示精确率、召回率和F1分数之间的关系,帮助决策者理解指标权衡的影响。

指标计算与优化的代码模板

import numpy as np

from sklearn.metrics import precision_score, recall_score, fbeta_score, precision_recall_curve

def optimize_threshold(y_true, y_pred_proba, beta=1.0, method="fbeta"):

"""

优化模型的决策阈值

参数:

y_true: 真实标签

y_pred_proba: 预测概率

beta: F-beta分数的beta值

method: 优化方法,可选fbeta或cost

返回:

best_threshold: 最佳阈值

best_metrics: 最佳指标

"""

# 计算PR曲线

precision, recall, thresholds = precision_recall_curve(y_true, y_pred_proba)

# 计算不同阈值下的F-beta分数

fbeta_scores = []

for i, thresh in enumerate(thresholds):

y_pred = y_pred_proba >= thresh

fbeta = fbeta_score(y_true, y_pred, beta=beta)

fbeta_scores.append(fbeta)

fbeta_scores = np.array(fbeta_scores)

# 找到最佳阈值

best_idx = np.argmax(fbeta_scores)

best_threshold = thresholds[best_idx]

# 计算最佳指标

y_pred = y_pred_proba >= best_threshold

best_precision = precision_score(y_true, y_pred)

best_recall = recall_score(y_true, y_pred)

best_fbeta = fbeta_scores[best_idx]

best_metrics = {

"精确率": best_precision,

"召回率": best_recall,

"F-beta分数": best_fbeta,

"阈值": best_threshold

}

return best_threshold, best_metrics

def calculate_cost_sensitive_score(y_true, y_pred, fn_cost, fp_cost):

"""

计算成本敏感分数

参数:

y_true: 真实标签

y_pred: 预测标签

fn_cost: 假阴性成本

fp_cost: 假阳性成本

返回:

cost_score: 成本敏感分数

"""

tp = np.sum((y_pred == 1) & (y_true == 1))

fp = np.sum((y_pred == 1) & (y_true == 0))

fn = np.sum((y_pred == 0) & (y_true == 1))

total_cost = fn * fn_cost + fp * fp_cost

max_cost = len(y_true) * max(fn_cost, fp_cost) # 最大可能成本

# 归一化到0-1之间,越高越好

cost_score = 1 - (total_cost / max_cost)

return cost_score

def analyze_tradeoff(y_true, y_pred_proba, beta_values=[0.1, 0.5, 1.0, 2.0, 5.0]):

"""

分析不同beta值下的指标权衡

参数:

y_true: 真实标签

y_pred_proba: 预测概率

beta_values: 要测试的beta值列表

返回:

results: 不同beta值下的指标结果

"""

results = []

for beta in beta_values:

best_threshold, best_metrics = optimize_threshold(y_true, y_pred_proba, beta=beta)

results.append({

"beta值": beta,

"最佳阈值": best_threshold,

"精确率": best_metrics["精确率"],

"召回率": best_metrics["召回率"],

"F-beta分数": best_metrics["F-beta分数"]

})

return results安全场景下的指标权衡案例

案例1:某大型金融机构的欺诈检测系统

背景:该金融机构的欺诈检测系统面临着漏报欺诈导致经济损失和误报正常交易影响用户体验的两难困境。

解决方案:

- 与业务团队合作,量化了误判成本:漏报1次欺诈的成本约为1000美元,误报1次正常交易的成本约为10美元。

- 根据成本比例,选择了beta=1.5,更看重召回率。

- 实现了动态阈值调整,根据实时欺诈率自动调整决策阈值。

- 结合业务规则,对高风险交易进行人工审核,进一步降低误判率。

效果:

- 欺诈检测率从85%提高到95%,漏报率显著降低。

- 误报率从5%降低到2%,用户体验得到改善。

- 欺诈损失减少了60%,ROI提高了3倍。

案例2:某大型互联网公司的反垃圾邮件系统

背景:该公司的反垃圾邮件系统误报率较高,导致用户经常收不到重要邮件,投诉率上升。

解决方案:

- 调整了指标优先级,将精确率放在首位,选择了beta=0.3。

- 提高了决策阈值,从0.5提高到0.85。

- 实现了基于用户反馈的自适应调整,根据用户标记的误判邮件自动调整模型。

- 增加了白名单机制,对重要发件人的邮件直接放行。

效果:

- 误报率从3%降低到0.5%,用户投诉率下降了90%。

- 垃圾邮件检测率保持在98%以上,基本满足业务需求。

- 用户满意度提高了40%,系统使用率上升。

关键词: 精确率, 召回率, F1分数, 指标权衡, 安全攻防, 成本敏感, 动态阈值, F-beta分数, 误判成本, PR曲线

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录