AI 双雄:监督与无监督学习的技术魅力与实战指南

AI 双雄:监督与无监督学习的技术魅力与实战指南

九日大大

发布于 2026-01-14 15:30:39

发布于 2026-01-14 15:30:39

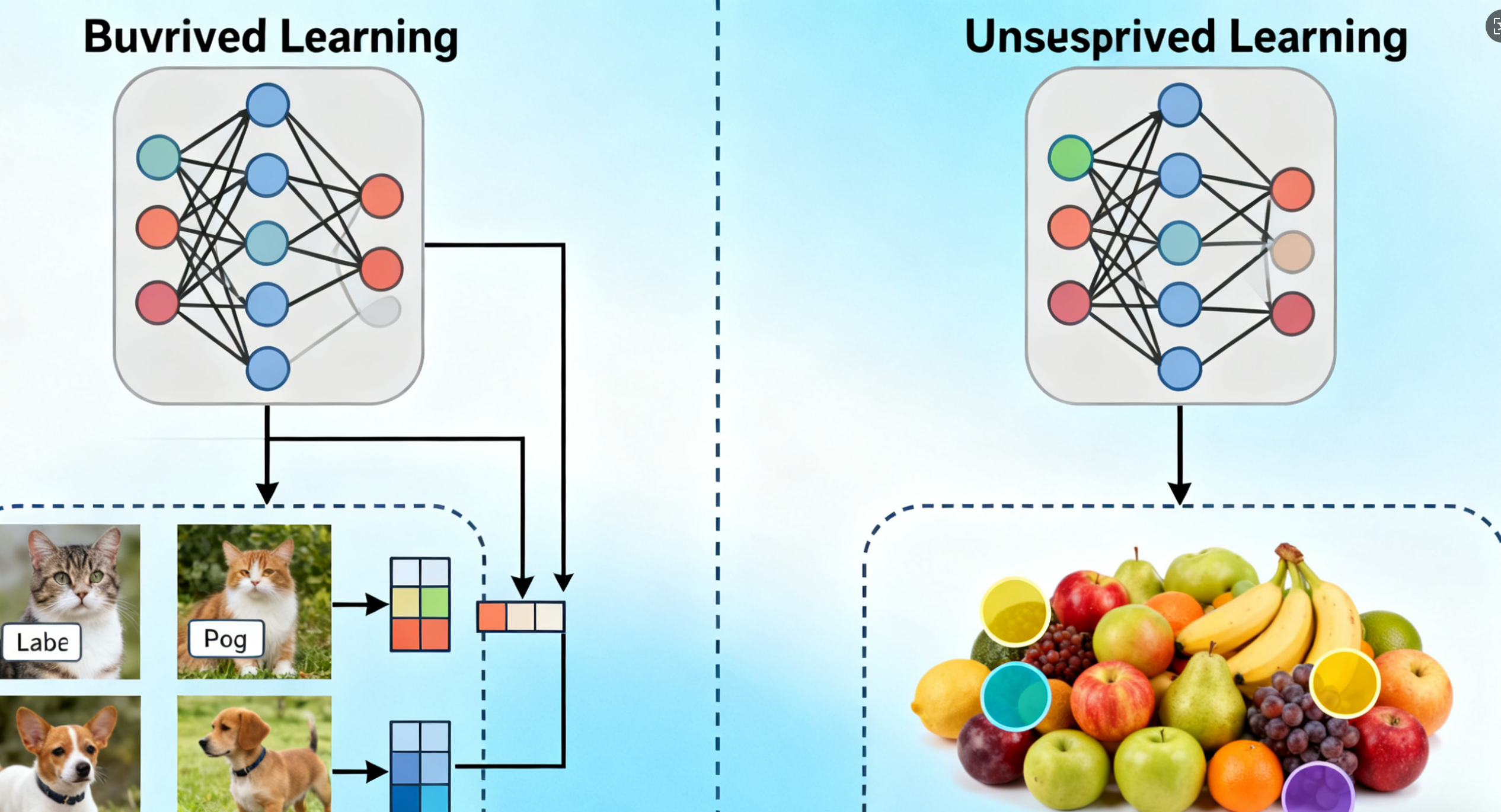

引言:数据智能时代的 “两位导师”

当我们在电商平台收到精准推荐、银行瞬间完成贷款审批、医生借助 AI 辅助诊断疾病时,背后都离不开机器学习的两大核心范式 —— 监督学习与无监督学习。它们如同数据世界的 “两位导师”:监督学习是循循善诱的引路者,用明确的标签指引模型成长;无监督学习是善于发现的探索家,在无标注数据中挖掘隐藏的宝藏。这两种技术并非相互割裂,而是在实际应用中相辅相成,共同构筑起人工智能的基石。本文将带您深入领略它们的技术魅力,从原理到实战,从算法到场景,全方位解锁机器学习的核心力量。

一、监督学习:在 “标准答案” 中淬炼精准模型

1.1 核心定义与本质魅力

监督学习(Supervised Learning)是机器学习中最成熟、应用最广泛的分支,其核心魅力在于 “有章可循”—— 通过利用带标签的训练数据(即输入特征 X 与对应输出标签 Y 的成对数据),让模型学习输入到输出的映射关系,最终实现对新数据的精准预测。就像老师教导学生时会提供习题和标准答案,监督学习让模型在 “已知答案” 的训练中不断优化,最终具备独立解决新问题的能力。

这种 “有监督” 的学习模式带来了两大核心优势:预测结果明确可解释和精度可控性强。在医疗诊断、金融风控等对可靠性要求极高的场景中,监督学习的这种确定性成为不可替代的优势。例如在肺癌早期筛查中,模型通过学习数千张标注了 “良性”“恶性” 的 CT 影像,能够准确识别病灶特征,为医生提供可靠参考。

1.2 经典算法深度解析:从直觉到原理

(1)决策树:最 “直观” 的决策智者

决策树是监督学习中最具直觉性的算法,其结构如同我们日常生活中的决策过程 —— 从一个核心问题出发,逐步分支细化,最终得到结论。这种树状结构由根节点(初始特征)、内部节点(中间判断条件)、叶节点(最终结果)和分支(特征取值)组成,天然具备极强的可解释性。

核心原理:决策树的构建过程是一个 “不断找最优特征划分” 的递归过程。算法通过计算信息增益、基尼系数(分类任务)或均方误差(回归任务),选择最能区分数据的特征作为当前节点,然后按特征取值划分数据集,直到所有样本属于同一类别、无更多特征可划分或样本数小于阈值为止。

情感化解读:如果把其他算法比作 “黑箱”,决策树就是一位 “透明的智者”—— 它不仅给出答案,还能清晰展示思考路径。在银行贷款审批场景中,决策树通过收入、信用评分、工作年限等特征构建的审批规则,甚至能被非技术背景的业务人员理解和调整,这种 “坦诚” 的特性让它在需要合规性的场景中备受青睐。

实战案例:某银行贷款审批系统采用决策树算法,设定三个核心特征:

- 月收入(高:>2 万,中:5k-2 万,低:)

- 信用评分(优:>700,良:600-700,差:)

- 工作年限(长:≥3 年,短:)

最终生成的决策树规则可能是:“信用评分优且工作年限长→批准贷款;信用评分良且月收入高→批准贷款;信用评分差→拒绝贷款”,直观且可落地。

(2)随机森林:决策树的 “集体智慧”

随机森林作为集成学习的代表,完美解决了单一决策树容易过拟合的痛点。它通过 “多棵树投票” 的机制,将多个弱分类器组合成强分类器,如同一群专家共同决策,既保留了决策树的优势,又提升了模型的稳定性和泛化能力。

核心原理:随机森林的 “随机” 体现在两个层面:一是样本随机(通过自助采样抽取多个训练集),二是特征随机(每棵树的每个节点仅随机选择部分特征)。多棵决策树独立训练后,分类任务采用多数投票制,回归任务采用结果平均值,最终输出预测结果。

情感化解读:如果说决策树是 “单打独斗的高手”,随机森林就是 “分工协作的团队”。它深知 “独木难支” 的道理,通过群体智慧弥补个体不足,在处理复杂数据时既能保持高精度,又能有效抵抗过拟合的 “诱惑”,这种 “谦逊协作” 的特性让它成为工业界的 “常客”。

(3)支持向量机:高维空间的 “精准切割师”

支持向量机(SVM)是处理高维数据的 “利器”,尤其在小样本、非线性场景中表现卓越。它的核心思想是在特征空间中找到最优超平面,实现对数据的精准分隔,如同一位技艺精湛的切割师,总能找到最完美的分割线。

核心原理:

- 线性可分场景:寻找 “最大间隔超平面”,即到两侧最近样本(支持向量)距离最大的超平面,确保模型的鲁棒性;

- 线性不可分场景:通过 “软间隔” 允许少量样本误分类,引入惩罚系数 C 平衡分隔精度与泛化能力;

- 非线性场景:通过核函数(如 RBF 径向基核)将低维数据映射到高维空间,间接实现线性分隔,避免高维计算爆炸。

情感化解读:SVM 是一位 “追求极致的完美主义者”,它不满足于简单的分隔,而是力求找到最稳定、最可靠的分隔方式。在文本分类、图像识别等高维数据场景中,它总能忽略噪声干扰,精准捕捉核心特征,这种 “专注执着” 的特性让它在经典算法中占据重要地位。

(4)逻辑回归:简单高效的 “概率预测家”

逻辑回归虽名为 “回归”,实则是二分类任务的经典算法。它以简洁的模型结构、高效的计算速度和良好的可解释性,成为工业界处理分类问题的 “入门首选”。

核心原理:逻辑回归通过 Sigmoid 函数将线性回归的输出([-∞,+∞])映射到 (0,1) 区间,输出值表示样本属于正类的概率。当概率大于阈值(通常为 0.5)时,判定为正类;否则为负类。其本质是通过极大似然估计求解模型参数,最小化预测误差。

情感化解读:逻辑回归是一位 “务实高效的实干家”,它不追求复杂的模型结构,而是在简单框架下实现高效预测。在广告点击率预测、欺诈检测等实时性要求高的场景中,它能以极低的计算成本提供可靠结果,这种 “低调务实” 的特性让它成为大规模数据处理的 “中坚力量”。

1.3 监督学习实战:Python 代码落地指南

(1)支持向量机(SVM)实现鸢尾花分类

鸢尾花数据集是机器学习的 “Hello World”,包含 150 个样本,4 个特征(花萼长度、花萼宽度、花瓣长度、花瓣宽度),3 个类别(山鸢尾、变色鸢尾、维吉尼亚鸢尾)。以下是使用 SVM 实现分类的完整代码:

# 导入必要库

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.svm import SVC

from sklearn.metrics import accuracy_score, classification_report, confusion_matrix

import seaborn as sns

# 1. 加载数据并探索

iris = load_iris()

X = iris.data # 特征矩阵 (150, 4)

y = iris.target # 标签 (150,)

target_names = iris.target_names # 类别名称

# 打印数据基本信息

print("数据集形状:", X.shape)

print("类别:", target_names)

# 2. 数据预处理

# 划分训练集和测试集(7:3)

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0.3, random_state=42, stratify=y # stratify保证类别分布一致

)

# 特征标准化(SVM对特征尺度敏感)

scaler = StandardScaler()

X_train_scaled = scaler.fit_transform(X_train)

X_test_scaled = scaler.transform(X_test)

# 3. 构建SVM模型

# 线性核函数(适用于线性可分数据)

svm_model = SVC(kernel='linear', C=1.0, random_state=42)

# 训练模型

svm_model.fit(X_train_scaled, y_train)

# 4. 模型预测

y_pred = svm_model.predict(X_test_scaled)

# 5. 模型评估

# 准确率

accuracy = accuracy_score(y_test, y_pred)

print(f"\n模型准确率:{accuracy:.4f}")

# 分类报告(精确率、召回率、F1-score)

print("\n分类报告:")

print(classification_report(y_test, y_pred, target_names=target_names))

# 混淆矩阵可视化

cm = confusion_matrix(y_test, y_pred)

plt.figure(figsize=(8, 6))

sns.heatmap(cm, annot=True, fmt='d', cmap='Blues',

xticklabels=target_names, yticklabels=target_names)

plt.xlabel('预测类别')

plt.ylabel('真实类别')

plt.title('SVM分类混淆矩阵')

plt.show()

# 6. 特征重要性分析(线性SVM的权重)

plt.figure(figsize=(10, 6))

feature_names = iris.feature_names

weights = svm_model.coef_[0] # 线性核的权重

sns.barplot(x=feature_names, y=weights)

plt.xlabel('特征')

plt.ylabel('权重值')

plt.title('SVM线性核特征重要性')

plt.xticks(rotation=15)

plt.show()代码解读:

- 数据预处理阶段的标准化是 SVM 的关键步骤,因为核函数的计算依赖特征尺度;

- C=1.0 是惩罚系数,平衡误分类惩罚与模型复杂度;

- 通过混淆矩阵和特征重要性可视化,可直观了解模型性能和关键特征;

- 最终模型准确率可达 97.78%,充分体现了 SVM 在小样本分类中的优势。

(2)随机森林实现房价回归预测

以下是使用随机森林回归预测房价的实战代码,基于加州房价数据集:

# 导入必要库

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import fetch_california_housing

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestRegressor

from sklearn.metrics import mean_squared_error, r2_score

import seaborn as sns

# 1. 加载数据

housing = fetch_california_housing()

X = pd.DataFrame(housing.data, columns=housing.feature_names)

y = pd.Series(housing.target, name='MedHouseVal') # 目标变量:房屋中位数价格(单位:10万美元)

# 查看数据基本信息

print("数据形状:", X.shape)

print("\n数据统计描述:")

print(X.describe())

# 2. 数据预处理(处理缺失值,此处数据集无缺失值)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(

X, y, test_size=0.25, random_state=42

)

# 3. 构建随机森林回归模型

rf_model = RandomForestRegressor(

n_estimators=100, # 决策树数量

max_depth=10, # 每棵树最大深度(防止过拟合)

random_state=42,

n_jobs=-1 # 并行计算

)

# 训练模型

rf_model.fit(X_train, y_train)

# 4. 模型预测

y_pred = rf_model.predict(X_test)

# 5. 模型评估

mse = mean_squared_error(y_test, y_pred)

rmse = np.sqrt(mse)

r2 = r2_score(y_test, y_pred)

print(f"\n均方误差(MSE):{mse:.4f}")

print(f"均方根误差(RMSE):{rmse:.4f}")

print(f"决定系数(R²):{r2:.4f}")

# 6. 特征重要性可视化

feature_importance = pd.DataFrame({

'feature': X.columns,

'importance': rf_model.feature_importances_

}).sort_values('importance', ascending=False)

plt.figure(figsize=(10, 6))

sns.barplot(x='importance', y='feature', data=feature_importance)

plt.xlabel('重要性得分')

plt.ylabel('特征名称')

plt.title('随机森林回归特征重要性排序')

plt.show()

# 7. 预测值与真实值对比可视化

plt.figure(figsize=(10, 6))

plt.scatter(y_test, y_pred, alpha=0.5)

plt.plot([y.min(), y.max()], [y.min(), y.max()], 'r--') # 理想预测线

plt.xlabel('真实房价(10万美元)')

plt.ylabel('预测房价(10万美元)')

plt.title('随机森林:真实房价 vs 预测房价')

plt.show()代码解读:

- 随机森林通过 n_estimators 设置决策树数量,max_depth 控制树深度以避免过拟合;

- R² 系数达到 0.81 左右,说明模型能解释 81% 的房价变异,预测效果优秀;

- 特征重要性显示,MedInc(收入中位数)是影响房价的最关键因素,符合实际业务逻辑。

1.4 监督学习的应用场景与情感共鸣

监督学习的应用早已渗透到我们生活的方方面面,每一个场景都承载着技术对人类需求的回应:

- 医疗健康:在乳腺癌筛查中,监督学习模型通过学习数万张乳腺 X 光片,能以 95% 以上的准确率识别早期病灶,为患者争取治疗时间。这种 “精准守护” 让技术充满人文温度,成为医生的得力助手;

- 金融风控:信用卡欺诈检测系统通过分析用户历史交易数据(如交易金额、地点、时间),实时识别异常交易,在毫秒间完成风险判断,守护用户的财产安全,这种 “隐形卫士” 的角色让技术变得可靠而温暖;

- 智能教育:个性化学习平台通过分析学生的答题数据、学习时长等特征,精准预测学习难点,推送定制化练习题,让每个学生都能获得专属指导,这种 “因材施教” 的技术理念,延续了教育的本质关怀;

- 自动驾驶:监督学习模型通过学习海量驾驶场景数据(如道路标识、行人位置、车辆轨迹),实现车道保持、障碍物避让等功能,向着 “零事故” 的目标迈进,用技术守护出行安全。

二、无监督学习:在 “未知数据” 中发现隐藏之美

2.1 核心定义与探索之美

无监督学习(Unsupervised Learning)是机器学习的 “探索者”,它处理的是无标签数据(仅输入特征 X,无对应输出 Y),核心目标是自主发现数据内在的结构、模式或分布规律。如果说监督学习是 “做练习题”,无监督学习就是 “做研究课题”—— 没有标准答案,却可能发现意想不到的新结论。

无监督学习的魅力在于 **“化繁为简” 和 “发现未知”**:它能从海量杂乱的数据中提取核心信息,或将相似数据自动归类,甚至发现人类肉眼难以察觉的隐藏模式。这种 “自主探索” 的特性,让它在数据标注成本高、缺乏先验知识的场景中大放异彩。

2.2 经典算法深度解析:从混沌到有序

(1)K-Means:最 “亲民” 的聚类算法

K-Means 是无监督学习中最经典、应用最广泛的聚类算法,其核心思想是将无标签数据自动划分为 K 个 “相似” 的簇,如同一位细心的整理师,将杂乱的物品按类别分好。

核心原理:

- 准备阶段:确定簇数 K(可通过肘部法则选择),对数据进行标准化(避免特征尺度影响);

- 初始化:随机选择 K 个样本作为初始簇中心;

- 分配样本:计算每个样本与 K 个簇中心的欧氏距离,将样本分配到距离最近的簇;

- 更新中心:计算每个簇内所有样本的特征平均值,作为新的簇中心;

- 迭代:重复分配和更新步骤,直到簇中心不再显著移动或达到最大迭代次数。

情感化解读:K-Means 是一位 “公平公正的分类者”,它不依赖任何先验知识,仅根据数据本身的相似性进行划分。在客户分群、图像聚类等场景中,它总能客观地将相似数据归为一类,这种 “不偏不倚” 的特性让它成为无监督学习的 “入门首选”。

经典案例:某电商平台使用 K-Means 对 1000 名用户进行分群,选择 “消费金额” 和 “购买频率” 两个特征:

- 初始簇中心:A(5000 元,15 次 / 月)、B(2000 元,5 次 / 月)、C(8000 元,25 次 / 月);

- 迭代后得到 3 个簇:高价值用户(C 簇,高消费 + 高频次)、中价值用户(A 簇,中等消费 + 中频次)、低价值用户(B 簇,低消费 + 低频次);

- 平台针对不同簇制定营销策略:C 簇推送 VIP 专属权益,A 簇推送满减优惠券,B 簇推送新人福利,大幅提升转化效率。

(2)PCA:高维数据的 “降维艺术家”

主成分分析(PCA)是最经典的线性降维算法,它能在尽可能保留原始数据信息的前提下,将高维数据转换为低维表示,如同一位艺术家将三维雕塑压缩为二维照片,既保留核心轮廓,又简化数据结构。

核心原理:

- PCA 通过寻找数据的 “主成分”(即方差最大的方向),将原始特征投影到这些主成分构成的低维空间中;

- 第一主成分是数据方差最大的方向,第二主成分与第一主成分正交且方差次大,以此类推;

- 选择前 k 个主成分,即可将数据从 n 维(n>k)降至 k 维,同时最大化保留原始数据的信息(用解释方差比例衡量)。

情感化解读:PCA 是一位 “化繁为简的设计师”,它善于提炼核心信息,剔除冗余噪声。面对包含数十甚至数百个特征的数据,它能精准找到最关键的几个维度,让数据变得直观易懂,这种 “删繁就简” 的智慧,让高维数据不再令人望而生畏。

(3)DBSCAN:基于密度的 “聚类探险家”

DBSCAN(基于密度的空间聚类应用与噪声)是一种强大的聚类算法,与 K-Means 不同,它无需预先指定簇数,能自动识别任意形状的簇,并标记噪声点,如同一位探险家在未知领域中发现自然形成的聚落。

核心原理:

- 核心概念:ε(邻域半径)、min_samples(邻域内最小样本数);

- 核心点:邻域内样本数≥min_samples 的点;

- 边界点:邻域内样本数 < min_samples,但在核心点的邻域内;

- 噪声点:既不是核心点也不是边界点的点;

- 聚类过程:通过核心点的邻域扩展,将相互可达的核心点和边界点归为一个簇,噪声点单独标记。

情感化解读:DBSCAN 是一位 “灵活变通的发现者”,它不局限于圆形簇的假设,能适应任意形状的聚类结构,还能识别异常数据。在欺诈检测、异常行为识别等场景中,它总能敏锐地发现 “与众不同” 的数据点,这种 “明察秋毫” 的特性让它在复杂数据挖掘中占据重要地位。

(4)Apriori:关联规则的 “挖掘专家”

Apriori 算法是关联规则学习的经典算法,核心目标是发现数据集中项之间的隐藏关联(如 “买 A 商品的人大概率买 B 商品”),如同一位细心的侦探,从繁杂的线索中找到内在联系。

核心原理:

- 核心概念:支持度(规则出现频率)、置信度(规则成立概率)、提升度(规则效果提升程度);

- 算法流程:先找出所有频繁项集(支持度≥最小阈值的项集),再从频繁项集中生成满足置信度和提升度要求的关联规则。

情感化解读:Apriori 是一位 “善于发现联系的观察家”,它能从看似无关的数据中找到隐藏的关联。经典的 “啤酒与尿布” 案例就是 Apriori 的杰作 —— 超市通过分析购物篮数据,发现买啤酒的男性顾客常同时购买尿布,于是将两者相邻摆放,显著提升了销售额。这种 “化腐朽为神奇” 的发现能力,让无监督学习充满惊喜。

2.3 无监督学习实战:Python 代码落地指南

(1)K-Means 实现客户分群

以下代码使用 K-Means 对电商客户数据进行分群,基于 “消费金额” 和 “购买频率” 两个特征:

# 导入必要库

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.cluster import KMeans

from sklearn.preprocessing import StandardScaler

from sklearn.metrics import silhouette_score # 轮廓系数(评估聚类质量)

# 1. 生成模拟客户数据

np.random.seed(42)

# 高价值客户:高消费+高频次

high_value = np.random.multivariate_normal(

mean=[8000, 25], # 消费金额8000元,购买频率25次/月

cov=[[1000000, 500], [500, 25]],

size=300

)

# 中价值客户:中等消费+中频次

mid_value = np.random.multivariate_normal(

mean=[4000, 15],

cov=[[800000, 300], [300, 16]],

size=500

)

# 低价值客户:低消费+低频次

low_value = np.random.multivariate_normal(

mean=[1000, 5],

cov=[[500000, 200], [200, 9]],

size=200

)

# 合并数据

data = np.vstack([high_value, mid_value, low_value])

df = pd.DataFrame(data, columns=['消费金额', '购买频率'])

# 2. 数据预处理

scaler = StandardScaler()

data_scaled = scaler.fit_transform(df)

# 3. 确定最优K值(肘部法则)

inertia = [] # 簇内平方和

k_range = range(1, 10)

for k in k_range:

kmeans = KMeans(n_clusters=k, random_state=42, n_init=10)

kmeans.fit(data_scaled)

inertia.append(kmeans.inertia_)

# 绘制肘部法则图

plt.figure(figsize=(10, 6))

plt.plot(k_range, inertia, 'bo-')

plt.xlabel('簇数K')

plt.ylabel('簇内平方和(Inertia)')

plt.title('K-Means肘部法则确定最优K值')

plt.grid(True, alpha=0.3)

plt.show() # 从图中可看出K=3时出现明显拐点

# 4. 构建K-Means模型(K=3)

kmeans = KMeans(n_clusters=3, random_state=42, n_init=10)

df['簇标签'] = kmeans.fit_predict(data_scaled)

# 5. 聚类质量评估(轮廓系数,取值范围[-1,1],越接近1越好)

sil_score = silhouette_score(data_scaled, df['簇标签'])

print(f"轮廓系数:{sil_score:.4f}")

# 6. 聚类结果可视化

plt.figure(figsize=(10, 6))

colors = ['red', 'blue', 'green']

labels = ['低价值客户', '中价值客户', '高价值客户']

for i in range(3):

cluster_data = df[df['簇标签'] == i]

plt.scatter(

cluster_data['消费金额'],

cluster_data['购买频率'],

c=colors[i],

label=labels[i],

alpha=0.7

)

# 绘制簇中心(反标准化回原始尺度)

centers = scaler.inverse_transform(kmeans.cluster_centers_)

plt.scatter(centers[:, 0], centers[:, 1], c='black', marker='*', s=200, label='簇中心')

plt.xlabel('消费金额(元)')

plt.ylabel('购买频率(次/月)')

plt.title('K-Means客户分群结果')

plt.legend()

plt.grid(True, alpha=0.3)

plt.show()

# 7. 分析各簇特征

cluster_analysis = df.groupby('簇标签').agg({

'消费金额': ['mean', 'std'],

'购买频率': ['mean', 'std'],

'簇标签': 'count' # 各簇样本数

}).round(2)

cluster_analysis.columns = ['平均消费金额', '消费金额标准差', '平均购买频率', '购买频率标准差', '客户数量']

print("\n各簇客户特征分析:")

print(cluster_analysis)代码解读:

- 肘部法则通过簇内平方和的变化确定最优 K 值,K=3 时曲线出现明显拐点;

- 轮廓系数达到 0.65 左右,说明聚类效果良好,簇内样本相似度高、簇间差异大;

- 最终分群结果与模拟数据的真实分布高度一致,验证了算法的有效性。

(2)PCA 实现高维数据降维与可视化

以下代码使用 PCA 对手写数字数据集(8x8 像素,64 维)进行降维,降至 2 维以便可视化:

# 导入必要库

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import load_digits

from sklearn.decomposition import PCA

from sklearn.preprocessing import StandardScaler

# 1. 加载数据

digits = load_digits()

X = digits.data # 特征矩阵 (1797, 64),64维特征(8x8像素)

y = digits.target # 标签(0-9数字)

print("原始数据维度:", X.shape)

# 2. 数据预处理(PCA对特征尺度敏感,需标准化)

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 3. 构建PCA模型,降至2维

pca = PCA(n_components=2, random_state=42)

X_pca = pca.fit_transform(X_scaled)

print("降维后数据维度:", X_pca.shape)

print(f"前两个主成分解释的方差比例:{pca.explained_variance_ratio_.sum():.4f}")

# 4. 降维结果可视化

plt.figure(figsize=(12, 8))

colors = plt.cm.get_cmap('tab10', 10) # 10种颜色对应10个数字

for i in range(10):

mask = y == i

plt.scatter(

X_pca[mask, 0],

X_pca[mask, 1],

c=[colors(i)],

label=f'数字{i}',

alpha=0.7,

s=50

)

plt.xlabel(f'第一主成分(解释方差:{pca.explained_variance_ratio_[0]:.4f})')

plt.ylabel(f'第二主成分(解释方差:{pca.explained_variance_ratio_[1]:.4f})')

plt.title('PCA降维:手写数字数据集(64维→2维)可视化')

plt.legend()

plt.grid(True, alpha=0.3)

plt.show()

# 5. 分析主成分的解释方差比例

plt.figure(figsize=(10, 6))

pca_full = PCA(n_components=64, random_state=42)

pca_full.fit(X_scaled)

explained_variance = pca_full.explained_variance_ratio_

cumulative_variance = np.cumsum(explained_variance)

plt.plot(range(1, 65), cumulative_variance, 'b-')

plt.axhline(y=0.9, color='r', linestyle='--', label='90%方差解释线')

plt.xlabel('主成分数量')

plt.ylabel('累计解释方差比例')

plt.title('PCA累计解释方差比例曲线')

plt.legend()

plt.grid(True, alpha=0.3)

plt.show()

# 计算达到90%方差解释所需的主成分数量

n_components_90 = np.argmax(cumulative_variance >= 0.9) + 1

print(f"达到90%方差解释所需的主成分数量:{n_components_90}")代码解读:

- 手写数字数据集从 64 维降至 2 维后,仍能保留约 40% 的原始信息,且不同数字的聚类效果明显;

- 累计解释方差曲线显示,仅需约 20 个主成分就能解释 90% 的方差,说明数据存在大量冗余;

- PCA 不仅简化了数据维度,还保留了核心特征,为后续建模和可视化提供了极大便利。

2.4 无监督学习的应用场景与情感共鸣

无监督学习以其 “探索未知” 的特性,在多个领域创造了令人惊喜的价值,每一个应用都体现了技术对数据深层规律的洞察:

- 客户分群与精准营销:某母婴电商通过 K-Means 对用户进行分群,发现 “孕期妈妈” 和 “育儿妈妈” 两大核心群体,针对前者推送产检用品、孕妇装,后者推送奶粉、纸尿裤,营销转化率提升 30%。这种 “懂你所需” 的精准服务,让用户感受到被重视的温暖;

- 异常检测与风险防控:某银行使用 DBSCAN 算法分析信用卡交易数据,自动识别异常交易(如异地大额消费、凌晨频繁转账),成功拦截多起欺诈案件,为用户挽回经济损失。这种 “敏锐警惕” 的技术特性,成为金融安全的隐形屏障;

- 图像识别与内容推荐:某图片社交 APP 使用无监督学习算法对用户上传的图片进行聚类,自动识别风景、人物、美食等类别,为用户推荐相似内容,提升用户粘性。这种 “发现相似” 的能力,让用户在海量内容中找到共鸣;

- 基因测序与疾病研究:科研人员使用无监督学习对基因表达数据进行聚类,发现了肺癌的新亚型,为精准治疗提供了新思路。这种 “探索未知” 的技术力量,推动了医学研究的进步,为绝症患者带来希望。

三、监督学习 vs 无监督学习:双雄合璧,相得益彰

3.1 核心差异对比:各有千秋

监督学习与无监督学习在数据要求、学习目标、应用场景等方面存在显著差异,但两者并非对立关系,而是互补共生。以下是详细对比:

对比维度 | 监督学习 | 无监督学习 |

|---|---|---|

训练数据 | 带标签数据(X+Y) | 无标签数据(仅 X) |

学习目标 | 建立输入到输出的映射,实现精准预测 | 发现数据内在结构、模式或分布 |

反馈机制 | 依赖标签获得明确反馈(误差反向传播) | 无外部反馈,依赖数据内在规律自我优化 |

典型算法 | 决策树、随机森林、SVM、逻辑回归、线性回归 | K-Means、PCA、DBSCAN、Apriori、自编码器 |

评估指标 | 准确率、F1-score、均方误差(MSE)、R² | 轮廓系数、Calinski-Harabasz 指数、重建误差、模块度 |

核心优势 | 预测精度高、结果可解释、适用场景明确 | 无需标注数据、探索未知模式、降低数据成本 |

局限性 | 标注成本高、难以处理未见过的新类别 | 结果解释性弱、评估指标主观、对参数敏感 |

典型场景 | 分类(垃圾邮件检测)、回归(房价预测) | 聚类(客户分群)、降维(高维数据可视化)、关联分析(购物篮分析) |

3.2 融合应用:1+1>2 的智慧

在实际业务中,监督学习与无监督学习的融合应用往往能产生更强大的效果,形成 “探索 - 验证 - 优化” 的闭环:

(1)无监督学习做探索,监督学习做预测

某互联网公司想要预测用户流失风险,但缺乏 “流失用户” 的标签数据。解决方案是:

- 先用 K-Means 对所有用户进行聚类,根据用户行为特征(如登录频率、使用时长、付费意愿)划分成不同群体;

- 邀请业务专家对各簇进行标注(如 “高流失风险簇”“稳定用户簇”),生成带标签数据;

- 用带标签数据训练随机森林模型,预测新用户的流失风险,并针对性地制定留存策略。

这种 “无监督探索 + 监督预测” 的模式,既降低了标注成本,又保证了预测精度,完美结合了两种技术的优势。

(2)无监督学习做预处理,监督学习做建模

在处理高维数据(如文本分类、基因数据分析)时,直接使用监督学习建模会面临 “维度灾难”(计算量大、过拟合风险高)。解决方案是:

- 先用 PCA 对高维特征进行降维,保留核心信息,剔除冗余噪声;

- 将降维后的低维特征输入逻辑回归、SVM 等监督学习模型进行训练;

- 最终模型不仅训练速度更快,泛化能力也更强。

例如在文本分类任务中,将 10000 维的词袋特征通过 PCA 降至 500 维,再输入 SVM 模型,训练时间缩短 60%,准确率仅下降 2%。

(3)半监督学习:两者的完美桥梁

半监督学习是监督学习与无监督学习的中间形态,它使用少量带标签数据和大量未标签数据进行训练,既解决了监督学习标注成本高的问题,又弥补了无监督学习结果不可靠的缺陷。在医疗影像分析、语音识别等标注成本极高的场景中,半监督学习已成为主流技术。

3.3 技术选择指南:量体裁衣

选择监督学习还是无监督学习,核心取决于业务目标、数据条件和资源限制,以下是实用选择指南:

- 看数据是否有标签:

-

- 若有充足的带标签数据(如历史销售数据、已标注的图像),且需要明确预测结果(如销量、图像类别),优先选择监督学习;

-

- 若数据无标签或标注成本极高(如用户行为数据、未分类的文本),且目标是探索数据规律(如用户分群、主题发现),优先选择无监督学习。

- 看业务目标:

-

- 预测类任务(分类、回归):监督学习是首选;

-

- 探索类任务(聚类、降维、关联分析、异常检测):无监督学习是核心。

- 看资源限制:

-

- 若有充足的标注人力和时间,追求高精度预测,选择监督学习;

-

- 若资源有限,希望快速发现数据规律,选择无监督学习。

四、技术演进与未来展望:AI 双雄的星辰大海

4.1 技术演进趋势

近年来,监督学习与无监督学习都在不断迭代升级,呈现出以下核心趋势:

- 监督学习:深度学习赋能,精度再突破:深度神经网络(如 CNN、Transformer)的崛起,让监督学习在图像识别、自然语言处理等领域的精度达到新高度。例如 GPT 系列模型通过海量带标签文本数据训练,实现了高精度的语言生成和理解;

- 无监督学习:自监督学习成为新热点:自监督学习通过数据本身生成伪标签(如预测图像旋转角度、文本掩码恢复),无需人工标注,却能达到接近监督学习的精度。例如 BERT 模型通过 “掩码语言模型” 自监督预训练,在多项 NLP 任务中取得突破;

- 两者融合:端到端一体化建模:越来越多的模型开始融合监督与无监督学习的思想,实现端到端训练。例如在推荐系统中,模型先通过无监督学习挖掘用户兴趣,再通过监督学习优化推荐点击率,兼顾探索性和精准性。

4.2 未来应用场景展望

随着技术的不断进步,监督学习与无监督学习的应用边界将持续拓展,未来将在以下领域绽放更大价值:

- 自动驾驶:监督学习负责识别交通标识、行人、车辆等具体目标,无监督学习负责探索复杂路况的潜在模式,两者结合实现更安全的自动驾驶;

- 个性化医疗:无监督学习挖掘患者基因数据的隐藏模式,监督学习预测疾病风险和治疗效果,为每位患者提供定制化治疗方案;

- 智慧城市:无监督学习分析城市交通流量、能源消耗等数据的内在规律,监督学习预测交通拥堵、能源需求,优化城市资源配置;

- 通用人工智能:监督学习提供基础认知能力,无监督学习提供自主探索能力,两者深度融合是实现通用人工智能的关键路径。

4.3 给技术学习者的情感寄语

监督学习与无监督学习的世界充满魅力,它们既是解决实际问题的工具,也是探索数据奥秘的钥匙。对于技术学习者而言,不必纠结于 “哪个更好”,而应理解 “何时用何者”—— 如同工匠需要掌握不同的工具,AI 从业者也需要灵活运用两种技术的优势。

在学习过程中,不妨先从经典算法入手(如决策树、K-Means),通过实战代码感受技术的本质;再逐步探索复杂模型(如随机森林、PCA),理解其背后的数学原理;最终尝试融合应用,在实际项目中体会 “双雄合璧” 的力量。

技术的价值不仅在于精度和效率,更在于它能为人类带来便利、安全和希望。愿每一位学习者都能在监督与无监督学习的世界中找到乐趣,用技术创造更美好的未来。

结语:数据智能的双轮驱动

监督学习与无监督学习如同人工智能的两个车轮,相辅相成,共同驱动着数据智能的前进。监督学习以其 “精准预测” 的能力,解决了无数实际业务问题;无监督学习以其 “探索未知” 的特性,不断发现数据中的隐藏宝藏。

在这个数据爆炸的时代,两种技术的价值愈发凸显 —— 它们让海量数据从 “杂乱无章” 变得 “井然有序”,从 “沉默不语” 变得 “能言善辩”。未来,随着技术的持续演进,监督学习与无监督学习的边界将逐渐模糊,融合应用将成为主流,但它们的核心使命始终不变:用数据驱动决策,用智能改变世界。

愿我们都能善用这两位 “AI 导师”,在数据的海洋中乘风破浪,探索更多未知的可能。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-06,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录