我们正在见证:一场由Sora发起的信息生态崩塌

我们正在见证:一场由Sora发起的信息生态崩塌

科技旋涡

发布于 2026-01-13 13:01:44

发布于 2026-01-13 13:01:44

点击上方蓝字关注我们

所谓的AI民主化,不过是把侵权权力发给每个人

作者| 王秦州

国庆假期被Sora刷屏了吧?朋友圈里全是各种AI生成的短视频,真人的就不提了,什么海绵宝宝、皮卡丘乱入现实世界...

等等,先别急着感叹技术有多牛逼。

冷静下来仔细想想,这背后暴露的问题,可比技术本身更值得关注。

OpenAI这次的操作,说好听点叫"大胆创新",说难听点就是"先污染,后治理"的经典套路又来了。

这就是传说中的"邀请制"?

OpenAI说Sora采用邀请制发布,听起来很高端对吧?但你猜怎么着,这玩意儿直接冲到App Store第一名了!

邀请制发布还能登顶?要么是他们的邀请码发得比优惠券还勤快,要么就是...这个"限制"压根就是做样子的。

我寻思着,真要控制规模的话,怎么可能让产品这么快就病毒式传播?

这个"邀请制"更像是一个法律挡箭牌。万一出了事,OpenAI可以说:"我们只是在小范围测试,不是商业化运营啊!"

但现实是什么?用户疯狂涌入,内容野蛮生长,版权方措手不及。

版权?什么版权?

最离谱的来了!

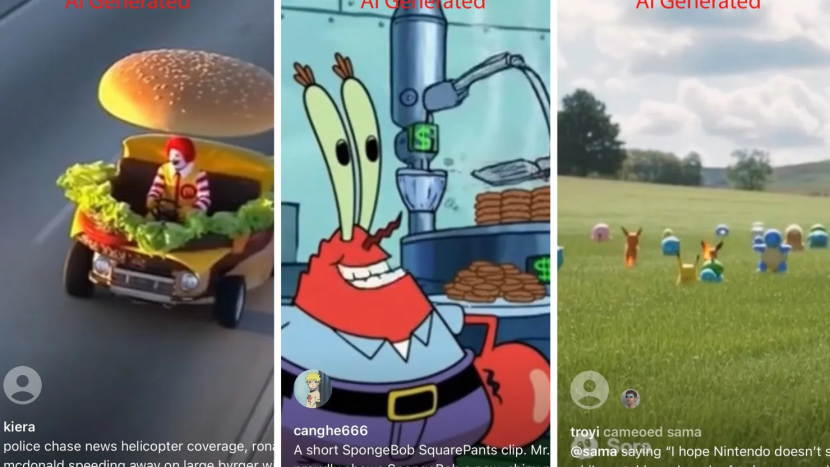

在亲身测试了Sora后,我发现了平台上充斥着各种未经授权的角色:

海绵宝宝在搞BLM抗议;

皮卡丘在白宫玫瑰园偷花;

瑞克和莫蒂各种乱入;

甚至还有麦当劳叔叔开着汉堡形状的车逃避警察追捕...

更搞笑的是,还有人生成了一个视频,内容是Sam Altman和一堆宝可梦站在田野里,Altman直接说:"我希望任天堂不要起诉我们。"

兄弟,你都知道要被起诉了,还硬上?这波操作我是真的看不懂...

迪士尼、派拉蒙、华纳兄弟这些大厂到现在都没回应媒体们的置评请求。估计法务部门正在连夜开会讨论怎么起诉呢。

"民主化AI"?别扯了

OpenAI一直在喊什么"让AI民主化","赋能创作者"...

结果呢?真正被"民主化"的是啥?

侵权被民主化了

随便一个用户都能生成迪士尼角色的视频。以前你想用米老鼠做个视频,得跟迪士尼谈授权,现在?直接AI生成,完事儿。

假新闻被民主化了

通过已有的视频资料不难发现,Sora可以生成各种假新闻片段:

人员密集区域的"炸弹恐慌"场景;

不堪入目的"战争场面",连小孩都能生成出来说自己家被烧了;

用"战争"相关的关键词,直接生成一个记者穿防弹衣报道交火的画面……

这些视频逼真到可怕,如果流传到社交媒体上,谁能分清真假?

仇恨言论被民主化了

最过分的是,有人用一些敏感的关键词,生成了一个黑人喊话(白人至上主义口号)的视频。

这就是你们说的"集体创造力"?

收入分享:糖衣包装的强盗逻辑

面对铺天盖地的批评,OpenAI赶紧调整策略,Sam Altman发博客说要跟版权方"分享收入"。

听起来很公平对吧?

但本质上就是强盗逻辑啊!

这就好比有人偷了你家车,被抓住后对你说:"要不咱们合伙开滴滴吧,我负责开车,赚到钱咱们五五分。"

更关键的是,这种"合作"完全不对等:

信息不透明:版权方根本不知道自己的内容被用了多少次

议价能力悬殊:OpenAI掌握技术和数据,个人创作者能有啥话语权?

替代威胁:你不合作?没关系,反正有的是其他内容可以用……

据《华尔街日报》报道,OpenAI在发布前就联系了一些工作室,说如果不想被AI复制,可以选择"退出"。

这逻辑对吗?应该是默认禁止,主动授权才对啊!

结果人家迪士尼直接拒绝了这种"合作"。能不拒绝吗?谁知道你会让米老鼠干什么奇奇怪怪的事情...

先不看国内专家,看看国外专家怎么说?

学术界对这事儿的态度很明确。

华盛顿大学的Emily Bender教授说得很直白:

"合成媒体机器对我们的信息生态系统是一种祸害...就像石油泄漏一样,通过技术和社会基础设施的连接流动,削弱和破坏信任关系。"

斯坦福法学院的Mark Lemley教授更是直接:

"OpenAI正在让自己面临相当多的版权诉讼...你不能简单地向公众发布通知说我们要使用每个人的作品,除非你告诉我们不要这样做。版权法不是这样运作的。"

波士顿大学研究媒体操纵的Joan Donovan教授也警告:

"当恶意的人拿到这样的工具时,他们会用它来进行仇恨、骚扰和煽动。"

专家们看得很清楚,但问题是,等诉讼真正开始的时候,Sora可能已经改变整个行业了。

硅谷的老套路

说白了,这就是硅谷那套"先污染,后治理"的经典玩法:

先把产品推出去,占领市场;

出了问题再道歉,说我们会改进;

等大家习惯了,就变成既定事实了。

Facebook隐私问题是这样处理的,Uber劳工问题是这样处理的,现在OpenAI版权问题也是这样处理的。

只不过这次污染的是整个信息生态系统...

而且时间窗口很关键。现在的法律完全跟不上技术发展的速度!版权法、肖像权法这些工业时代的法律,面对AI算法简直就是小学生遇到大学题。

OpenAI就是吃准了这一点,在监管政策出台之前,疯狂圈地。等法律追上来的时候,他们已经通过网络效应建立了护城河。

这招确实高,但也确实缺德。

用户也有锅

不过说实话,普通用户也有责任。

大部分人根本不关心什么版权不版权的,只要能生成好玩的视频就行。刷到海绵宝宝跟皮卡丘同框的视频,第一反应是"哇,AI太牛了!"而不是"这侵权了吧?"

这种集体无意识其实是在纵容这些科技公司的掠夺行为。

我们一边享受着"免费"的AI服务,一边对背后的代价视而不见。等到有一天发现自己的作品也被AI学习和模仿时,再去抗议可能就晚了。

监管在哪里?

最气人的是监管的缺失。

George Washington University的David Karpf教授看了Sora上的内容后直接开骂:

"护栏根本不存在...在2022年,科技公司还会大肆宣传他们在招聘内容审核员...到了2025年,科技公司已经决定他们不在乎了。"

确实,内容审核呢?AI安全措施呢?都去哪了?

华盛顿邮报的记者甚至成功生成了Sam Altman本人扮演二战军官的视频,还有各种"愤怒诱饵、虚假犯罪和女性被白色液体溅到"的内容。

这些都能通过审核?OpenAI的安全团队是在摸鱼吗?

竞争对手在看戏

更有意思的是,Meta、Google这些竞争对手现在肯定在旁边看戏。

他们也在开发类似的文本生成视频技术,但看到OpenAI这次翻车,估计心里都在想:"感谢友商帮我们踩雷。"

现在他们可以学习OpenAI的教训,在版权处理上做得更谨慎一些,说不定还能借此抢占道德高地。

毕竟消费者和创作者现在对这种"先侵权后分成"的模式已经有意见了。

我们要什么样的AI?

最后想问大家一个问题:我们到底要什么样的AI未来?

是要那种"快速增长,代价自负"的硅谷模式?还是要那种"负责任发展,造福社会"的可持续模式?

真正的创新应该是解决问题的,而不是制造问题的。当一项技术需要以牺牲版权保护、信息真实性和社会信任为代价时,我们真的应该好好想想:这值得吗?

技术进步当然是好事,但不应该建立在对他人权益的践踏之上。

写在最后

Sora的技术确实厉害,我不否认。1分钟免费生成逼真AI视频,这在几年前想都不敢想。

但是这种发布方式和后续处理,真的让人失望。

OpenAI从ChatGPT开始就一直标榜自己是"负责任的AI公司",结果现在干的事情跟那些只顾赚钱的资本家有什么区别?

技术可以是中性的,但掌握技术的人不是。

当利润成为唯一目标的时候,任何技术都可能变成社会的祸害。Sora这次的表现,算是彻底撕掉了OpenAI"负责任AI"的遮羞布。

现在问题是:我们是装作看不见,继续享受这些"免费"的AI服务,还是要求他们真正负起责任?

答案其实很明显。只是需要更多人意识到这个问题,并且愿意为改变而行动。

毕竟,

我们今天对技术公司的纵容,

就是明天被技术绑架的开始。

更多内容

往期推荐

提供线索及合作,请在后台回复“合作”

声明:此公号(ID:TechVortex)发布内容和图片的目的在于传播更多信息,版权归原作者所有,不为商业用途,如有侵犯,敬请作者与我们联系。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-10-06,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录