DecoyDB:革新蛋白-配体结合亲和力预测的数据集与框架

DecoyDB:革新蛋白-配体结合亲和力预测的数据集与框架

MindDance

发布于 2026-01-08 12:56:31

发布于 2026-01-08 12:56:31

DecoyDB: A Dataset for Graph Contrastive Learning in Protein-Ligand Binding Affinity Prediction

期刊: arxiv 链接: https://arxiv.org/abs/2507.06366 代码: https://github.com/spatialdatasciencegroup/DecoyDB 简介: 该论文针对蛋白质 - 配体结合亲和力预测中高质量标记数据稀缺的问题,提出了大型结构感知数据集 DecoyDB 及定制化图对比学习框架,创新点在于通过计算生成的诱饵构象构建正负样本对并利用其 RMSD 值优化对比损失。方法上,DecoyDB 包含高分辨率天然复合物和大量带 RMSD 标注的诱饵构象,框架结合双类别图对比损失(考虑不同类型负样本)和去噪分数匹配正则化进行预训练。实验使用 PDBbind 等数据集,结果显示基于 DecoyDB 预训练的模型在预测精度、样本效率和泛化能力上均优于基线模型,尤其在小样本场景下提升显著。该研究为蛋白质 - 配体结合亲和力预测提供了新的数据集和方法,有助于推动药物发现相关研究。

近期arxiv上发布的《DecoyDB: A Dataset for Graph Contrastive Learning in Protein-Ligand Binding Affinity Prediction》一文,在解决小样本约束下的亲和力预测难题方面展现出突破性价值。该研究不仅构建了目前规模最大的蛋白-配体自监督学习数据集,更提出了适配分子结构特性的图对比学习框架,为基于深度学习的药物发现研究提供了全新范式。

研究背景:小样本困境与自监督学习的破局潜力

蛋白-配体结合亲和力预测是计算机辅助药物设计的核心环节,直接影响虚拟筛选与先导化合物优化的效率。传统方法中,分子力学(如MM/PBSA)与自由能计算(如FEP)虽精度较高,但计算成本使其难以应用于大规模筛选。近年来,基于3D卷积神经网络(CNN)和图神经网络(GNN)的深度学习方法逐渐成为主流,但其性能受限于标注数据的稀缺性。

目前应用最广泛的PDBbind数据集仅包含约2万个带亲和力标签的复合物,且这类实验标签的获取耗时费力,规模难以快速扩张。与之形成鲜明对比的是,PDB等结构数据库中存在超过17万个未标注的蛋白-配体复合物,这些数据蕴含的结构相互作用信息尚未被充分利用。

自监督学习通过海量无标签数据预训练模型,再结合少量标注数据微调的范式,为解决这一矛盾提供了可能。其中,图对比学习(GCL)在分子数据领域展现出独特优势,但现有研究面临两大挑战:一是缺乏定义清晰的正负样本对数据集;二是通用GCL的扰动方法(如节点/边删除)可能破坏分子的物理化学约束,生成非真实构象。DecoyDB的提出正是为了填补这一空白。

DecoyDB数据集:结构感知的大规模自监督学习资源

数据集构建策略

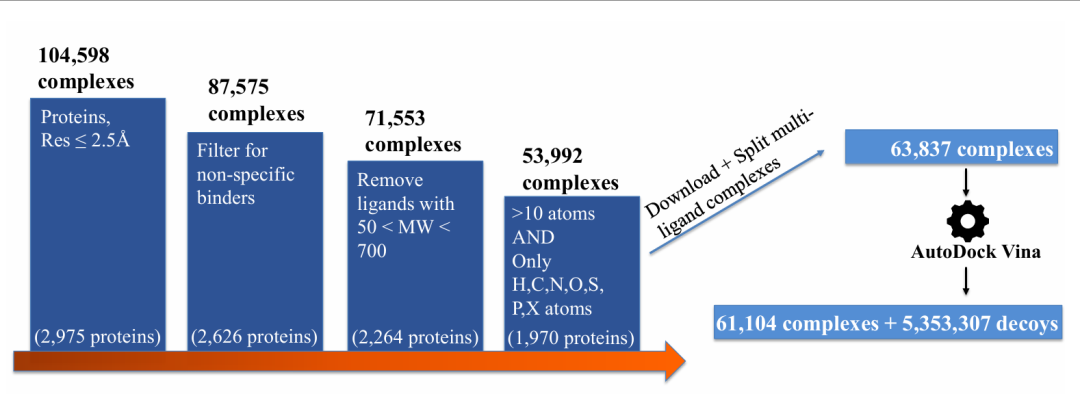

DecoyDB的构建遵循严格的质量控制与多样性设计原则,具体流程包括:

- 1. 核心复合物筛选:从PDB数据库中筛选出61,104个高分辨率(≤2.5Å)的X射线晶体结构,排除了分子量不在50-700范围内、含金属簇或稀有元素的配体,并仅保留与配体距离≤10Å的蛋白质链,确保捕捉关键相互作用区域。

- 2. 诱饵构象生成:采用AutoDock Vina对每个核心复合物进行虚拟对接,在配体周围设置5Å缓冲的网格盒,生成100个构象(exhaustiveness=8),最终获得5,353,307个高质量诱饵结构,平均每个复合物对应88个诱饵。

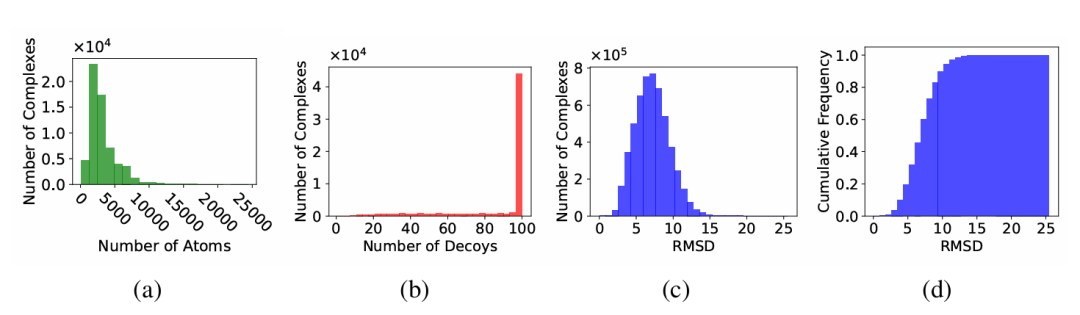

- 3. 结构标注体系:每个诱饵均标注与天然构象的Root Mean Squared Deviation(RMSD),范围从0.03Å到25.56Å(均值7.22Å),形成从近天然(RMSD≤2Å,正样本)到非天然(RMSD>2Å,负样本)的连续分布。

DecoyDB 的数据构建流程。

DecoyDB 的数据构建流程。

数据集优势与创新点

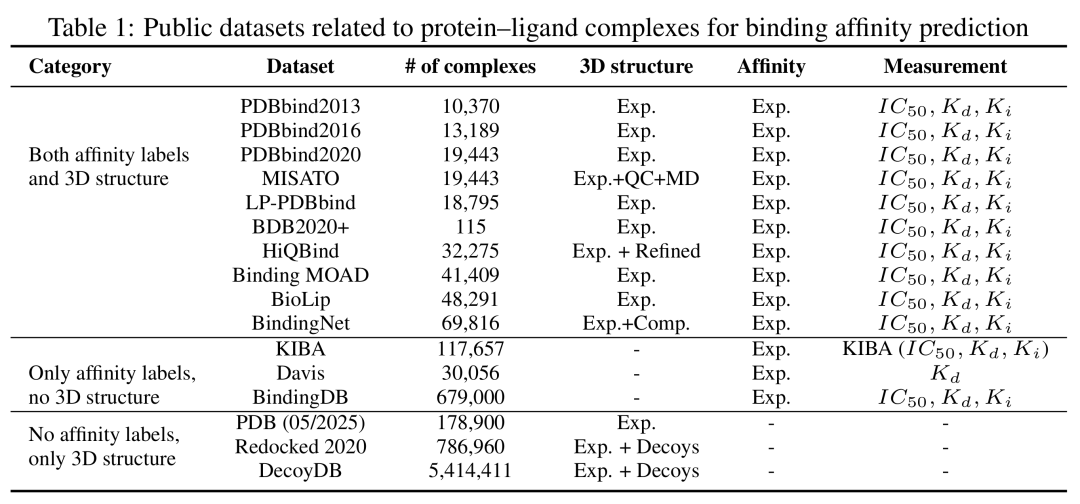

与蛋白质 - 配体复合物结合亲和力预测相关的公共数据集。

与蛋白质 - 配体复合物结合亲和力预测相关的公共数据集。

相较于现有资源,DecoyDB的核心优势体现在:

- • 规模与多样性:总规模达541万(6万+核心复合物+535万诱饵),远超同类数据集(如Redocked2020的78万构象),且RMSD分布连续,覆盖从近天然到完全偏离的构象空间。

- • 避免数据泄露:核心复合物主要来自PDB而非PDBbind,与常用微调数据集的重叠率极低,为验证模型泛化能力提供了纯净的测试环境。

- • 结构-功能关联:通过RMSD量化构象偏离程度,将结构特征与结合能(天然构象对应能量最低态)建立关联,为自监督学习提供了物理意义明确的监督信号。

DecoyDB 的统计分析。(a)每个蛋白质 - 配体复合物的原子数量分布;(b)每个复合物的诱饵数量分布;(c)诱饵复合物的 RMSD 值分布;(d)诱饵复合物的 RMSD 值累积分布。

DecoyDB 的统计分析。(a)每个蛋白质 - 配体复合物的原子数量分布;(b)每个复合物的诱饵数量分布;(c)诱饵复合物的 RMSD 值分布;(d)诱饵复合物的 RMSD 值累积分布。

定制化图对比学习框架

基于DecoyDB的特性,研究者设计了适配蛋白-配体系统的自监督学习框架,核心包括双类别对比损失与去噪正则化模块。

双类别图对比损失

传统GCL采用单一负样本策略,而该框架创新性地设计了两类负样本:

- 1. 同复合物诱饵负样本:来自同一核心复合物的诱饵构象,根据RMSD赋予权重(β = α·RMSD/RMSD_max),使偏离越大的构象权重越高,强化模型对细微结构差异的识别。

- 2. 异复合物负样本:来自不同核心复合物的结构,采用固定权重(β=1),确保模型学习跨复合物的结构差异。

最终损失函数通过InfoNCE形式整合正负样本对,公式如下:

其中z为GNN编码器输出的嵌入向量,τ为温度参数,m为每个锚点的正样本数。

去噪分数匹配正则化

为使模型学习能量最低构象的特征,框架引入去噪分数匹配(DSM)正则化:

- 1. 对配体原子坐标添加高斯噪声(x' = x + ε,ε~N(0,σ²))生成扰动结构;

- 2. 定义损失函数促使模型从扰动结构恢复天然构象:

最终总损失为L = L₁ + μL₂,其中μ为平衡系数。

实验验证:性能提升与泛化能力分析

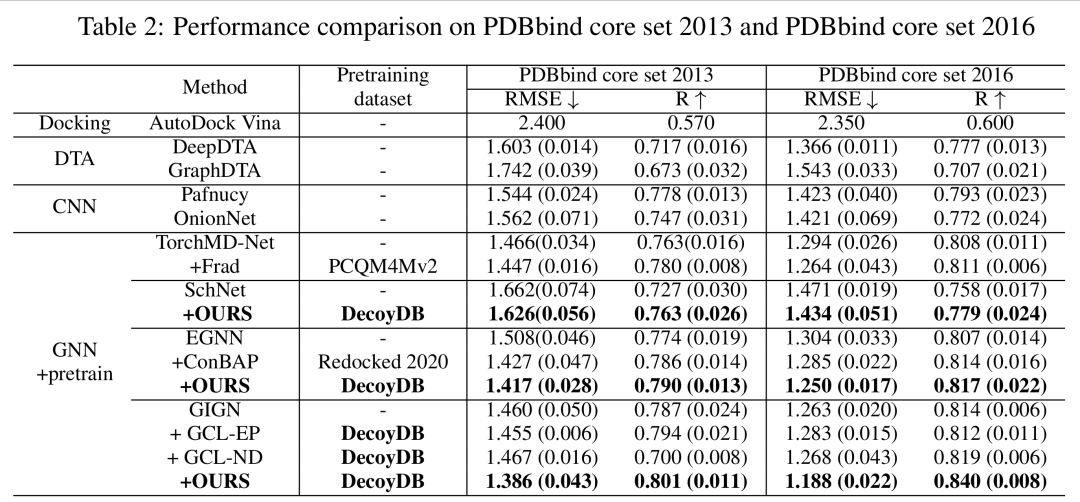

在两个数据集上,该框架与基线模型的详细性能比较。

在两个数据集上,该框架与基线模型的详细性能比较。

研究团队在多个基准数据集上验证了框架的有效性,关键发现包括:

预测精度提升

在PDBbind2013核心集(107个复合物)和2016核心集(285个复合物)上,采用GIGN作为基础模型时:

- • 预训练后RMSE分别从1.460降至1.386(2013)和1.263降至1.188(2016);

- • 相较同类方法(如ConBAP),在EGNN模型上的RMSE降低更显著(1.304→1.250)。

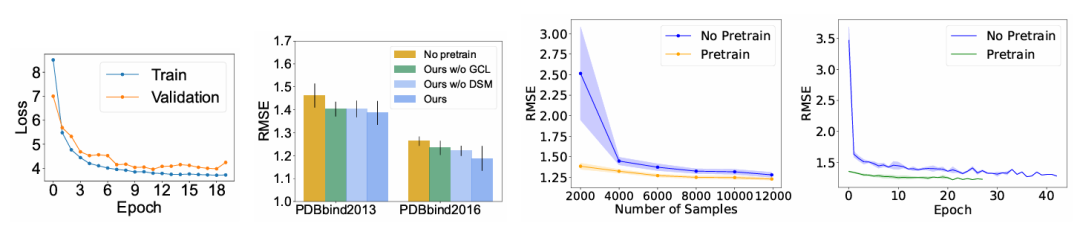

样本效率提升

在微调阶段改变标注样本量(2k-12k)的实验显示:

- • 预训练模型在所有样本量下均优于无预训练模型,尤其在小样本(2k)时优势最大(RMSE降低0.3+);

- • 收敛速度提升一倍(约20轮vs40轮)。

泛化能力增强

在 leakage-proof 的LP-PDBbind数据集(4651个测试样本)上:

- • 预训练模型RMSE从1.496降至1.371,远优于随机划分数据集上的提升(1.294→1.269),证明其有效克服了数据重叠导致的虚假性能。

消融实验结论

- • 双类别负样本策略优于单一类别(仅异复合物),2016核心集RMSE从1.246降至1.221;

- • 去除GCL或DSM模块均导致性能下降,证明两者协同作用的必要性。

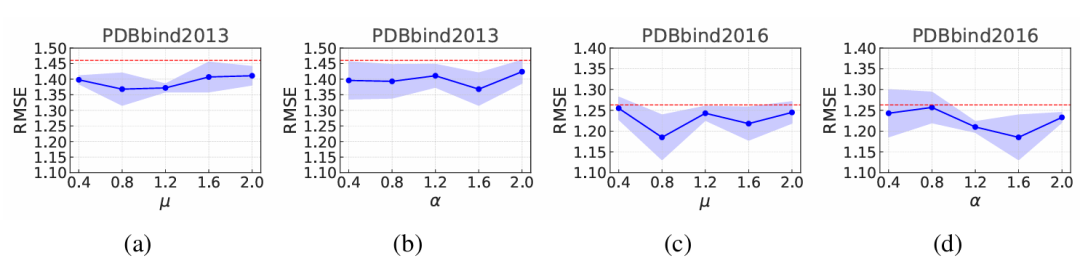

损失函数中两个关键超参数 α 和 μ 的敏感性分析。(a)和(c)显示在两个数据集(PDBbind2013 和 PDBbind2016)上不同 μ 值的 RMSE 性能;(b)和(d)显示在相同两个数据集上不同 α 值的 RMSE 变化。红色虚线表示基线 GIGN 模型。

损失函数中两个关键超参数 α 和 μ 的敏感性分析。(a)和(c)显示在两个数据集(PDBbind2013 和 PDBbind2016)上不同 μ 值的 RMSE 性能;(b)和(d)显示在相同两个数据集上不同 α 值的 RMSE 变化。红色虚线表示基线 GIGN 模型。

(a)预训练期间的训练和验证损失曲线;(b)消融研究;(c)微调数据集大小对结合亲和力预测的影响;(d)微调中的验证曲线。

(a)预训练期间的训练和验证损失曲线;(b)消融研究;(c)微调数据集大小对结合亲和力预测的影响;(d)微调中的验证曲线。

研究意义与未来方向

DecoyDB的提出首次实现了蛋白-配体复合物的大规模自监督预训练,其创新点在于:

- 1. 数据层面:构建了结构标注精细、无泄露风险的数据集,为自监督学习提供高质量素材;

- 2. 方法层面:设计了适配分子特性的对比学习策略,避免传统扰动方法的物理化学约束破坏;

- 3. 应用层面:显著提升了模型在小样本场景的性能,降低对实验标注的依赖。

未来研究可拓展至结合构象预测、药物分子生成等任务,而DecoyDB开源资源(https://github.com/spatialdatasciencegroup/DecoyDB)的释放,将推动该领域的快速发展。对于从事计算药物设计的研究者而言,这一工作不仅提供了强大的工具,更启发了"利用计算生成数据赋能小样本学习"的新研究思路。

(●'◡'●) 需要进一步讨论的同学欢迎留言交流!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录