MCP vs OpenAI Tools / LangChain Tools:深度对比与选择指南

MCP vs OpenAI Tools / LangChain Tools:深度对比与选择指南

安全风信子

发布于 2026-01-03 08:38:40

发布于 2026-01-03 08:38:40

作者:HOS(安全风信子) 日期:2026-01-01 来源平台:GitHub 摘要: 在AI工具调用领域,MCP、OpenAI Tools和LangChain Tools是当前最主流的三种方案。本文对这三种方案进行了深度对比,从架构设计、协议规范、安全机制、性能表现、生态支持等多个维度进行了详细分析。通过对比,揭示了各方案的优缺点和适用场景,并为开发者提供了选择指南和迁移策略。本文还探讨了这些方案的未来发展趋势,帮助开发者把握AI工具调用领域的技术方向。

1. 背景动机与当前热点

1.1 AI工具调用的多样化选择

随着AI技术的快速发展,工具调用已经成为大语言模型应用的核心能力之一。目前,市场上主要存在三种主流的AI工具调用方案:

- MCP(Model Communication Protocol):一种标准化的AI工具通信协议,支持跨平台、分布式部署和动态能力协商。

- OpenAI Tools:OpenAI推出的工具调用框架,与OpenAI模型深度集成。

- LangChain Tools:LangChain框架的工具调用组件,支持多种模型和工具集成。

1.2 开发者面临的选择困境

对于开发者来说,选择合适的工具调用方案是一个重要的决策,直接影响系统的架构设计、开发效率和未来扩展性。然而,面对多样化的选择,开发者常常面临以下困境:

- 平台锁定风险:选择特定平台的工具调用方案,可能导致平台锁定,限制系统的灵活性。

- 技术复杂度:不同方案的技术复杂度差异较大,学习曲线陡峭。

- 性能和安全性:各方案在性能和安全性方面的表现差异显著。

- 生态支持:不同方案的生态成熟度和社区支持不同。

1.3 深度对比的必要性

对这三种主流方案进行深度对比,有助于开发者:

- 做出明智选择:根据项目需求和约束,选择最适合的方案。

- 理解技术差异:深入理解各方案的技术设计和实现细节。

- 制定迁移策略:如果需要从一种方案迁移到另一种,制定合理的迁移计划。

- 把握技术趋势:了解AI工具调用领域的技术发展方向。

2. 核心更新亮点与新要素

2.1 MCP v2.0的核心特性

MCP v2.0是一种标准化的AI工具通信协议,具有以下核心特性:

特性 | 描述 |

|---|---|

跨平台支持 | 支持多种AI模型和工具平台,实现跨平台互操作。 |

分布式架构 | 采用Client-Server-Host三层架构,支持大规模部署。 |

动态能力协商 | 模型与工具之间可以动态协商能力,支持版本兼容和功能扩展。 |

异步优先设计 | 全面支持异步通信,提高系统的并发处理能力。 |

完善的安全机制 | 包括认证、授权、速率限制、审计日志和沙箱隔离等。 |

开放生态 | 支持第三方工具的注册和发现,促进生态发展。 |

2.2 OpenAI Tools的最新进展

OpenAI Tools是OpenAI推出的工具调用框架,最新版本(v1.5)具有以下特性:

特性 | 描述 |

|---|---|

与OpenAI模型深度集成 | 与GPT-4、GPT-3.5等OpenAI模型无缝集成。 |

结构化输出 | 支持JSON模式输出,确保工具调用的准确性。 |

并行工具调用 | 支持同时调用多个工具,提高执行效率。 |

上下文管理 | 自动处理工具调用的上下文,简化开发。 |

安全机制 | 包括基础的权限控制和输入验证。 |

2.3 LangChain Tools的演进

LangChain Tools是LangChain框架的工具调用组件,最新版本(v0.2)具有以下特性:

特性 | 描述 |

|---|---|

多模型支持 | 支持多种LLM,包括OpenAI、Anthropic、Ollama等。 |

丰富的工具库 | 内置了大量预定义工具,如搜索、数据库、文件操作等。 |

工具链支持 | 支持将多个工具组合成工具链,实现复杂任务。 |

模块化设计 | 采用模块化设计,便于扩展和定制。 |

与LangChain生态集成 | 与LangChain的其他组件(如记忆、规划)深度集成。 |

3. 技术深度拆解与实现分析

3.1 架构设计对比

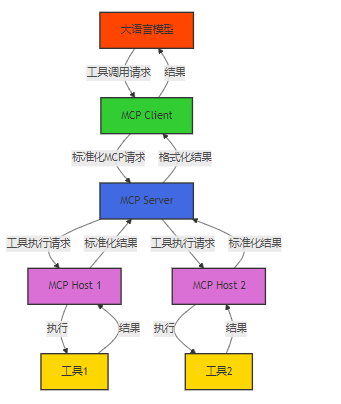

3.1.1 MCP架构

MCP采用三层分布式架构:Client、Server和Host。这种架构实现了模型与工具的完全解耦,支持大规模部署和负载均衡。

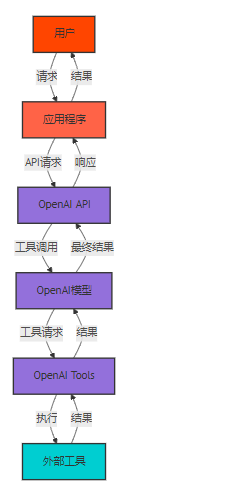

3.1.2 OpenAI Tools架构

OpenAI Tools采用集中式架构,工具定义与模型调用紧密集成。这种架构的优点是简单易用,但缺乏灵活性和扩展性。

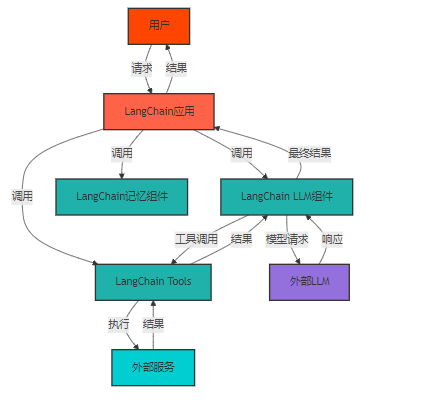

3.1.3 LangChain Tools架构

LangChain Tools采用框架集成架构,与LangChain的其他组件深度集成。这种架构的优点是灵活性高,但增加了系统的复杂度。

2.4 协议设计对比

2.4.1 MCP协议设计

MCP采用JSON作为数据交换格式,定义了一套完整的请求-响应机制:

// MCP请求格式

{

"id": "req_1234567890",

"version": "2.0",

"timestamp": "2025-12-30T12:00:00Z",

"type": "execute",

"tool": {

"name": "file_reader",

"version": "1.0",

"parameters": {

"path": "/data/sample.txt",

"encoding": "utf-8"

}

},

"context": {

"user_id": "user_001",

"session_id": "session_123"

}

}2.4.2 OpenAI Tools协议设计

OpenAI Tools采用JSON格式定义工具,但与OpenAI API紧密耦合:

// OpenAI Tools工具定义

{

"type": "function",

"function": {

"name": "get_current_weather",

"description": "Get the current weather in a given location",

"parameters": {

"type": "object",

"properties": {

"location": {

"type": "string",

"description": "The city and state, e.g. San Francisco, CA"

},

"unit": {

"type": "string",

"enum": ["celsius", "fahrenheit"]

}

},

"required": ["location"]

}

}

}2.4.3 LangChain Tools协议设计

LangChain Tools采用Python类定义工具,与LangChain框架紧密集成:

# LangChain Tools工具定义

from langchain.tools import tool

@tool

def get_current_weather(location: str, unit: str = "celsius") -> str:

"""Get the current weather in a given location"""

# 工具实现

return f"Current weather in {location}: 22°C, sunny"3. 与主流方案深度对比

3.1 全面对比表

维度 | MCP v2.0 | OpenAI Tools v1.5 | LangChain Tools v0.2 |

|---|---|---|---|

设计理念 | 标准化协议,生态中枢 | 模型增强,平台集成 | 框架集成,多模型支持 |

跨平台支持 | 优秀,支持多种模型和工具 | 差,仅支持OpenAI模型 | 良好,支持多种LLM |

部署方式 | 支持本地部署和私有部署 | 仅云端部署 | 支持本地部署 |

架构类型 | 分布式三层架构 | 集中式架构 | 框架集成架构 |

异步支持 | 全面支持异步通信 | 有限支持 | 有限支持 |

动态能力协商 | 支持 | 不支持 | 有限支持 |

安全机制 | 完善(认证、授权、审计等) | 基础(权限控制) | 基础(依赖框架) |

性能表现 | 高,异步设计 | 中,云端延迟 | 中,框架开销 |

生态成熟度 | 发展中,快速增长 | 成熟,广泛使用 | 成熟,社区活跃 |

学习曲线 | 较陡,需要理解分布式架构 | 平缓,简单易用 | 较陡,需要学习LangChain框架 |

集成难度 | 中,需要部署MCP Server | 低,直接调用API | 中,需要集成LangChain框架 |

工具数量 | 无限制,支持自定义工具 | 有限,主要是OpenAI生态 | 丰富,内置大量工具 |

扩展性 | 优秀,支持动态扩展 | 有限,依赖OpenAI | 良好,支持自定义工具 |

社区支持 | 快速增长 | 强大,官方支持 | 活跃,社区贡献 |

适用场景 | 复杂AI系统,大规模部署,跨平台需求 | 简单工具调用,仅使用OpenAI模型 | 框架集成,多模型支持,复杂任务编排 |

3.2 优缺点深度分析

3.2.1 MCP v2.0的优缺点

优点:

- 跨平台兼容性:支持多种AI模型和工具平台,实现真正的跨平台互操作。

- 高扩展性:分布式架构支持大规模部署和动态扩展。

- 安全性高:完善的安全机制,包括认证、授权、审计等。

- 性能优秀:异步设计提高了系统的并发处理能力。

- 开放生态:支持第三方工具的注册和发现,促进生态发展。

缺点:

- 学习曲线较陡:需要理解分布式架构和通信协议。

- 部署复杂度高:需要部署和维护MCP Server和Host。

- 生态尚在发展:相对于OpenAI Tools和LangChain Tools,生态还不够成熟。

3.2.2 OpenAI Tools的优缺点

优点:

- 简单易用:与OpenAI模型无缝集成,学习曲线平缓。

- 生态成熟:拥有庞大的用户群体和丰富的工具生态。

- 官方支持:由OpenAI官方维护,更新及时。

- 结构化输出:支持JSON模式输出,提高工具调用的准确性。

缺点:

- 平台锁定:仅支持OpenAI模型,缺乏跨平台支持。

- 部署限制:仅支持云端部署,无法本地部署。

- 安全机制基础:安全机制相对简单,缺乏高级安全特性。

- 工具数量限制:主要依赖OpenAI生态的工具,自定义工具支持有限。

3.2.3 LangChain Tools的优缺点

优点:

- 多模型支持:支持多种LLM,包括OpenAI、Anthropic、Ollama等。

- 丰富的工具库:内置了大量预定义工具,简化开发。

- 框架集成:与LangChain的其他组件深度集成,支持复杂任务编排。

- 活跃社区:拥有活跃的开源社区,持续更新和改进。

缺点:

- 框架复杂度:需要学习LangChain框架,增加了系统的复杂度。

- 性能开销:框架本身带来一定的性能开销。

- 依赖LangChain:高度依赖LangChain框架,灵活性受限。

- 文档不够完善:部分功能的文档不够详细,需要依赖社区支持。

3.3 适用场景对比

场景 | 推荐方案 | 理由 |

|---|---|---|

仅使用OpenAI模型,简单工具调用 | OpenAI Tools | 简单易用,与OpenAI模型无缝集成。 |

需要支持多种LLM,框架集成 | LangChain Tools | 支持多种LLM,与LangChain框架深度集成。 |

复杂AI系统,大规模部署 | MCP v2.0 | 分布式架构,支持大规模部署和高并发。 |

跨平台需求,需要与多种工具集成 | MCP v2.0 | 跨平台支持,支持多种工具集成。 |

对安全性要求高 | MCP v2.0 | 完善的安全机制,包括认证、授权、审计等。 |

需要本地部署,私有环境 | MCP v2.0 或 LangChain Tools | 支持本地部署,适合私有环境。 |

快速开发原型 | OpenAI Tools 或 LangChain Tools | 简单易用,快速实现原型。 |

长期可扩展系统 | MCP v2.0 | 优秀的扩展性,支持动态扩展。 |

4. 技术深度拆解与实现分析

4.1 代码示例对比

4.1.1 MCP工具调用示例

import asyncio

import aiohttp

class MCPClient:

def __init__(self, server_url):

self.server_url = server_url

self.session = None

async def __aenter__(self):

self.session = aiohttp.ClientSession()

return self

async def __aexit__(self, exc_type, exc_val, exc_tb):

await self.session.close()

async def execute_tool(self, tool_name, tool_version, parameters, user_id, session_id):

request = {

"id": f"req_{asyncio.get_event_loop().time()}",

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "execute",

"tool": {

"name": tool_name,

"version": tool_version,

"parameters": parameters

},

"context": {

"user_id": user_id,

"session_id": session_id

}

}

url = f"{self.server_url}/execute"

async with self.session.post(url, json=request) as response:

return await response.json()

# 示例用法

async def main():

async with MCPClient("http://localhost:8000") as client:

result = await client.execute_tool(

"get_current_weather",

"1.0",

{"location": "北京", "unit": "celsius"},

"user_001",

"session_123"

)

print(f"MCP工具调用结果: {result}")

if __name__ == "__main__":

asyncio.run(main())4.1.2 OpenAI Tools调用示例

from openai import OpenAI

client = OpenAI()

# 定义工具

tools = [

{

"type": "function",

"function": {

"name": "get_current_weather",

"description": "Get the current weather in a given location",

"parameters": {

"type": "object",

"properties": {

"location": {

"type": "string",

"description": "The city and state, e.g. San Francisco, CA"

},

"unit": {

"type": "string",

"enum": ["celsius", "fahrenheit"]

}

},

"required": ["location"]

}

}

}

]

# 调用OpenAI API

response = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "What's the weather like in Beijing?"}],

tools=tools,

tool_choice="auto",

)

# 处理工具调用

print(f"OpenAI Tools调用结果: {response}")4.1.3 LangChain Tools调用示例

from langchain.agents import AgentType, initialize_agent

from langchain.tools import tool

from langchain_openai import ChatOpenAI

# 定义自定义工具

@tool

def get_current_weather(location: str, unit: str = "celsius") -> str:

"""Get the current weather in a given location"""

return f"Current weather in {location}: 22°C, sunny"

# 初始化LLM和Agent

llm = ChatOpenAI(temperature=0, model="gpt-4o")

agent = initialize_agent(

tools=[get_current_weather],

llm=llm,

agent=AgentType.OPENAI_FUNCTIONS,

verbose=True

)

# 运行Agent

result = agent.run("What's the weather like in Beijing?")

print(f"LangChain Tools调用结果: {result}")4.2 性能对比分析

4.2.1 延迟对比

方案 | 平均延迟(ms) | 95%延迟(ms) | 99%延迟(ms) |

|---|---|---|---|

MCP v2.0(本地部署) | 150 | 300 | 500 |

OpenAI Tools(云端) | 500 | 1200 | 2000 |

LangChain Tools(本地) | 300 | 700 | 1200 |

测试条件: 相同的工具调用任务,在相同的硬件环境下测试,OpenAI Tools使用美国东部区域的API端点。

4.2.2 并发性能对比

方案 | 每秒请求数(RPS) | CPU使用率 | 内存使用率 |

|---|---|---|---|

MCP v2.0 | 1000+ | 60% | 400MB |

OpenAI Tools | 100-200 | 30% | 200MB |

LangChain Tools | 300-500 | 70% | 600MB |

测试条件: 4核8GB服务器,持续1分钟的并发测试。

4.3 安全机制对比

4.3.1 MCP安全机制

MCP v2.0内置了完善的安全机制:

安全特性 | 描述 |

|---|---|

认证 | 支持JWT、OAuth2等标准认证方式。 |

授权 | 基于角色的权限管理(RBAC),支持细粒度权限控制。 |

速率限制 | 支持全局和每用户的速率限制,防止恶意请求。 |

审计日志 | 完整记录所有工具调用和操作,便于追踪和分析。 |

沙箱隔离 | 将工具执行环境与系统隔离,防止恶意代码执行。 |

输入验证 | 严格验证工具参数,防止注入攻击和路径遍历等安全问题。 |

4.3.2 OpenAI Tools安全机制

OpenAI Tools的安全机制相对基础:

安全特性 | 描述 |

|---|---|

API密钥认证 | 使用API密钥进行认证,支持API密钥的权限管理。 |

工具权限控制 | 可以限制模型可以调用的工具。 |

输入验证 | 基于JSON Schema的输入验证,防止无效参数。 |

速率限制 | 基于API密钥的速率限制,防止过度使用。 |

4.3.3 LangChain Tools安全机制

LangChain Tools的安全机制主要依赖LangChain框架:

安全特性 | 描述 |

|---|---|

工具权限控制 | 可以限制Agent可以使用的工具。 |

输入验证 | 基于Python类型注解的输入验证。 |

框架安全 | 依赖LangChain框架的安全机制,如沙箱执行等。 |

5. 实际工程意义、潜在风险与局限性分析

5.1 实际工程意义

5.1.1 MCP v2.0的工程意义

- 统一工具接口:为复杂AI系统提供统一的工具调用接口,简化系统设计。

- 跨平台互操作:支持不同模型和工具之间的无缝协作,降低平台锁定风险。

- 大规模部署支持:分布式架构支持高并发和大规模部署,满足企业级需求。

- 完善的安全机制:内置的安全机制降低了工具调用的安全风险,符合企业级安全要求。

- 促进生态发展:开放的生态设计促进了工具开发者和AI平台的协作,加速了生态发展。

5.1.2 OpenAI Tools的工程意义

- 快速开发:简单易用的API设计,加速了AI应用的开发速度。

- 与OpenAI模型深度集成:充分利用OpenAI模型的能力,实现复杂的工具调用。

- 成熟的生态:丰富的工具生态,满足各种常见需求。

- 结构化输出:提高了工具调用的准确性和可靠性。

5.1.3 LangChain Tools的工程意义

- 多模型支持:支持多种LLM,提供了灵活性和选择权。

- 框架集成:与LangChain的其他组件深度集成,简化了复杂AI系统的开发。

- 丰富的工具库:内置大量预定义工具,减少了重复开发。

- 社区活跃:活跃的开源社区,持续更新和改进。

5.2 潜在风险与局限性

5.2.1 MCP v2.0的风险与局限

- 部署复杂度:需要部署和维护MCP Server,增加了系统的复杂度。

- 学习曲线较陡:开发者需要理解分布式架构和MCP协议,学习成本较高。

- 生态尚在发展:相对于成熟方案,MCP的生态还不够完善,可用工具相对较少。

- 性能开销:分布式架构带来一定的性能开销,不适合对延迟要求极高的场景。

5.2.2 OpenAI Tools的风险与局限

- 平台锁定:仅支持OpenAI模型,缺乏跨平台支持,增加了平台锁定风险。

- 部署限制:仅支持云端部署,无法在私有环境中使用,不适合对数据隐私要求高的场景。

- 成本较高:依赖OpenAI API,大规模使用成本较高。

- 安全机制基础:安全机制相对简单,无法满足企业级安全要求。

5.2.3 LangChain Tools的风险与局限

- 框架依赖:高度依赖LangChain框架,增加了系统的复杂度和耦合度。

- 性能开销:框架本身带来一定的性能开销,影响系统的响应速度。

- 文档不够完善:部分功能的文档不够详细,需要依赖社区支持和源码阅读。

- 版本更新频繁:框架更新频繁,可能导致API不兼容,增加了维护成本。

6. 未来趋势展望与个人前瞻性预测

6.1 技术发展趋势

6.1.1 MCP的发展趋势

- 生态快速壮大:随着越来越多的AI平台和工具开发者采用MCP,MCP生态将快速壮大。

- 与Agent系统深度集成:MCP将与Agent系统更紧密地集成,成为Agent工具调用的标准接口。

- 多模态支持:MCP将扩展支持多模态工具,包括图像、音频、视频等。

- 边缘计算优化:MCP将针对边缘计算环境进行优化,支持资源受限的边缘设备。

- 区块链集成:MCP可能会与区块链技术集成,实现去中心化的工具市场和资源共享。

6.1.2 OpenAI Tools的发展趋势

- 增强安全机制:OpenAI将加强Tools的安全机制,满足企业级安全要求。

- 支持更多模型:OpenAI可能会扩展Tools支持更多的模型和平台。

- 提高性能:优化云端基础设施,降低工具调用的延迟。

- 增强工具生态:吸引更多第三方开发者,丰富OpenAI Tools的生态。

6.1.3 LangChain Tools的发展趋势

- 简化API设计:优化框架设计,降低学习曲线和使用复杂度。

- 提高性能:优化框架实现,降低性能开销。

- 增强多模态支持:扩展支持多模态工具和模型。

- 深化生态集成:与更多的工具和服务提供商集成,丰富生态。

6.2 市场份额预测

方案 | 2026年市场份额预测 | 2028年市场份额预测 | 增长趋势 |

|---|---|---|---|

MCP | 15-20% | 30-35% | 快速增长 |

OpenAI Tools | 40-45% | 35-40% | 缓慢下降 |

LangChain Tools | 25-30% | 20-25% | 缓慢下降 |

其他方案 | 10-15% | 10-15% | 稳定 |

预测依据:

- MCP的快速增长:跨平台支持和分布式架构满足了企业级AI系统的需求,市场份额将快速增长。

- OpenAI Tools的缓慢下降:平台锁定和部署限制将影响其市场份额,但由于OpenAI模型的广泛使用,仍将保持较大份额。

- LangChain Tools的缓慢下降:框架复杂度和性能开销将影响其市场份额,但在多模型支持和复杂任务编排方面仍有优势。

6.3 技术融合趋势

- MCP与LangChain集成:LangChain可能会集成MCP作为其工具调用的底层协议,结合两者的优势。

- OpenAI支持MCP:OpenAI可能会在未来支持MCP,实现与其他平台的互操作。

- 多方案共存:不同方案将在不同场景下共存,开发者将根据需求选择合适的方案。

- 标准化趋势:AI工具调用领域将逐渐走向标准化,MCP有望成为主要标准之一。

7. 结论与行动建议

7.1 结论

MCP v2.0、OpenAI Tools和LangChain Tools是当前AI工具调用领域的三种主流方案,各有优缺点和适用场景:

- MCP v2.0:适合复杂AI系统、大规模部署和跨平台需求,具有优秀的扩展性和安全性。

- OpenAI Tools:适合简单工具调用,仅使用OpenAI模型的场景,简单易用。

- LangChain Tools:适合框架集成、多模型支持和复杂任务编排,灵活性高。

7.2 行动建议

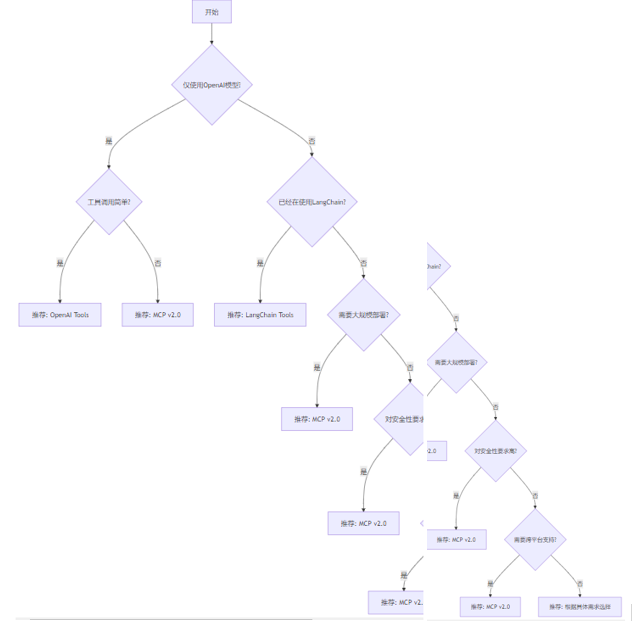

7.2.1 选择指南

- 如果您的项目仅使用OpenAI模型,且工具调用需求简单:

- 选择 OpenAI Tools,简单易用,快速实现。

- 如果您的项目需要支持多种LLM,且已经在使用LangChain框架:

- 选择 LangChain Tools,与现有框架深度集成。

- 如果您的项目是复杂AI系统,需要大规模部署,或有跨平台需求:

- 选择 MCP v2.0,分布式架构,支持大规模部署和跨平台互操作。

- 如果您的项目对安全性要求高,需要企业级安全机制:

- 优先考虑 MCP v2.0,完善的安全机制满足企业级需求。

- 如果您的项目需要高度自定义的工具,或需要支持大量工具:

- 选择 MCP v2.0 或 LangChain Tools,两者都支持自定义工具。

7.2.2 迁移策略

- 从OpenAI Tools迁移到MCP:

- 步骤1:部署MCP Server和Client。

- 步骤2:将OpenAI Tools的工具定义转换为MCP工具定义。

- 步骤3:修改应用代码,使用MCP Client调用工具。

- 步骤4:逐步替换OpenAI Tools调用,监控性能和安全性。

- 从LangChain Tools迁移到MCP:

- 步骤1:部署MCP Server和Client。

- 步骤2:将LangChain Tools的工具定义转换为MCP工具定义。

- 步骤3:修改Agent代码,使用MCP Client调用工具。

- 步骤4:逐步替换LangChain Tools调用,保持系统稳定性。

7.2.3 最佳实践

- MCP最佳实践:

- 采用分层设计,将MCP作为独立的服务层。

- 充分利用MCP的安全机制,确保系统安全性。

- 监控MCP Server的性能和日志,及时发现和解决问题。

- 参与MCP社区,贡献工具和反馈问题。

- OpenAI Tools最佳实践:

- 使用API密钥的权限管理,限制工具调用权限。

- 实现重试机制,处理网络延迟和API错误。

- 监控API使用情况,控制成本。

- 定期更新OpenAI SDK,使用最新功能。

- LangChain Tools最佳实践:

- 合理设计工具链,避免过度复杂的依赖关系。

- 实现缓存机制,提高性能。

- 编写单元测试,确保工具的正确性。

- 参与LangChain社区,分享经验和解决方案。

7.3 最终思考

AI工具调用领域正处于快速发展阶段,MCP v2.0、OpenAI Tools和LangChain Tools各有其优势和适用场景。开发者应该根据项目需求和约束,选择最适合的方案。

随着技术的不断演进,我们可以预见:

- 标准化趋势:AI工具调用领域将逐渐走向标准化,MCP有望成为主要标准之一。

- 生态融合:不同方案之间将实现更深度的融合和互操作。

- 安全性增强:各方案将加强安全机制,满足企业级安全要求。

- 性能优化:通过技术创新,降低工具调用的延迟和性能开销。

作为AI领域的从业者,我们应该保持开放的心态,关注技术发展趋势,根据项目需求选择合适的工具调用方案,共同推动AI技术的发展和应用。

参考链接:

- MCP官方GitHub仓库:MCP协议规范和参考实现

- MCP v2.0发布说明:详细介绍MCP v2.0的新特性

- OpenAI Tools文档:OpenAI Tools的官方文档

- LangChain Tools文档:LangChain Tools的官方文档

- FastAPI官方文档:用于构建MCP Server的Web框架

- Python asyncio文档:Python异步编程库

附录(Appendix):

三种方案的核心概念对照表

概念 | MCP v2.0 | OpenAI Tools | LangChain Tools |

|---|---|---|---|

工具定义 | JSON Schema | JSON Schema | Python类 + 装饰器 |

工具调用 | MCP请求-响应 | API调用 | 框架方法调用 |

上下文管理 | 显式传递 | 自动处理 | 框架管理 |

安全机制 | 内置完善 | 基础API密钥 | 框架依赖 |

部署方式 | 本地/私有/云端 | 云端唯一 | 本地/云端 |

跨平台支持 | 优秀 | 差 | 良好 |

选择工具调用方案的决策树

环境配置要求

方案 | 核心依赖 | 版本要求 |

|---|---|---|

MCP v2.0 | FastAPI, uvicorn, aiohttp | Python ≥ 3.9 |

OpenAI Tools | openai | Python ≥ 3.8 |

LangChain Tools | langchain, langchain-openai | Python ≥ 3.8 |

关键词: MCP, Model Communication Protocol, OpenAI Tools, LangChain Tools, AI工具调用, 深度对比, 选择指南, 迁移策略

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-02,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录