从Function Calling到MCP:AI工具调用的范式级变化

从Function Calling到MCP:AI工具调用的范式级变化

安全风信子

发布于 2026-01-03 08:30:54

发布于 2026-01-03 08:30:54

作者:HOS(安全风信子) 日期:2026-01-01 来源平台:GitHub 摘要: Function Calling曾经是AI工具调用的主流方式,但随着AI应用的复杂化和工具生态的壮大,其局限性日益凸显。MCP(Model Communication Protocol)v2.0的出现,带来了AI工具调用的范式级变化。本文深入分析Function Calling的局限,详解MCP如何通过动态能力协商、分布式架构和生态集成,实现从单一工具调用到AI工具生态中枢的转变。通过对比分析、架构设计和代码实现,揭示MCP如何解决Function Calling的核心痛点,并为未来Agent时代的工具调用奠定基础。

1. 背景动机与当前热点

1.1 Function Calling的兴起与局限

Function Calling自2023年由OpenAI推出以来,迅速成为AI工具调用的主流方式。它允许大语言模型(LLM)根据用户需求,自动调用外部函数获取信息或执行操作。然而,随着AI应用的复杂化和工具生态的壮大,Function Calling的局限性日益凸显:

- 静态绑定:工具定义与模型强绑定,无法动态调整或扩展。

- 平台依赖:不同模型平台采用各自的Function Calling标准,导致生态割裂。

- 安全隐患:缺乏有效的权限管理和审计机制,容易引发越权调用。

- 扩展性差:难以支持大规模工具编排和复杂任务执行。

- 异步能力有限:主要支持同步调用,无法充分利用现代系统的异步处理能力。

1.2 MCP的出现:从协议到生态中枢

MCP(Model Communication Protocol)作为一种标准化的AI工具通信协议,于2025年迎来了重大更新(v2.0)。它不再是简单的工具调用协议,而是正在成为AI工具生态的中枢,连接模型、工具和应用,实现标准化、安全、高效的工具调用。

1.3 范式转变的必要性

AI工具调用正在从单一模型-工具交互,向复杂的生态系统演进。这种演进需要一种全新的通信范式,能够支持:

- 跨平台互操作:不同模型和工具之间的无缝协作。

- 动态能力管理:根据需求和资源状况,动态调整工具的使用。

- 安全可靠:完善的权限管理、审计机制和容错能力。

- 大规模扩展:支持大规模工具生态和复杂任务编排。

- 异步高效:充分利用现代系统的异步处理能力,提高性能。

2. 核心更新亮点与新要素

2.1 MCP v2.0的四大核心创新

创新点 | 描述 | 与Function Calling的区别 |

|---|---|---|

动态能力协商 | 模型与工具之间可以动态协商能力,支持版本兼容和功能扩展 | Function Calling采用静态绑定,无法动态调整 |

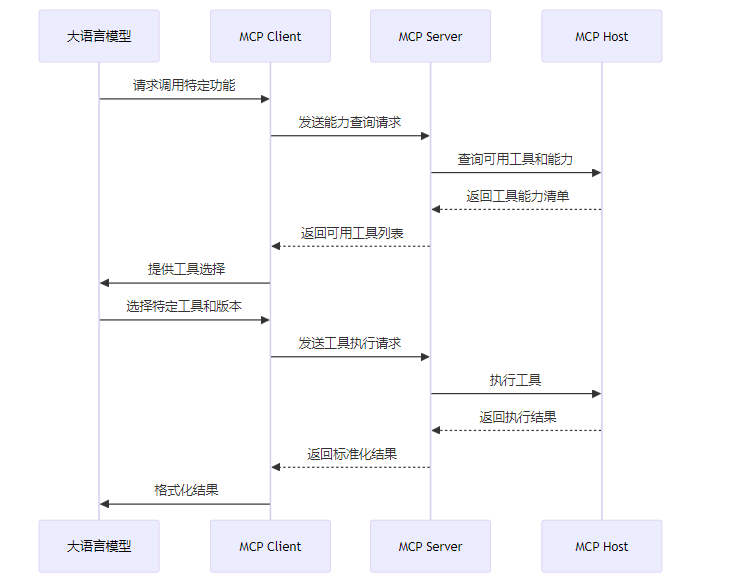

分布式架构 | 采用Client-Server-Host三层架构,支持多工具协同和负载均衡 | Function Calling是模型-工具直接交互,缺乏中间层 |

标准化协议 | 跨平台的标准协议,支持不同模型和工具的互操作 | Function Calling是平台特定的,不同平台不兼容 |

异步优先设计 | 全面支持异步通信,提高系统的并发处理能力 | Function Calling主要支持同步调用,异步能力有限 |

2.2 从Function Calling到MCP的范式转变

维度 | Function Calling | MCP v2.0 | 范式变化 |

|---|---|---|---|

设计理念 | 模型增强 | 能力外置 | 从模型为中心转向生态为中心 |

架构模式 | 点对点 | 分布式 | 从单一交互转向生态协同 |

能力管理 | 静态绑定 | 动态协商 | 从固定能力转向自适应能力 |

生态建设 | 平台封闭 | 开放生态 | 从割裂生态转向统一生态 |

安全机制 | 基本验证 | 完善的权限管理和审计 | 从信任模型转向零信任架构 |

性能设计 | 同步为主 | 异步优先 | 从阻塞式转向非阻塞式 |

2.3 MCP的新要素

- 能力发现机制:允许模型动态发现可用工具和能力。

- 版本协商:支持不同版本工具的共存和兼容。

- 资源管理:根据资源状况,动态调整工具的使用。

- 异步通信:全面支持异步调用,提高系统吞吐量。

- 工具编排:支持复杂的工具组合和任务编排。

- 安全审计:完整的审计日志和安全监控。

- 生态集成:标准化的工具注册和发现机制。

3. 技术深度拆解与实现分析

3.1 MCP架构设计

MCP v2.0采用了三层分布式架构,与Function Calling的点对点架构形成鲜明对比:

架构优势分析:

- 解耦:模型与工具完全解耦,提高了系统的灵活性和可扩展性。

- 负载均衡:支持多个MCP Server和Host,实现负载均衡和高可用性。

- 安全隔离:MCP Server作为中间层,提供了完善的安全隔离和权限管理。

- 动态扩展:可以根据需求动态添加或移除工具,无需修改模型。

- 跨平台支持:支持不同模型和工具的互操作,促进了生态发展。

3.2 MCP动态能力协商机制

MCP v2.0的核心特性之一是动态能力协商,它允许模型和工具之间协商支持的能力和版本:

动态能力协商的优势:

- 版本兼容:支持不同版本工具的共存和兼容。

- 功能扩展:允许工具动态添加新功能,而无需修改模型。

- 资源优化:根据模型需求和资源状况,动态调整工具的使用。

- 安全增强:只向模型暴露其被授权使用的工具和功能。

- 灵活性提高:模型可以根据上下文和需求,选择最适合的工具。

3.3 MCP异步通信设计

MCP v2.0采用异步优先设计,全面支持异步通信,提高了系统的并发处理能力:

# MCP异步通信示例

import asyncio

import aiohttp

class AsyncMCPClient:

"""异步MCP Client实现"""

def __init__(self, server_url):

self.server_url = server_url

self.session = None

async def __aenter__(self):

self.session = aiohttp.ClientSession()

return self

async def __aexit__(self, exc_type, exc_val, exc_tb):

await self.session.close()

async def execute_tool(self, tool_name, tool_version, parameters):

"""异步执行工具"""

request = {

"id": f"req_{asyncio.get_event_loop().time()}",

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "execute",

"tool": {

"name": tool_name,

"version": tool_version,

"parameters": parameters

}

}

async with self.session.post(f"{self.server_url}/execute", json=request) as response:

return await response.json()

async def execute_multiple_tools(self, tool_calls):

"""并行执行多个工具"""

tasks = []

for tool_call in tool_calls:

task = self.execute_tool(

tool_call["name"],

tool_call["version"],

tool_call["parameters"]

)

tasks.append(task)

return await asyncio.gather(*tasks)

# 示例用法

async def main():

async with AsyncMCPClient("http://localhost:8000") as client:

# 并行执行多个工具

results = await client.execute_multiple_tools([

{

"name": "file_reader",

"version": "1.0",

"parameters": {"path": "/data/file1.txt"}

},

{

"name": "file_reader",

"version": "1.0",

"parameters": {"path": "/data/file2.txt"}

},

{

"name": "file_reader",

"version": "1.0",

"parameters": {"path": "/data/file3.txt"}

}

])

print(f"并行执行结果: {results}")

if __name__ == "__main__":

asyncio.run(main())异步通信的优势:

- 高并发处理:可以同时处理大量工具调用请求,提高系统吞吐量。

- 资源利用率高:避免了线程阻塞,充分利用了系统资源。

- 响应速度快:减少了等待时间,提高了系统的响应速度。

- 支持长任务:可以处理长时间运行的任务,而不会阻塞其他请求。

- 更好的扩展性:可以轻松扩展到更多的工具和用户。

3.4 MCP安全机制设计

MCP v2.0内置了完善的安全机制,解决了Function Calling的安全隐患:

// MCP安全配置示例

{

"security": {

"authentication": {

"type": "JWT",

"secret": "your-secret-key",

"expires_in": 3600

},

"authorization": {

"roles": {

"user": {

"permissions": ["file:read", "data:query"]

},

"admin": {

"permissions": ["*:*"]

}

}

},

"rate_limiting": {

"global": {

"requests_per_minute": 1000

},

"per_user": {

"requests_per_minute": 60

}

},

"audit": {

"enabled": true,

"log_level": "info",

"retention_days": 30

},

"sandbox": {

"enabled": true,

"allowed_paths": ["/data", "/tmp"],

"allowed_commands": ["ls", "cat", "grep"]

}

}

}安全机制的核心组件:

- 认证与授权:采用JWT或OAuth2等标准认证方式,结合基于角色的权限管理(RBAC)。

- 速率限制:防止恶意请求和资源滥用。

- 审计日志:完整记录所有工具调用和操作,便于追踪和分析。

- 沙箱隔离:将工具执行环境与系统隔离,防止恶意代码执行。

- 输入验证:严格验证工具参数,防止注入攻击和路径遍历等安全问题。

4. 与主流方案深度对比

4.1 MCP vs Function Calling

维度 | Function Calling | MCP v2.0 | 优势方 |

|---|---|---|---|

平台兼容性 | 平台特定 | 跨平台支持 | MCP |

部署方式 | 云端唯一 | 支持本地部署和私有部署 | MCP |

安全性 | 基本权限控制 | 完善的安全机制 | MCP |

可扩展性 | 有限 | 支持大规模工具生态 | MCP |

异步支持 | 有限 | 全面支持异步通信 | MCP |

动态能力 | 不支持 | 支持动态能力协商 | MCP |

工具编排 | 有限 | 支持复杂工具编排 | MCP |

生态开放性 | 封闭 | 开放生态 | MCP |

4.2 MCP vs gRPC

维度 | gRPC | MCP v2.0 | 优势方 |

|---|---|---|---|

设计目标 | 通用RPC框架 | 专门为AI工具调用设计 | MCP |

易用性 | 复杂的IDL定义 | 简单的JSON Schema | MCP |

跨语言支持 | 支持多种语言 | 支持多种语言 | 平局 |

异步支持 | 支持 | 全面支持 | 平局 |

安全机制 | 基本TLS | 完善的安全机制 | MCP |

生态集成 | 通用框架 | 专门的AI工具生态 | MCP |

动态能力 | 有限 | 支持动态能力协商 | MCP |

4.3 MCP vs RESTful API

维度 | RESTful API | MCP v2.0 | 优势方 |

|---|---|---|---|

设计风格 | 资源导向 | 功能导向 | MCP |

异步支持 | 有限 | 全面支持 | MCP |

标准化 | 缺乏严格标准 | 严格的协议规范 | MCP |

工具定义 | 自由格式 | 严格的JSON Schema | MCP |

安全机制 | 基本认证 | 完善的安全机制 | MCP |

生态集成 | 通用 | 专门的AI工具生态 | MCP |

动态能力 | 不支持 | 支持动态能力协商 | MCP |

5. 技术深度拆解与实现分析

5.1 MCP Server实现:从理论到实践

下面是使用Python FastAPI实现的完整MCP Server示例,包括动态能力协商、异步通信和安全机制:

from fastapi import FastAPI, HTTPException, Depends, Security

from fastapi.security import HTTPBearer, HTTPAuthorizationCredentials

from pydantic import BaseModel, Field

import uvicorn

import json

import asyncio

from typing import Dict, List, Any, Optional

import jwt

from datetime import datetime, timedelta

# 安全配置

SECRET_KEY = "your-secret-key"

ALGORITHM = "HS256"

ACCESS_TOKEN_EXPIRE_MINUTES = 30

# 工具注册表

tools_registry: Dict[str, Any] = {}

# 初始化FastAPI应用

app = FastAPI(title="MCP Server", version="2.0")

# JWT认证

bearer_scheme = HTTPBearer()

# 工具定义模型

class ToolDefinition(BaseModel):

name: str = Field(..., description="工具名称")

version: str = Field(..., description="工具版本")

description: str = Field(..., description="工具描述")

parameters: Dict[str, Any] = Field(..., description="工具参数Schema")

returns: Dict[str, Any] = Field(..., description="工具返回值Schema")

security: Dict[str, Any] = Field(default={}, description="安全配置")

async_supported: bool = Field(default=True, description="是否支持异步调用")

# 工具执行请求模型

class ToolExecuteRequest(BaseModel):

id: str = Field(..., description="请求ID")

version: str = Field(..., description="MCP版本")

timestamp: str = Field(..., description="请求时间戳")

type: str = Field(..., description="请求类型")

tool: Dict[str, Any] = Field(..., description="工具信息")

context: Dict[str, Any] = Field(default={}, description="上下文信息")

# 能力查询请求模型

class CapabilityQueryRequest(BaseModel):

id: str = Field(..., description="请求ID")

version: str = Field(..., description="MCP版本")

timestamp: str = Field(..., description="请求时间戳")

type: str = Field(..., description="请求类型")

capabilities: List[str] = Field(default=[], description="查询的能力列表")

context: Dict[str, Any] = Field(default={}, description="上下文信息")

# 创建访问令牌

def create_access_token(data: dict, expires_delta: Optional[timedelta] = None):

to_encode = data.copy()

if expires_delta:

expire = datetime.utcnow() + expires_delta

else:

expire = datetime.utcnow() + timedelta(minutes=15)

to_encode.update({"exp": expire})

encoded_jwt = jwt.encode(to_encode, SECRET_KEY, algorithm=ALGORITHM)

return encoded_jwt

# 验证访问令牌

def verify_token(credentials: HTTPAuthorizationCredentials = Security(bearer_scheme)):

try:

payload = jwt.decode(credentials.credentials, SECRET_KEY, algorithms=[ALGORITHM])

return payload

except jwt.PyJWTError:

raise HTTPException(status_code=401, detail="Invalid authentication credentials")

# 根路由

@app.get("/")

async def root():

return {"message": "MCP Server is running", "version": "2.0"}

# 健康检查

@app.get("/health")

async def health_check():

return {"status": "healthy"}

# 获取服务器指标

@app.get("/metrics")

async def get_metrics():

return {

"tools_count": len(tools_registry),

"server_version": "2.0"

}

# 注册工具

@app.post("/tools/register", dependencies=[Depends(verify_token)])

async def register_tool(tool_def: ToolDefinition):

tool_key = f"{tool_def.name}:{tool_def.version}"

tools_registry[tool_key] = tool_def.dict()

return {"status": "success", "message": f"Tool {tool_key} registered successfully"}

# 获取工具列表

@app.get("/tools/list")

async def list_tools():

return {"tools": list(tools_registry.values())}

# 获取特定工具

@app.get("/tools/{tool_name}")

async def get_tool(tool_name: str, version: Optional[str] = None):

if version:

tool_key = f"{tool_name}:{version}"

if tool_key in tools_registry:

return tools_registry[tool_key]

else:

raise HTTPException(status_code=404, detail=f"Tool {tool_key} not found")

else:

# 返回所有版本的工具

tools = []

for key, tool in tools_registry.items():

if key.startswith(f"{tool_name}:"):

tools.append(tool)

if not tools:

raise HTTPException(status_code=404, detail=f"Tool {tool_name} not found")

return {"tools": tools}

# 能力协商

@app.post("/negotiate")

async def negotiate_capabilities(request: CapabilityQueryRequest):

# 验证MCP版本

if request.version != "2.0":

raise HTTPException(status_code=400, detail="Unsupported MCP version")

# 处理能力查询

available_capabilities = []

for tool in tools_registry.values():

# 检查工具是否支持请求的能力

if not request.capabilities or any(cap in tool.get("capabilities", []) for cap in request.capabilities):

available_capabilities.append({

"name": tool["name"],

"version": tool["version"],

"capabilities": tool.get("capabilities", [])

})

return {

"id": request.id,

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "response",

"status": "success",

"capabilities": available_capabilities,

"context": request.context

}

# 执行工具

@app.post("/execute")

async def execute_tool(request: ToolExecuteRequest, payload: Dict[str, Any] = Depends(verify_token)):

# 验证MCP版本

if request.version != "2.0":

raise HTTPException(status_code=400, detail="Unsupported MCP version")

tool_name = request.tool["name"]

tool_version = request.tool.get("version", "1.0")

tool_key = f"{tool_name}:{tool_version}"

# 检查工具是否存在

if tool_key not in tools_registry:

raise HTTPException(status_code=404, detail=f"Tool {tool_key} not found")

tool_def = tools_registry[tool_key]

# 检查用户是否有执行该工具的权限

user_roles = payload.get("roles", ["user"])

tool_permissions = tool_def["security"].get("permissions", [])

# 简化的权限检查,实际应用中应该更复杂

has_permission = True

if tool_permissions:

has_permission = any(role == "admin" or f"{tool_name}:*" in tool_permissions for role in user_roles)

if not has_permission:

raise HTTPException(status_code=403, detail="Permission denied")

# 这里简化了工具执行逻辑,实际实现需要根据工具定义执行具体的工具

# 在真实场景中,应该将请求路由到对应的MCP Host执行

# 模拟文件读取工具执行

if tool_name == "file_reader":

path = request.tool["parameters"].get("path")

encoding = request.tool["parameters"].get("encoding", "utf-8")

try:

with open(path, "r", encoding=encoding) as f:

content = f.read()

return {

"id": request.id,

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "response",

"status": "success",

"result": {

"content": content,

"metadata": {

"file_size": len(content),

"read_time": 0.001

}

},

"context": request.context

}

except Exception as e:

return {

"id": request.id,

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "response",

"status": "error",

"error": {

"code": "execution_failed",

"message": str(e)

},

"context": request.context

}

# 模拟其他工具执行

return {

"id": request.id,

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "response",

"status": "success",

"result": {

"message": f"Tool {tool_key} executed successfully",

"parameters": request.tool["parameters"]

},

"context": request.context

}

# 生成访问令牌

@app.post("/token")

async def generate_token(username: str, password: str):

# 简化的身份验证,实际应用中应该更复杂

if username == "admin" and password == "password":

access_token_expires = timedelta(minutes=ACCESS_TOKEN_EXPIRE_MINUTES)

access_token = create_access_token(

data={"sub": username, "roles": ["admin"]}, expires_delta=access_token_expires

)

return {"access_token": access_token, "token_type": "bearer"}

elif username == "user" and password == "password":

access_token_expires = timedelta(minutes=ACCESS_TOKEN_EXPIRE_MINUTES)

access_token = create_access_token(

data={"sub": username, "roles": ["user"]}, expires_delta=access_token_expires

)

return {"access_token": access_token, "token_type": "bearer"}

else:

raise HTTPException(status_code=401, detail="Incorrect username or password")

if __name__ == "__main__":

uvicorn.run(app, host="0.0.0.0", port=8000)运行说明:

- 安装依赖:

pip install fastapi uvicorn pydantic python-jose aiohttp - 保存代码为

mcp_server_full.py - 运行服务器:

python mcp_server_full.py - 访问API文档:

http://localhost:8000/docs - 生成访问令牌:发送POST请求到

/token获取JWT令牌 - 使用令牌调用其他API:在请求头中添加

Authorization: Bearer <token>

5.2 MCP Client与LLM集成示例

下面是一个示例,展示如何将MCP Client与LLM集成,实现智能工具调用:

import asyncio

import aiohttp

import json

from openai import AsyncOpenAI

class LLM_MCPClient:

"""LLM与MCP Client集成"""

def __init__(self, llm_api_key: str, mcp_server_url: str):

self.llm_client = AsyncOpenAI(api_key=llm_api_key)

self.mcp_server_url = mcp_server_url

self.mcp_session = None

async def __aenter__(self):

self.mcp_session = aiohttp.ClientSession()

return self

async def __aexit__(self, exc_type, exc_val, exc_tb):

await self.mcp_session.close()

async def list_mcp_tools(self) -> dict:

"""获取MCP工具列表"""

url = f"{self.mcp_server_url}/tools/list"

async with self.mcp_session.get(url) as response:

return await response.json()

async def execute_mcp_tool(self, tool_name: str, tool_version: str,

parameters: dict, user_id: str, session_id: str) -> dict:

"""执行MCP工具"""

request = {

"id": f"req_{asyncio.get_event_loop().time()}",

"version": "2.0",

"timestamp": str(asyncio.get_event_loop().time()),

"type": "execute",

"tool": {

"name": tool_name,

"version": tool_version,

"parameters": parameters

},

"context": {

"user_id": user_id,

"session_id": session_id

}

}

url = f"{self.mcp_server_url}/execute"

async with self.mcp_session.post(url, json=request) as response:

return await response.json()

async def generate_tool_call(self, user_query: str, tools: list) -> dict:

"""使用LLM生成工具调用"""

# 构建提示词

prompt = f"""

你是一个智能助手,需要根据用户查询和可用工具,生成合适的工具调用请求。

可用工具:

{json.dumps(tools, indent=2, ensure_ascii=False)}

用户查询:{user_query}

请生成一个JSON格式的工具调用请求,包含工具名称、版本和参数。

只返回JSON,不要添加任何其他内容。

"""

# 调用LLM生成工具调用

response = await self.llm_client.chat.completions.create(

model="gpt-4o",

messages=[

{"role": "system", "content": "你是一个智能工具调用生成器。"},

{"role": "user", "content": prompt}

],

response_format={"type": "json_object"}

)

return json.loads(response.choices[0].message.content)

async def process_user_query(self, user_query: str, user_id: str, session_id: str) -> str:

"""处理用户查询,智能调用工具"""

# 获取可用工具列表

tools_response = await self.list_mcp_tools()

tools = tools_response.get("tools", [])

if not tools:

return "没有可用的工具。"

# 使用LLM生成工具调用

tool_call = await self.generate_tool_call(user_query, tools)

# 执行工具调用

tool_name = tool_call["name"]

tool_version = tool_call.get("version", "1.0")

parameters = tool_call["parameters"]

result = await self.execute_mcp_tool(tool_name, tool_version, parameters, user_id, session_id)

# 使用LLM将工具结果转化为自然语言回答

prompt = f"""

你是一个智能助手,需要将工具执行结果转化为自然语言回答,响应用户的原始查询。

用户原始查询:{user_query}

工具调用详情:

{json.dumps(tool_call, indent=2, ensure_ascii=False)}

工具执行结果:

{json.dumps(result, indent=2, ensure_ascii=False)}

请将结果转化为自然、友好的自然语言回答,不要添加任何其他内容。

"""

response = await self.llm_client.chat.completions.create(

model="gpt-4o",

messages=[

{"role": "system", "content": "你是一个智能结果解释器。"},

{"role": "user", "content": prompt}

]

)

return response.choices[0].message.content

# 示例用法

async def main():

async with LLM_MCPClient(

llm_api_key="your-openai-api-key",

mcp_server_url="http://localhost:8000"

) as client:

# 处理用户查询

user_query = "请读取/data/sample.txt文件的内容"

result = await client.process_user_query(user_query, "user_001", "session_123")

print(f"用户查询:{user_query}")

print(f"回答:{result}")

if __name__ == "__main__":

asyncio.run(main())运行说明:

- 安装依赖:

pip install aiohttp openai - 保存代码为

llm_mcp_integration.py - 确保MCP Server正在运行

- 设置OpenAI API密钥:

export OPENAI_API_KEY=your-api-key - 运行集成示例:

python llm_mcp_integration.py

5. 实际工程意义、潜在风险与局限性分析

5.1 MCP的实际工程意义

- 提高开发效率:标准化的协议和工具定义,减少了重复开发和适配工作。

- 增强系统安全性:内置的安全机制,降低了工具调用的安全风险。

- 促进生态发展:开放的生态系统,加速了工具的开发和共享。

- 支持大规模部署:分布式架构,支持高并发和大规模工具调用。

- 为Agent时代奠定基础:标准化的工具调用机制,是多Agent协作的核心基础设施。

- 降低AI应用开发门槛:简化了AI应用与外部工具的集成,降低了开发难度。

- 提高系统可靠性:完善的容错机制和负载均衡,提高了系统的可靠性和可用性。

5.2 MCP的潜在风险

- 协议复杂性:MCP v2.0引入了较多新特性,增加了学习和实现的复杂性。

- 性能开销:相对于直接的Function Calling,MCP的分层架构会带来一定的性能开销。

- 生态碎片化风险:如果MCP未能成为真正的行业标准,可能导致新的生态碎片化。

- 安全挑战:虽然MCP内置了安全机制,但随着工具生态的扩大,新的安全挑战也会不断出现。

- 兼容性问题:不同版本的MCP之间可能存在兼容性问题,需要有效的版本管理机制。

- 依赖网络通信:MCP依赖网络通信,在网络不稳定的环境下可能影响可靠性。

5.3 MCP的局限性

- 初期学习曲线较陡:对于不熟悉分布式系统和通信协议的开发者,MCP的学习曲线较陡。

- 性能开销:在对延迟要求极高的场景下,MCP的分层架构可能不是最佳选择。

- 工具生态尚不成熟:虽然MCP的生态正在快速发展,但与成熟的Function Calling生态相比,仍有差距。

- 标准化工作仍在进行中:MCP v2.0是一个相对较新的协议,标准化工作仍在进行中,可能会有后续的变更。

- 需要额外的基础设施:部署MCP需要额外的服务器和资源,增加了系统的复杂性和成本。

6. 未来趋势展望与个人前瞻性预测

6.1 MCP的短期发展趋势(2026-2027)

- 广泛采用:越来越多的AI平台和工具开发者将采用MCP作为标准通信协议。

- 生态壮大:围绕MCP将形成完整的工具生态,包括工具市场、注册中心和开发框架。

- 性能优化:MCP的实现将进一步优化,降低通信开销,提高执行效率。

- 安全增强:引入更高级的安全特性,如零信任架构、区块链审计和AI驱动的威胁检测。

- 多模态支持:扩展支持多模态工具,包括图像、音频、视频等。

- 边缘计算支持:优化MCP在边缘设备上的表现,支持边缘AI应用。

6.2 MCP的长期发展趋势(2028-2030)

- 成为行业标准:MCP将成为AI工具调用的行业标准,类似于HTTP在Web中的地位。

- Agent时代的核心基础设施:MCP将成为多Agent协作系统的核心基础设施,支持复杂的任务编排和资源管理。

- 与AI OS深度集成:MCP将与AI OS深度集成,成为AI系统与外部世界交互的标准接口。

- 跨域协作支持:支持跨组织、跨平台的工具调用,实现真正的全球AI工具生态。

- 自适应能力:MCP将引入自适应能力,能够根据模型需求和资源状况动态调整工具的使用策略。

- 量子计算支持:随着量子计算的发展,MCP将扩展支持量子计算工具和资源。

6.3 个人前瞻性预测

- MCP将重塑AI工具生态:未来3-5年内,MCP将彻底改变AI工具的开发和使用方式,形成一个统一、开放、安全的工具生态。

- MCP将成为Agent协作的"TCP/IP":在Agent时代,MCP将扮演类似TCP/IP的角色,成为Agent之间协作和资源共享的基础协议。

- MCP将推动AI应用的普及:标准化的工具调用机制,将降低AI应用开发的门槛,推动AI应用的普及。

- MCP将促进AI安全的发展:内置的安全机制和审计能力,将促进AI安全技术的发展和应用。

- MCP将催生新的商业模式:围绕MCP将出现新的商业模式,如工具即服务(TaaS)、工具市场和工具订阅等。

- MCP将与Web3技术融合:MCP可能会与Web3技术融合,实现去中心化的工具市场和资源共享。

7. 结论与行动建议

7.1 结论

从Function Calling到MCP,代表了AI工具调用的范式级变化。MCP v2.0通过动态能力协商、分布式架构、标准化协议和异步优先设计,解决了Function Calling的核心痛点,为AI工具生态的发展奠定了基础。

这种范式转变的核心是从"模型增强"向"能力外置"的设计理念转变,从"平台封闭"向"开放生态"的生态建设转变,从"静态绑定"向"动态协商"的能力管理转变。

7.2 行动建议

- 对于AI平台开发者:

- 考虑集成MCP支持,提供标准化的工具调用接口。

- 参与MCP社区,推动协议的完善和发展。

- 构建MCP兼容的工具生态,吸引更多开发者参与。

- 对于工具开发者:

- 学习MCP协议,开发MCP兼容的工具。

- 将现有工具适配为MCP标准,扩大工具的应用范围。

- 参与MCP工具市场,提高工具的曝光度和使用率。

- 对于AI应用开发者:

- 采用MCP作为工具调用的标准,提高应用的可扩展性和安全性。

- 利用MCP的动态能力协商机制,优化工具的使用。

- 关注MCP生态的发展,及时采用新的工具和特性。

- 对于研究人员:

- 研究MCP在多Agent协作和智能系统中的应用。

- 探索MCP的性能优化和安全增强技术。

- 关注MCP与未来模型能力的适配和演进。

7.3 最终思考

MCP的出现标志着AI工具生态进入了一个新的阶段。它不仅仅是一种协议,更是一种AI工具生态的全新组织方式。随着MCP的广泛采用和生态的不断壮大,我们将迎来一个更加开放、安全、高效的AI工具时代。

作为AI领域的从业者,我们应该积极拥抱MCP,参与到这场AI工具生态的变革中来,共同推动AI技术的发展和应用。只有通过开放合作和标准化,我们才能充分发挥AI的潜力,创造出更加智能、安全、高效的AI应用。

参考链接:

- MCP官方GitHub仓库:MCP协议规范和参考实现

- MCP v2.0发布说明:详细介绍MCP v2.0的新特性

- FastAPI官方文档:用于构建MCP Server的Web框架

- Python asyncio文档:Python异步编程库

- aiohttp官方文档:Python异步HTTP客户端/服务器库

- OpenAI Function Calling文档:OpenAI Function Calling的官方文档

附录(Appendix):

MCP v2.0核心概念

概念 | 描述 |

|---|---|

MCP | Model Communication Protocol,模型通信协议,用于大语言模型与外部工具的安全交互 |

动态能力协商 | 模型与工具之间动态协商支持的能力和版本 |

分布式架构 | 采用Client-Server-Host三层架构,支持多工具协同和负载均衡 |

异步通信 | 非阻塞的通信方式,提高系统的并发处理能力 |

工具定义 | 使用JSON Schema定义工具的元数据和参数规范 |

安全机制 | 包括认证、授权、速率限制、审计日志和沙箱隔离等 |

生态集成 | 标准化的工具注册和发现机制,支持工具市场和生态建设 |

MCP v2.0 API端点详细说明

端点 | 方法 | 功能 | 认证要求 |

|---|---|---|---|

/ | GET | 根路由,返回服务器状态 | 否 |

/health | GET | 健康检查 | 否 |

/metrics | GET | 获取服务器指标 | 否 |

/tools/register | POST | 注册新工具 | 是 |

/tools/list | GET | 获取可用工具列表 | 否 |

/tools/{tool_name} | GET | 获取特定工具信息 | 否 |

/negotiate | POST | 进行能力协商 | 否 |

/execute | POST | 执行工具 | 是 |

/token | POST | 生成访问令牌 | 否 |

环境配置要求

组件 | 版本要求 | 用途 |

|---|---|---|

Python | ≥ 3.9 | 运行环境 |

FastAPI | ≥ 0.100.0 | Web框架 |

uvicorn | ≥ 0.20.0 | ASGI服务器 |

pydantic | ≥ 2.0.0 | 数据验证 |

python-jose | ≥ 3.3.0 | JWT认证 |

aiohttp | ≥ 3.8.0 | 异步HTTP客户端 |

openai | ≥ 1.0.0 | OpenAI API客户端 |

关键词: MCP, Model Communication Protocol, Function Calling, 范式转变, 动态能力协商, 分布式架构, 异步通信, FastAPI, Python asyncio, AI工具生态

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-02,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录