DeepSeek 重磅新作:梁文锋领衔发布 mHC 架构,攻克大模型训练不稳定性难题

原创DeepSeek 重磅新作:梁文锋领衔发布 mHC 架构,攻克大模型训练不稳定性难题

原创

猫头虎

发布于 2026-01-02 18:24:31

发布于 2026-01-02 18:24:31

DeepSeek 重磅新作:梁文锋领衔发布 mHC 架构,攻克大模型训练不稳定性难题

摘要:2026年1月1日,DeepSeek 发布最新论文,提出流形约束超连接架构,旨在解决大规模模型训练中的不稳定性问题。该论文由 DeepSeek 创始人梁文锋参与署名,通过引入流形约束恢复恒等映射特性,仅增加少量计算开销即可实现显著性能提升。

引言

在深度学习与大模型领域,架构设计的微小改进往往能带来性能的巨大飞跃。自 ResNet 引入残差连接以来,这一范式已成为过去十年的标准配置。然而,随着模型规模的指数级增长,传统的连接方式面临着训练不稳定性和扩展性受限的挑战。

1月1日,AI 独角兽 DeepSeek 发布了一篇重磅新论文,提出了一种名为 mHC(Manifold-Constrained Hyper-connections,流形约束超连接) 的新架构。这项研究不仅解决了超连接在大规模训练中的“痛点”,更标志着深度学习基石技术的又一次关键升级。

值得注意的是,DeepSeek 创始人梁文锋位列作者名单之中。论文的第一作者包括 Zhenda Xie(解振达)、Yixuan Wei(韦毅轩)、Huanqi Cao。

DeepSeek 论文

核心突破:从超连接到流形约束

论文摘要指出,近年来以超连接为代表的研究通过拓宽残差流宽度和多样化连接模式,拓展了传统的残差连接范式。虽然这些改进带来了显著的性能提升,但也引入了新的问题:

- 削弱恒等映射特性:连接模式的多样化从根本上削弱了残差连接固有的恒等映射特性。

- 训练不稳定与扩展受限:导致了严重的训练不稳定性,限制了模型的可扩展性。

- 内存访问开销:造成了显著的内存访问负担。

为了解决这些问题,DeepSeek 提出了 流形约束超连接(mHC)。这是一种通用框架,能够将 HC 的残差连接空间投影到特定流形上。其核心价值在于:

- 恢复恒等映射特性:确保信号在深层网络中有效传递。

- 基础设施级优化:融合了严格的基础设施优化,确保运行效率。

架构对比

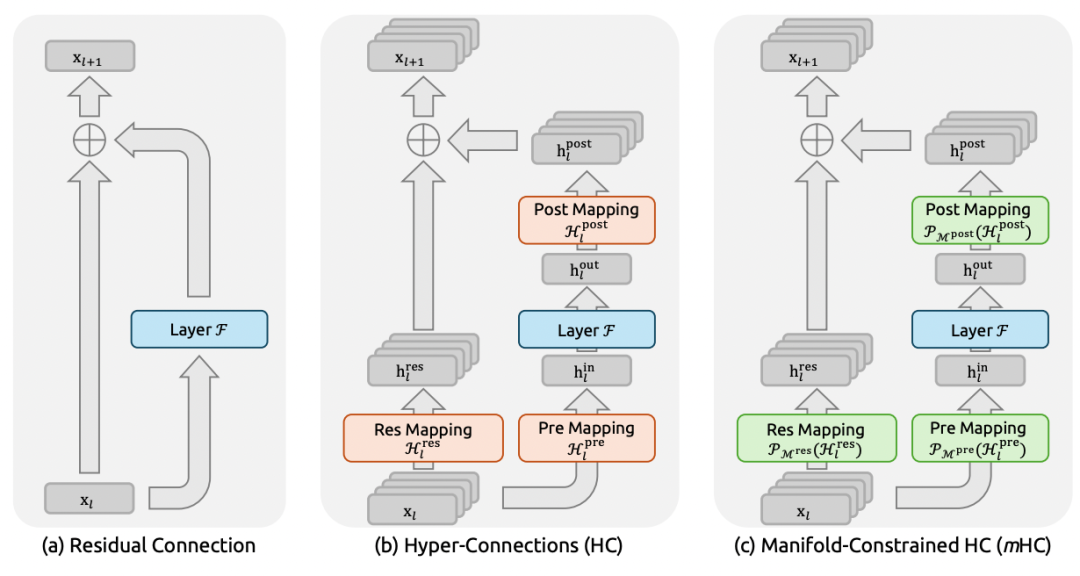

图为残差连接范式的示意图。本图对比了 标准残差连接、超连接 以及 流形约束超连接 的结构设计。与无约束的 HC 不同,mHC 通过将连接矩阵投影到一个约束流形上,专注于优化残差连接空间,从而确保训练的稳定性。

性能验证:低开销,高收益

实证实验表明,mHC 能够有效支持大规模训练,在提供明显性能提升的同时具备更优的可扩展性。

根据内部大规模训练结果显示,mHC 在扩展率 $n=4$ 时,仅带来 6.7% 的额外时间开销。这意味着开发者可以在几乎不增加额外计算成本的前提下,获得更稳定的训练过程和更优的模型性能。

DeepSeek 预计,mHC 作为 HC 的一种灵活而实用的拓展,将有助于深化对拓扑架构设计的理解,并为基座模型的演进指明富有前景的方向。

结论与展望:重塑宏观架构设计

论文在结论部分强调,相较于传统 HC,mHC 能以更优的可扩展性实现稳定的大规模训练。关键是,通过高效的基础设施级优化,mHC 以可忽略的计算开销实现了上述改进。

未来研究方向包括:

- 兼容多种流形约束:虽然本研究采用双随机矩阵确保稳定性,但该框架可兼容针对特定学习目标设计的多种流形约束探索。

- 几何约束的深入研究:预计对差异化几何约束的研究可能催生能更好权衡“可塑性—稳定性”关系的新方法。

- 激发宏观架构设计关注:DeepSeek 希望 mHC 能重新激发学界对宏观架构设计的关注,通过深化对拓扑结构如何影响优化与表征学习的理解,突破现有局限。

DeepSeek 近期动态回顾

近期,DeepSeek 在模型发布与学术研究上动作频频,持续推动行业边界。

2025年12月1日:发布双模

DeepSeek 同时发布两个正式版模型:DeepSeek-V3.2 和 DeepSeek-V3.2-Speciale。

- DeepSeek-V3.2:旨在平衡推理能力与输出长度,适合日常问答和通用 Agent 任务。在公开推理类 Benchmark 中达到 GPT-5 水平,仅略低于 Gemini-3.0-Pro。

- DeepSeek-V3.2-Speciale:长思考增强版,结合了定理证明能力,具备出色的指令跟随和逻辑验证能力,性能媲美 Gemini-3.0-Pro。

2025年9月29日:架构探索与降价

发布 DeepSeek-V3.2-Exp 模型,引入 DeepSeek Sparse Attention(稀疏注意力机制),针对长文本效率进行优化。同时,API 价格大幅下调,开发者调用成本降低 50% 以上。

2025年9月17日:登顶 Nature 封面

DeepSeek-R1 推理模型研究论文登上国际权威期刊《自然》封面。梁文锋担任通讯作者,首次公开了仅靠强化学习激发大模型推理能力的研究成果。这是中国大模型研究首次登上 Nature 封面,标志着中国 AI 技术获得国际最高认可。

《自然》社论评价道:“几乎所有主流的大模型都还没有经过独立同行评审,这一空白终于被 DeepSeek 打破。”

深度解析:mHC 如何拯救“梯度爆炸”?

为了更直观地理解这项技术的意义,我们可以从历史和类比的角度进行剖析。

DeepSeek 的这一发布,是继 2015 年 ResNet 之后的又一历史性时刻。2015 年后,ResNet 成为标准,为了解决深层网络信息传递问题,残差连接让每一层都传递信息给后面的层。然而,当最后一层收到以前所有层的信号时,信息量过大(噪音太大),容易导致梯度爆炸或梯度消失,也就是常说的 AI 训练“炸机”。

2024年9月,DeepSeek 团队曾提出 HC(超连接),相当于把 ResNet 从单条高速连接扩展到 4 条。虽然性能提升了,但信号过于复杂,经常出现“梯度大爆炸”的不稳定情况。

2026年1月1日发布的 mHC 架构,则为这场“交通堵塞”提供了解决方案。

通俗类比: 训练大模型就像几百人排队玩传话游戏。ResNet 时代:为了防止传话失真,允许后面的人直接听最前面的人喊声(残差连接)。 HC 时代:增加了多条通道,但大家七嘴八舌,导致听不清(不稳定)。 mHC 时代:相当于给每个人都发了一个“智能导航系统”。它实时引导数据流从不同的“高速公路”走,保证进来多少车、出去也是多少车。车速依旧快,但不再撞车。

mHC 即流形约束,它从数学层面确保了信号传递和梯度的双向保障,为未来更大参数量级的模型训练扫清了架构上的障碍。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录