放弃“看图说话”,让AI用“语言”预见未来:语义世界模型让机器人决策更聪明

放弃“看图说话”,让AI用“语言”预见未来:语义世界模型让机器人决策更聪明

一点人工一点智能

发布于 2025-11-26 16:25:32

发布于 2025-11-26 16:25:32

编辑:陈萍萍的公主@一点人工一点智能

摘要:论文提出了一种新型的世界建模方法,旨在通过语义预测而非像素级重建来支持机器人控制中的规划任务。传统世界模型通常通过预测未来帧的像素来模拟环境动态,然而,高保真的像素重建并不总能转化为有效的决策能力。

该论文指出,世界模型实际上只需预测与任务相关的未来语义信息,例如“机械臂是否接近物体?”或“红色方块是否翻倒?”。为此,作者将世界建模问题重新定义为对未来结果的视觉问答任务,从而可以利用视觉语言模型的强大能力。该方法通过在有图像-动作-文本数据上进行监督微调,使视觉语言模型具备预测未来语义状态的能力,进而用于规划任务。

实验表明,该方法在多个开放式机器人任务中显著优于基于重建的传统世界模型,尤其在泛化性和鲁棒性方面表现突出。

论文地址:https://arxiv.org/pdf/2510.19818

项目地址:https://weirdlabuw.github.io/swm/

引言

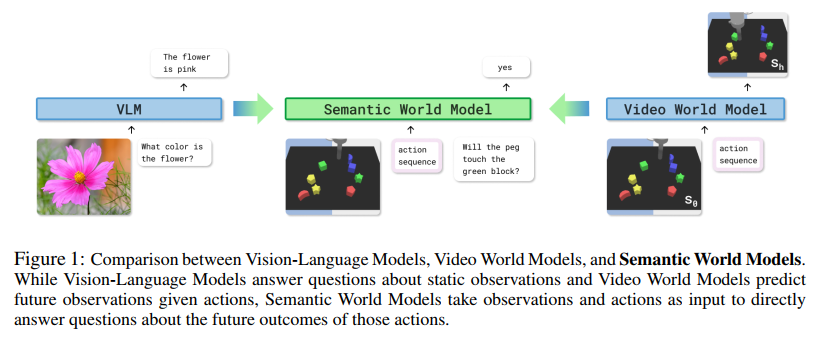

世界模型是一类能够从大量数据中学习并生成对未来结果预测的模型,这些预测可用于规划任务,从而帮助策略获得泛化能力强且鲁棒的行为。传统世界模型多采用像素级重建作为训练目标,尽管在视觉保真度上表现出色,但在规划任务中往往无法捕捉到决策所需的关键语义细节。

例如,在精细操作任务中,像素级预测可能无法准确反映物体之间的接触状态。尽管已有研究尝试建模“任务相关”的潜在表示,但这些方法通常依赖于奖励信号或已知因素,限制了其在实际问题中的适用性。

论文提出,世界模型无需预测像素,而应专注于预测未来的语义信息。具体而言,作者将世界建模问题转化为对未来状态的视觉问答问题,即模型应能回答关于未来状态的语义问题。这一转变使得世界建模可以与视觉语言模型的工具链相结合,利用其在大规模预训练中获得的语义理解能力和泛化性。

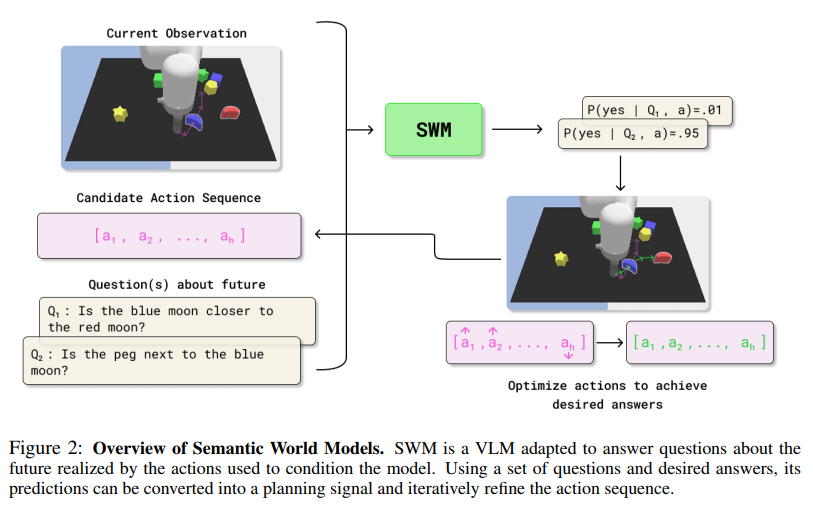

论文中提出的“语义世界模型”(Semantic World Model, SWM)以当前观测、动作序列和自然语言问题作为输入,直接输出关于未来状态的文本答案。SWM 不依赖于像素重建,而是通过语言空间中的推理来理解动作的语义后果,从而更直接地服务于决策任务。

相关工作

视觉语言模型(VLMs)在多模态理解任务中表现出强大的能力,尤其是在图像与语言的联合表示学习和生成任务中。CLIP 和 SigLIP 等方法通过对比学习或成对损失函数实现图像与文本的对齐,而生成式 VLMs 则能够根据图像和语言提示生成自然语言响应。

近年来,视觉-语言-动作模型(VLAs)进一步将 VLMs 的能力扩展到具身决策任务中,例如 OpenVLA 和 Pi-0 等模型可以直接生成机器人动作。与 VLAs 不同,SWM 将动作作为输入,语言作为输出,这种“反向”结构更有利于保留 VLMs 在预训练中获得的知识。

在世界模型用于控制的研究中,主流方法多基于潜在动态模型或视频预测模型。例如,PETS 和 PlaNet 分别学习一步或多步动态模型,并在潜在空间中进行规划;Dreamer 和 TD-MPC 则利用世界模型进行 rollout 生成以优化策略。

尽管这些方法在样本效率和长期规划方面取得进展,但它们仍依赖于像素或潜在状态的重建。SWM 的独特之处在于其完全在语言空间中进行动态推理,无需显式生成未来观测,从而更直接地聚焦于任务相关语义。

语义世界模型方法

3.1 数据集构建

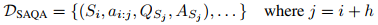

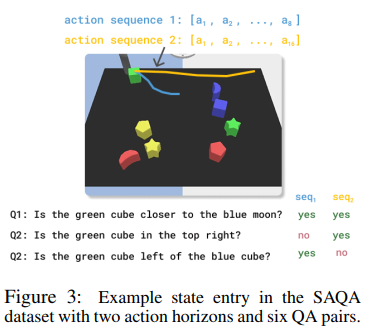

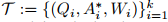

为训练 SWM,论文提出构建“状态-动作-问题-答案”(SAQA)数据集。其形式化定义为:

其中Si表示当前状态(RGB图像),h为预测步长,

是从状态Si开始执行的动作序列,

和

是关于未来状态Sj的问题与答案对。SAQA数据集的构建依赖于轨迹数据,每个轨迹由状态-动作序列组成。通过从不同时间步采样不同长度的动作序列,并结合未来状态的先验信息(如物体位置),程序化地生成多样化的问题与答案对。为提高模型的泛化能力,每个问题类型还包含多种语言表达方式。

3.2 模型架构

SWM 基于预训练的视觉语言模型 PaliGemma 构建,该模型包含三个核心组件:自回归语言模型、视觉编码器和投影矩阵。为将动作信息融入模型,作者引入一个新的投影矩阵

,将动作向量映射到语言模型的输入嵌入空间。给定一个 SAQA 数据样本

,模型的输入序列由图像嵌入、动作嵌入和问题 token 嵌入拼接而成:

模型通过标准交叉熵损失进行端到端微调:

该训练目标使模型能够在语言空间中捕捉环境动态,而无需显式生成像素级表示。

3.3 基于语义世界模型的规划

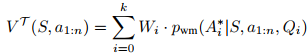

规划任务的目标是找到使未来状态满足特定语义条件的动作序列。每个任务可定义为一系列问题、期望答案和权重:

。给定当前状态S和动作序列

,其任务价值函数为:

为鼓励模型尽早达成目标,作者进一步提出分块评估策略,将动作序列划分为长度为c的子块,并逐块累积价值:

3.3.1 基于采样的规划

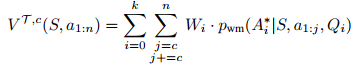

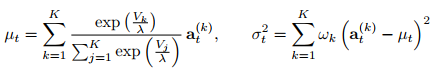

论文采用模型预测路径积分(MPPI)算法进行采样规划。算法维护一个动作参数的高斯分布,并通过迭代采样和加权更新来优化动作序列。具体而言,每轮迭代中从当前分布中采样K条轨迹,计算其价值Vk,并更新分布参数:

其中λ为温度参数,控制探索强度。

3.3.2 基于梯度的规划

为解决采样方法计算成本高的问题,作者提出结合基础策略的梯度优化方法。给定基础策略πb生成初始动作序列a,通过梯度上升优化价值函数:

梯度优化能够更高效地利用模型提供的方向信息,显著减少前向传播次数,适用于复杂任务。

3.4 多步任务处理

为处理长视野任务,SWM 可扩展为多步规划形式。任务被分解为一系列子目标

,每个子目标对应一个语义问题与期望答案。模型依次执行各子目标,并在每一步使用 SWM 验证子目标完成情况。例如,在方块堆叠任务中,子目标包括“是否抓取方块?”和“是否将方块堆叠?”,模型依次完成这两个阶段以实现整体任务。

实验与结果

4.1 实验设置

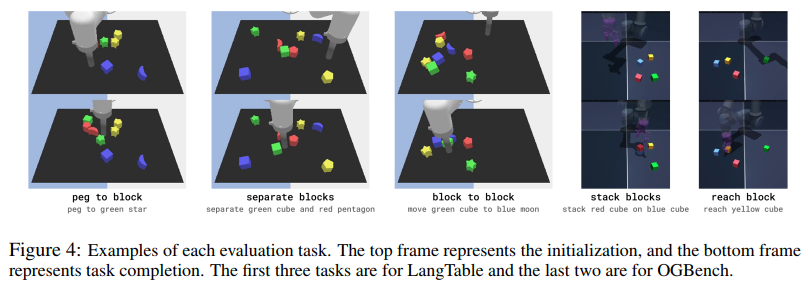

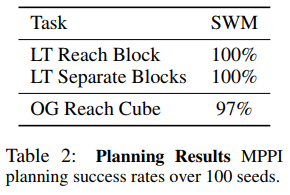

SWM 在 LangTable 和 OGBench 两个仿真环境中进行评估。LangTable 包含“抓取”、“分离方块”和“推动”等任务,注重组合泛化能力;OGBench 则侧重于灵巧操作任务,如“抓取立方体”和“堆叠立方体”。为测试泛化能力,实验在测试阶段改变了方块颜色组合(LangTable)或背景颜色(OGBench),构建分布外测试场景。

4.2 基线方法

论文将 SWM 与以下基线方法进行比较:

· IDQL:一种离线强化学习方法,基于扩散策略与隐式 Q 学习结合。

· 动作条件视频扩散模型(AVD):基于像素的未来帧预测模型,生成帧后使用 SWM 进行 VQA 并计算奖励。

所有方法均基于相同的基础扩散策略进行训练与评估。

4.3 结果分析

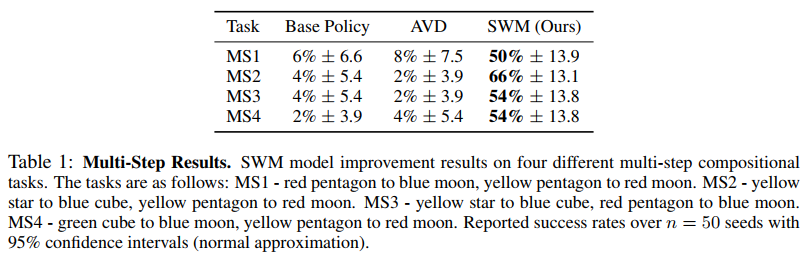

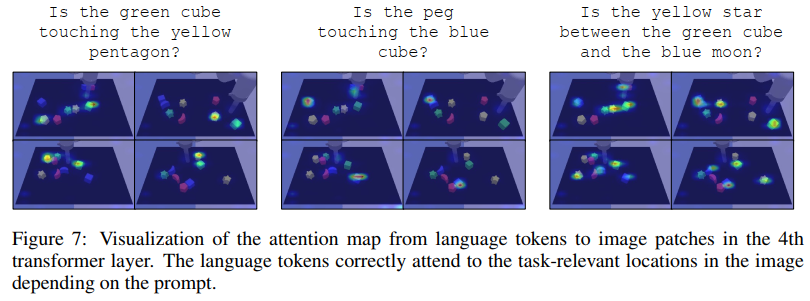

4.3.1 SWM 是否适用于决策?

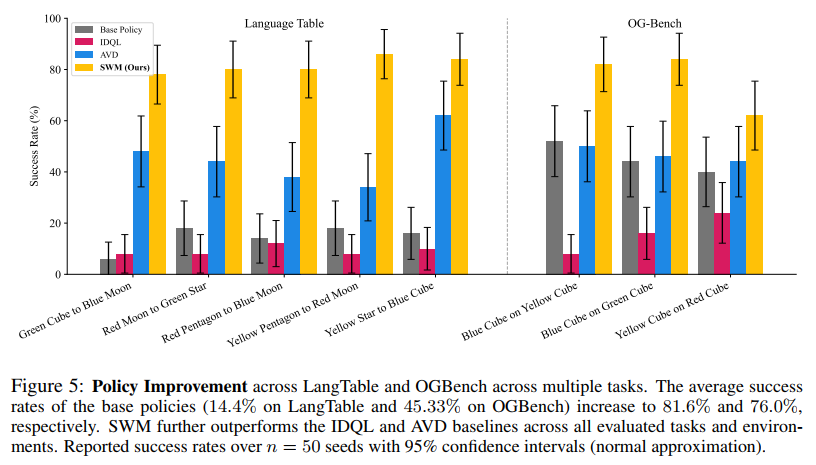

实验表明,SWM 在采样规划(MPPI)下在简单任务中接近完美成功率(见表2)。在复杂任务中,梯度优化方法显著提升基础策略性能:在 LangTable 中平均成功率从 14.4% 提升至 81.6%,在 OGBench 中从 45.33% 提升至 76%。SWM 在所有任务中均优于 IDQL 和 AVD 基线(图5),证明其作为世界模型在决策中的有效性。

4.3.2 非最优数据是否提升模型性能?

为验证 SWM 从非专家数据中学习的能力,作者比较了在专家数据、非最优数据和混合数据上训练的模型性能。结果显示,混合数据训练的模型在分布内和分布外测试中均取得最高准确率(表3),表明非最优数据有助于提升模型的鲁棒性与泛化能力。

4.3.3 模型是否保留基础 VLM 的泛化能力?

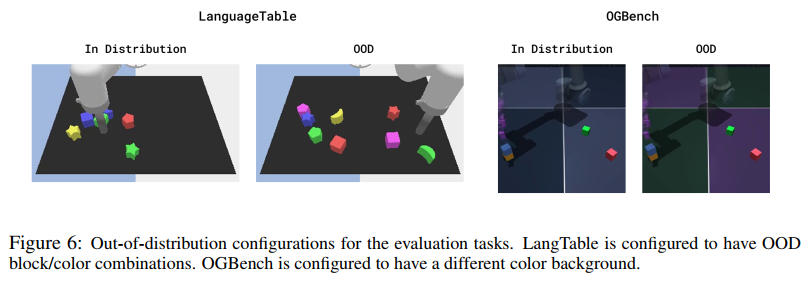

在颜色组合和背景变化的分布外测试中,SWM 相比基础策略提升约 20%(表4),而 AVD 方法在此类场景中表现显著下降。此外,注意力可视化显示(图7),模型能够正确关注与问题相关的物体,即使问题涉及三个物体时也表现出良好的泛化能力,说明其继承了基础 VLM 的语义理解能力。

4.3.4 模型是否关注任务相关信息?

通过可视化语言 token 对图像 patch 的注意力图,作者发现模型能够根据语言提示聚焦于任务相关区域。例如,当询问“红色月亮是否接触蓝色方块?”时,模型在对应物体区域激活较高注意力分数。这表明 SWM 不仅在语义预测上表现优异,其内部表示也具备良好的可解释性。

结论与展望

本文提出了一种基于语义问答的世界建模范式,通过直接预测未来语义状态而非像素信息,实现了更高效、更具泛化能力的机器人规划。SWM 支持采样与梯度两种规划方式,并在多个任务中显著优于像素重建方法与离线强化学习基线。

尽管 SWM 表现出色,仍存在一些局限性:首先,基础 VLM 参数量大,导致采样规划计算成本高;其次,SAQA 数据集的构建依赖仿真环境中的真实状态信息,在真实机器人系统中难以获取。未来研究方向包括使用更轻量化的 VLMs(如 FastVLM、SmolVLM)以降低计算负担,以及探索基于基础 VLM 自动生成 QA 对的方法,从而减少对仿真信息的依赖,提升在真实场景中的适用性。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-10-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读