对抗性运动与运动模仿在人形机器人策略学习中的应用

对抗性运动与运动模仿在人形机器人策略学习中的应用

一点人工一点智能

发布于 2025-11-26 15:51:38

发布于 2025-11-26 15:51:38

编辑:陈萍萍的公主@一点人工一点智能

摘要:本文提出了一种名为“对抗性运动与运动模仿”(Adversarial Locomotion and Motion Imitation, ALMI)的新型框架,旨在解决人形机器人在全身协调控制中的挑战。

传统方法通常将上下半身视为一个整体进行策略学习,忽略了上下半身在不同任务中的独特角色,导致策略训练复杂、稳定性差、易摔倒等问题。ALMI 通过上下半身的对抗性策略学习,分别训练下半身的鲁棒运动能力和上半身的精确运动模仿能力,并通过迭代更新实现全身协调控制。该框架还可扩展至结合遥操作系统的移动操作任务。

实验表明,ALMI 在仿真和真实机器人(Unitree H1)上均表现出良好的运动稳定性和运动跟踪精度。此外,作者还发布了一个大规模全身运动控制数据集 ALMI-X,包含来自 MuJoCo 仿真的高质量轨迹数据,可用于真实机器人的部署。

论文地址:https://arxiv.org/pdf/2504.14305

项目地址:https://almi-humanoid.github.io/

引言

人类在日常活动中展现出多样且富有表现力的全身运动能力,例如跳舞时下半身负责稳定移动和步态控制,上半身执行精确动作以完成特定任务。这种上下半身的协调配合使得人类能够适应各种复杂环境。然而,实现类似人类的全身体协调对人形机器人而言仍是一个巨大挑战。现有方法通常采用运动重定向和强化学习(RL)技术,通过最小化跟踪误差来训练一个统一的全身控制策略。

然而,这类方法存在明显局限:

· 首先,人形机器人具有高自由度(DoF),直接学习全身策略需要复杂的奖励函数设计,训练成本高昂;

· 其次,不同运动之间的差异以及某些超出机器人物理能力的人类动作,使得强化学习策略难以收敛;

· 更重要的是,这类方法往往过于强调运动跟踪精度,而忽视了机器人维持平衡的基本需求,导致在实际部署中频繁摔倒。

本文指出,上述问题的根本原因在于未能区分上下半身在运动学习中的不同角色:下半身主要负责提供稳定的运动能力,上半身则专注于精确的运动模仿。为此,ALMI 提出了一种对抗性训练框架,分别学习上下半身的策略,并通过对抗机制促进两者之间的协调。

预备知识

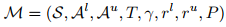

ALMI 采用对抗性训练框架,将上下半身的策略学习建模为一个马尔可夫决策过程(MDP)。该 MDP 定义为

。其中,上下半身共享状态空间S,但具有不同的动作空间Al和Au。奖励函数rl用于鼓励下半身跟踪速度指令,ru用于鼓励上半身跟踪参考运动。状态转移函数

表示在联合动作下转移到下一状态的概率。

本文使用 Unitree H1-2 机器人进行实验,该机器人共有 27 个自由度,策略控制其中 21 个(排除手腕关节)。状态向量包括机器人的本体感知信息(关节位置、速度、基座角速度、重力投影、上一时刻动作)、下半身速度指令、步态相位参数以及上半身参考关节位置。下半身策略输出 12 维动作(腿部关节目标位置),上半身策略输出 9 维动作(肩、肘和腰部关节目标位置)。两者共享状态空间,但通过掩码机制屏蔽不相关的指令信息。

方法

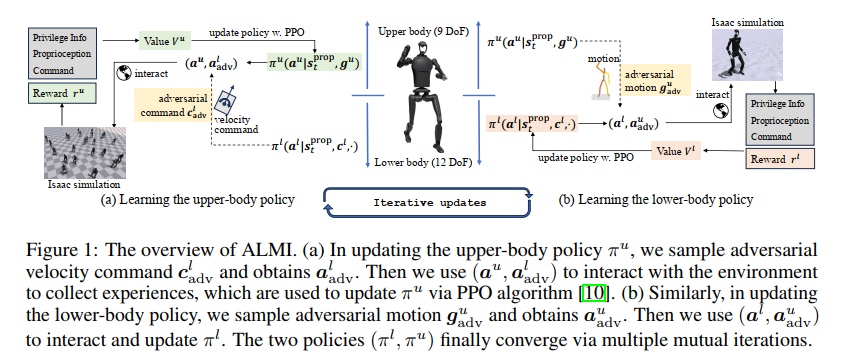

3.1 对抗性学习框架

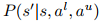

ALMI 的核心思想是通过对抗性训练分别优化下半身运动策略πl和上半身运动模仿策略πu。对于下半身策略的学习,将其建模为一个两人零和马尔可夫博弈:下半身为智能体(agent),上半身为对抗者(adversary)。下半身的目标是最大化运动奖励

而上半身则试图最小化该值函数,即提供干扰以提升下半身的鲁棒性。该博弈存在纳什均衡

类似地,上半身策略的学习也采用对称的博弈形式:

为避免同时优化两对策略带来的计算负担,ALMI 提出一种简化框架:在训练πl时固定πu,但从运动数据集中采样对抗性动作;在训练πu时固定πl,但采样对抗性速度指令。通过将内层优化从参数空间转换为指令空间,显著提高了算法效率。

3.2 下半身的鲁棒运动控制

下半身策略需在受到上半身干扰的情况下仍能稳定跟踪速度指令。为此,ALMI 引入了一种双课程机制(Dual Curriculum Mechanism),根据上半身动作对下半身稳定性的影响程度进行难度分级。具体而言,首先在不施加上半身干扰的情况下训练一个基础运动策略

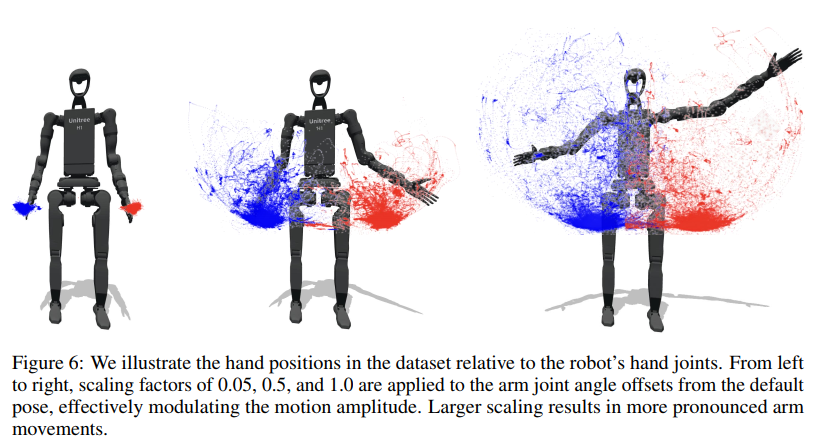

,然后逐步引入来自 AMASS 数据集的运动动作,记录机器人的“生存长度”作为运动难度指标。运动按难度排序后,通过缩放因子

调节动作幅度:

课程机制根据当前策略的抗干扰能力动态调整采样窗口和缩放因子,逐步提升训练难度。

3.3 上半身的运动跟踪

上半身策略需在受到下半身运动干扰的情况下准确跟踪参考运动。ALMI 使用当前训练轮次的下半身策略πl提供对抗性速度指令,上半身则通过最大化运动跟踪奖励进行学习。速度指令的采样范围根据上半身的跟踪误差动态调整,形成一种自适应的课程机制。具体而言,若跟踪误差较小,则扩大速度指令范围以增加干扰强度;反之则缩小范围以降低难度。

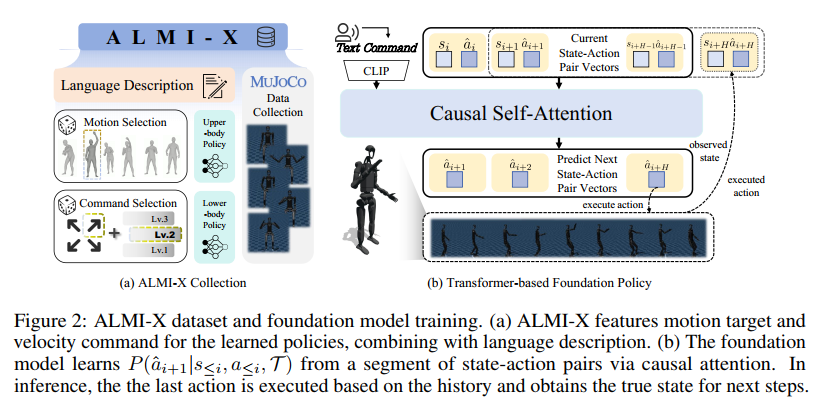

ALMI-X 数据集与基础模型

ALMI-X 是一个大规模全身运动控制数据集,包含超过 8 万条轨迹数据,每条轨迹配有自然语言描述(如“缓慢后退并挥舞左手”)。数据采集通过在 MuJoCo 中运行训练好的 ALMI 策略完成,结合了多样化的上半身动作和全方位下半身指令。数据集经过平衡处理,避免某些动作类别数据过少的问题。

基于 ALMI-X,作者尝试训练一个基于 Transformer 的基础模型,用于实现端到端的语言引导全身控制。该模型以文本指令和历史状态-动作为输入,通过自回归方式预测下一动作,具备较强的实时交互和适应能力。与现有方法(如 UH-1)相比,该模型更注重闭环控制和环境适应性。

相关工作

5.1 人形机器人运动控制

传统方法主要基于轨迹规划和 ZMP 控制,近年来强化学习在步态控制、复杂地形行走、跳跃等任务中取得显著进展。然而,大多数方法仅关注下半身控制,将上半身视为固定负载,或仅学习摆动策略以辅助运动。ALMI 则明确区分上下半身角色,并通过对抗训练提升整体性能。

5.2 人形运动模仿

现有研究通过运动重定向和 RL 优化实现精细运动模仿,但往往难以平衡运动精度和稳定性。ALMI 通过分离上下半身控制并结合对抗机制,在保证运动表现的同时提升系统鲁棒性。

5.3 机器人基础模型

当前视觉-语言-动作模型主要针对固定基座或轮式机器人的操作任务,ALMI-X 则专注于全身控制,涵盖更多自由度且具备更高的可执行性和安全性。

实验

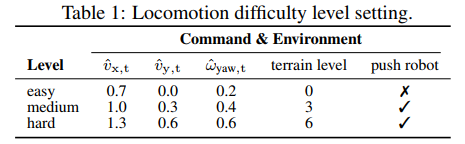

实验在 Isaac Gym 仿真环境和 Unitree H1-2 真实机器人上进行,主要回答以下四个问题:

Q1:ALMI 在速度指令和运动跟踪方面的精度如何?

Q2:ALMI 在复杂场景下的稳定性和鲁棒性如何?

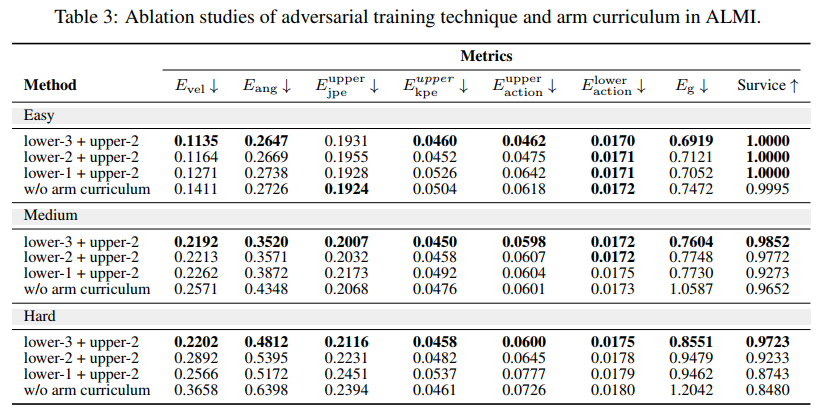

Q3:对抗性迭代训练和课程机制对策略优化有何贡献?

Q4:ALMI 在真实环境中的表现如何?

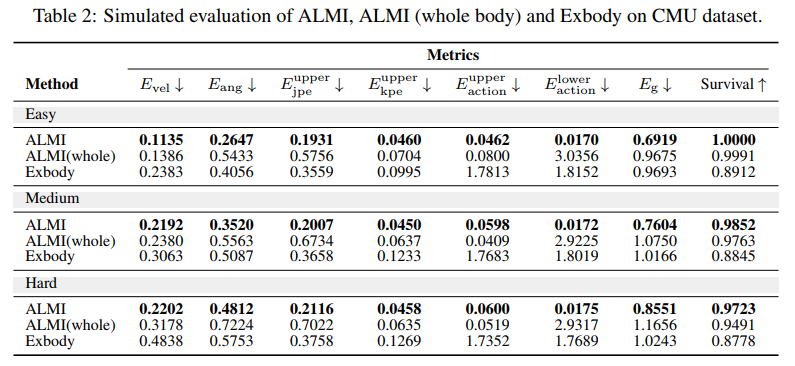

6.1 ALMI 主要结果

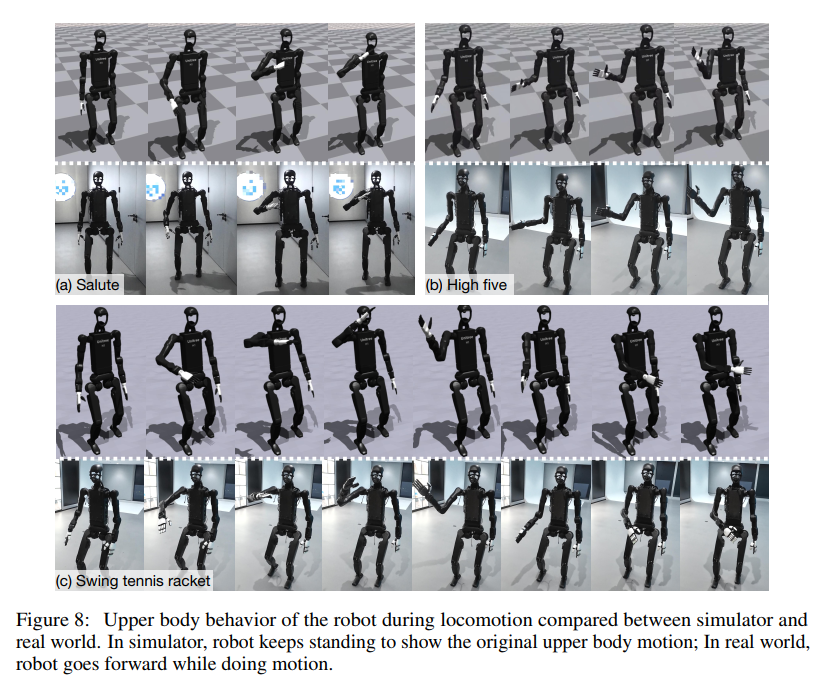

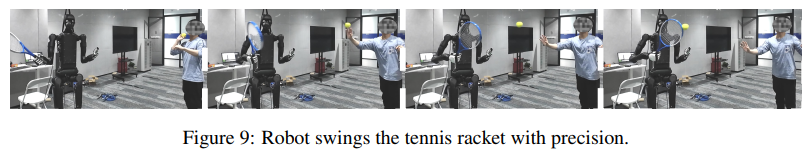

实验结果表明,ALMI 在所有难度级别下均优于基线方法(如 Exbody、ALMI (whole)),在运动跟踪精度、指令跟随能力和抗干扰稳定性方面均表现最佳。特别是在高难度环境下,ALMI 能有效避免摔倒,显示出较强的鲁棒性。

6.2 基础模型结果

基于 ALMI-X 训练的 Transformer 模型在闭环控制设置下表现出良好的指令跟随能力和运动稳定性,但在处理全数据集时性能下降,说明当前模型在处理高度多样化行为时仍存在局限。

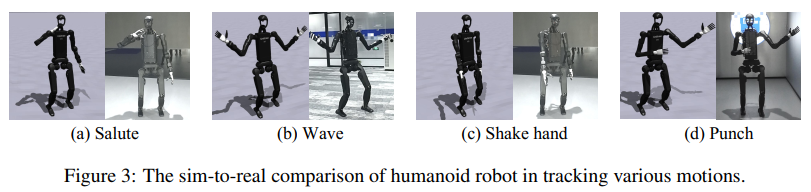

6.3 真实机器人实验

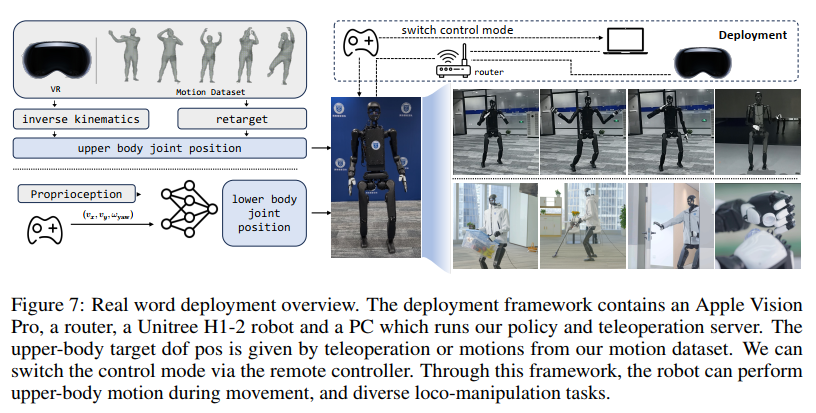

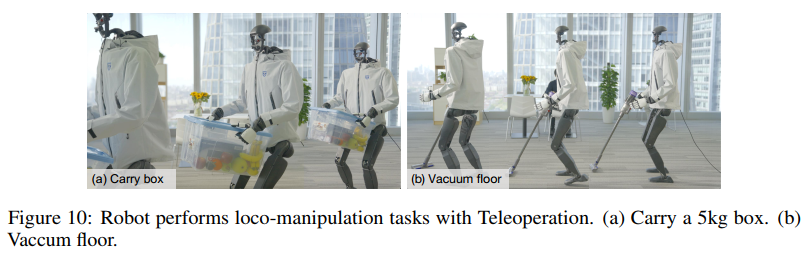

ALMI 策略可直接部署于 Unitree H1-2 机器人,无需额外仿真到真实的适配。通过遥操作系统,机器人能完成移动操作任务(如搬运物体、使用吸尘器),验证了 ALMI 在真实环境中的有效性和实用性。

结论

ALMI 通过对抗性训练和课程学习,实现了人形机器人上下半身的协调控制,兼具运动稳定性和动作表现力。理论分析表明该框架可在马尔可夫博弈下收敛至近似纳什均衡。ALMI-X 数据集的发布为全身控制基础模型的研究提供了重要资源。实验验证了 ALMI 在仿真和真实环境中的优越性能。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-09-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读