A/B 测试:让数据替你说话

原创你好,我是悦创。😊

在做完专题分析后,很多结论要真正落地,还需要一个重要环节——A/B 测试。今天就带你快速了解这个数据驱动决策的神器。

本文分为三部分:

- A/B 测试介绍

- A/B 测试注意事项

- A/B 测试案例

1. A/B 测试到底是什么?

1.1 核心概念

A/B 测试,简单来说就是:把同一类用户随机分到不同版本的产品中(A、B、甚至 A/B/n),通过对比他们的体验数据和业务数据,来判断哪个版本更好。

关键点有三个:

- 用户群一致:样本不能乱,A 组和 B 组必须可比。

- 同一时间对比:不同时间段数据差异很大,不具备可比性。

- 指标体系完整:事先设计好要追踪的数据指标,别临时抱佛脚。

常规流程一般是:

- 数据分析 → 提出优化建议

- 产品经理确认 → 进入 A/B 测试

- 研发&设计 → 开发测试版本

- 自动化采集数据

- 分析师跟进效果,显著性达 95%+ 时即可收尾

上线节奏通常走“灰度发布”:先小规模(5%)放量,再逐步扩展到 50%、100%。这样就能避免“一次性全量上线 → 整体崩盘”的风险。

1.2 常见的两类 A/B 测试

1.2.1 界面设计类

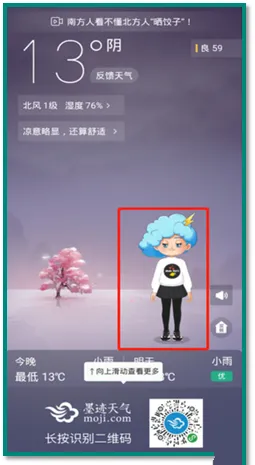

比如墨迹天气曾测试过“是否在界面放一个小人”。结果显示带小人的版本用户数据更好,于是最终上线。

👉 结论:好不好看不重要,数据说了算。

1.2.2 算法策略类

以小红书为例:

- 策略 A:100% 推送用户兴趣内容

- 策略 B:80% 兴趣内容 + 20% 热门推荐

结果发现策略 B 的效果更佳。类似的推荐逻辑,往往需要 10w+ 用户样本才能得出结论。

1.2.3 实际中的“坑”

比如某产品上线短视频功能,2 个月后整体数据上涨。业务方要求分析师证明增长来自短视频。

问题是:没有事先做 A/B 测试,现在根本解释不清。

👉 提醒:A/B 测试要提前做,别等结果出来才后悔。

2. A/B 测试中的注意事项

想做出靠谱的实验,分析师必须留意以下几点:

2.1 保证组间只有一个变量

只有 A/B 组唯一变量不同,结果才可信。

2.2 验证策略是否生效

别光看平台结果,抽样检查实验组用户,确认功能真的上线了。

2.3 指标体系要提前设计

比如:用户数、留存、时长、CTR……以后直接跑报表即可。

2.4 数据要观察一周左右

前 3 天波动大,4~10 天结果才更稳定。

2.5 建立存档,形成闭环

每个实验都要文档化,用 5W1H 方法(是什么、为什么、谁负责、预期&实际效果)。

👉 这样不光能写进述职,还能方便团队复盘。

3. A/B 测试案例

3.1 Netflix 海报测试

Netflix 发现某些海报点击率更高,比如带表情的角色、反派特写、人物少于 3 个的封面。

不同国家用户的偏好差异巨大,因此他们建立了自动化海报生成+测试系统。

👉 这就是数据驱动设计的威力。

3.2 国内产品案例

- 墨迹天气:分享按钮形状通过 A/B 测试定型

- 滴滴:头像小汽车图标,实测提升体验

- 今日头条:广告位放在第 4 位效果最佳

👉 看似细节,其实都影响巨大。

4. 三类角色的思考

- 设计师:别只凭审美,设计要和数据绑定。

- 产品经理:靠直觉不够,A/B 测试帮你更懂用户。

- 数据分析师:别迷信“爆改带来大提升”,更多时候是细微优化,需要长期积累。

小结 & 互动

A/B 测试不是锦上添花,而是产品迭代的必需品。

它能帮助我们降低风险,找到真正有效的优化方案。

👀 现在轮到你了:

你身边有没有见过或参与过 A/B 测试?结果出乎意料吗?

欢迎在评论区分享你的故事!

想获取更多原创数据分析干货,记得关注我的公众号 👉 AI悦创。

我们下节课见!

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录