本地能跑!Ollama现已全面支持DeepSeek R1及衍生蒸馏模型,选择V3还是R1蒸馏模型辅助编程?

本地能跑!Ollama现已全面支持DeepSeek R1及衍生蒸馏模型,选择V3还是R1蒸馏模型辅助编程?

AgenticAI

发布于 2025-03-18 16:31:45

发布于 2025-03-18 16:31:45

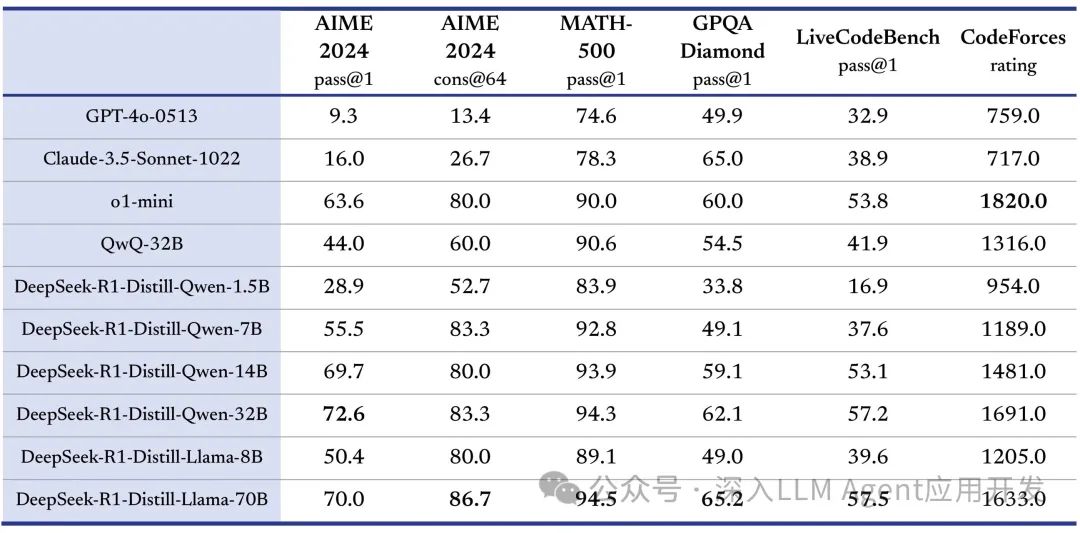

DeepSeek 的第一代推理模型R1在数学、代码和推理任务中实现了与 OpenAI 的 o1 相当的性能!

在开源 DeepSeek-R1-Zero 和 DeepSeek-R1 两个 660B 模型的同时,通过 DeepSeek-R1 的输出,蒸馏了 6 个小模型开源给社区,其中 32B 和 70B 模型在多项能力上实现了对标 OpenAI o1-mini 的效果。

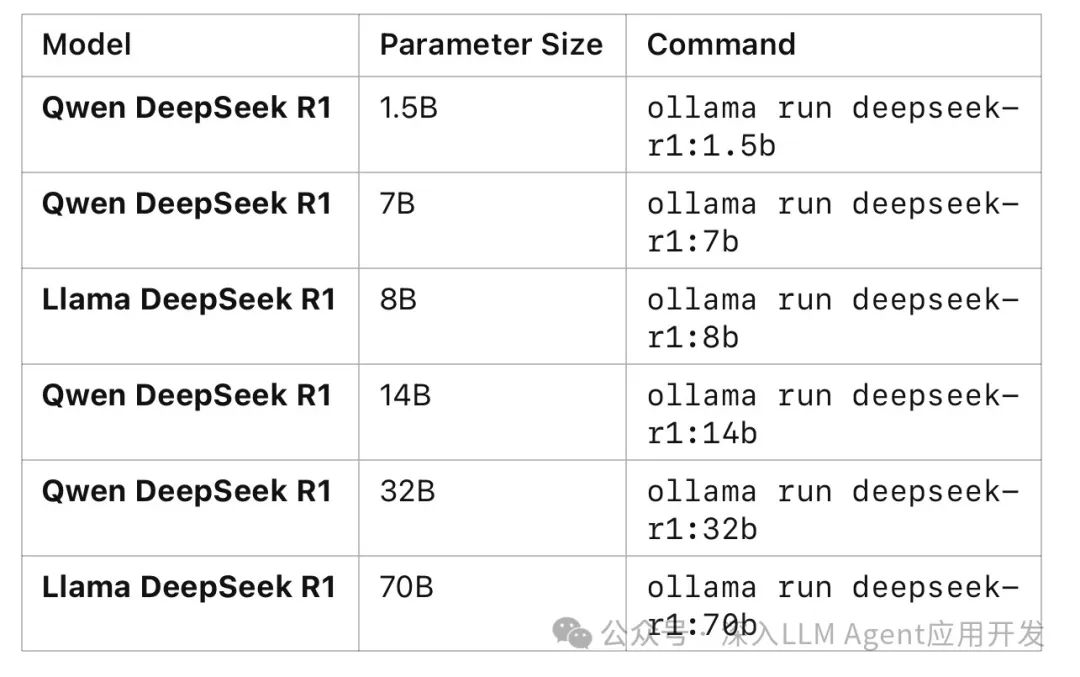

Ollama现已全面支持DeepSeek推理模型系列R1及其蒸馏模型。

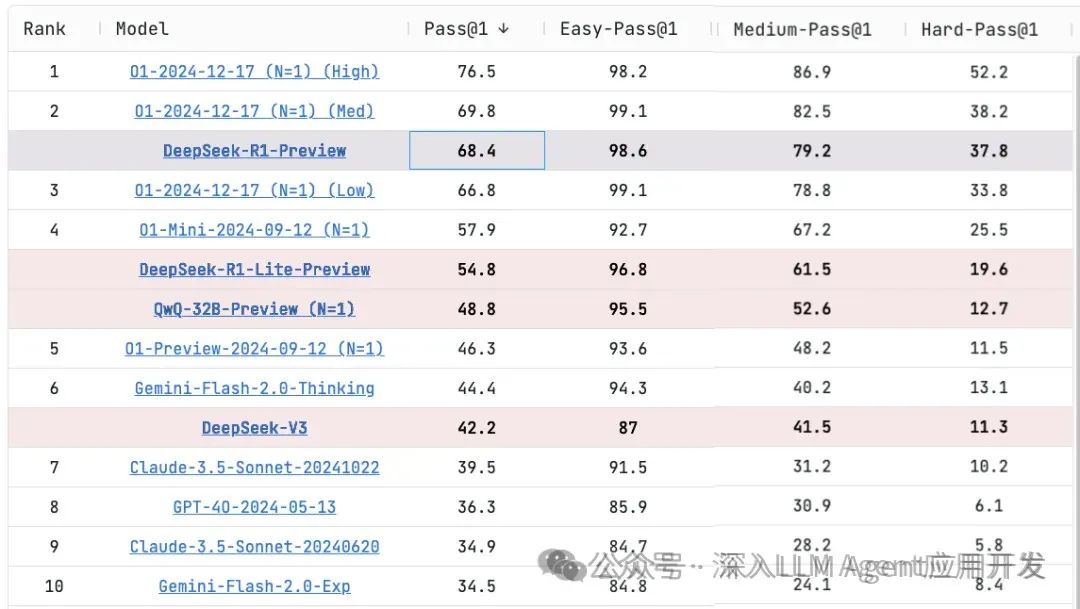

如果你觉得v3在编程方面已经不错,那么桌面替代蒸馏模型是哪个呢?相比较DeepSeek V3,哪个蒸馏模型能够媲美?按照上一篇文章显示的LiveCodeBench评分,DeepSeek V3得分42.2,蒸馏模型Qwen 14B在第一张图中得分53.1,具有相当的性能,而且尺寸相对来说属于桌面级能跑,推荐大家在桌面上使用14B。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-01-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读