ChatGPT|开源大模型Llama3性能匹敌GPT4

ChatGPT|开源大模型Llama3性能匹敌GPT4

用户1904552

发布于 2025-02-27 10:29:50

发布于 2025-02-27 10:29:50

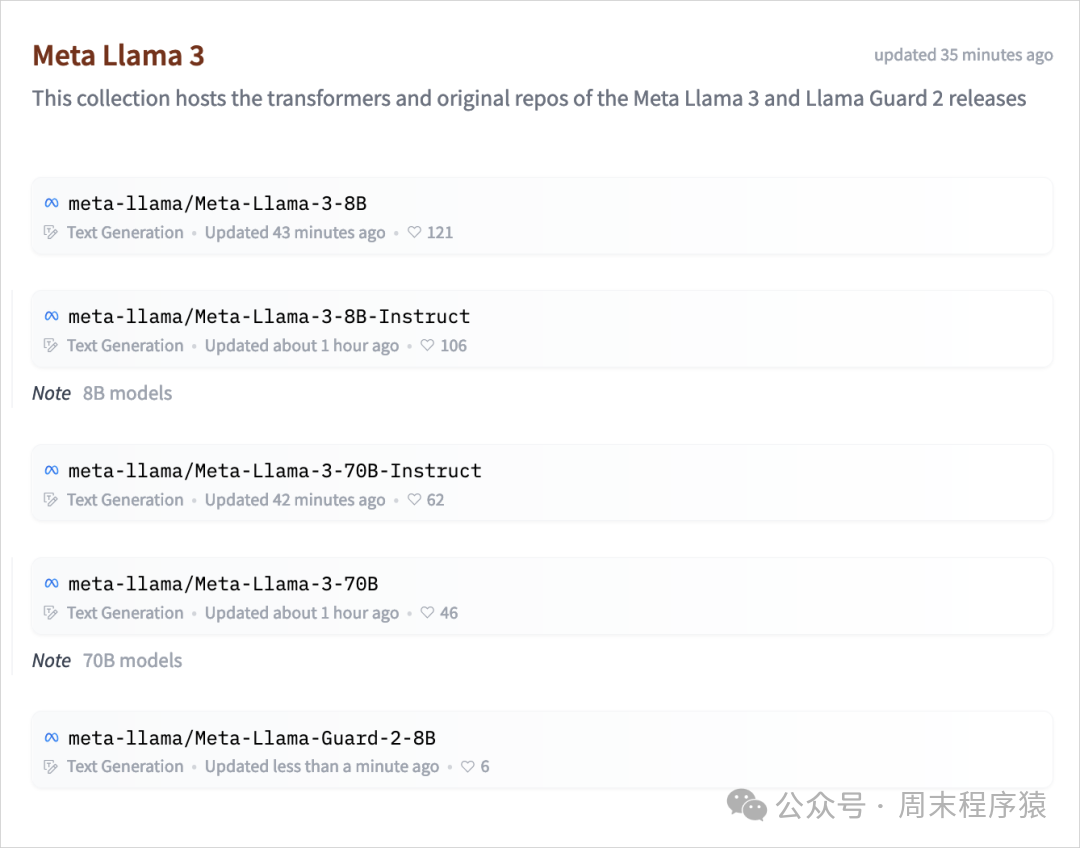

4月18日,Meta正式发布Llama3,开源了包括8B和70B,在多个关键的基准测试中性能优于业界先进同类模型,其在代码生成等任务上实现了全面领先,能够进行复杂的推理,可以更遵循指令。

开源地址

下载链接:https://llama.meta.com/llama-downloads/ Github:https://github.com/meta-llama/

开源地址

体验地址:

(1)https://llama3.replicate.dev/

(2)https://build.nvidia.com/explore/discover#llama3-70b,英伟达在这个平台上提供各种模型,其中包括现在流行的模型,建议收藏

(3)https://huggingface.co/meta-llama/Meta-Llama-3-8B,huggingface地址

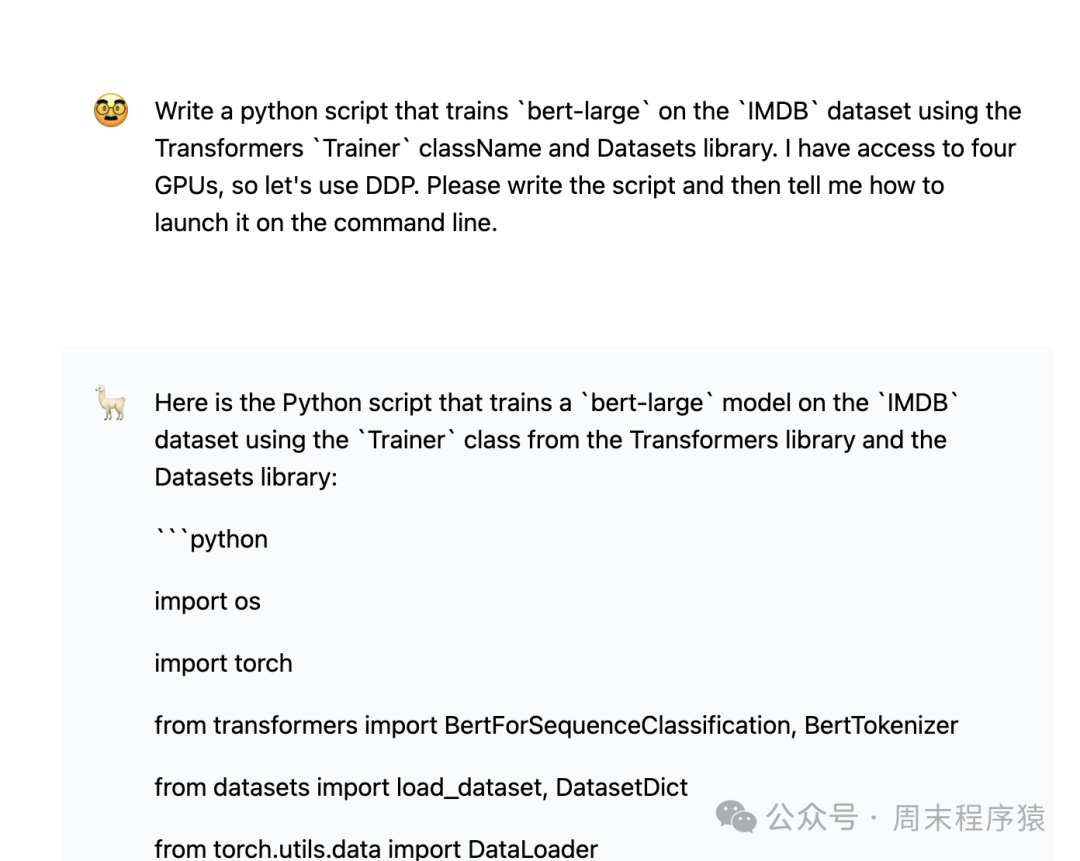

如果有GPU可以尝试自己跑起来:

// 1、clone git代码

// 2、运行llama-3-8b-chat

torchrun --nproc_per_node 1 example_chat_completion.py \

--ckpt_dir Meta-Llama-3-8B-Instruct/ \

--tokenizer_path Meta-Llama-3-8B-Instruct/tokenizer.model \

--max_seq_len 512 --max_batch_size 6

Llama3对比Llama2的改进

- 基于超过 15T token 训练,相当于 Llama 2 数据集的 7 倍还多;

- 支持 8K 长文本,改进的 tokenizer 具有 128K token 的词汇量,可实现更好的性能;

- 在大量重要基准中均具有最先进性能;

- 新能力范畴,包括增强的推理和代码能力;

- 训练效率比 Llama 2 高 3 倍;

- 带有 Llama Guard 2、Code Shield 和 CyberSec Eval 2 的新版信任和安全工具;

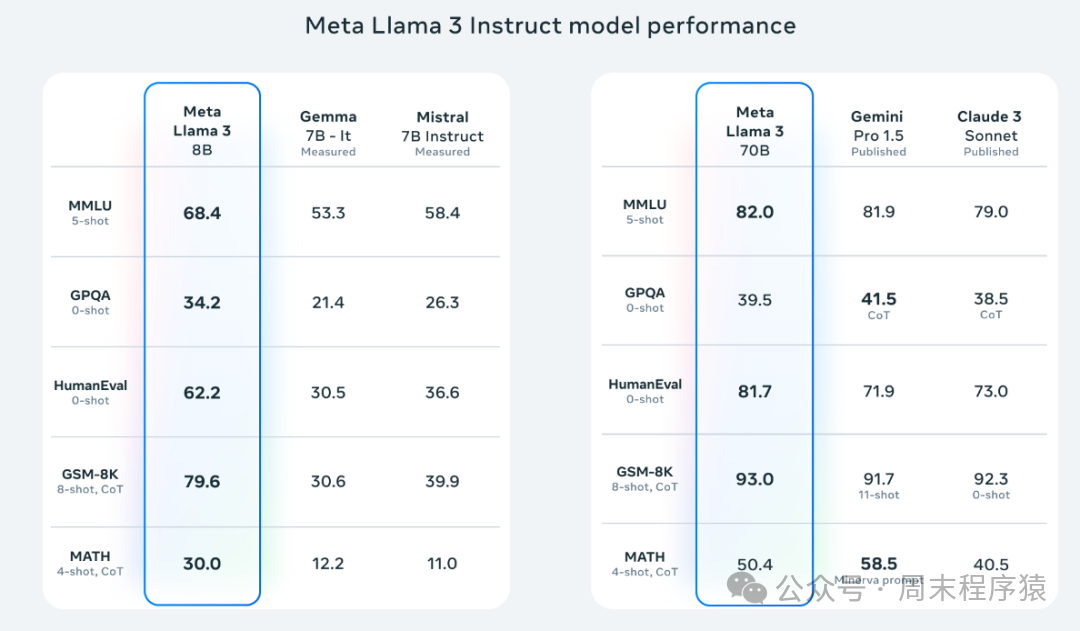

对比各个闭源大模型,Llama3在代码生成、文本摘要、对话、代码搜索等任务中均取得了显著的性能提升:

体验Llama3

用国内可以用的地址:https://llama3.replicate.dev/,体验效果如下:

最后致敬开源社区,如同Llama3生成的诗一样:

开源精神激发创新,

人工智能的民主化,

让所有人参与其中

.....

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2024-04-19,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录