Maestro + Qwen2 + DeepCoderV2:几秒钟生成一个应用程序(本地、快速、一次提示)

Maestro + Qwen2 + DeepCoderV2:几秒钟生成一个应用程序(本地、快速、一次提示)

AI进修生

发布于 2024-12-02 18:50:59

发布于 2024-12-02 18:50:59

Aitrainee | 公众号:AI进修生

🌟Claude Opus智能协调子代理的框架。

https://github.com/Doriandarko/maestro

Hi,这里是Aitrainee,欢迎阅读本期新文章。

本期文章将了解:

📌 革命性的 AI 创建:了解 Maestro 与 Claude-3.5 Sonnet 如何通过单个文本提示使用创新的 AI 代理技术创建桌面应用、Web 应用和游戏。

💰 经济高效的本地 LLMs:使用 DeepSeek Coder 和 Qwen 等本地 LLMs 降低 API 成本,同时保持 Maestro 框架的高性能和灵活性。

⚙️ 分步配置:按照我们的详细指南配置和安装 Ollama 模型、DeepSeek Coder V2 和 Qwen2 72B,确保高效设置 AI 环境。

🎮 创建贪吃蛇游戏:观看使用 HTML、CSS 和 JS 创建贪吃蛇游戏的演示,比较 Claude 和本地模型的结果,展示不同 AI 配置的潜力。

下面进入文字版实操,详情观看上方视频

我们开始:

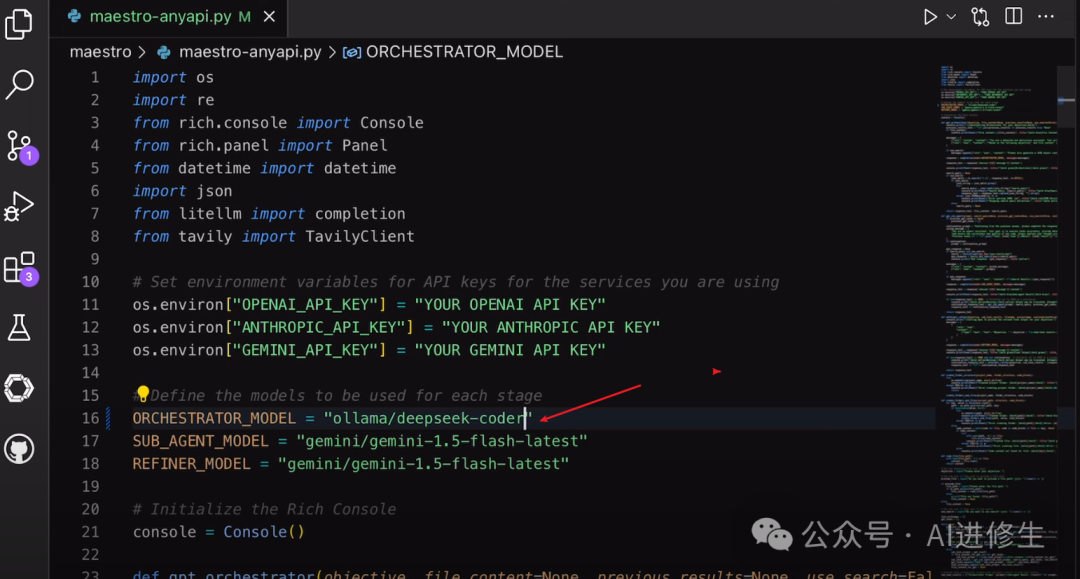

克隆Maestro的仓库并配置API文件。选择DeepSeek Coder V2模型,安装后在终端检查其运行情况。

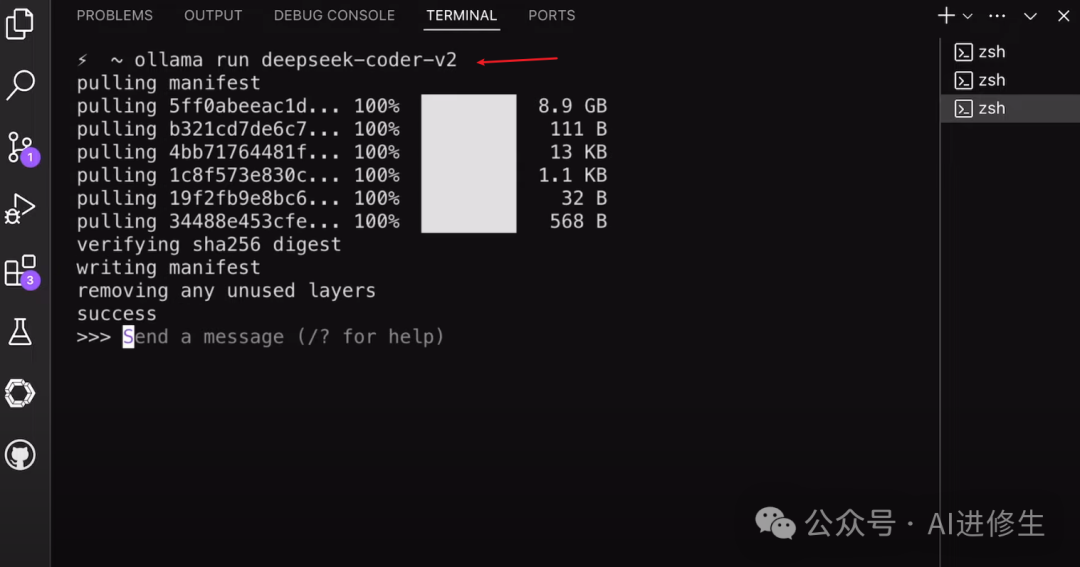

配置完成后,我们开始安装DeepSeek模型。访问Olama网站,选择模型并复制安装命令,粘贴到终端进行安装。安装完成后,发送消息确认其正常运行。

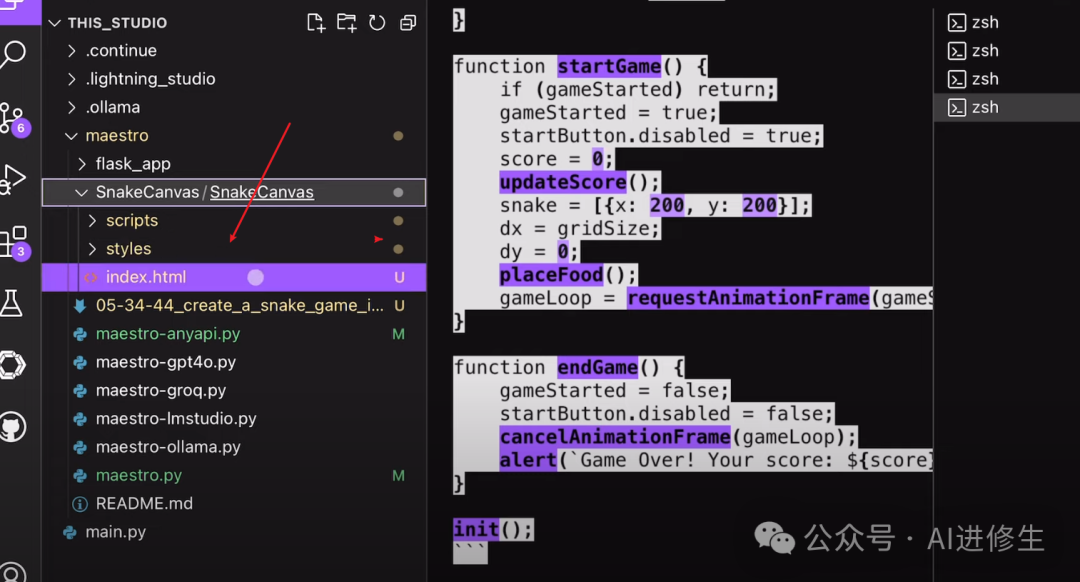

接下来,我们运行命令安装所需的程序包。完成后,我们可以运行程序,尝试用HTML、CSS和JS创建一个贪吃蛇游戏。我之前使用Claude创建同样的游戏效果非常好,让我们看看这次如何。

几分钟后,代码生成完成。虽然文件夹结构正确,但程序无法运行,界面元素显示不全。

这可能是因为DeepSeek Coder不适合处理复杂的代理任务,而Claude在这方面表现更佳。DeepSeek Coder可能更适合纯编码任务,而在处理自然语言提示时表现欠佳。所以我们可以尝试用更好的模型作为主代理和精炼器,如Qwen 72B,只让DeepSeek Coder处理子代理任务。

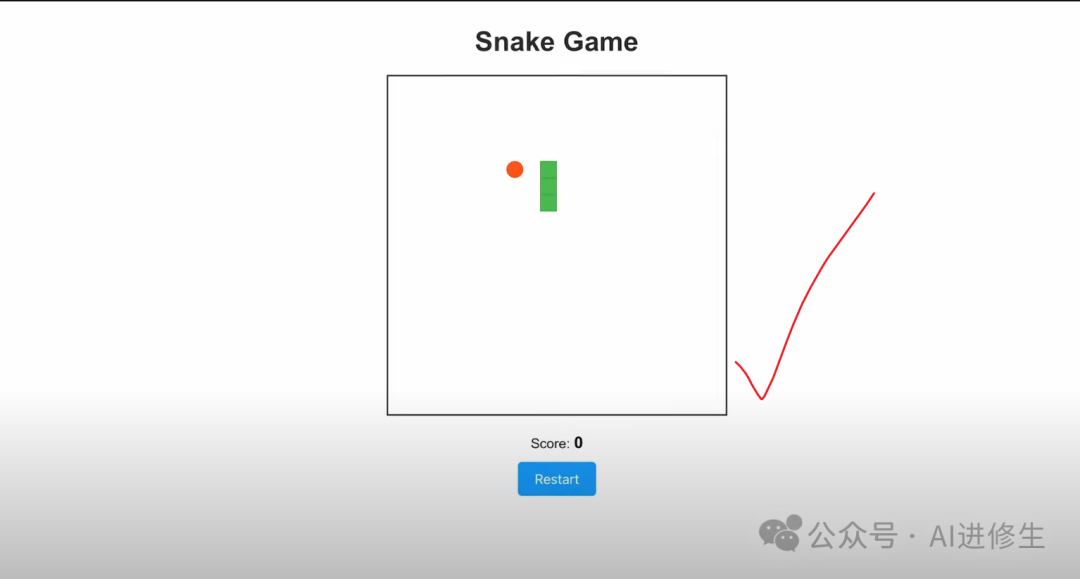

首先安装Qwen2 72B模型,访问Olama网站,选择并安装。确认其运行正常后,修改配置文件,设置Qwen 272B为主代理模型。然后重新尝试相同的提示生成贪吃蛇游戏,等待几分钟后,代码生成完成。这次代码运行正常,界面也显示正确,效果与Claude 3.5相当。

在API文件中,你还可以配置Anthropic、Gemini和OpenAI的模型,使用本地模型或其他提供商的模型作为主模型或子代理。

下面提供官方的文档介绍、相关资源、部署教程等,进一步支撑你的行动,以提升本文的帮助力。

Maestro - 用于Claude Opus、GPT和本地LLM的子代理编排框架

此Python脚本展示了一个使用Anthropic API的AI辅助任务分解和执行工作流程。它利用Opus和Haiku两个AI模型,将一个目标分解成子任务,执行每个子任务,并将结果提炼成一个连贯的最终输出。

新特性:

支持Claude 3.5 Sonnet

python maestro.py兼容多个API

通过使用LiteLLM重新编写代码库,现在可以更轻松地选择您想要的模型。您可以使用Anthropic、Gemini、OpenAI、Cohere等API。

设置API密钥的环境变量

os.environ["OPENAI_API_KEY"] = "YOUR_KEY"

os.environ["ANTHROPIC_API_KEY"] = "YOUR_KEY"

os.environ["GEMINI_API_KEY"] = "YOUR_KEY"定义每个阶段使用的模型

ORCHESTRATOR_MODEL = "gemini/gemini-1.5-flash-latest"

SUB_AGENT_MODEL = "gemini/gemini-1.5-flash-latest"

REFINER_MODEL = "gemini/gemini-1.5-flash-latest"要使用例如GPT-3.5-turbo的模型,只需调整模型定义即可。

首先安装LiteLLM:

pip install litellm运行脚本:

python maestro-anyapi.py支持GPT-4o

脚本已重新设计以支持GPT-4o的代码能力。安装依赖项后,运行:

python maestro-gpt4o.py在本地使用LMStudio或Ollama运行

LMStudio

- 1. 从LMStudio下载应用。

- 2. 使用您的首选方法运行本地服务器。

- 3. 移除任何系统提示以利用脚本提示。

然后执行:

python maestro-lmstudio.pyOllama

通过Ollama平台在本地体验Llama 3的强大功能。

- 1. 从Ollama安装Ollama客户端。

- 2. 安装依赖项:

pip install ollama- 1. 拉取模型:

ollama.pull('llama3:70b')

ollama.pull('llama3:8b')- 1. 运行脚本:

python maestro-ollama.py其他特性

GROQ支持

通过Groq体验更快的响应。安装包:

pip install groq运行脚本:

python maestro-groq.py搜索功能

Claude Opus现在在为子代理创建任务时执行搜索。确保替换您的Tavil API:

tavily = TavilyClient(api_key="YOUR_API_KEY_HERE")支持GPT-4

要使用GPT-4作为编排器,运行:

python maestro-gpt.py主要特性

- • 使用Opus模型将目标分解为可管理的子任务。

- • 使用Haiku模型执行子任务,并利用先前任务的记忆提供上下文。

- • 使用Opus模型将子任务结果提炼为最终输出。

- • 生成详细的交换日志,保存为Markdown文件。

- • 改进的Opus模型提示以更好地评估任务完成情况。

- • 在编码项目中创建代码文件和文件夹。

前提条件

- • 安装Python

- • Anthropic API密钥

- • 必需的Python包:

anthropic和rich

安装

- 1. 克隆存储库或下载脚本文件。

- 2. 安装必需的包:

pip install -r requirements.txt- 1. 替换脚本中的API密钥占位符:

client = Anthropic(api_key="YOUR_API_KEY_HERE")若使用搜索功能,替换Tavil API:

tavily = TavilyClient(api_key="YOUR_API_KEY_HERE")使用

- 1. 打开终端并导航到脚本所在目录。

- 2. 运行脚本:

python maestro.py- 1. 在提示时输入您的目标:

Please enter your objective: Your objective here脚本将分解任务并显示进度和结果。

代码结构

主要功能:

- •

opus_orchestrator(objective, previous_results=None): 分解目标。 - •

haiku_sub_agent(prompt, previous_haiku_tasks=None): 执行子任务。 - •

opus_refine(objective, sub_task_results): 将结果提炼为最终输出。

循环持续进行直到目标完成,然后提炼结果并保存日志。

自定义

- • 调整

client.messages.create()中的max_tokens参数以控制生成的最大token数量。 - • 根据需要更改模型。

- • 使用

rich库修改控制台输出。 - • 自定义交换日志格式。

Flask应用集成

我们添加了一个Flask应用,以提供用户友好的界面。

设置和运行

- 1. 确保安装Flask:

pip install Flask- 1. 导航到Flask应用目录。

- 2. 运行应用:

python app.py- 1. 在浏览器中访问

http://localhost:5000/。

界面功能

- • 输入目标的表单。

- • 显示结果的区域。

- • 基础样式以提高可读性。

更新的运行说明

- 1. 导航到

flask_app目录。 - 2. 启动服务器:

python app.py- 1. 访问

http://localhost:5000/。

此更新增强了可用性,通过Web界面提供了使用Maestro框架的直观方式。

希望这篇文章对你有帮助,感谢阅读!

视频教程

AlCodeKing:https://www.youtube.com/watch?v=gCOrT54tL0Y

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2024-06-26,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录