突破最强算法模型,回归!!

突破最强算法模型,回归!!

Python编程爱好者

发布于 2023-12-18 18:48:44

发布于 2023-12-18 18:48:44

核心点:答读者问,关于回归类的 9 个问题 !!

哈喽,我是Johngo~

已经有一段时间,私信快炸了,太多同学的问题,实在回复不过来。

然后这几天把所有的问题,摘取了出来,进行了分类。

当然,还会不断的更新添加进去。因此,也开了一个新的专题。

咱们先来第一期:突破最强算法模型 - 回归类!!

老规矩:大家伙如果觉得近期文章还不错!欢迎大家点个赞、转个发~

咱们一起来看看,大家也可以在后台补充~

# 关于数据标准化/归一化

读者问:“我听说在某些回归算法中,如岭回归和LASSO,数据标准化或归一化非常重要。但是,我不太清楚什么时候以及为什么需要进行这些步骤。方便大概解释一下吗?”

大壮答:数据标准化和归一化是在回归算法中常用的预处理步骤,特别是在岭回归和LASSO等正则化算法中。

这些步骤旨在确保数据的尺度一致,有助于提高模型的性能和稳定性。

下面详细阐述为什么以及何时需要进行数据标准化或归一化:

为什么需要数据标准化或归一化?

- 尺度不一致的问题: 在回归问题中,不同特征通常具有不同的尺度和范围。例如,一个特征的取值范围可能是0到1,而另一个可能是0到100。这种尺度不一致可能导致模型对于具有较大尺度的特征更为敏感,影响模型的性能。

- 梯度下降优化算法: 对于基于梯度下降的优化算法,如岭回归和LASSO,尺度不一致可能导致算法收敛缓慢或不稳定。这是因为不同特征的梯度值可能差异很大,使得优化过程难以找到全局最优解。

- 正则化项的影响: 岭回归和LASSO等正则化算法引入了惩罚项,这些项对特征的系数进行约束。如果特征具有不同的尺度,惩罚项的影响也会不同,从而导致模型对于某些特征更为偏向或偏离。

何时需要数据标准化或归一化?

- 使用基于距离的算法: 如果你的回归算法是基于距离的,如K最近邻(K-Nearest Neighbors),那么尺度不一致会导致距离计算的不准确性。在这种情况下,标准化或归一化是必要的。

- 使用梯度下降优化算法: 岭回归和LASSO等正则化算法通常使用梯度下降来最小化损失函数。在这种情况下,数据标准化或归一化有助于加速收敛过程,确保算法更快地找到最优解。

如何进行数据标准化或归一化?

- 标准化(Z-score标准化): 将每个特征的值减去均值,然后除以标准差。公式:

其中,

是原始特征值,

是均值,

是标准差。

- 归一化(Min-Max归一化): 将每个特征的值缩放到一个指定的范围,通常是0到1。公式:

其中,

和

分别是特征的最小值和最大值。

注意点和一点建议:

- 在训练集上进行标准化/归一化:使用训练集的统计信息(均值和标准差,或最小值和最大值)来进行标准化或归一化,然后将相同的变换应用于测试集和实际应用中的数据。

- 避免信息泄露:不要在整个数据集上计算均值和标准差,以免引入信息泄露。在拆分数据集前,只使用训练集的统计信息。

- 根据具体情况选择方法:标准化和归一化的选择取决于问题的特性。在某些情况下,一种方法可能比另一种更适用。

总的来说,数据标准化或归一化对于提高回归模型性能和稳定性非常重要,特别是在使用正则化算法时。需要仔细捉摸。

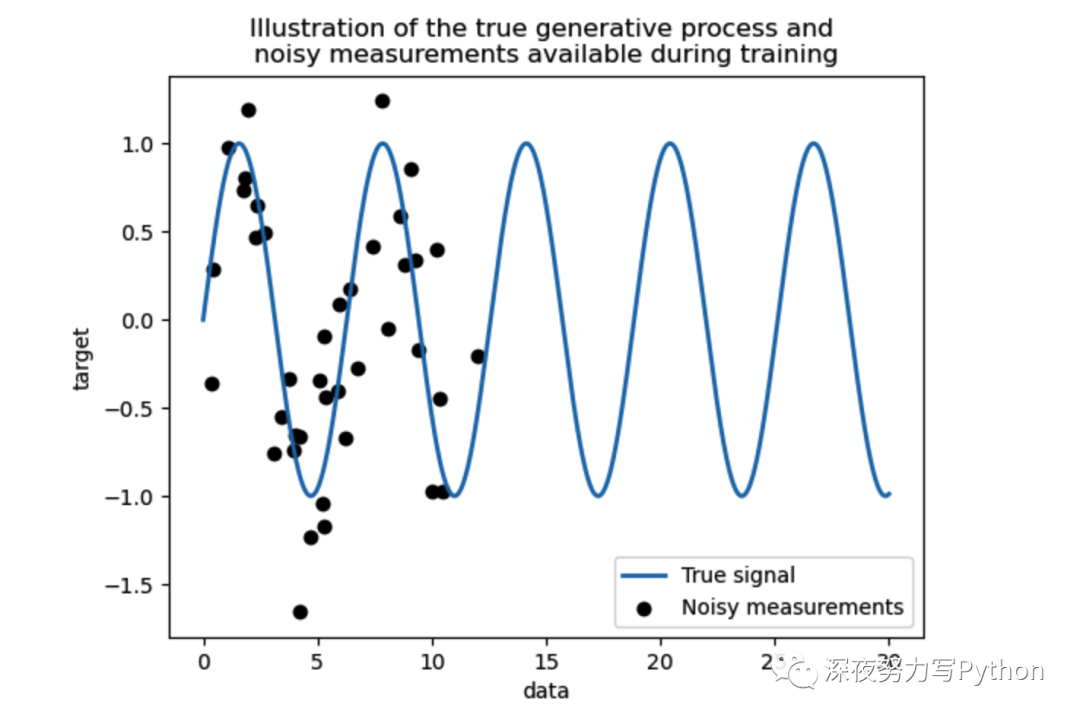

# 处理非线性关系

读者问:“如果我的数据中的变量间关系不是线性的,我应该怎么办?我听说过多项式回归和变换方法,比如对数变换,但不太明白它们是如何应用的。”

大壮答:当数据中的变量间关系不是线性的时候,线性回归模型可能无法很好地拟合数据。

在这种情况下,你可以考虑使用多项式回归或进行变换(如对数变换)来捕捉非线性关系。

下面详细阐述这两种方法:

1. 多项式回归

多项式回归通过引入原始特征的高次幂,将线性模型扩展到非线性关系。

例如,对于一个特征

,多项式回归可以考虑添加

、

等项。

对于一元多项式回归(二次多项式):

对于多元多项式回归:

关键点

- 防止过拟合: 高次项的引入可能导致过拟合,因此需要谨慎选择多项式的次数。

- 选择最佳次数: 可以使用交叉验证或学习曲线来选择最合适的多项式次数。

- 特征缩放: 在使用多项式回归前,通常需要进行特征缩放,确保不同特征的尺度一致。

2. 变换方法(对数变换等)

变换方法通过对原始数据进行某种数学变换,使数据更符合线性关系。对数变换是其中一种常见的方法,尤其适用于数据呈指数增长的情况。

对数变换:

关键的几点:

- 对数变换的条件: 适用于正数数据,特别是在数据存在指数增长趋势时。

- 恢复变换后的预测值: 对数变换后的预测值需要通过指数函数进行逆变换,以获得原始的预测值。

注意点和一些建议:

- 探索性数据分析(EDA): 在应用多项式回归或变换方法前,进行探索性数据分析以了解数据的分布和特性。

- 尝试不同方法: 在处理非线性关系时,尝试多项式回归和变换方法,并根据模型性能选择最适合的方法。

- 注意异常值: 非线性关系的发现可能受到异常值的影响,因此在进行建模前要处理异常值。

- 模型评估: 使用适当的评估指标(如均方误差、R平方等)来评估模型性能,确保选择的方法在测试数据上也表现良好。

总体而言,当数据关系非线性时,多项式回归和变换方法是常见的处理手段,但在使用它们时需要谨慎选择并进行适当的模型评估。

# 缺失数据的处理

读者问:“在我的数据集中有一些缺失值。我应该如何处理这些缺失数据?直接删除含有缺失值的记录是否是一个好主意,还是有其他更好的方法?”

大壮答:处理缺失数据是数据预处理中非常重要的一步,因为缺失值可能影响模型的性能和准确性。直接删除含有缺失值的记录是一种处理缺失数据的简单方法,但并不总是最佳选择。

下面是一些处理缺失数据的常见方法:

1. 删除含有缺失值的记录

直接删除含有缺失值的记录是一种简单而直观的方法,特别是当缺失值的比例相对较小时。

- 影响样本量: 删除记录可能会减少样本量,从而降低模型的训练效果。

- 样本偏倚: 如果缺失数据并非随机分布,而是与某些特征或结果有关,删除可能导致样本偏倚。

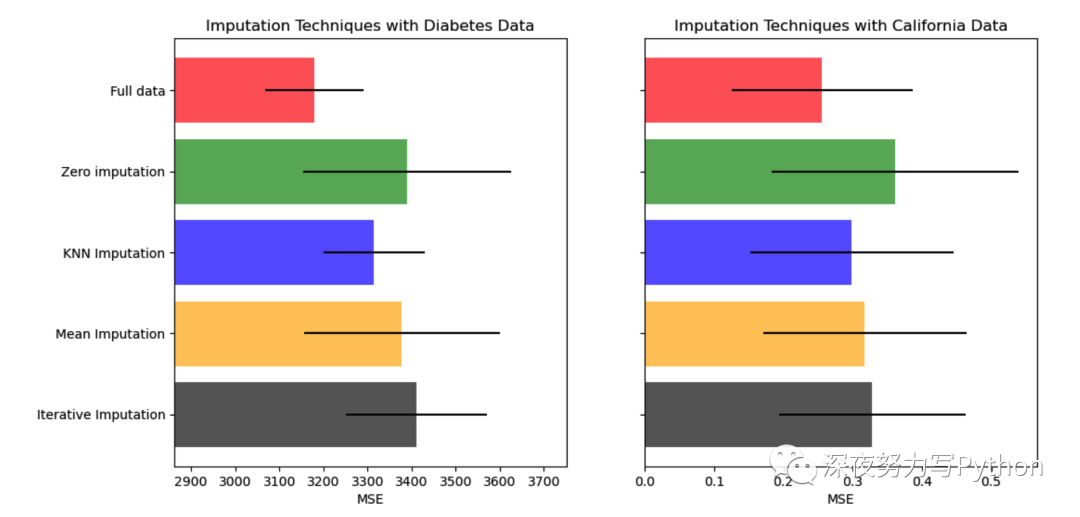

2. 插补缺失值

插补缺失值是通过某种方法估算缺失值,以保留数据记录并减少信息损失。

所用到的方法有:

- 均值/中位数/众数插补: 用特征的均值、中位数或众数来替代缺失值。

- 回归模型插补: 使用其他特征建立回归模型,预测缺失值。

- K近邻插补: 基于相似性选择最近邻居的值来插补缺失值。

还有需要注意的关键点:

- 插补方法的选择: 根据数据的性质选择适当的插补方法。

- 潜在偏见: 插补可能引入潜在的偏见,因此需要小心使用。

3. 使用特殊值表示缺失

将缺失值用特殊值(如NaN、-9999)表示,保留原始数据的完整性。

适用情境: 适用于某些模型能够处理缺失值的情况,例如决策树和随机森林。

4. 多重插补

使用多个模型进行多次插补,以获取不同插补数据集,并在分析中考虑不确定性。

多重插补(Multiple Imputation): 利用统计方法多次生成不同插补数据集,然后基于这些数据集进行分析。

需要注意的关键点:

- 复杂度: 多重插补的实施相对复杂,需要谨慎使用。

- 不确定性考虑: 可以考虑缺失数据的不确定性,提高模型结果的可信度。

一点建议:

- 理解缺失机制: 理解缺失数据的生成机制有助于选择合适的处理方法。

- 评估处理方法: 在应用缺失数据处理方法前后,评估模型的性能以确保所选方法的有效性。

- 灵活使用方法: 根据数据的特点和缺失情况,可能需要结合多种方法进行处理。

在实际应用中,最佳的处理方法取决于数据的性质以及缺失值的分布和原因。最好的做法是综合考虑数据集的特点,选择最适合问题的缺失数据处理方法。

# 异常值的识别和处理

读者问:“我怎样才能识别出数据中的异常值?发现异常值后,应该如何处理?我是否应该总是移除它们?”

大壮答:常见的异常值检测方法:

1. 基于统计的方法:

- Z-Score: 计算每个数据点与平均值的标准偏差之间的关系。通常,超过某个阈值(例如3)的数据点被认为是异常值。

- IQR(四分位数范围): 计算数据的四分位数(Q1和Q3),然后通过IQR来定义异常值的范围。

2. 基于机器学习的方法:

- 孤立森林(Isolation Forest): 利用树结构识别异常值,因为异常值在树结构中通常需要更短的路径来被孤立。

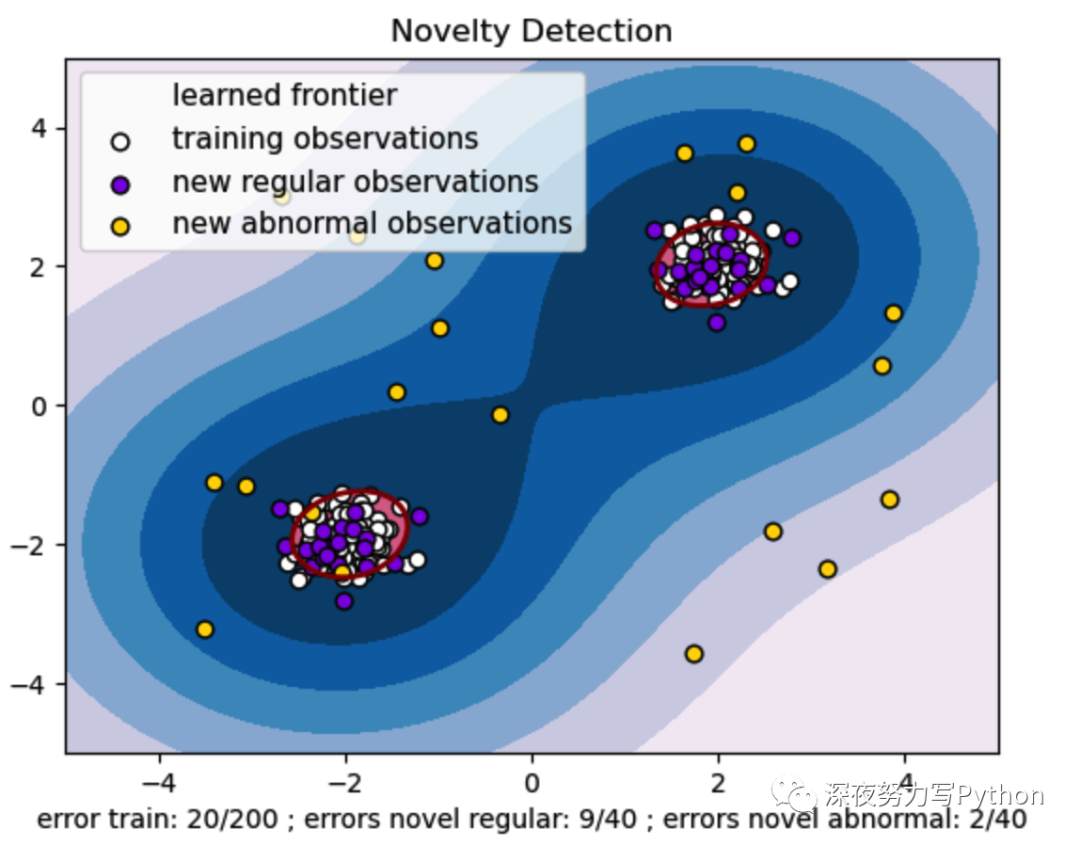

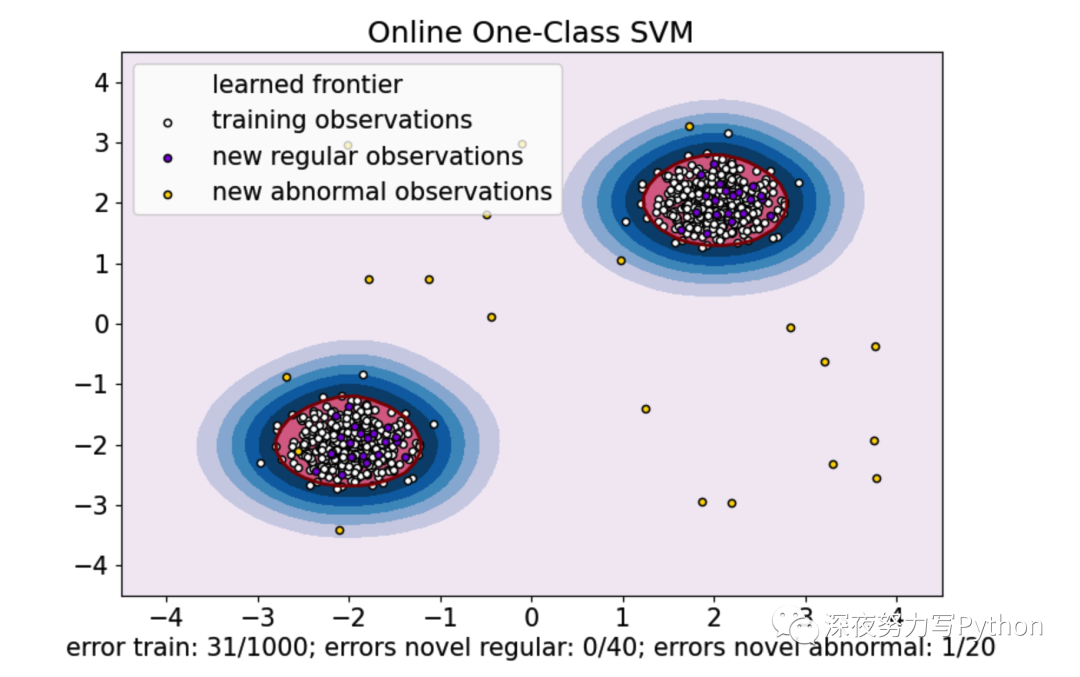

- One-Class SVM: 使用支持向量机来区分正常数据和异常数据。

3. 可视化方法:

- 散点图、箱线图等: 通过可视化工具直观查看数据的分布,识别离群点。

2. 可能的处理方式:

a. 移除异常值:

- 删除记录: 直接删除包含异常值的记录。

- 修剪数据: 将异常值截断到某个范围内。

关键点:

- 删除异常值可能导致信息损失,尤其是当异常值反映了数据的真实特性时。

- 谨慎选择移除策略,避免对结果产生负面影响。

b. 变换数据:

- 取对数: 对数变换可以使数据更对称,有助于减小异常值的影响。

- Box-Cox变换: 一种可调整的变换方法,可以处理不同类型的数据。

关键点:

- 变换可能改变数据的解释性,需要谨慎选择。

c. 用中位数或平均值替代:

- 使用整体数据的中位数或平均值替代异常值。

关键点:

- 替代可能使数据变得更平滑,但可能掩盖真实的异常情况。

d. 使用鲁棒模型:

- 使用鲁棒模型,如鲁棒回归,对异常值更具鲁棒性。

关键点:

- 鲁棒模型能够减弱异常值对模型的影响。

注意点和建议:

- 了解数据背景: 了解数据的领域和背景,有助于确定哪些数据点可能是真实的异常,哪些可能是错误的记录。

- 多重检测方法: 结合多种异常值检测方法,以提高检测准确性。

- 谨慎处理异常值: 异常值可能包含重要信息,因此在处理时需要仔细考虑。

- 验证处理效果: 处理异常值后,验证模型在测试数据上的性能,确保处理不会对模型产生负面影响。

总体而言,异常值的处理取决于数据的特性以及对模型性能的影响。谨慎选择处理方法,并在处理后评估模型的效果。不是总是移除异常值,而是根据具体情况综合考虑不同的处理方式。

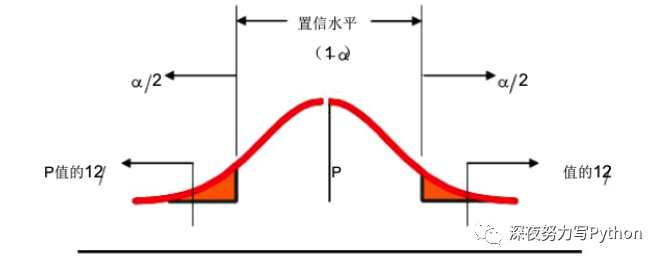

# 理解p值和置信区间

读者问:“在回归分析中,模型系数的p值和置信区间有什么作用?如果p值很高,这意味着什么?”

大壮答:在回归分析中,模型系数的p值和置信区间是我们评估模型的重要工具,它们提供了关于模型参数估计的不确定性和显著性的关键信息。

1. 模型系数的p值

作用: p值用于检验一个模型系数是否显著不同于零,也就是该变量对响应变量是否有显著影响。

原理: 在假设检验中,p值表示在零假设成立的情况下,观察到当前统计量或更极端统计量的概率。零假设通常是模型系数等于零,而备择假设是模型系数不等于零。

2 个关键点:

- 小于显著性水平(通常为0.05): 如果p值小于设定的显著性水平,通常是0.05,我们有足够的证据拒绝零假设,即认为模型系数是显著的。

- 大于显著性水平: 如果p值很高,大于显著性水平,我们可能无法拒绝零假设,即认为模型系数不显著。

2. 置信区间

作用: 置信区间提供了对模型系数的估计范围,表示我们对真实模型系数的不确定性。

原理: 置信区间是一个区间估计,通常表示在给定置信水平下,我们对模型系数的估计在某个区间内。

2 个关键点:

- 置信水平: 通常使用95%的置信水平,表示我们对真实模型系数在置信区间内的信心水平。

- 包含零点: 如果置信区间包含零点,说明我们不能排除模型系数等于零的可能性。

下面,解释一下 p 值很高的情况:

如果某个模型系数的p值很高,这意味着我们缺乏足够的证据拒绝零假设,即该模型系数不显著。

可能有几种解释:

- 变量对响应变量没有显著影响: 这个变量在这个模型中可能不是一个重要的预测因子。

- 样本量不足: p值受样本量影响,较小的样本可能导致p值较高。

- 存在共线性: 高度相关的自变量可能导致模型系数估计的不准确性,使得p值升高。

综合考虑p值和置信区间可以帮助我们更全面地了解模型参数估计的可靠性和显著性。同时,要注意不仅仅依赖于p值的二元判定,而应该结合置信区间和实际问题进行全面解释。

# 多重共线性的诊断和解决

读者问:“我听说多重共线性是多元回归中的一个问题。我该如何检测和处理它?使用方差膨胀因子(VIF)是解决这个问题的正确方法吗?”

大壮答:当我们在进行多元回归分析时,多重共线性是一个需要关注的问题。多重共线性指的是自变量之间存在高度线性相关性的情况,可能导致模型不稳定、参数估计不准确。那么,如何检测和处理多重共线性呢?

一个常用的工具是方差膨胀因子(VIF)。VIF测量了一个自变量与其他自变量之间的线性相关性程度。VIF值越高,说明自变量与其他自变量的关联性越强。通常来说,VIF超过10可能表示存在严重的多重共线性,而超过5也被认为是有问题的。

检测多重共线性步骤:

- 计算VIF: 对每个自变量计算VIF值,使用以下公式:

这里,

是将第

个自变量作为因变量,用其他自变量拟合得到的决定系数。

- 评估VIF值: 检查VIF值,如果发现某些自变量具有较高的VIF,表示存在多重共线性的可能性。

处理多重共线性的方法:

- 删除相关性强的变量: 如果两个或多个自变量之间存在高度相关性,可以考虑删除其中之一。

- 合并相关性强的变量: 将相关性强的自变量进行组合,生成一个新的变量。

- 使用正则化方法: 岭回归(Ridge Regression)和LASSO回归(Least Absolute Shrinkage and Selection Operator)是正则化方法,可以有效减缓多重共线性的影响。

- 增加样本量: 增加样本量有助于缓解多重共线性的问题。

关于VIF,虽然是一种常用的检测方法,但并不是唯一的。同时,它提供的是共线性的迹象,而不是直接证据。因此,在处理多重共线性时,需要结合其他方法和领域知识,以全面评估模型的健壮性。

# 选择适当的模型复杂度

读者问:“在构建回归模型时,我该如何选择合适的模型复杂度?比如,在使用多项式回归时,我应该如何决定多项式的阶数?”

大壮答:在构建回归模型时选择适当的模型复杂度至关重要,因为它直接影响模型的拟合能力和泛化性能。对于多项式回归,决定多项式的阶数是一个关键的选择。

下面是一些建议:

选择模型复杂度的步骤:

- 理解数据: 首先,深入了解你的数据。了解数据的分布、特征之间的关系以及可能的非线性模式。

- 绘制学习曲线: 通过绘制学习曲线,观察模型在训练集和验证集上的表现。随着模型复杂度的增加,你可能会看到训练集误差降低,但验证集误差升高,这是过拟合的迹象。

- 交叉验证: 使用交叉验证来评估模型的性能。通过在不同的训练集和验证集上进行多次训练和测试,获取更稳健的性能评估。

对于多项式回归:

- 尝试简单的模型: 从简单的模型开始,比如线性回归,了解基本趋势。

- 尝试不同阶数: 逐步增加多项式的阶数,观察模型的性能如何变化。但要小心过度拟合。

- 观察学习曲线: 绘制学习曲线,观察训练集和验证集上的表现。找到一个平衡点,使得模型在训练和验证中都有好的表现。

注意点和一些建议:

- 防止过拟合: 高阶多项式可能导致模型过度拟合训练数据,但在未见过的数据上表现不佳。选择适当的复杂度以避免过拟合。

- 使用正则化: 如果发现模型过拟合,可以考虑使用正则化方法,如岭回归(Ridge Regression)或LASSO回归,来限制模型参数的大小。

- 领域知识: 考虑问题的领域知识。有时,专业知识能够指导模型选择更合适的复杂度。

- 综合考虑: 选择合适的模型复杂度是一个平衡问题,需要综合考虑模型的偏差和方差。

总体而言,选择适当的模型复杂度是一项挑战,需要通过实验和经验不断调整。观察模型的表现,借助学习曲线和交叉验证,找到适合问题的最佳模型复杂度。

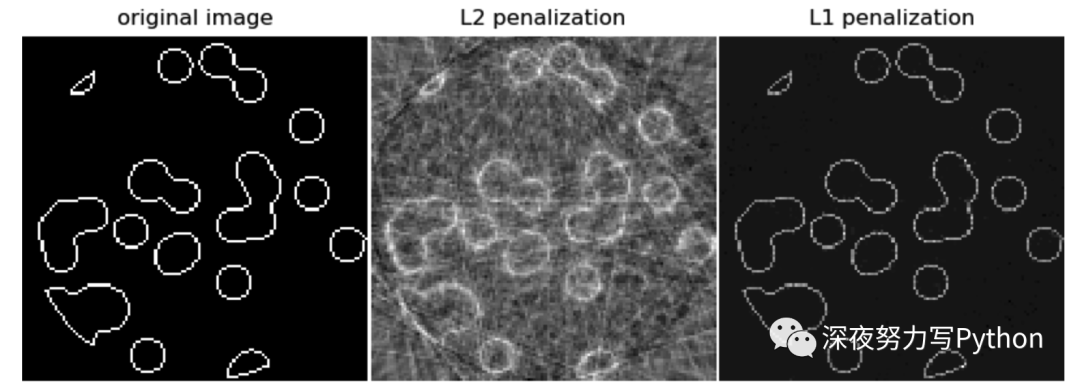

# 区分L1和L2正则化

读者问:“L1(LASSO)和L2(岭回归)正则化有什么区别?它们是如何影响回归模型的?”

大壮答:当谈到L1正则化(LASSO)和L2正则化(岭回归)时,我们实际上是在讨论在回归模型中引入的两种不同的正则化技术。

下面聊一聊,大家一起深入了解它们的区别和对回归模型的影响。

1. 区别

a. 正则化项的形式:

- L1正则化(LASSO): 使用的是模型参数的绝对值之和(L1范数)作为正则化项。

- L2正则化(岭回归): 使用的是模型参数的平方和的平方根(L2范数)作为正则化项。

b. 特征选择:

- L1正则化(LASSO): 具有特征选择的效果,可以使得某些模型参数变为零,实现稀疏性,即减少不重要的特征。

- L2正则化(岭回归): 一般不会将模型参数压缩到零,对所有特征都进行缩放。

c. 解的稳定性:

- L1正则化(LASSO): 在某些情况下,可能导致解不稳定,因为正则化项的形状使得某些参数在特定条件下可能变为零。

- L2正则化(岭回归): 通常对参数施加平滑约束,更容易得到稳定的解。

2. 影响回归模型的方式

a. 参数收缩:

- L1正则化(LASSO): 可以将某些模型参数缩小到零,实现特征选择,剔除不重要的特征,从而降低模型复杂度。

- L2正则化(岭回归): 缩小了所有模型参数,但很少使其变为零。通过减小参数的幅度,岭回归有助于处理共线性问题。

b. 模型复杂度:

- L1正则化(LASSO): 更倾向于生成稀疏模型,适用于特征较多,但只有少数对目标变量有显著影响的情况。

- L2正则化(岭回归): 平滑参数,有助于处理多重共线性,适用于特征间关联较强的情况。

3. 注意点和一些建议

- 超参数调整: 选择合适的正则化强度参数((\lambda))很重要,通常通过交叉验证来确定。

- 问题特征: 根据问题特征的性质选择正则化方法。如果认为只有少数特征对问题有贡献,可以考虑使用L1正则化(LASSO)。

- 综合考虑: 有时候,也可以同时使用L1和L2正则化,称为弹性网络(Elastic Net),以综合利用它们的优势。

总的来说,L1和L2正则化是在回归模型中用于控制模型复杂度的有效手段,选择取决于具体问题和数据的性质。

# 模型评估指标

读者问:“在评估回归模型时,我应该关注哪些评估指标?比如R², MSE, RMSE有什么不同?”

大壮答:在评估回归模型时,我们通常关注多个评估指标,它们能够提供关于模型性能和拟合程度的不同方面的信息。

R²(决定系数)、MSE(均方误差)、RMSE(均方根误差)是其中一些常见的指标,下面咱们聊一聊他们的不同之处:

1. R²(决定系数):

- 定义: R²度量了模型对目标变量变异性的解释程度,取值范围为0到1,越接近1表示模型越好。

- 公式:

- 关键点: R²为1表示模型完美拟合,为0表示模型无法解释目标变量的变异性。但R²也有缺陷,当模型过于复杂时,R²可能会过高。

2. MSE(均方误差):

- 定义: MSE度量了模型预测值与实际值之间的平均差异的平方,值越小表示模型预测越准确。

- 公式:

- 关键点: MSE对异常值敏感,平方项放大了误差。

3. RMSE(均方根误差):

- 定义: RMSE是MSE的平方根,它与目标变量的度量单位相一致,因此更容易解释。

- 公式:

- 关键点: 与MSE类似,RMSE也受异常值的影响,但更直观。

如何选择评估指标:

- R²: 适用于理解模型对目标变量变异性的解释程度,但要注意过拟合可能导致R²过高。

- MSE和RMSE: 适用于衡量模型的整体预测准确性,但要注意异常值可能对结果产生较大影响。

综合考虑这些指标可以提供对模型性能的全面了解。在选择时,要根据具体问题和数据特征进行权衡,有时候需要结合多个指标综合评估模型的优劣。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2023-12-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录