在LSTM网络中,序列对序列和序列对一回归的区别是什么?

在LSTM网络中,序列对序列和序列对一回归的区别是什么?

提问于 2019-02-26 19:33:26

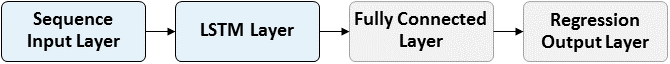

- sequence-to-sequence:LSTM层的输出是一个序列,输入到一个完全连接的层。

lstmLayer(N, 'OutputMode', 'sequence')。 - sequence-to-one:LSTM层的输出是序列的最后一个元素,输入到一个完全连接的层中。

lstmLayer(N, 'OutputMode', 'last')。

两者在时间序列预测方面有什么区别?什么时候应该用一个而另一个呢?

注意:时间序列预测的一个例子使用顺序到顺序的体系结构.如果你只需要预测下一个时间步骤,为什么要输出一个完整的序列呢?我没有看到任何序列对一回归的例子。

回答 2

Stack Overflow用户

回答已采纳

发布于 2019-04-06 18:23:25

sequence-to-sequence:输出是LSTM单元在输入序列中的每个时间步骤的隐藏状态。我们想要LSTM的状态,因为它消耗了序列中的每个点,并考虑了它以前的状态。例如,在对时间序列进行微分时,需要序列中每个点的“梯度”:

x4 x3 x2 x1

[LSTM]

(h1)

x4 x3 x2 x1

[LSTM]

(h2) (h1)

x4 x3 x2 x1

[LSTM]

(h3) (h2) (h1)LSTM基本上是将输入序列转换成输出序列。输出将是(h4) (h3) (h2) (h1)。

在这种情况下,假设我们只需要在使用整个序列之后的sequence-to-one:状态。例如,当您集成一个时间序列时,您希望在集成整个序列之后得到最终结果:

x4 x3 x2 x1

[LSTM]

(h4) (h3) (h2) (h1)所以输出就是(h4)。

Stack Overflow用户

发布于 2019-02-27 08:26:02

如果您想在给定序列之后预测i事件,可以使用seq到-seq(具有i大小的第二个序列),当您想要预测输入序列的下一个步骤时,可以使用seq-to-one来预测输入序列的下一个步骤。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/54892813

复制相关文章

相似问题