Kinect V2与PyKinect2 :深度图像的区别

Kinect V2与PyKinect2 :深度图像的区别

提问于 2019-01-29 07:24:40

我目前正在开发kinect V2以访问深度图像。我使用python PyKinect2中的库来帮助我获得这些图像。

我的第一个问题是:

->我运行KinectStudio 2,查找深度映像,我查找PyKinect2的实现,我有一个不同的映像。这怎么可能?

->可以访问称为X(x,y)的特定点的深度,我使用MapColorFrameToDepthSpace方法,并设法获得一些坐标,以帮助我获得深度框架上的距离。这个说法正确吗?

要获得深度图像:

def draw_depth_frame(self, frame):

depth_frame = frame.reshape((424, 512,-1)).astype(np.uint8)

return depth_framekinect 2的图像:

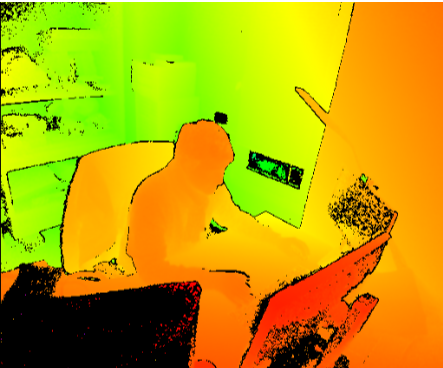

来自kinect 2的带有彩色斜坡的图像:

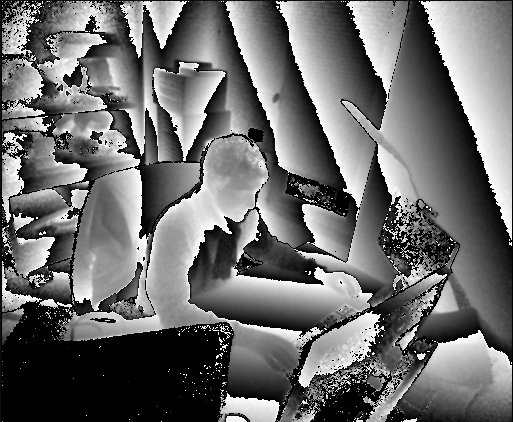

来自pyKinect 2的图像

由衷地,

回答 1

Stack Overflow用户

回答已采纳

发布于 2019-02-02 09:16:19

我发现了我的错误,

当我用这个

depth_frame = frame.reshape((424, 512,-1)).astype(np.uint8)这句话其实是错的。

深度不是映射在uint8上,而是映射在uint16上。

通过执行整形,我已经“丢失”了关于距离的信息,我只有255的价值,所以没有多大用处。

例子: 1600作为一个距离,被认为是255,因为这一行,它给了我第三次深度图像在我的上一篇文章。因此,修正只是一个简单的东西:

depth_frame = frame.reshape((424, 512,-1)).astype(np.uint16)页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/54415817

复制相关文章

相似问题