使用延迟屏幕空间标记系统的边界检查问题

我试图使用OpenGL实现一个延迟的屏幕空间标记系统,下面的文章名为“用延迟的屏幕空间标记在其他东西上绘图”,链接:http://martindevans.me/game-development/2015/02/27/Drawing-Stuff-On-Other-Stuff-With-Deferred-Screenspace-Decals/。

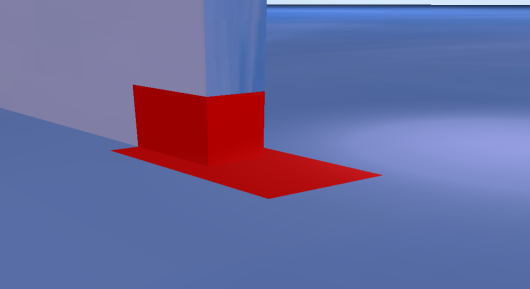

一个红色的立方体被绘制在场景的顶部,它符合设置为false的深度掩码的墙壁。图像链接(无边界立方体):https://gyazo.com/8487947bd4afb08d8d0431551057ad6f

墙的深度缓冲区和一些顶点着色器输出用于计算墙在cube.The边界的维度内的对象空间位置,以确保在墙的对象空间位置之外的立方体的每个像素都被丢弃。

问题是边界没有正常工作,立方体完全消失了。

潜在故障

我已经检查了深度缓冲区是否正确工作,通过可视化它在避雷器通道,它似乎运行良好。深度缓冲器存储在浮动大小为GL_RGB32F的gbuffer中的颜色附件中。图像链接(远程墙的Ligtingpass深度缓存可视化):https://gyazo.com/69920a532ca27aa9f57478cb57e0c84c

贴花着色码

VertexShader

// Vertex positions

vec4 InputPosition = vec4(aPos, 1);

// Viewspace Position

PositionVS = view* model* InputPosition;

// Clipspace Position

PositionCS = projection*PositionVS;

gl_Position = PositionCS; FragmentShader

// Position on the screen

vec2 screenPos = PositionCS.xy / PositionCS.w;

// Convert into a texture coordinate

vec2 texCoord = vec2((1 + screenPos.x) / 2 + (0.5 / resolution.x), (1 -

screenPos.y) / 2 + (0.5 / resolution.y));

// Sampled value from depth buffer

vec4 sampledDepth = texture(gDepth, texCoord);

// View-direction

vec3 viewRay = PositionVS.xyz * (farClip / -PositionVS.z);

// Wallposition in view-space

vec3 viewPosition = viewRay*sampledDepth.z;

// Transformation from view-space to world-space

vec3 WorldPos = (invView*vec4(viewPosition, 1)).xyz;

// Transformation from world-space to object-space

vec3 objectPosition = (invModel*vec4(WorldPos, 1)).xyz;

// Bounds check, discard pixels outside the wall in object-space

if (abs(objectPosition.x) > 0.5) discard;

else if (abs(objectPosition.y) > 0.5) discard;

else if (abs(objectPosition.z) > 0.5) discard;

// Color to Gbuffer

gAlbedoSpec = vec4(1, 0, 0, 1);代码描述

invView和invModel分别与视图和模型矩阵相反。矩阵逆计算是在CPU中完成的,并作为制服发送到碎片着色器。farClip是距摄像机法面的距离(这里设置为3000 )。gDepth是Gbuffer的深度纹理。

问题所在

墙中由立方体形成的部分应该是红色的,如下所示,它显然不是。

图像链接(带边界的立方体):https://gyazo.com/ab6d0db2483a969db932d2480a5acd08

我的猜测是,问题是如何将视图空间位置转换为对象空间位置,但我无法理解它!

回答 1

Stack Overflow用户

发布于 2019-01-17 17:41:36

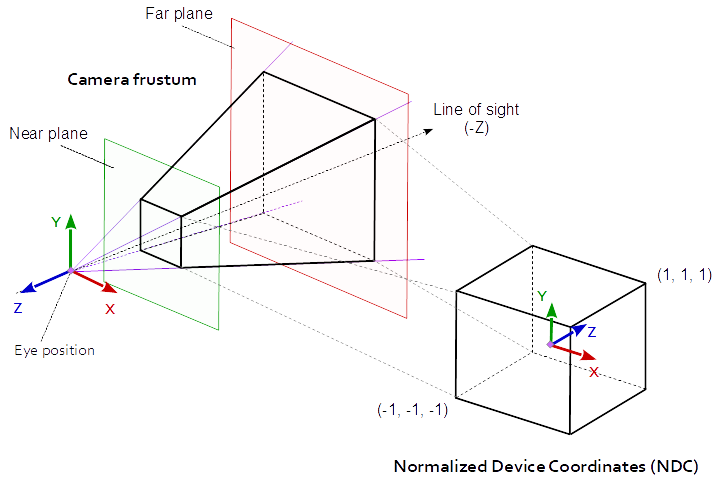

你把粉笔和奶酪弄糊涂了。PositionCS是一个剪辑空间位置,可以由透视划分转换成规范化的设备空间位置。

vec2 ndcPos = PositionCS.xyz / PositionCS.w;sampledDepth是深度值(默认范围为0,1),可以从深度缓冲区纹理读取“红色”颜色通道(.r,.x)。利用depth*2.0-1.0可将深度转换为归一化器件空间Z坐标

vec2 texCoord = ndcPos.xy * 0.5 + 0.5;

// (+ 0.5/resolution.xy;) is not necessary if texture filter is GL_NEAREST

float sampledDepth = texture(gDepth, texCoord).x;

float sampleNdcZ = sampledDepth * 2.0 - 1.0;在透视投影和归一化设备空间中,所有具有相同x和y坐标的点都在同一条射线上,从视图位置开始。

这意味着,如果用与ndcPos (ndcPos,PositionCS)相同的视图矩阵和投影矩阵生成深度缓冲区ndcPos.z,则可以用相应的NDC z坐标代替ndcPos.z,形成深度缓冲区(sampleNdcZ),且点仍位于相同的视图射线上。

ndcPos.z和sampleNdcZ是同一参考系统中的比较值。

vec3 ndcSample = vec3(ndcPos.xy, sampleNdcZ);该坐标可以通过反投影矩阵和透视剖分转换为视图空间坐标。

如果NDC点在同一视图射线上被转换为视图空间,那么XY坐标将是不同的。注意,由于(* 1/.w),转换不是线性的。另见OpenGL -鼠标坐标到空间坐标。

uniform mat4 invProj; // = inverse(projection)vec4 hViewPos = invProj * vec4(ndcSample, 1.0);

vec3 viewPosition = hViewPos.xyz / hViewPos.w;这可以通过将逆视图矩阵转化为世界空间,将逆模型矩阵转换为对象空间:

vec3 WorldPos = (invView * vec4(viewPosition, 1.0)).xyz;

vec3 objectPosition = (invModel * vec4(WorldPos, 1.0)).xyz;

https://stackoverflow.com/questions/54201496

复制相似问题