将大量数据从Server传输到Azure SQL Server的最佳方法。Azure数据工厂、HDInsight等

我喜欢找到最好的方法,将20 GB的SQL数据从安装在客户现场服务器客户端上的server数据库传输到S4上的Azure SQL Server Source,该数据库的性能为每月320美元,具有200 DTU的性能。在进行初始设置时,我们建立了一个Azure数据工厂,该工厂通过多个表副本复制20 GB以上的数据,例如客户端表A的内容到源表A,客户端表B的内容复制到来源表B,等等。然后我们运行许多提取器存储过程,通过将这些源表连接在一起,将这些源表中的数据插入到阶段表中,例如,源A连接到源B。

目前,S4上的复制时间约为12小时,提取时间为4小时。将性能级别提高到每月2400美元的S9为1600个DTU将减少到6个小时,提取时间为2小时,但这带来了更高的成本。

我想知道是否还有其他的Azure方法。与将Azure扩展到一个HDInsight或更多的S9相比,使用Hadoop或Spark来设置一个Azure是否更节省成本?每月31天的S9是每小时3.28美元。存储D14 v2实例的优化节点的Azure v2集群是每小时1.496美元,所以比S9便宜。然而,它在性能上是如何比较的。复制过程是更快,还是提取过程更快?

我还不习惯大数据方法。谢谢你的帮助。

回答 1

Stack Overflow用户

发布于 2018-12-17 15:08:06

Azure Data复制活动提供了一流的安全、可靠和高性能的数据加载解决方案.它使您能够每天在丰富的云和现场数据stores.Copy活动中复制数十兆字节的数据,提供了高度优化的数据加载体验,易于配置和设置。

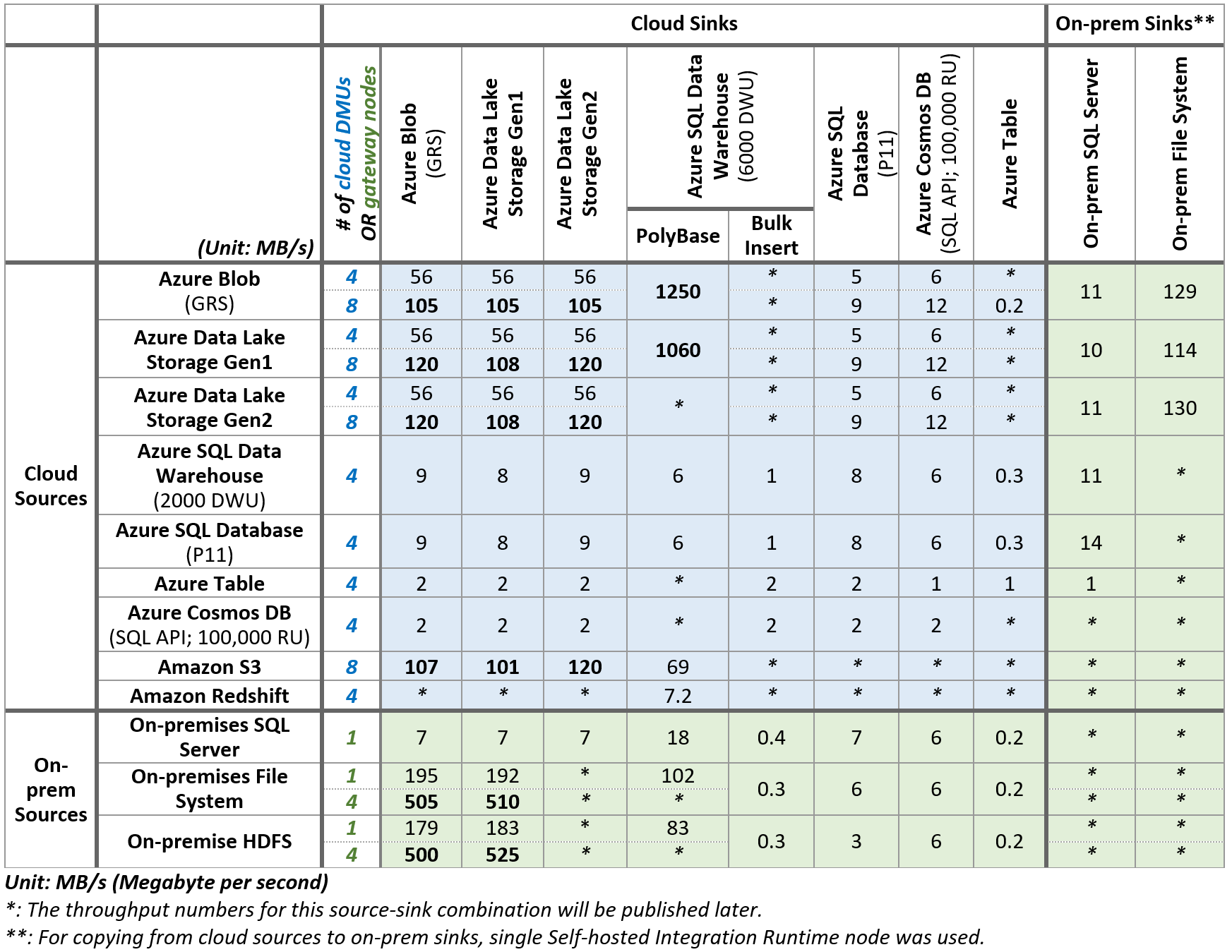

您可以看到有关复制活动的性能引用表:

该表显示了基于内部测试运行的单个副本活动中给定源和接收器对的MBps副本吞吐量数字。

如果希望通过使用Azure data复制活动更快地传输数据,Azure提供了三种实现更高吞吐量的方法:

- 数据集成单元。数据集成单元(,DIU)(以前称为云数据运动单元(,DMU) )是表示数据工厂中单个单元的功率( CPU、内存和网络资源分配的组合)的度量。您可以通过使用更多的数据集成单元(DIU)实现更高的吞吐量,.You是根据复制操作的总时间收费的。为数据移动计费的总持续时间是跨DIUs的持续时间之和。

- 平行拷贝。我们可以使用parallelCopies属性指示要将活动复制到use.For的并行性--每次运行复制活动,Data将确定用于从源数据存储区和目标数据存储区复制数据的并行副本的数量。

- 假拷贝。将数据从源数据存储复制到接收器数据存储时,可以选择使用Blob存储作为临时暂存存储。

您可以使用以下方法通过复制活动优化Data服务的性能。

有关Azure Data复制活动性能的详细信息,请参阅:https://learn.microsoft.com/en-us/azure/data-factory/copy-activity-performance#data-integration-units

https://stackoverflow.com/questions/53808469

复制相似问题