资格跟踪算法,更新顺序

资格跟踪算法,更新顺序

提问于 2018-10-15 00:06:40

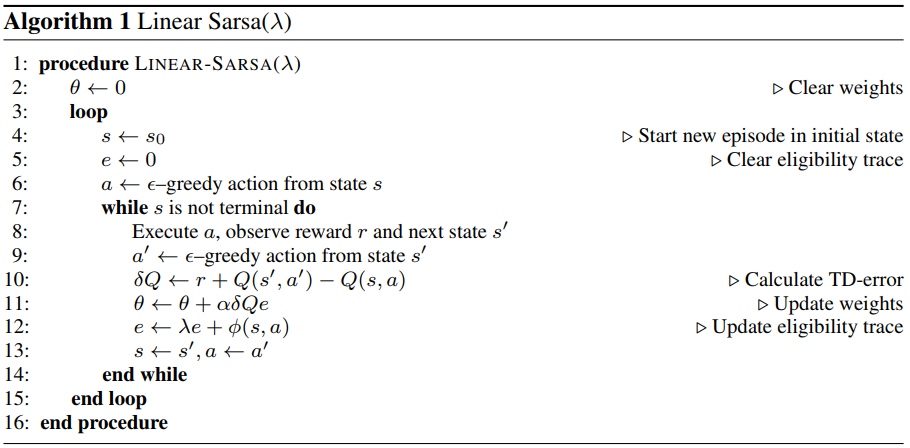

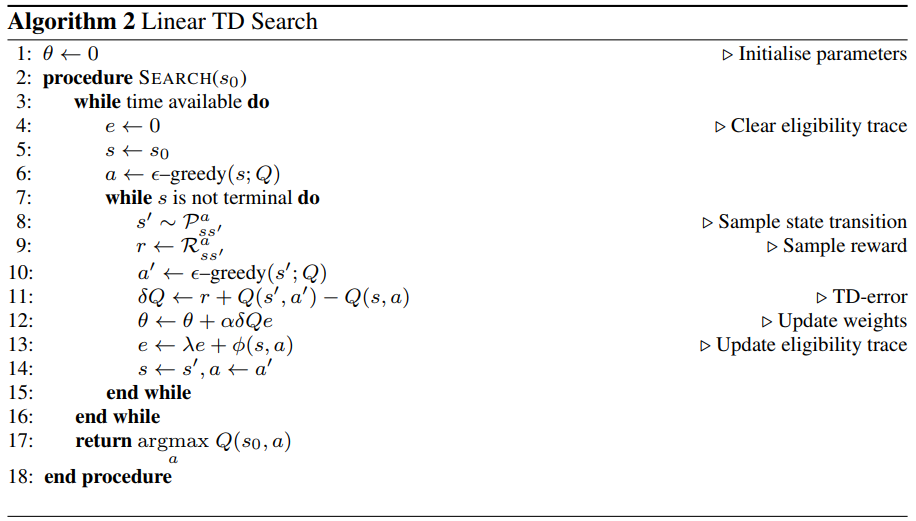

我正在阅读西尔弗等人(2012年)“计算机围棋中的时间差搜索”,并试图理解资格跟踪算法的更新顺序。在算法1和2中,在更新资格跟踪之前更新权重。我想知道这个顺序是否正确(算法1中的第11和第12行,算法2的第12和第13行)。考虑到lambda=0的极端情况,参数不会被更新为初始状态-动作对(因为e仍然是0)。因此,我怀疑订单是否应该是相反的。

有人能澄清这一点吗?

我发现这篇论文对学习强化学习领域有很大的指导意义,所以我想详细了解这篇论文。

如果有一个更合适的平台来问这个问题,请也让我知道。

回答 1

Stack Overflow用户

回答已采纳

发布于 2018-10-18 17:28:20

在我看来,你是对的,e应该在 theta之前更新。根据论文中的数学,这也是应该发生的事情。例如,参见等式(7)和(8),其中e_t首先使用phi(s_t)计算,然后才使用delta V_t更新theta (在控制情况下是delta Q )。

请注意,您用lambda=0编写的关于极端情况的文章并不完全正确。初始状态-动作对仍然涉及更新(不是在第一次迭代中,而是在第二次迭代期间合并到e中)。然而,在我看来,r似乎永远不会用于任何更新(因为它只出现在第一次迭代中,其中e仍然是0)。既然这篇论文是关于Go的,我想这不会有什么关系;除非他们在做一些非常规的事情,否则他们可能只会对最终的游戏状态使用非零奖励。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/52808170

复制相关文章

相似问题