增强学习中的SARSA算法

增强学习中的SARSA算法

提问于 2018-05-15 23:48:13

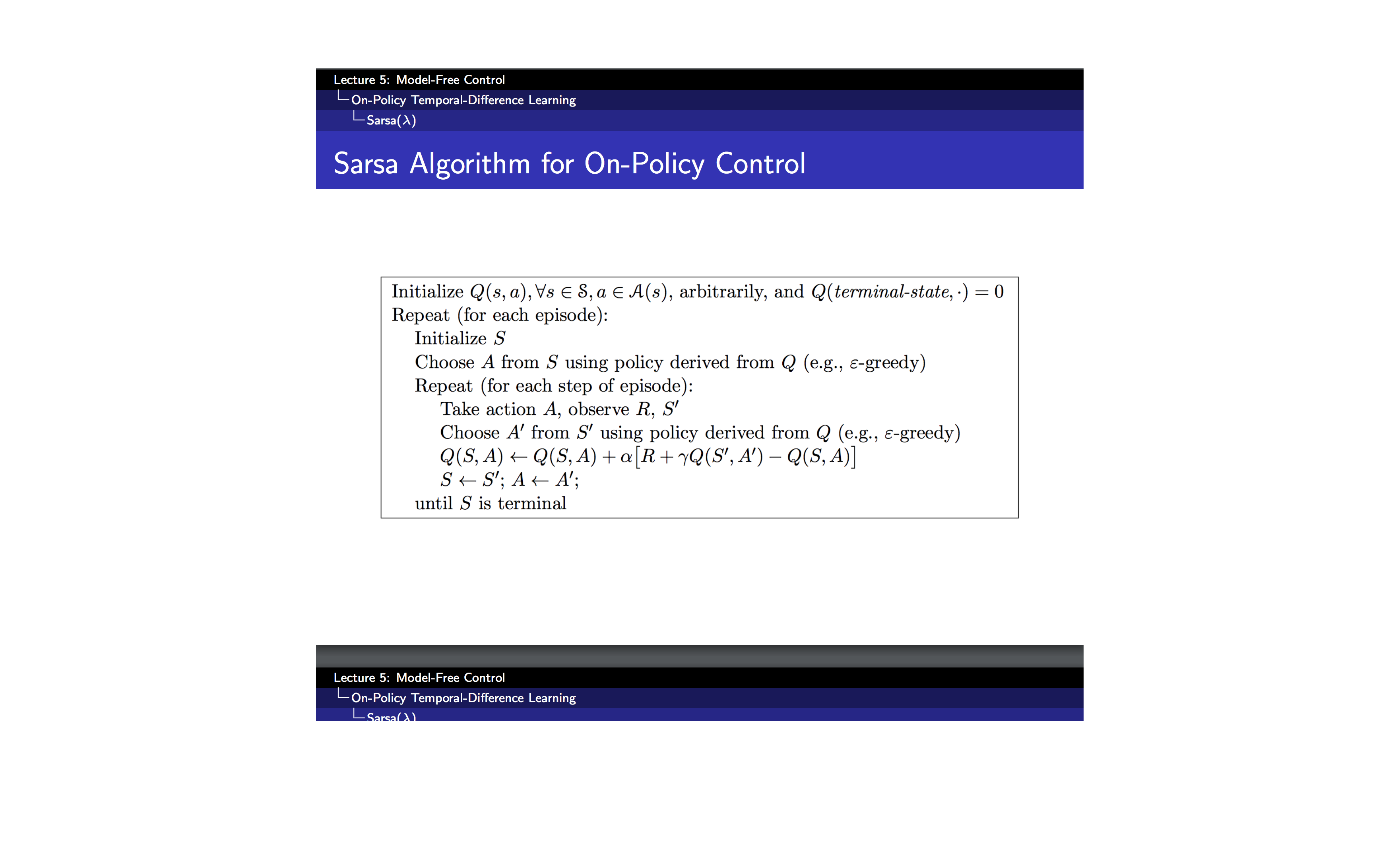

我在无模型强化学习中遇到了SARSA算法.具体来说,在每个状态中,您将采取一个操作a,然后观察一个新的状态s'。

我的问题是,如果你没有状态转移概率方程P{next state | current state = s0},你怎么知道你的下一个状态是什么?

我的尝试:你是简单地尝试这个动作a out,然后从环境中观察吗?

回答 3

Stack Overflow用户

回答已采纳

发布于 2018-05-16 00:25:49

通常是的,您在环境中执行操作,环境告诉您下一个状态是什么。

Stack Overflow用户

发布于 2018-07-20 14:58:14

是。基于存储在动作值函数中的代理体验,他的行为策略pi将当前状态的映射到动作()中,该将他引导到下一个状态‘,然后映射到下一个动作a'。

Stack Overflow用户

发布于 2019-01-17 20:46:40

在Q学习和SARSA中使用了一种称为TD学习的技术,以避免学习过渡概率.

简而言之,在SARSA中,当您正在采样(即与系统交互)并收集数据样本(状态、动作、奖励、下一状态、下一动作)时,当您使用样本更新模型的参数时,将隐式地考虑转换概率。例如,每次您选择当前状态下的一个动作,然后得到一个奖励和新状态,系统实际上根据转换概率p(s',r_x,a,s)生成奖励和新状态。

你可以在这本书中找到一个简单的描述,

人工智能--现代方法

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/50360618

复制相关文章

相似问题