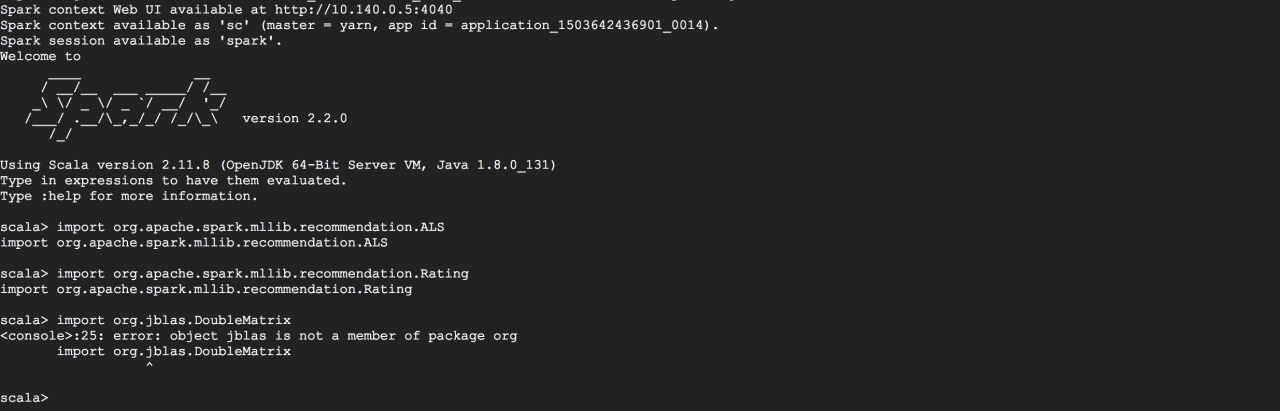

错误的解决方案是什么,“JBlas不是包或apache的成员”?

错误的解决方案是什么,“JBlas不是包或apache的成员”?

提问于 2017-09-01 01:58:01

回答 1

Stack Overflow用户

回答已采纳

发布于 2017-09-01 02:24:08

您在这些链接线程中执行了完整的"git克隆“步骤吗?你真的需要修改jblas吗?如果不是,您应该使用--packages org.jblas:jblas:1.2.4将它们从maven中心取出,而不使用git clone或mvn install;在一个新的Dataproc集群上,下面的内容对我来说很好:

$ spark-shell --packages org.jblas:jblas:1.2.4

Ivy Default Cache set to: /home/dhuo/.ivy2/cache

The jars for the packages stored in: /home/dhuo/.ivy2/jars

:: loading settings :: url = jar:file:/usr/lib/spark/jars/ivy-2.4.0.jar!/org/apache/ivy/core/settings/ivysettings.xml

org.jblas#jblas added as a dependency

:: resolving dependencies :: org.apache.spark#spark-submit-parent;1.0

confs: [default]

found org.jblas#jblas;1.2.4 in central

downloading https://repo1.maven.org/maven2/org/jblas/jblas/1.2.4/jblas-1.2.4.jar ...

[SUCCESSFUL ] org.jblas#jblas;1.2.4!jblas.jar (605ms)

:: resolution report :: resolve 713ms :: artifacts dl 608ms

:: modules in use:

org.jblas#jblas;1.2.4 from central in [default]

---------------------------------------------------------------------

| | modules || artifacts |

| conf | number| search|dwnlded|evicted|| number|dwnlded|

---------------------------------------------------------------------

| default | 1 | 1 | 1 | 0 || 1 | 1 |

---------------------------------------------------------------------

:: retrieving :: org.apache.spark#spark-submit-parent

confs: [default]

1 artifacts copied, 0 already retrieved (10360kB/29ms)

Setting default log level to "WARN".

To adjust logging level use sc.setLogLevel(newLevel). For SparkR, use setLogLevel(newLevel).

ivysettings.xml file not found in HIVE_HOME or HIVE_CONF_DIR,/etc/hive/conf.dist/ivysettings.xml will be used

Spark context Web UI available at http://10.240.2.221:4040

Spark context available as 'sc' (master = yarn, app id = application_1501548510890_0005).

Spark session available as 'spark'.

Welcome to

____ __

/ __/__ ___ _____/ /__

_\ \/ _ \/ _ `/ __/ '_/

/___/ .__/\_,_/_/ /_/\_\ version 2.2.0

/_/

Using Scala version 2.11.8 (OpenJDK 64-Bit Server VM, Java 1.8.0_131)

Type in expressions to have them evaluated.

Type :help for more information.

scala> import org.jblas.DoubleMatrix

import org.jblas.DoubleMatrix

scala> :quit此外,如果您需要通过Dataproc的作业提交API来提交需要“包”的作业,那么由于--packages实际上是各种星火启动脚本中的语法糖,而不是Spark作业的属性,所以在这种情况下,您需要使用等效的spark.jars.packages,比如explained in this StackOverflow answer。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/45992362

复制相关文章

相似问题