用iOS 11 11模型进行图像分类-使用协同工具和经过训练的.caffemodel转换问题

使用coremltool和经过训练的.caffemodel似乎存在一些转换问题。我能够训练和测试caffe狗模型(120个类别,20k图像),它通过了直接caffe分类的测试。不幸的是,在转换到mlmodel之后,它并没有给出对相同输入的有效预测。

训练模型

该模型使用Caffe、GoogleNet、20k图像集进行了训练,将120多个类别的图像打包成lmdb和大约500 k的迭代。我已经准备好了图像数据库和所有其他的,并把这里所有的文件都在一起

基于caffe的分类

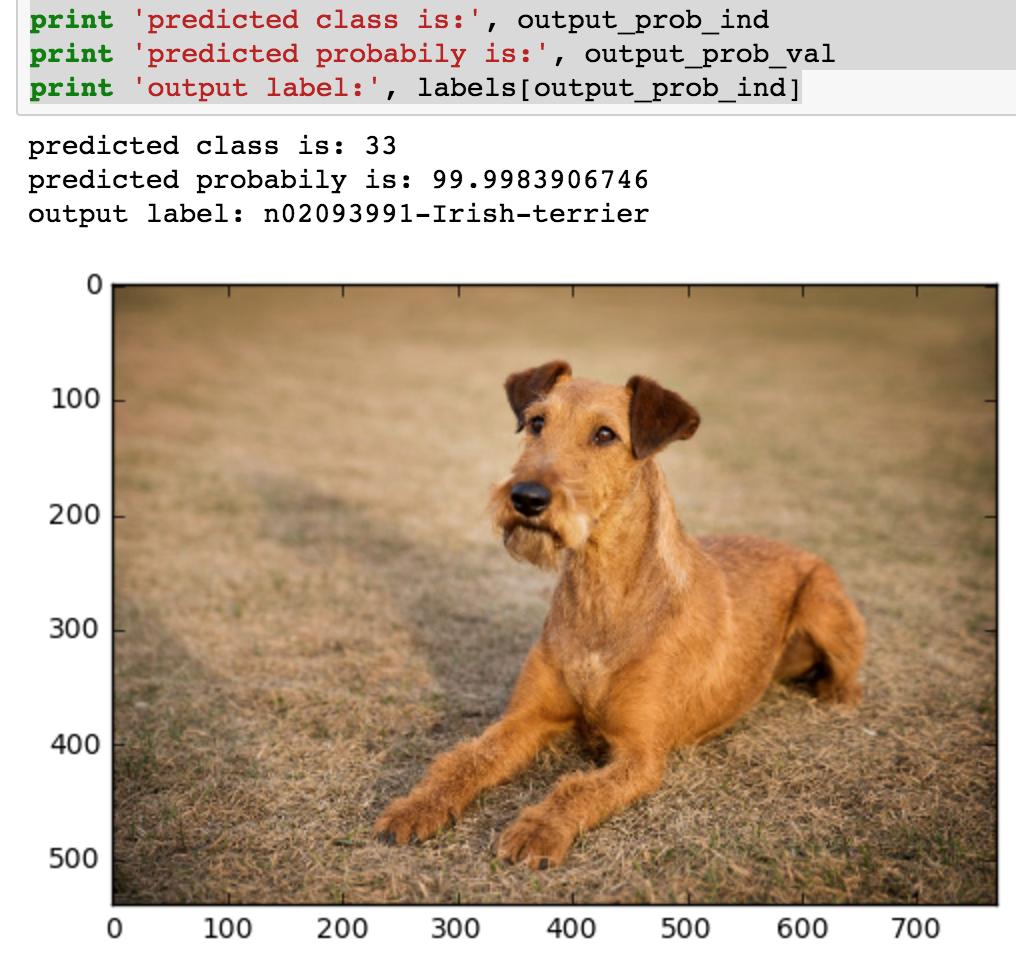

这个分类实例是caffe的。当我试图针对经过训练的caffemodel运行分类请求时,它工作的概率很高(80-99%),正确的结果是:

基于Apple iOS 11 CoreML的分类

不幸的是,当我试图将这款DTDogs.caffemodel & deploy.txt装进苹果iOS 11 CoreML的.mlmodel消费品中时,我有不同的预测结果。实际上,没有错误加载和使用模型,但我无法获得有效的分类,所有的预测是0-15%的可信度,并有错误的标签。为了正确地测试它,我使用了与caffe直接分类完全相同的图像

我也在这里用我的iOS应用程序尝试过iOS--它们工作得很好,所以这似乎是包装过程中的一个问题。

我错过了什么?

下面是使用caffe进行分类的示例:无问题,正确答案(python):

import numpy as np

import sys

import caffe

import os

import urllib2

import matplotlib.pyplot as plt

%matplotlib inline

test_folder = '/home/<username>/Desktop/CaffeTest/'

test_image_path = "http://cdn.akc.org/content/hero/irish-terrier-Hero.jpg"

# init caffe net

model_def = test_folder + 'deploy.prototxt'

model_weights = test_folder + 'DTDogs.caffemodel'

# caffe.set_mode_gpu()

net = caffe.Net(model_def, model_weights, caffe.TEST)

# prepare transformer

transformer = caffe.io.Transformer({'data': net.blobs['data'].data.shape})

transformer.set_transpose('data', (2,0,1))

transformer.set_raw_scale('data', 255)

transformer.set_channel_swap('data', (2,1,0))

net.blobs['data'].reshape(1, 3, 256, 256)

test_image = urllib2.urlopen(test_image_path)

with open(test_folder + 'testImage.jpg','wb') as output:

output.write(test_image.read())

image = caffe.io.load_image(test_folder + 'testImage.jpg')

transformed_image = transformer.preprocess('data', image)

net.blobs['data'].data[...] = transformed_image

# classify

output = net.forward()

output_prob = output['prob'][0]

output_prob_val = output_prob.max() * 100

output_prob_ind = output_prob.argmax()

labels_file = test_folder + 'labels.txt'

labels = np.loadtxt(labels_file, str, delimiter='\t')

plt.imshow(image)

print 'predicted class is:', output_prob_ind

print 'predicted probabily is:', output_prob_val

print 'output label:', labels[output_prob_ind]下面是使用DTDogs.mlmodel打包coremltools模型的示例。我看到结果的.mlmodel文件比原始的.caffemodel小两倍,但是它可能是coremltools (python)的某种归档或压缩优化:

import coremltools;

caffe_model = ('DTDogs.caffemodel', 'deploy.prototxt')

labels = 'labels.txt'

coreml_model = coremltools.converters.caffe.convert(caffe_model, class_labels = labels, image_input_names= "data")

coreml_model.short_description = "Dogs Model v1.14"

coreml_model.save('DTDogs.mlmodel')下面是一个在应用程序中使用DTDogs.mlmodel的示例。我使用常规的图像选择器来选择用于.caffe分类测试(swift)的相同图像:

func imagePickerController(_ picker: UIImagePickerController, didFinishPickingMediaWithInfo info: [String : Any]) {

picker.dismiss(animated: true)

print("Analyzing Image…")

guard let uiImage = info[UIImagePickerControllerOriginalImage] as? UIImage

else { print("no image from image picker"); return }

guard let ciImage = CIImage(image: uiImage)

else { print("can't create CIImage from UIImage"); return }

imageView.image = uiImage

do {

let model = try VNCoreMLModel(for: DTDogs().model)

let classificationRequest = VNCoreMLRequest(model: model, completionHandler: self.handleClassification)

let orientation = CGImagePropertyOrientation(uiImage.imageOrientation)

let handler = VNImageRequestHandler(ciImage: ciImage, orientation: Int32(orientation.rawValue))

try handler.perform([classificationRequest])

} catch {

print(error)

}

}回答 1

Stack Overflow用户

发布于 2017-07-23 10:13:46

通常,在这些情况下发生的情况是,图像Core正在传递到模型中,格式不正确。

在Caffe模型的情况下,通常需要在调用is_bgr=True时设置caffe.convert(),并且通常必须传递将从输入图像中减去的RGB平均值,以及可能的缩放值。

换句话说,Core需要执行transformer脚本中的相同操作。

就像这样:

coreml_model = coremltools.converters.caffe.convert(

caffe_model, class_labels = labels, image_input_names= "data",

is_bgr=True, image_scale=255.)我不确定是否需要image_scale=255.,但值得一试。:-)

https://stackoverflow.com/questions/45260273

复制相似问题