如何使用mkvmerge和外部时间代码强制A/V同步?

如何使用mkvmerge和外部时间代码强制A/V同步?

提问于 2017-04-12 02:46:37

背景

我正在从事一个项目,其中视频和音频是MKV源文件的算法解释,在该项目中,我使用ffmpeg、-ss和-t提取音频和视频的特定区域以分离文件。我在音频过程中使用视频中的场景变化(即视频场景上的音频变化),所以同步是至关重要的。

音频是48千赫,使用512个样本块。视频是23.976fps (我也尝试了24)。

我以累积块的形式将sceneChanges的帧开始存储在一个文件中:

blocksPerFrame = (48000 / 512) / 23.976

sceneOnsetBlock = sceneOnsetFrame*blocksPerFrame我在音频代码中使用这些块将与每个场景关联的样本作为一个组来处理。

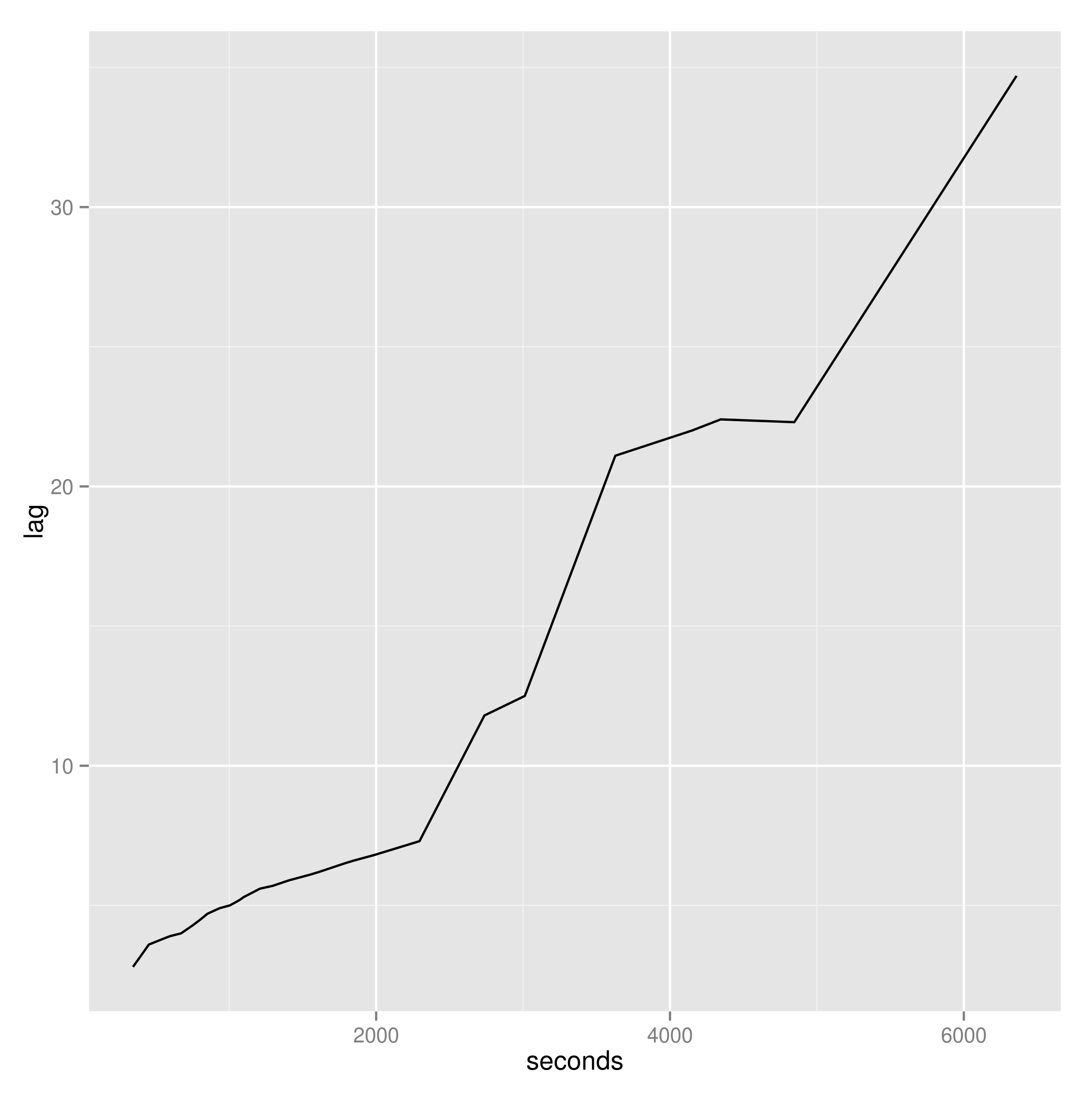

当我将音频和视频组合回一起(目前使用ffmpeg在MKV容器中生成mp4(v) mp3(a) )时,音频和视频开始同步,但是越来越多地漂移,直到它结束于大约35秒。最糟糕的是音频滞后是非线性的!所谓非线性,我的意思是,如果我用时间滞后的位置绘制滞后图,我没有得到一条线,但是你在下面的图像中看到了什么)。由于这种非线性,我不能只是移动或缩放音频来适应视频。我无法找出这种非线性增加的音频延迟的原因;我已经双倍和三倍地验证了我的数学。

因为我知道场景更改的确切时间,所以我应该能够为mkvmerge生成“外部时间代码”(从上面的块)来完美地同步输出!

分问题:

- 这是最好的方法(除了试图找出问题所在)吗?当我使用我的视频帧作为参考,如果我使用场景变化作为音频的时间码,它会强制视频匹配音频还是反之亦然?与同步相比,我对时间的关注要少得多。这个视频制作起来要辛苦得多,所以我宁愿放一些声音,也不愿放一些画框。

- 我不清楚要在timecodes文件中使用哪些数字。根据mkvmerge 文档的说法,“对于视频,这正是一个帧,对于音频,这是一个特定音频类型的包。”由于我使用的是MP3,数据包大小是什么?理想情况下,我可以指定一个包大小(在音频编码器中?)这与我的块大小(512)相匹配,以使事情保持一致和简单。我能用ffmpeg做这个吗?

谢谢!

回答 1

Stack Overflow用户

发布于 2017-04-19 17:32:02

最后,我在代码中解决了问题的原因,所以我从来不需要遵循上面的想法。在与mkvmerge作者的讨论中,我确定了以下答案:

- 最好将视频与音频同步,因为有些玩家使用音频时间戳(timecodes)作为参考,而且视频比音频更容易被播放器减慢和加速。

- 音频没有单一的数据包大小。数据包大小取决于编码器,甚至可能在流的不同部分有不同的大小。必须从MKV报头中提取每个数据包中的样本数,并使用它计算每个数据包的持续时间以生成时间戳。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/43359375

复制相关文章

相似问题