滞后的系统还是TensorFlow中可能的错误?

我目前正在研究RnD的TensorFlow (CPU版本),但无法确定我的系统对大型数据集培训的基本需求,也可能是偶然在TensorFlow库中发现了一个可能的错误。

在官方TensorFlow文档中,没有任何地方表示系统需要在其上构建和运行TensorFlow程序。据我所知,如果可以在Windows、Linux、Mac以及Android、iOS以及RaspberryPi等嵌入式系统上运行,我想也不应该有任何这样的硬件要求。

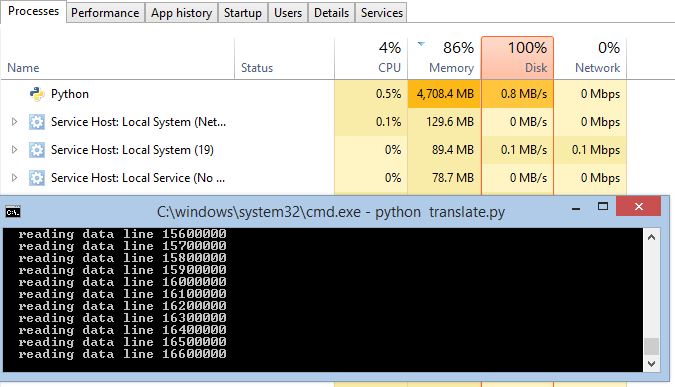

然而,在最初的研究过程中,我尝试运行TensorFlow Seq2Seq模型(将英语翻译为法语https://www.tensorflow.org/tutorials/seq2seq),其中培训和测试数据集最初占用大约7-8GB的磁盘空间,整个磁盘空间为20-22Gb。一旦执行了translate.py python脚本,它就会阻塞内存,并将磁盘利用率分别提高到98%和100%。

我目前的系统运行Windows8.1 64位操作系统,核心i5 5200 U时钟在2.2 GHz,8GB内存和约70 8GB的空间在硬盘上(专门分配给TensorFlow使用)。但是,即使允许我的系统运行超过7-8个小时(没有其他应用程序运行),它也多次被卡住,而且通常是在内存利用率达到100%左右之后,在标记数据集之后。

虽然我不确定,但我认为TensorFlow学习图是在内存中创建的,一旦它扩展到所有内存空间,程序就会以无结束循环结束,等待内存被清除,然后增加学习图。

因此,整个演练归结为三个问题:

- TensorFlow是否使用内存来创建和保存学习图?如果是这样的话,是否有可能以类似的方式窒息?

- 从业务的角度来看,培训这样一个系统是否有最低的硬件要求?

- 如果这不是系统需求,这是否可能是TensorFlow库中的一个错误,它将其推入一个无休止的循环,等待内存被清除?

更新

在连续运行python脚本30多个小时后,该过程似乎在“读取开发和培训数据”的同时在同一个位置停留了14个小时。如欲作进一步调查,请参阅下图:

回答 1

Stack Overflow用户

发布于 2017-04-01 15:22:40

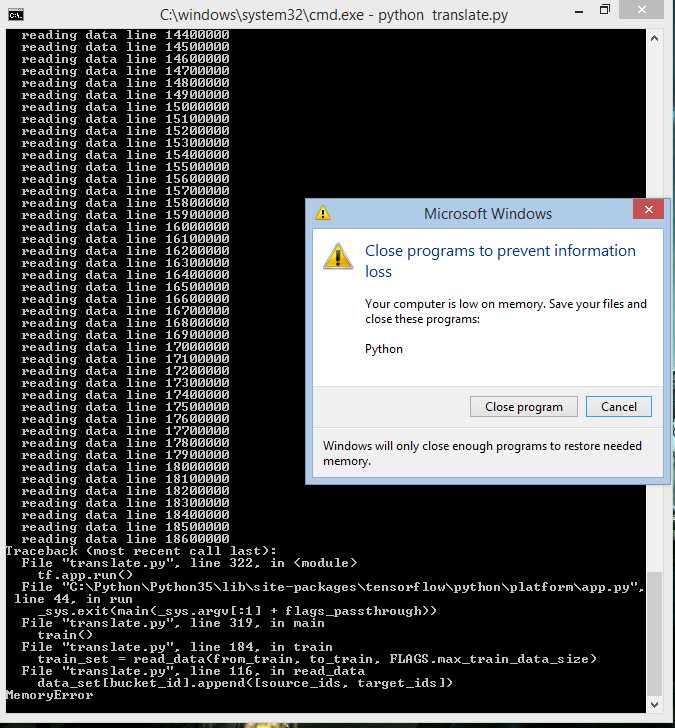

当我即将关闭程序时,同样的程序再次开始响应,我又等了15-20分钟,最后从操作系统本身得到了答案。造成这一问题的确实是内存不足。附加屏幕抓取的Windows警报系统运行不足的内存,以供参考,以防任何人陷入同样的情况。

更新

我尝试在Google平台上使用VM实例。这台机器有2台Intel Xeon (R),每台运行在2.23 GHZ,内存为13 GHZ,存储容量为50 GHZ。但是在这种情况下,结果也是一样的,即使应用程序使用了超过10.5GB的RAM。似乎本教程脚本需要一个非常密集的系统,可能是一台至少32 GB内存的超级计算机才能完全运行和执行。我现在可能会考虑编写/安排我自己的数据集。然而,这必须作为未来的增强,使用持久存储(HDD/SSD)来创建图形而不是RAM,以避免内存的阻塞。

https://stackoverflow.com/questions/43144633

复制相似问题