在集群上运行星火库:初始作业未接受任何资源

在集群上运行星火库:初始作业未接受任何资源

提问于 2016-11-28 21:56:51

- 我在linode.com上有一个远程Ubuntu服务器,它有4个核心和8G内存

- 我在我的远程Ubuntu服务器上有一个由一个主服务器和一个从服务器组成的Spark-2集群。

- 我已经在我的PySpark上本地启动了MacBook外壳,通过以下方式连接到远程服务器上的主节点: $ PYSPARK_PYTHON=python3 PYSPARK_PYTHON=python3--主火花://服务器-ip:7077

- 我试着从网站上执行简单的星火示例: 从spark.read.json("/path/to/spark-2.0.0-bin-hadoop2.7/examples/src/main/resources/people.json")导入SparkSession S起来= SparkSession \ .builder \.appName(“pyspark.sql示例”)\ .config("spark.some.config.option",“一些值”)\ .getOrCreate() df =SparkSession

- 我犯了错误 初始作业未接受任何资源;请检查群集用户界面,以确保员工已注册并拥有足够的资源。

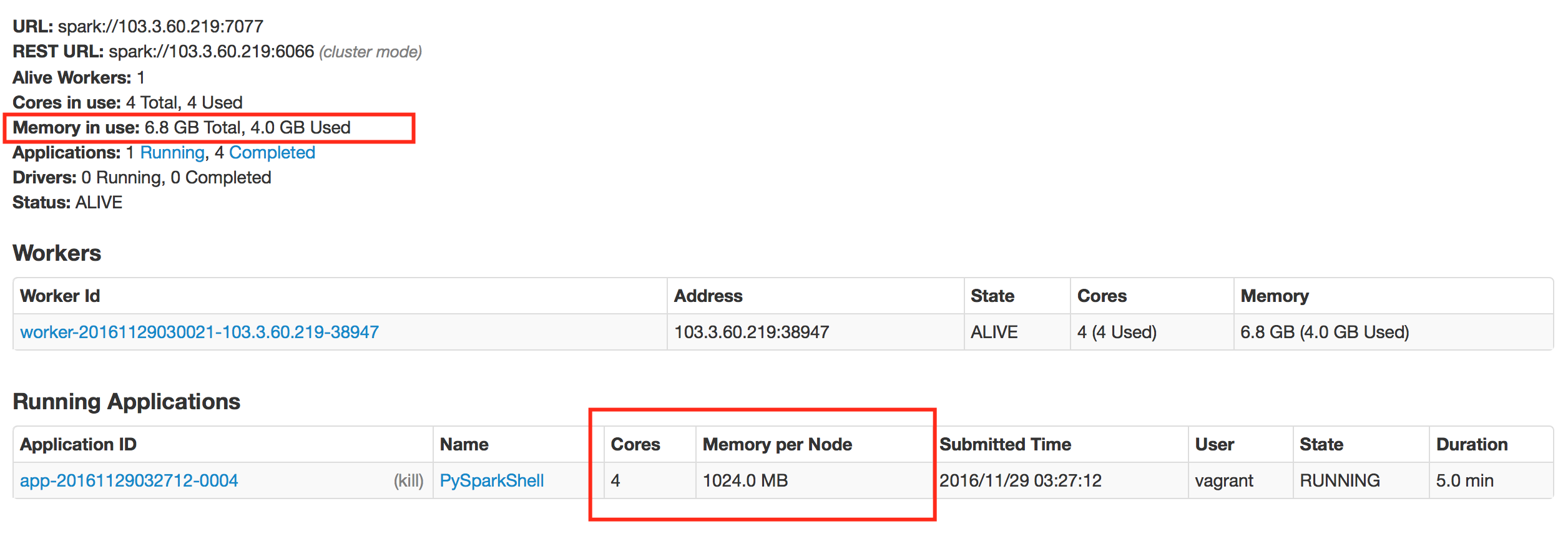

- 我有足够的内存在我的服务器和我的本地机器,但我得到这个奇怪的错误一次又一次。我的星盘集群有6G,我的脚本只使用4个内核,每个节点有1G内存。 [

- 我已经谷歌了这个错误,并试图设置不同的内存信任,也禁用了防火墙的两台机器,但它没有帮助我。我不知道怎么修好它。

- 有人也面临同样的问题吗?有什么想法吗?

回答 1

Stack Overflow用户

回答已采纳

发布于 2016-11-28 22:06:57

您正在以客户端模式提交应用程序。这意味着驱动程序进程是在本地机器上启动的。

在执行星火应用程序时,所有机器都必须能够相互通信。很可能您的驱动程序进程无法从执行器(例如,它正在使用私有IP或隐藏在防火墙后面)。如果是这种情况,您可以通过检查executor日志(转到应用程序,选择状态为EXITED的工作人员的on并检查stderr )来确认这一点。你“应该”看到执行者由于org.apache.spark.rpc.RpcTimeoutException而失败)。

有两种可能的解决办法:

- 从您的集群可以到达的机器上提交申请。

- 以群集模式提交应用程序。这将使用集群资源启动驱动程序进程,因此您必须说明这一点。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/40854231

复制相关文章

相似问题