为什么Google robots.txt测试器有错误且无效

为什么Google robots.txt测试器有错误且无效

提问于 2016-08-24 05:12:20

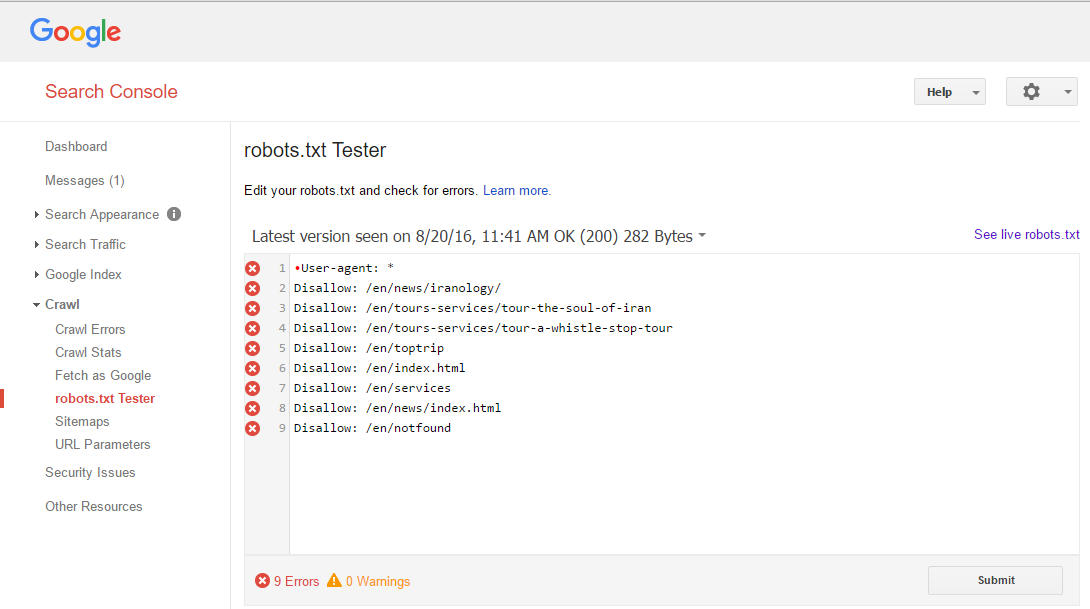

正如您在下面的图片中所看到的,Google WebMaster Tools robots.txt Tester告诉我9个错误,但是我不知道如何修复它,问题是什么?

请帮我弄清楚

回答 2

Stack Overflow用户

回答已采纳

发布于 2016-08-24 08:26:19

这是一个有效的robots.txt,但是在文本文件的开头有一个8 BOM (\xef\xbb\xbf)。这就是为什么在第一行的“用户”旁边有一个红色的点。这个标记告诉浏览器和文本编辑器将文件解释为UTF-8,而robots.txt则只使用ASCII字符。

将您的文本文件转换为ASCII,错误将消失。或者复制红点后的所有内容,然后再粘贴。

我在实时版本上测试了这一点,下面是从字节格式转换出来的结果:

\xef\xbb\xbfUser-agent: *\r\nDisallow: /en/news/iranology/\r\nDisallow:

/en/tours-services/tour-the-soul-of-iran\r\nDisallow:

/en/tours-services/tour-a-whistle-stop-tour\r\nDisallow: /en/to你可以清楚地看到BOM在开始。浏览器和文本编辑器将忽略它,但它可能会影响爬虫解析robots.txt的能力。您可以使用这个python脚本测试活动版本:

import urllib.request

text = urllib.request.urlopen('http://www.best-iran-trip.com/robots.txt')

print(repr(text.read()))如果您能够安装Notepad++,它实际上有一个编码菜单,允许您以任何格式保存它。

Stack Overflow用户

发布于 2017-02-18 11:04:47

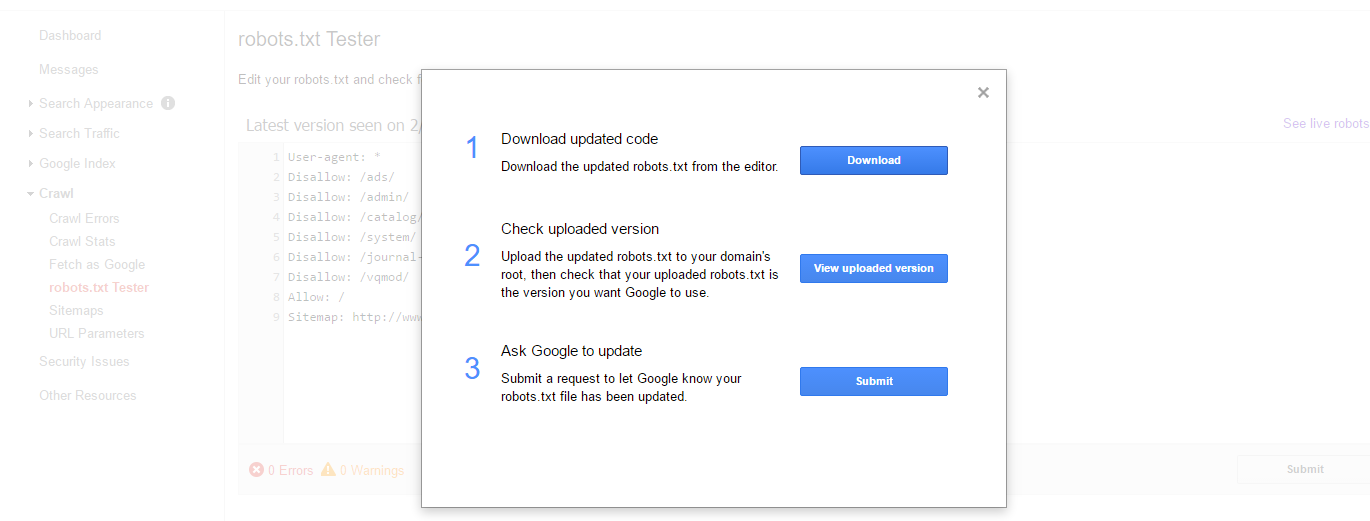

您可以使用webmaster面板工具https://www.google.com/webmasters/tools/robots-testing-tool并测试您的机器人文件,然后下载。

工作正常。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/39114878

复制相关文章

相似问题