尽管“健康”状态,但无法在中间层DC/OS上访问HDFS

尽管“健康”状态,但无法在中间层DC/OS上访问HDFS

提问于 2016-08-09 16:33:50

因此,我使用CloudFormation脚本/指令在AWS中部署了一个具有默认集群设置的这里 (5个私有从站、一个公共从站、一个主站,全部为m3.xlarge),并使用dcos命令:dcos package install hdfs在集群上安装了HDFS。

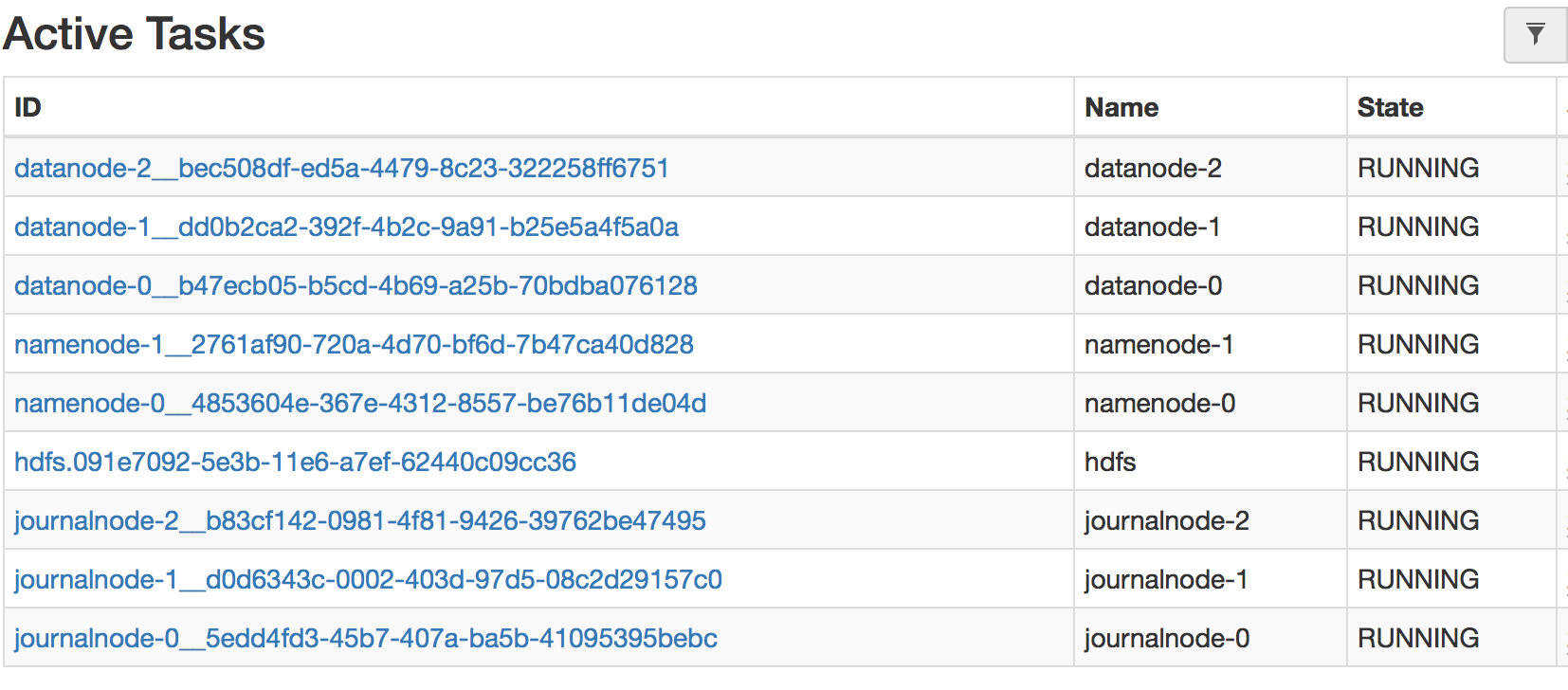

根据DC/OS网络用户界面和马拉松的说法,HDFS服务显然是健康的:

(问题)此时我应该能够将SSH放入我的从节点并执行hadoop fs命令,但这会返回错误-bash: hadoop: command not found (基本上告诉我这里没有安装hadoop )。

不存在来自HDFS服务的STDOUT和STDERR日志记录的错误,但就其价值而言,日志中出现了一条反复出现的“提供拒绝”消息:

Processing DECLINE call for offers: [ 5358a8d8-74b4-4f33-9418-b76578d6c82b-O8390 ] for framework 5358a8d8-74b4-4f33-9418-b76578d6c82b-0001 (hdfs) at scheduler-60fe6c75-9288-49bc-9180-f7a271c …

我肯定我错过了一些愚蠢的东西。

回答 1

Stack Overflow用户

回答已采纳

发布于 2016-08-10 19:53:27

因此,我想出了--一种解决方案,用于在安装后至少验证HDFS是否在您的Mesos /OS集群上运行。

- 使用

dcosCLI:dcos node ssh --master-proxy --leader进入您的主服务器 - 创建安装了hadoop的对接器容器,以查询HDFS:

docker run -ti cloudera/quickstart hadoop fs -ls hdfs://namenode-0.hdfs.mesos:9001/

为什么这不是一个好的解决方案&需要注意的是:

- 以前的文件都指向

hdfs://hdfs/的默认URL,它将抛出一个java.net.UnknownHostException。我不喜欢直接指向namenode。 - 其他文件建议您在SSH进入集群时可以运行

hdfs fs ...命令--这不像文档所描述的那样工作。 - 我用来测试您可以访问HDFS的映像是> 4GB (更好的选项?)

- 所有这些都没有被记录下来(或者至少不清楚/完全,所以我一直更新这篇文章)。为了找到答案,我不得不在DC/OS闲聊中寻找答案。

- 中间层/HDFS回购与通过

dcos package install hdfs安装的HDFS完全不同。这种回购不再被维护,新版本还没有开源(因此我猜缺乏当前的文档)。

我希望有一种更简单的方式与HDFS接口,但我仍然缺少。任何更好的解决方案仍然是非常有帮助的!

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/38856140

复制相关文章

相似问题