利用梯度梯度实现SARSA

我已经成功地实现了SARSA算法(包括一步和使用资格跟踪)使用表查找。本质上,我有一个Q值矩阵,其中每一行对应一个状态,每列对应一个动作。

类似于:

[Q(s1,a1), Q(s1,a2), Q(s1,a3), Q(s1,a4)]

[Q(s2,a1), (Q(s2,a2), Q(s2a3), Q(s2, a2]

.

.

.

[Q(sn,a1), Q(sn,a2), Q(sn,a3), Q(sn,a4)]在每一时间步骤中,从矩阵中选择一行,并根据策略根据SARSA规则选择和更新操作。

我现在试着用梯度下降作为神经网络来实现它。

我的第一个假设是建立一个两层网络,输入层的输入神经元和有状态的输入神经元一样多,输出层的输出神经元和动作的输出神经元数量一样多。每个输入将完全连接到每个输出。(因此,实际上,它看起来就像上面的矩阵)

我的输入向量是1xn行向量,其中n是输入神经元的数目。输入向量中的所有值都为0,但与当前状态对应的索引为1除外:

[0 0 0 1 0 0]将是处于状态4的代理的输入向量。

所以,这个过程应该是这样的:

[0 0 0 1 0 0] X [ 4 7 9 3]

[ 5 3 2 9]

[ 3 5 6 9]

[ 9 3 2 6]

[ 2 5 7 8]

[ 8 2 3 5]我创建了一个随机的样本权重矩阵。

其结果将是:

[9 3 2 6]这意味着,如果选择了贪婪的策略,就应该选择行动1,第四个输入神经元和第一个输出神经元之间的联系应该通过以下方式变得更强:

dw = dw_old + learning_rate*(reward + discount*network_output - dw_old)(摘自SARSA算法的方程)

但是-这个实现并不能让我信服。根据我所读到的,网络权重应该用来计算状态-动作对的Q值,但我不确定它们是否应该表示这样的值。(特别是因为我通常只看到权重值包含在0到1之间。)

有什么建议吗?

回答 1

Stack Overflow用户

发布于 2015-05-03 18:35:23

摘要:当前的方法是正确的,只是不应该将输出值限制在0到1之间。

此页有一个很好的解释,我将在这里总结。它没有专门讨论SARSA,但我认为它所说的一切都应该翻译。

结果向量中的值确实应该表示神经网络对与每个状态相关的q值的估计。因此,通常建议不要将允许值的范围限制在0到1之间(因此,只需将值乘以连接权重之和,而不是使用某种sigmoid激活函数)。

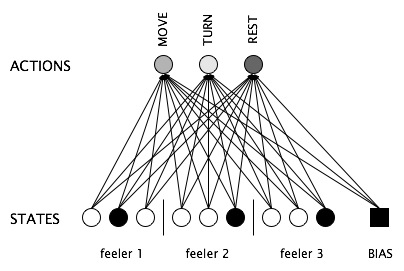

至于如何表示状态,一种选择是用代理拥有或理论上可能拥有的传感器来表示它们。例如,在下面的例子中,机器人有三个“触角”传感器,每个传感器都可以处于三种条件之一。他们一起向机器人提供所有关于它所处状态的信息。

但是,如果您想给您的代理提供完美的信息,您可以想象它有一个传感器,它确切地告诉它处于哪个状态,如此页末尾所示。这将完全按照当前网络设置的方式工作,每个状态都有一个输入。

https://stackoverflow.com/questions/29978406

复制相似问题