用于音频的卷积神经网络

我一直在学习关于DeepLearning.net的教程,以学习如何实现从图像中提取特征的卷积神经网络。本教程解释得很好,易于理解和遵循。

我想扩展相同的CNN,同时从视频(图像+音频)中提取多模态特征。

我知道视频输入只不过是在一段时间内显示的一系列图像(像素强度)。30 FPS)与音频相关。然而,我并不真正理解什么是音频,它是如何工作的,或者它是如何分解成网络的。

我读过几篇关于这个主题的论文(多模特征提取/表示),但是没有人解释过音频是如何输入到网络中的。

此外,我从我的研究中了解到,多模态表征是我们大脑真正运作的方式,因为我们没有刻意过滤掉我们的感官来实现理解。这一切都是在我们不知道的情况下同时发生的(联合代表)。一个简单的例子是,如果我们听到狮子的咆哮声,我们会立刻形成狮子的心理形象,感受危险,反之亦然。我们大脑中会激发多种神经模式,以全面了解狮子的长相、声音、感觉、气味等。

上面提到的是我的最终目标,但就目前而言,为了简单起见,我正在分解我的问题。

如果有人能了解音频是如何分解的,然后再用卷积神经网络来表示,我会非常感激。我也会感谢你的想法,关于多模式同步,联合申述,以及什么是正确的方式训练一个CNN与多模数据。

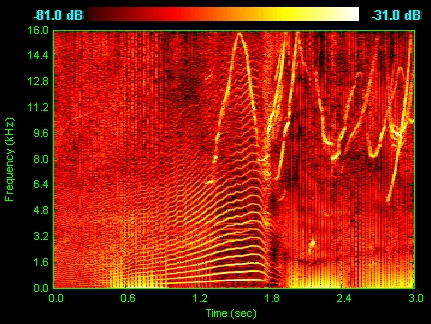

编辑:我发现音频可以用光谱图来表示。它是音频的通用格式,并表示为具有两个几何尺寸的图形,其中水平线代表时间,垂直表示频率。

是否可以在这些光谱图上使用同样的技术来处理图像?换句话说,我可以简单地使用这些光谱图作为我的卷积神经网络的输入图像吗?

回答 2

Stack Overflow用户

发布于 2015-10-11 12:04:33

我们在光谱图上使用深卷积网络来完成口语识别任务。我们在这次TopCoder比赛提供的数据集上的准确率约为95%。细节是这里。

普通卷积网络不能捕捉时间特性,因此,例如在这项工作中,卷积网络的输出被馈送给一个时滞神经网络。但是,我们的实验表明,即使没有额外的元素,卷积网络也能很好地执行某些任务,当输入具有相同的大小时。

Stack Overflow用户

发布于 2014-05-24 01:54:15

为了训练分类器,从音频数据中提取特征向量有很多种方法。最常用的是MFCC (MEL-Frequency倒谱),你可以把它看作是一个“改进的”谱图,保留更多的相关信息来区分类别。其他常用的技术是PLP (感知线性预测),也取得了很好的效果。这些仍然是许多不太为人所知的。

最近,深层网络被用来自动提取特征向量,因此,我们在图像识别中所做的类似的事情也是如此。这是一个活跃的研究领域。不久前,我们还使用特征提取器来训练图像(SIFT、HOG等)的分类器,但这些方法被深度学习技术所取代,它们将原始图像作为输入,并自行提取特征向量(实际上,这就是深度学习的真正意义)。

注意音频数据是连续的也是非常重要的。在训练分类器之后,需要将序列模型训练为HMM或CRF,它选择最有可能的语音单元序列,使用分类器给出的概率作为输入。

学习语音识别的一个好起点是Jursky和Martins:言语和语言处理。它很好地解释了所有这些概念。

编辑:添加一些可能有用的信息

有很多语音识别工具包都有从音频文件中提取MFCC特征向量的模块,但使用起来并不总是那么简单。我目前正在使用CMU Sphinx4。它有一个名为FeatureFileDumper的类,它可以独立用于从音频文件生成MFCC矢量。

https://stackoverflow.com/questions/22471072

复制相似问题