我可以使用RDMA通过无限带加载/存储访问从GPU2核心到GPU1-RAM在不同的PCIe总线?

我可以使用RDMA通过无限带加载/存储访问从GPU2核心到GPU1-RAM在不同的PCIe总线?

提问于 2013-11-19 11:04:09

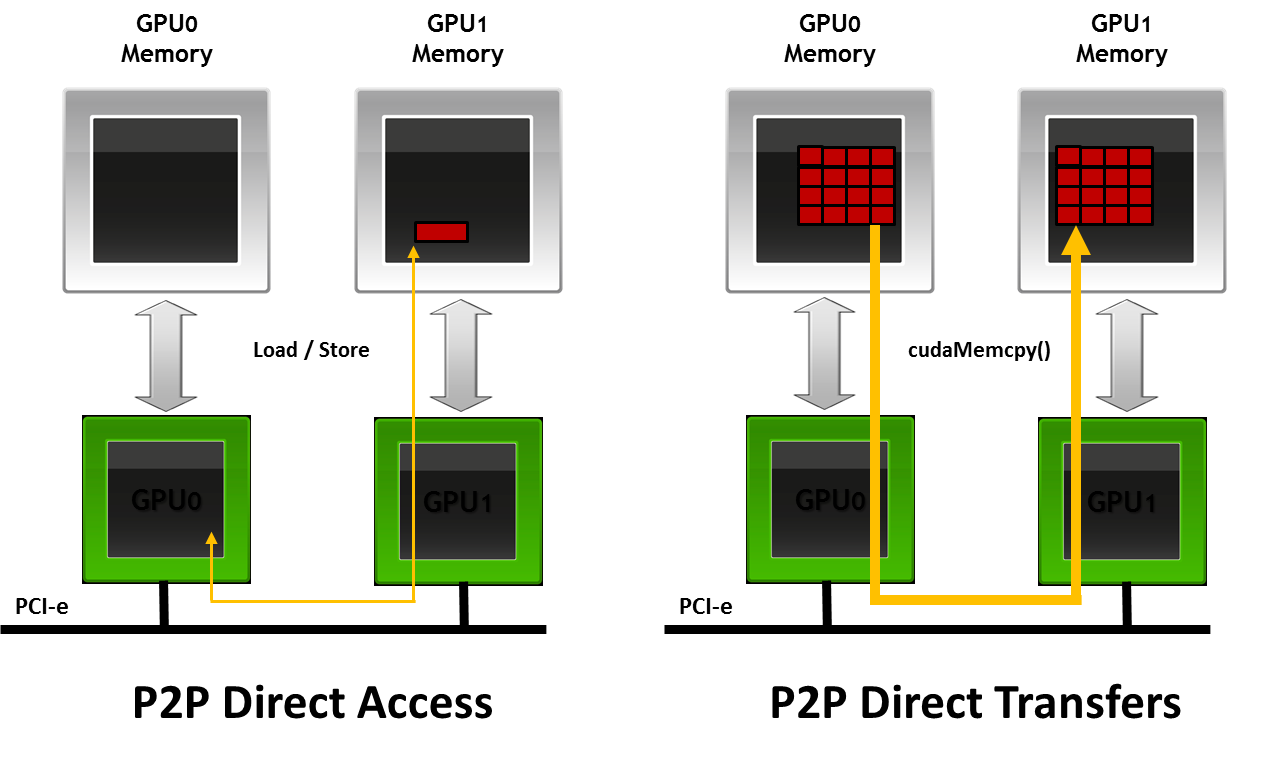

如前所述:https://developer.nvidia.com/gpudirect我可以从GPU0-Core访问同一个PCIe总线上的GPU1-RAM:

- 装载/储存

cudaMemcpy()

它被命名为"NVIDIA GPUDirect v2 Peer (P2P)在同一PCIe总线上的GPU通信“(2011年):

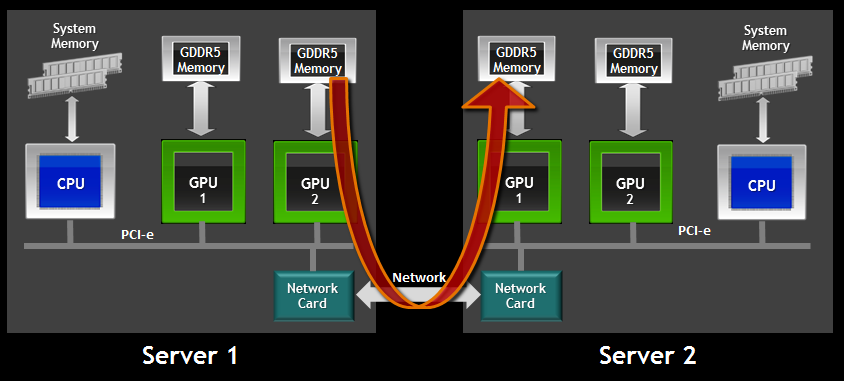

我可以通过Infiniband使用RDMA在不同的PCIe总线上将GPU2-RAM复制到GPU1-RAM,它被命名为“GPUDirect支持,在CUDA 5(2012)中引入的。”

但是,我可以在通过Infiniband连接的PCIe总线上使用RDMA吗?

- 加载/存储(从GPU2-Core访问GPU)

cudaMemcpy()(从GPU2-RAM复制到GPU1-RAM)

或者只能在RDMA中使用cudaMemcpy()?

回答 1

Stack Overflow用户

回答已采纳

发布于 2013-11-19 16:07:00

Mellanox目前只有一个GPUDirect公共实现。您需要使用类似于CUDA感知的MPI系统之一的东西来利用它。

在您演示的示例中,不能使用cudaMemcpy从GPU1复制到GPU2,即不能使用cudaMemcpy直接在驻留在不同主机系统中的GPU1之间进行复制。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/20069776

复制相关文章

相似问题