帮助我理解二进制支持向量机中的线性可分性

我在math.stackexchange.com上发布了这篇文章,因为我没有收到任何反馈,这对我来说是一个时间敏感的问题。

我的问题是关于支持向量机中超平面的线性可分性。

根据维基百科

支持向量机( ...formally )是在高维或无限维空间中构造超平面或超平面集的支持向量机,可用于分类、回归或其他任务。直观地说,通过与任何类最近的训练数据点(所谓的函数边缘)有最大距离的超平面来实现良好的分离,因为一般来说,边缘越大,classifier.classifier的泛化误差就越小。

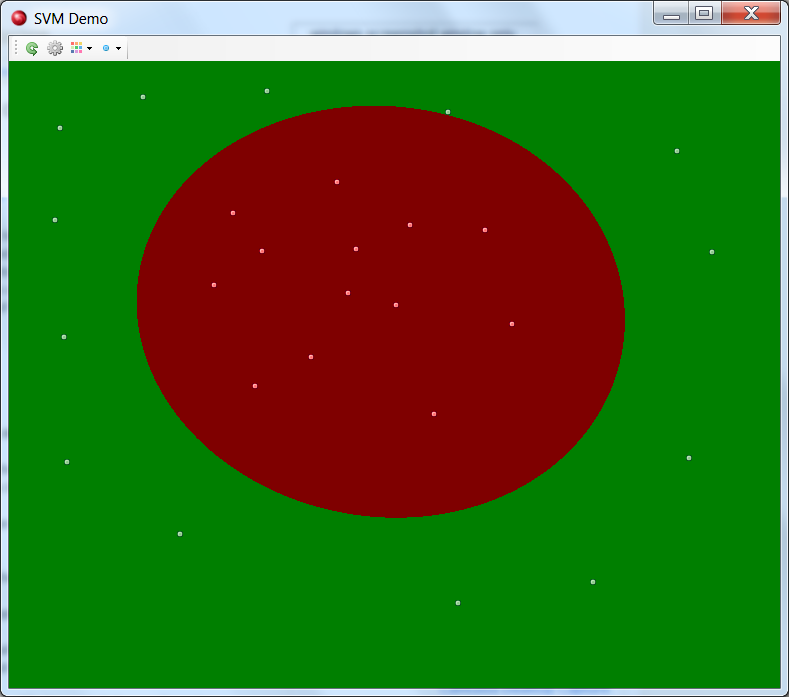

用超平面线性分离类对我来说是有意义的。我想我理解二维几何的线性可分性。然而,我使用一个流行的支持向量机库(libSVM)来实现支持向量机,当我处理这些数字时,我不明白当n维空间V中的超平面是维数n−1的“平坦”子集时,当n维空间V中的超平面是维n−1的“平坦”子集或二维空间的1D线时,支持向量机如何能够在类之间创建曲线,或者将第1类的中心点包围在第2类中的圆曲线中。

我的意思是:

那不是超平面。那是圆形的。这是怎么回事?还是支持向量机内部的维数比二维输入特征多?

此示例应用程序可以下载这里。

编辑:

谢谢你的全面回答。因此,支持向量机可以很好地利用核函数对奇异数据进行分离。将数据线性化后再发送给支持向量机会有帮助吗?例如,我的一个输入特性(一个数值)有一个转折点(例如。0)如果它完全属于第1类,但高于或低于0,则属于第2类。现在,由于我知道这一点,将这个特征的绝对值发送给支持向量机,会不会有助于分类?

回答 7

Stack Overflow用户

发布于 2010-10-22 14:18:19

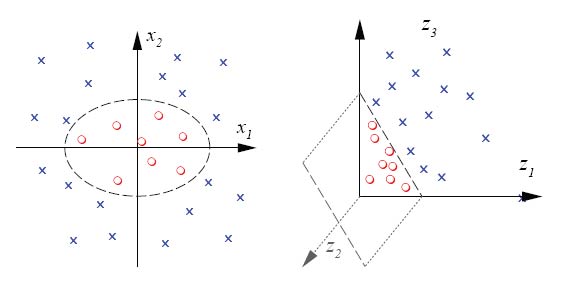

正如mokus所解释的,支持向量机使用核函数隐式地将数据映射到一个特征空间,其中它们是线性可分的:

不同的核函数用于不同类型的数据。请注意,图片中的转换添加了一个额外的维度(特性),尽管这个特性从未在内存中具体化。

(插图取自克里斯·桑顿,苏塞克斯大学.)

Stack Overflow用户

发布于 2010-10-23 03:34:55

看看这个YouTube视频,它演示了一个线性不可分离的点的例子,当映射到一个更高的维度时,这些点会被平面所分离。

Stack Overflow用户

发布于 2010-10-22 14:00:21

我对SVMs并不十分熟悉,但我从我的研究中回忆起来,它们经常与“核函数”一起使用--本质上,是对标准内积的一种替代,有效地使空间非线性。从你的空间到某个应用线性分类器的“工作空间”的非线性变换,然后把结果拉回你原来的空间,在那里分类器工作的线性子空间不再是线性的。

维基百科的文章在“非线性分类”小节中确实提到了这一点,并提供了一个指向把戏的链接,该链接更广泛地解释了这种技术。

https://stackoverflow.com/questions/3997454

复制相似问题