DataBricks无法显示来自DataBricks 2的数据

DataBricks无法显示来自DataBricks 2的数据

提问于 2021-08-18 11:26:33

我们正在从blob存储迁移到ADLS 2,我们希望测试从DataBricks访问数据湖的情况。我创建了一个服务主体,它具有和访问Data的权限。

我的笔记本设置了以下星火配置:

spark.conf.set("fs.azure.account.auth.type","OAuth")

spark.conf.set("fs.azure.account.oauth.provider.type","org.apache.hadoop.fs.azurebfs.oauth2.ClientCredsTokenProvider")

spark.conf.set("fs.azure.account.oauth2.client.id","<clientId")

spark.conf.set("fs.azure.account.oauth2.client.secret","<secret>")

spark.conf.set("fs.azure.account.oauth2.client.endpoint","https://login.microsoftonline.com/<endpoint>/oauth2/token")

//I replaced the values in my notebook with correct values from my service principal当我运行以下代码时,目录的内容将正确显示:

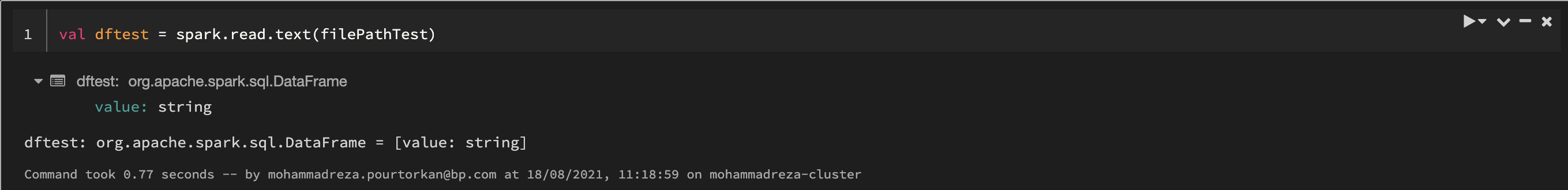

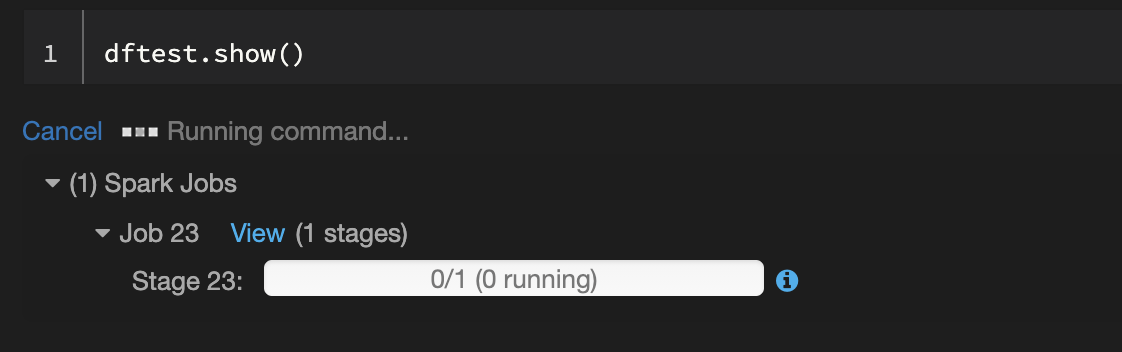

dbutils.fs.ls("abfss://ado-raw@<storage account name>.dfs.core.windows.net")我可以从我的数据湖读取一个小的文本文件,它只有3个字节,但是当我试图显示它的内容时,单元格会被命令卡住,什么也不会发生。

你觉得问题是什么?我该怎么解决呢?

提前感谢

回答 1

Stack Overflow用户

回答已采纳

发布于 2021-08-20 15:00:00

问题是私人和公共子网因错误而被删除,然后使用不同的IP范围重新创建。它们需要在与管理子网相同的范围内,否则为存储帐户设置的私有端点将无法工作。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/68831453

复制相关文章

相似问题