火花提交错误:无效的最大堆大小:-xmx4g--jars,但系统上内存足够

火花提交错误:无效的最大堆大小:-xmx4g--jars,但系统上内存足够

提问于 2020-02-11 00:42:06

我正在运行一个火花作业:

spark-submit --master spark://ai-grisnodedev1:7077 --verbose --conf spark.driver.port=40065 --driver-memory 4g

--jars /opt/seqr/.conda/envs/py37/lib/python3.7/site-packages/hail/hail-all-spark.jar

--conf spark.driver.extraClassPath=/opt/seqr/.conda/envs/py37/lib/python3.7/site-packages/hail/hail-all-spark.jar

--conf spark.executor.extraClassPath=./hail-all-spark.jar ./hail_scripts/v02/convert_vcf_to_hail.py ./hgmd_pro_2019.4_hg38.vcf -ht

--genome-version 38 --output ./hgmd_pro_2019.4_hg38.ht这个命令给出了一个错误:

无效的最大堆大小:-Xmx4g--jars错误:无法创建Java。错误:发生致命异常。程序将退出。

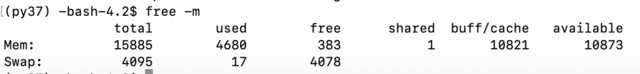

我检查了记忆:

所以,看起来挺好的。我查过java了

(py37) -bash-4.2$ java -version

openjdk version "1.8.0_232"

OpenJDK Runtime Environment (build 1.8.0_232-b09)

OpenJDK 64-Bit Server VM (build 25.232-b09, mixed mode)然后,我在Chrome中检查了spark是否在ai-grisnodedev1:7077上运行,它与一个工作人员一起运行。如果我使用ipython,我可以在https://hail.is/docs/0.2/getting_started.html上运行简单的install示例

import hail as hl

mt = hl.balding_nichols_model(n_populations=3, n_samples=50, n_variants=100)

mt.count()因此,依赖于Hail的Spark也起作用了。也许我的命令格式错误,或者一些文件被破坏了,但是这个错误是非常误导的。我能做些什么来调试这个问题呢?

回答 2

Stack Overflow用户

回答已采纳

发布于 2020-02-11 00:50:11

我刚把问题发了出来,马上就解决了,尽管非常绝望。问题是,我在几个编辑器和后面复制粘贴命令,在--driver-memory 4g之后可能出现了一些错误的字符。我刚刚删除了空格(可能不是空格),重新插入它们,它就开始工作了。如果说为什么,也许是tab或newline搞砸了。我用的是Microsoft One Note -也许它是在修改空间.

Stack Overflow用户

发布于 2021-10-14 16:37:41

我也有这个问题。总之,我用的是pySpark。对我来说,这是spark.executor.memory接受的问题,例如16gb,而spark.driver.memory只接受16g-> b in g__b中的错误(老实说,这有点不直观)。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/60160477

复制相关文章

相似问题