实例规范化与批处理大小1

实例规范化与批处理大小1

提问于 2020-06-13 07:52:04

我真的很困惑Instance Norm的含义,以及我是否可以在批处理大小为1的情况下使用它。我使用的是PyTorch,文档中没有提到批处理大小应该大于1。

我知道,对于BatchNorm,当批处理大小小于8时,性能会受到不利影响,因此它对批处理大小设置了某种软约束。然而,我没有看到任何这样的分析,例如诺姆,现在有点困惑。如果我的批次大小是1,我应该删除标准层吗?

回答 1

Stack Overflow用户

回答已采纳

发布于 2020-06-13 15:23:20

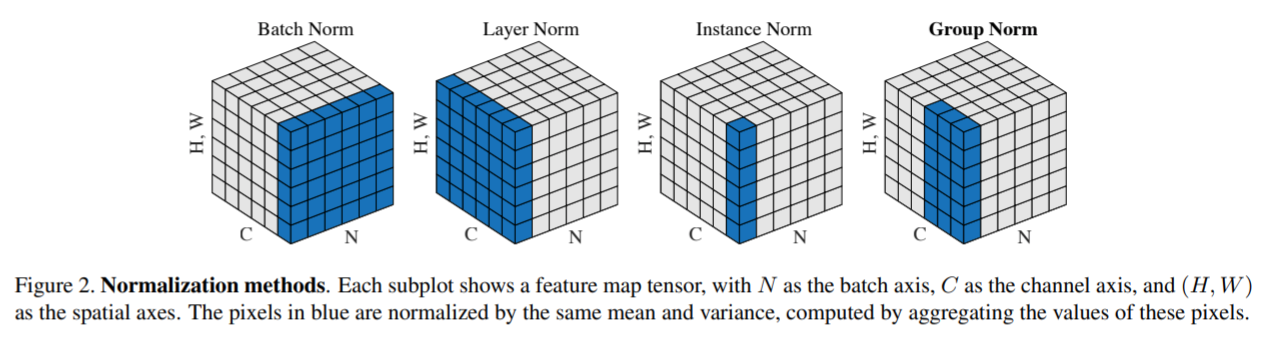

群归一化纸很好地概述了不同的规范。

实例正常化概括为:

..。在计算中,每个样本和每个通道沿(H,W)轴进行σ。

平均偏差和标准差仅在空间维数(H,W)上计算,并且与批次大小和通道无关(有N不同的范数)。因此,您可以使用它的批处理大小为1。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/62356985

复制相关文章

相似问题