BROADCASTJOIN提示不适用于PySpark SQL

我试图提供广播提示的表是较小的规模,但物理计划仍然显示给我SortMergeJoin。

spark.sql('select /*+ BROADCAST(pratik_test_temp.crosswalk2016) */ * from pratik_test_staging.crosswalk2016 t join pratik_test_temp.crosswalk2016 c on t.serial_id = c.serial_id').explain()

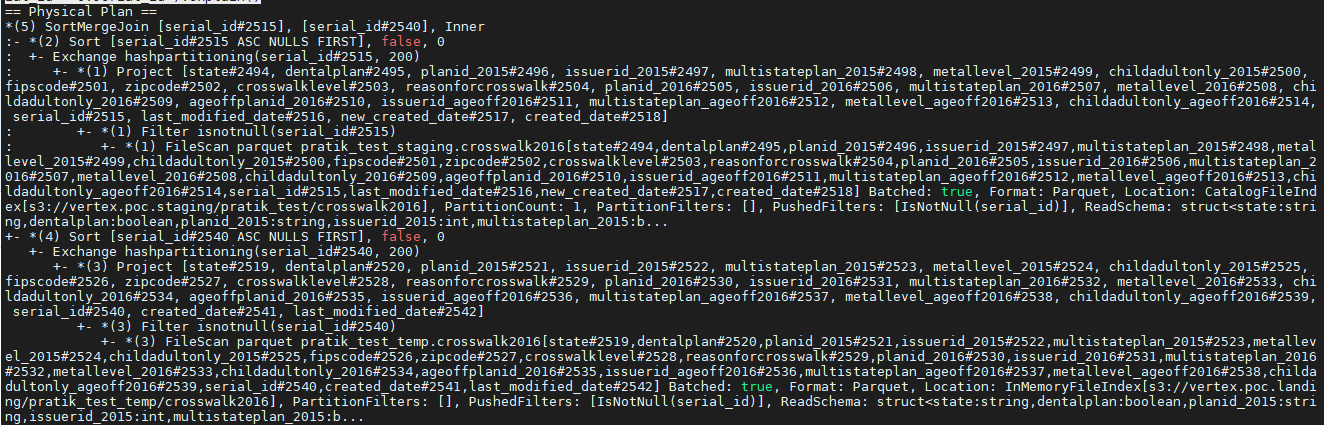

产出:

注意:

表的

- 大小在KBs (测试数据)

- 连接列'serial_id‘不分区列

- 中使用胶水目录作为亚稳态(AWS)

- Spark版本-Spark2.4.4

H 111我尝试过BROADCASTJOIN和MAPJOIN提示,以及H 212H 113当我尝试使用created_date分区列而不是serial_id作为我的连接条件时,它显示的是BroadCast连接-<>H 216/code>

spark.sql('select /*+ BROADCAST(pratik_test_temp.crosswalk2016) */ * from pratik_test_staging.crosswalk2016 t join pratik_test_temp.crosswalk2016 c on t.created_date = c.created_date').explain()

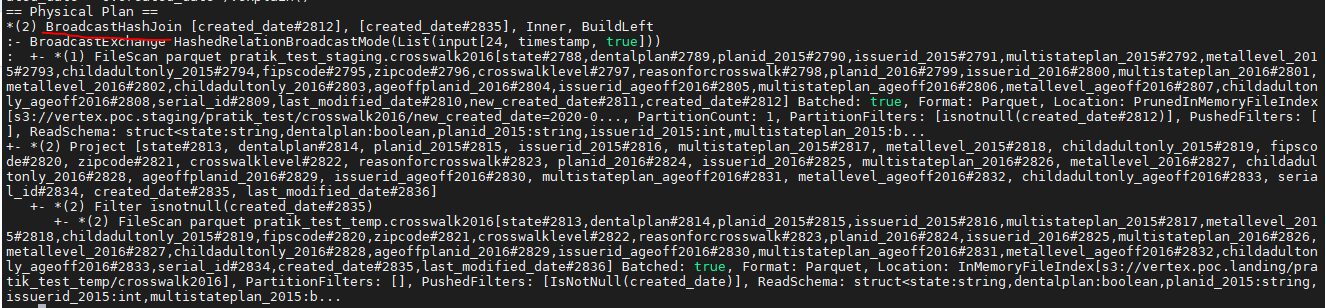

产出-

为什么火花行为是奇怪的AWS胶目录作为我的亚稳态?

回答 1

Stack Overflow用户

发布于 2020-06-28 13:45:48

在BROADCAST提示中,我们需要传递alias name of the table (因为您在sql语句中保留了别名)。

尝试使用/*+ BROADCAST(c) */*而不是/*+ BROADCAST(pratik_test_temp.crosswalk2016) */ *

spark.sql('select /*+ BROADCAST(c) */ * from pratik_test_staging.crosswalk2016 t join pratik_test_temp.crosswalk2016 c on t.serial_id = c.serial_id').explain()https://stackoverflow.com/questions/62622742

复制相似问题