CNN特征提取

CNN特征提取

提问于 2021-08-22 10:05:08

class ResNet(nn.Module):

def __init__(self, output_features, fine_tuning=False):

super(ResNet, self).__init__()

self.resnet152 = tv.models.resnet152(pretrained=True)

#freezing the feature extraction layers

for param in self.resnet152.parameters():

param.requires_grad = fine_tuning

#self.features = self.resnet152.features

self.num_fts = 512

self.output_features = output_features

# Linear layer goes from 512 to 1024

self.classifier = nn.Linear(self.num_fts, self.output_features)

nn.init.xavier_uniform_(self.classifier.weight)

self.tanh = nn.Tanh()

def forward(self, x):

h = self.resnet152(x)

print('h: ',h.shape)

return h

image_model_resnet152=ResNet(output_features=10).to(device)

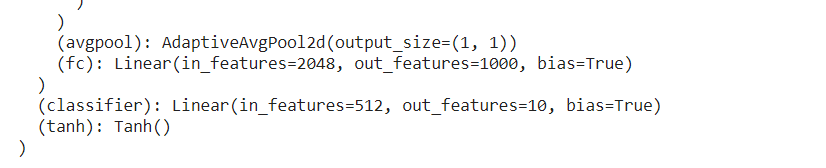

image_model_resnet152在这里,在打印image_model_resnet152之后,我得到:

在这里,(avgpool): Linear(in_features=2048)和(classifier): Linear(in_features=512)有什么区别?

我正在实现一个图像标题模型,那么对于一个图像,我应该使用哪个in_features呢?

回答 1

Stack Overflow用户

回答已采纳

发布于 2021-08-22 10:40:31

ResNet并不像VGG那样简单:它不是一个顺序模型,即在forward的torchvision.models.resnet152定义中有一些特定于模型的逻辑,例如,CNN和分类器之间的特征的平坦。你可以看看它的源代码。

在这种情况下,最简单的方法是在CNN的最后一层添加一个钩子:layer4,并将该层的结果记录在外部数据块中。这是用register_forward_hook完成的。

定义钩子:

out = {}

def result(module, input, output):

out['layer4'] = output将钩子连接到子模块resnet.layer4上

>>> x = torch.rand(1,3,224,224)

>>> resnet = torchvision.models.resnet152()

>>> resnet.layer4.register_forward_hook(result)推断之后,您将可以访问out内部的结果。

>>> resnet(x)

>>> out['layer4']

(1, 2048, 7, 7)您可以在更深入地使用前向挂钩的情况下查看我的另一个答案。

一项可能的执行办法是:

class NN(nn.Module):

def __init__(self):

super().__init__()

self.resnet = torchvision.models.resnet152()

self.resnet.layer4.register_forward_hook(result)

self.out = {}

@staticmethod

def result(module, input, output):

out['layer4'] = output

def forward(self, x):

x = self.resnet(x)

return out['layer4']然后,您可以为您的自定义分类器定义其他层,并在forward中调用它们。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/68880288

复制相关文章

相似问题