读写器读取json返回_corrupt_record

读写器读取json返回_corrupt_record

提问于 2022-08-23 16:13:13

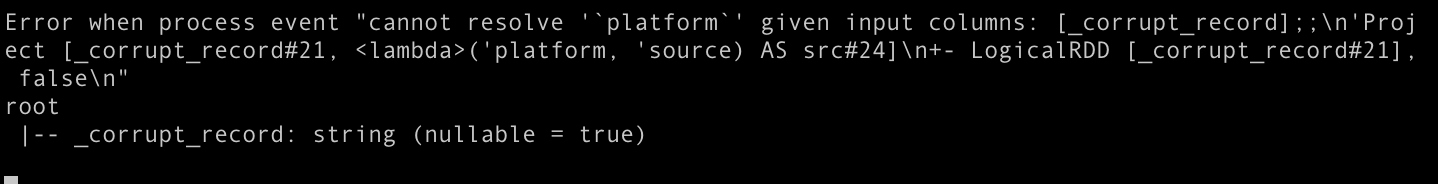

我正在使用pyspark和卡夫卡,但它正在返回_corrupt_record。我将https://spark.apache.org/docs/latest/sql-data-sources-json.html设置为True,但没有工作。我是不是忘了什么配置?

回答 1

Stack Overflow用户

发布于 2022-08-23 16:18:11

请尝试在代码中使用read多行JSON,如下所示。

val df = spark.read.option("multiline","true").json("C:\\data\\nested-data.json")页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/73461990

复制相关文章

相似问题