如何使用基于规则的“专家”进行模仿学习?

如何使用基于规则的“专家”进行模仿学习?

提问于 2022-04-09 11:04:41

我目前正在训练一个PPO模型来进行模拟。PPO模型不能理解某些条件会导致没有回报。

这些导致没有报酬的条件是非常简单的规则。我试图用这些规则创建一个PPO模型可以用来模仿学习的“专家”。

基于专家的规则的示例:

如果资源A不可用,则不要选择该资源。

如果"X“和"Y”不匹配,那么就不要选择那些。

带有模拟库的示例

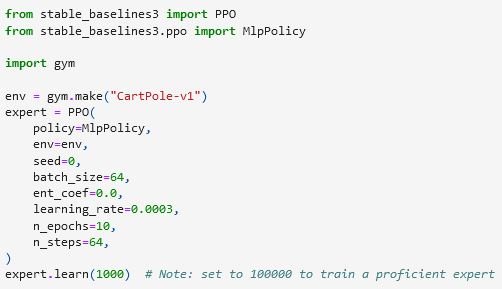

我在看“模仿”python库。这里的例子显示了一个专家,它是一个具有更多迭代的PPO模型。

https://github.com/HumanCompatibleAI/imitation/blob/master/examples/1_train_bc.ipynb

问题:

有没有一种方法可以将简单的“基于规则的”专家转换成一个PPO模型,用于模仿学习?

或者,在模仿学习中使用“基于规则”的专家有不同的方法吗?

回答 1

Stack Overflow用户

回答已采纳

发布于 2022-04-09 12:03:01

观察行为克隆是如何实施的:

from imitation.algorithms import bc

bc_trainer = bc.BC(

observation_space=env.observation_space,

action_space=env.action_space,

demonstrations=transitions,

)你所要做的就是创建演示。您甚至不需要编写“代理”本身。只需使用基于规则的机器人生成与环境交互的序列,仅此而已。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/71807485

复制相关文章

相似问题