无法将示例字数作为火花作业处理

无法将示例字数作为火花作业处理

提问于 2022-01-28 08:14:37

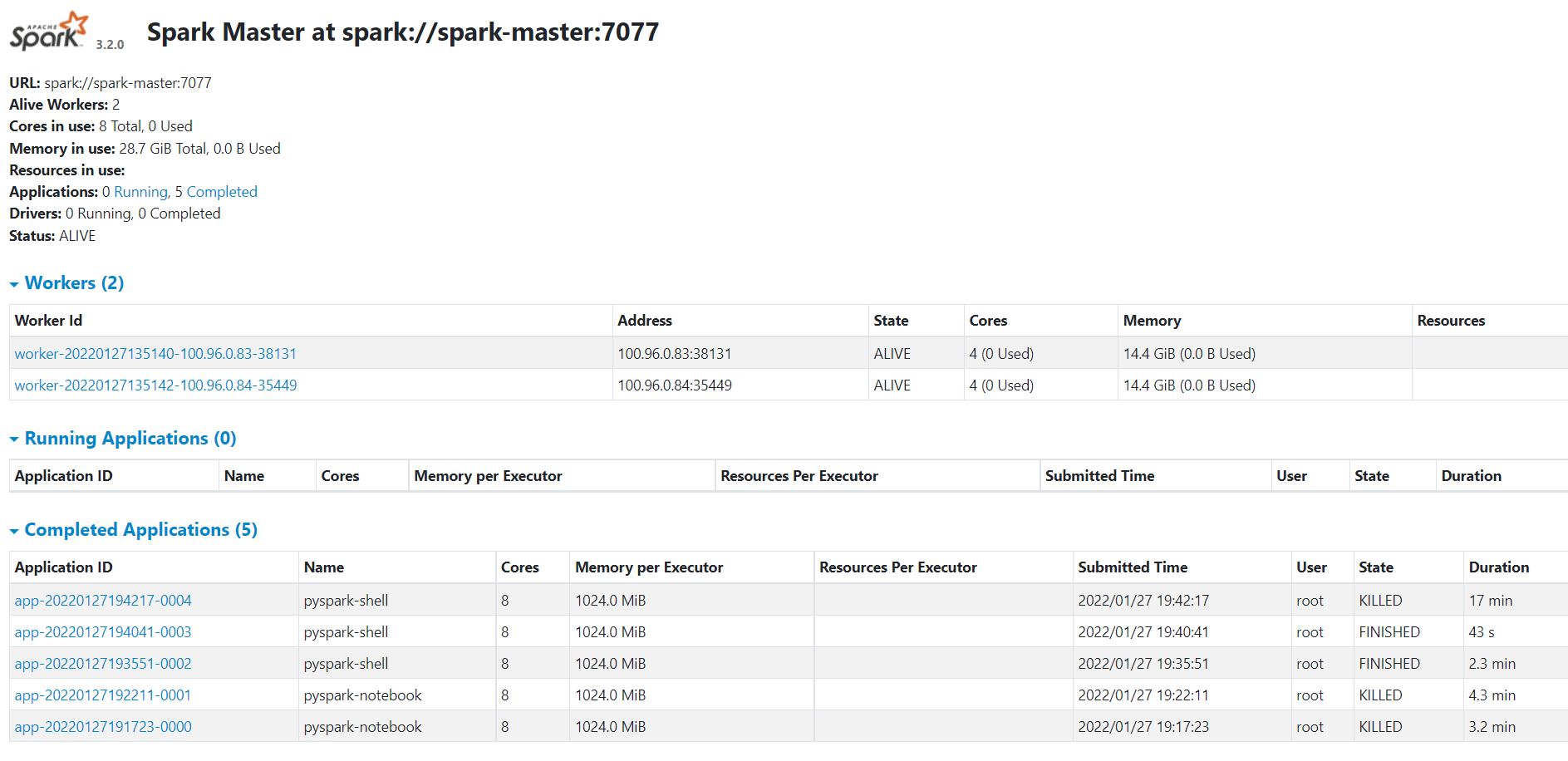

我有火花主人和火花工作者运行在SAP Kyma环境(不同口味的Kubernetes)和木星实验室与充分的CPU和RAM分配。

我可以访问星火主用户界面,并看到工人也注册了(下面的屏幕快照)。

我正在使用Python3提交作业(下面的片段)

import pyspark

conf = pyspark.SparkConf()

conf.setMaster('spark://spark-master:7077')

sc = pyspark.SparkContext(conf=conf)

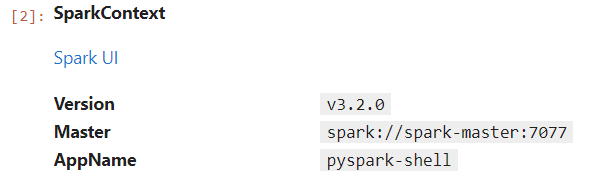

sc并且可以将星火上下文看作sc的输出。在此之后,我正在准备将数据提交给火花主(下面的片段)。

words = 'the quick brown fox jumps over the lazy dog the quick brown fox jumps over the lazy dog'

seq = words.split()

data = sc.parallelize(seq)

counts = data.map(lambda word: (word, 1)).reduceByKey(lambda a, b: a + b).collect()

dict(counts)

sc.stop()但是它开始将警告信息记录在笔记本上(下面的片段),直到我从火星主用户界面中删除这个进程。

22/01/27 19:42:39 WARN TaskSchedulerImpl: Initial job has not accepted any resources; check your cluster UI to ensure that workers are registered and have sufficient resources

22/01/27 19:42:54 WARN TaskSchedulerImpl: Initial job has not accepted any resources; check your cluster UI to ensure that workers are registered and have sufficient resources我是基玛(库伯内特斯)和斯派克的新手。任何帮助都将不胜感激。

谢谢

回答 1

Stack Overflow用户

回答已采纳

发布于 2022-10-29 16:30:31

对于那些无意中遇到同样问题的人。

检查您的基础设施证书。事实证明,库伯奈特夫妇签发了错误的内部证书,而这一证书没有得到船舱的认可。

在我们修复证书之后,所有的人都开始工作了。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/70890614

复制相关文章

相似问题