如何确定激活函数?

目前有许多激活函数,如sigmoid、tanh、ReLU (是首选),但我有一个问题,即需要考虑哪些选择才能选择特定的激活函数。

例如:当我们想在GANs中更新一个网络时,我们更喜欢使用LeakyReLU。

我是这门学科的新手,还没有找到在不同情况下使用哪种激活功能的具体解决方案。

我的知识直到现在:

Sigmoid :当您有一个二进制类要识别时

唐:?

ReLU:?

LeakyReLU :当你想要升级时

如有任何帮助或文章,将不胜感激。

回答 1

Stack Overflow用户

发布于 2022-01-25 14:57:36

这是一个公开的研究问题。激活的选择也与模型的体系结构和可用的计算/资源交织在一起,所以不能用筒仓来回答。论文LeCun et.阿尔。对什么是良好的激活功能有了很好的见解。

尽管如此,这里有一些玩具例子,可能有助于获得激活功能的直觉。考虑具有一个隐藏层和一个简单分类任务的简单MLP:

在最后一层,我们可以结合使用sigmoid和binary_crossentropy损失,以便使用logistic回归的直觉--因为我们只是对隐藏层提供给最后一层的学习特性进行简单的logistic回归。

学习什么类型的特征取决于在该隐藏层中使用的激活函数和该隐藏层中的神经元数量。

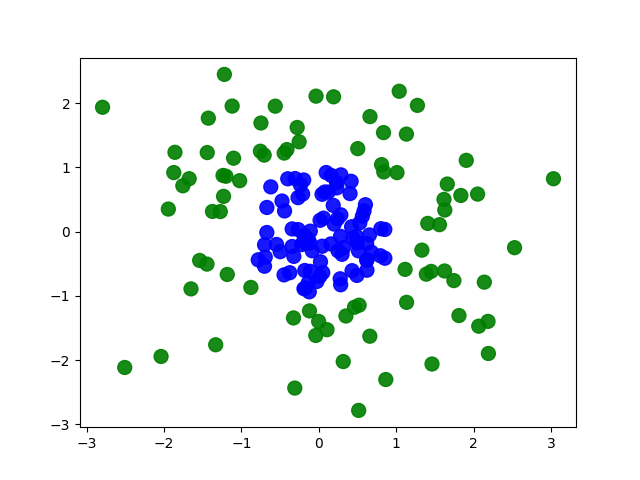

下面是ReLU在使用两个隐藏神经元时学到的内容:

(左边是决策边界在特征空间中的样子)

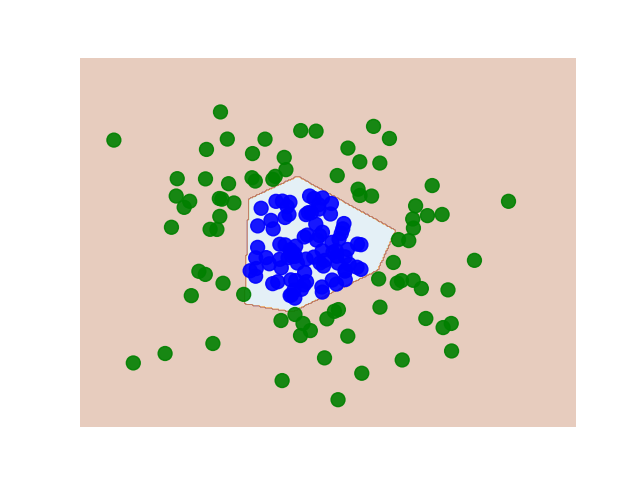

当你加入更多的神经元时,你会得到更多的片段来逼近决策边界。这里有三个隐藏的神经元:

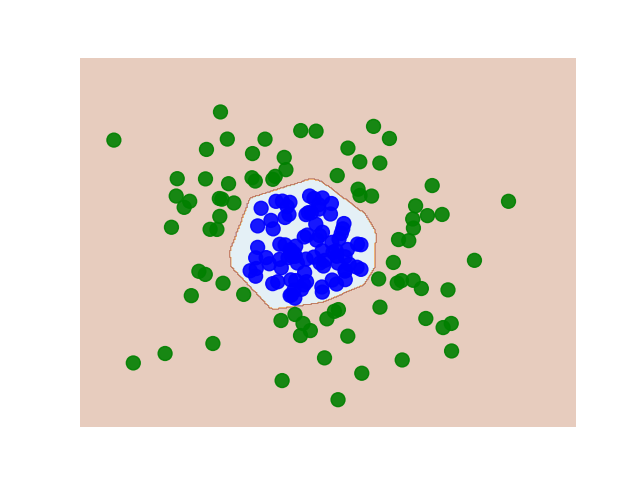

10个隐藏的神经元:

Sigmoid和Tanh产生相似的衰变边界(这是tanh,jynT0RkGsZFqt3WSFcez4w.gif - sigmoid是相似的),它们更加连续和正弦。

主要的区别是sigmoid不是以零为中心的,这并不能使它成为隐藏层的好选择--尤其是在深网络中。

https://stackoverflow.com/questions/70844105

复制相似问题