SimpleTransformers模型没有对整个数据进行培训(如在历元栏下的括号中所示)?

SimpleTransformers模型没有对整个数据进行培训(如在历元栏下的括号中所示)?

提问于 2021-12-26 13:53:49

我的数据有1751个句子,然而,当训练一个数字出现在时代栏下。有时候是1751

我试着查看文档以了解这个数字是否应该与我的训练集大小相同,但我找不到答案。

我正在使用GPU后端的Kaggle。这是否意味着该模型确实没有对所有数据进行培训?

回答 1

Stack Overflow用户

回答已采纳

发布于 2022-03-24 19:16:48

简而言之:不,这是关于所有数据的培训。

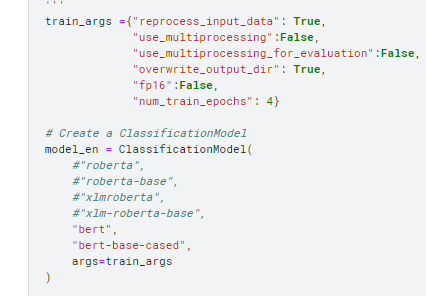

首先,让我们看看其中的一些参数:

num_of_train_epochs: 4:您的设置,意味着整个数据集将被训练4次。这就是为什么输出中有4小节的原因。

train_batch_size: 8:这是默认设置,意思是在每次更新权重时,您在训练数据中使用8条记录(总共1751条)

这意味着,总共有1751/8 =每一时期218.875批,这是你在输出中看到的219/219。

您在底部看到的876只意味着它总共经历了219次(每一个时期批处理)*4(纪元数)= 876个批/更新。

证明这一点的一种方法是将num_of_train_epochs改为1,你应该看到219而不是876。

批次和时代的定义

批处理大小是在更新模型之前处理的大量样本。历元数是经过训练数据集的完整次数。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/70486977

复制相关文章

相似问题