为什么在这些模型的某个时期,精度突然提高?

为什么在这些模型的某个时期,精度突然提高?

提问于 2021-12-19 14:46:32

我现在正在学习卷积神经网络,并在Pytorch上练习。最近,我一直在阅读与优化器相关的论文,如SGD、Adam和Radam。

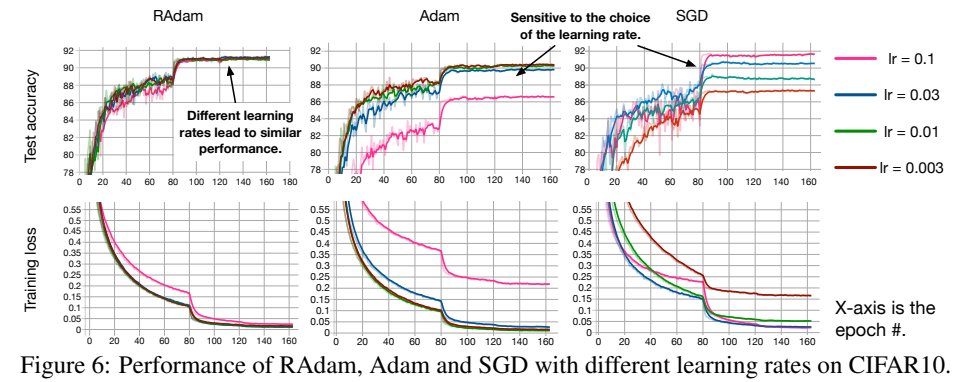

当查看论文的视觉结果时,我发现它们的图像在第80个时代(纸上的figure6“关于自适应学习率的变化及以后”)的准确性突然提高了。

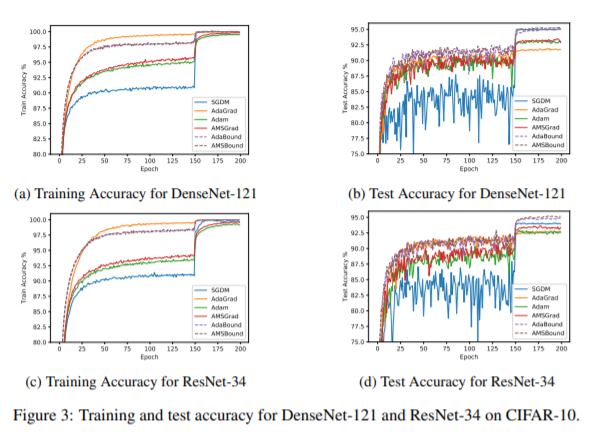

或150年代(论文中的figure3 -具有学习速率的自适应梯度方法)

不管是哪种算法。

有人能告诉我为什么会这样吗?谢谢。

回答 2

Stack Overflow用户

发布于 2021-12-19 19:34:24

如果您的实现是正确的,这可能意味着您的模型在这一时刻学习了一些非常有用的东西(因此您的梯度下降找到了一个转折点)。例如,模型必须自己学习输入的正确规范化。看到损失有这样的“阶梯”损失图并不少见,我以前见过这个(但不记得确切的位置)。

这也意味着您使用的是低效的权值初始化,因此您的优化算法必须手动找到最佳的正确方法。

Stack Overflow用户

发布于 2021-12-19 21:07:57

它们大大降低了学习速度。它们可能从太大的学习率开始,以至于无法快速得到一些“平均”模型,然后降低学习速度,将模型调整到更高的精度水平。在学习率下降的情况下,有很多种训练方法。他们选择了这样的。

在“学习速率的自适应梯度法”一文中,他们说它们降低了学习率:

我们采用200个时代的固定预算,并在150个时代后将学习率降低10个。

也许在另一篇论文中,他们也是这样做的,但他们并没有写。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/70412433

复制相关文章

相似问题