如何部署sagemaker.workflow.pipeline.Pipeline?

如何部署sagemaker.workflow.pipeline.Pipeline?

提问于 2021-12-09 08:59:47

我有一个sagemaker.workflow.pipeline.Pipeline,它包含多个sagemaker.workflow.steps.ProcessingStep,每个ProcessingStep都包含sagemaker.processing.ScriptProcessor。

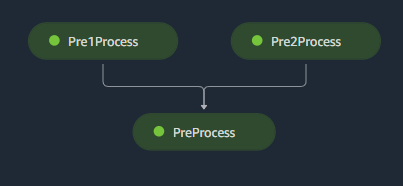

当前管道图如下图所示。它将从S3获取来自多个源的数据,并使用前面步骤中的数据处理和创建最终数据集。

由于Pipeline对象不支持.deploy方法,如何部署这个管道?

在推理/打分时,当我们收到原始数据(每个源的单行数据)时,如何触发管道?

还是仅为大型/批量数据的数据处理和模型培训而设计?不是用单一的数据点进行推断吗?

回答 1

Stack Overflow用户

回答已采纳

发布于 2021-12-09 18:06:18

由于管道对象不支持.deploy方法,如何部署这个管道?

管道没有.deploy()方法,没有

使用pipeline.upsert(role_arn='...')创建/更新管道定义为SageMaker,然后调用pipeline.start()。Docs 这里

在推理/打分时,当我们收到原始数据(每个源的单行数据)时,如何触发管道?

实际上,SageMaker中有两种类型的管道。模型构建管道(在您的问题中有)和串行推理管道,用于推理。AWS绝对应该将前者称为“工作流”。

您可以使用建模管道来设置串行推理管道。

要在串行推理管道中进行预处理,您需要训练编码器/估计器(如SKLearn)并保存其模型。然后训练一个学习算法,保存它的模型,然后使用这两个模型创建一个PipelineModel。

页面原文内容由Stack Overflow提供。腾讯云小微IT领域专用引擎提供翻译支持

原文链接:

https://stackoverflow.com/questions/70287087

复制相关文章

相似问题