深度详解突破性AI压缩技术——TurboQuant

原创深度详解突破性AI压缩技术——TurboQuant

原创jack.yang

修改于 2026-03-26 21:24:23

修改于 2026-03-26 21:24:23

谷歌研究院于 2026 年 3 月 25 日正式发布了一项突破性 AI 压缩技术——TurboQuant。该算法专为解决大语言模型(LLM)和向量搜索引擎在推理阶段的内存瓶颈而设计,尤其聚焦于 键值缓存(Key-Value Cache, KV Cache) 的极致压缩。以下是对其技术原理、性能表现与行业影响的深度详解。

一、核心问题:为什么需要 TurboQuant?

在 Transformer 架构中,KV Cache 是推理时用于存储历史 token 的注意力键(Key)和值(Value)的临时内存结构。随着上下文窗口扩大(如从 4K 扩展到 128K tokens),KV Cache 的内存占用呈线性增长:

以 Llama-3-70B 为例:

K 上下文 → KV Cache ≈ 80 GB

K 上下文 → KV Cache > 300 GB

这导致:

模型无法在单卡甚至多卡 GPU 上部署;

云服务成本飙升(内存是主要开销);

移动端/边缘设备完全无法运行长上下文模型。

传统量化方法(如 INT4、INT8)虽可压缩,但会显著降低注意力分数精度,导致生成质量下降。TurboQuant 的目标是在极低位宽(3-bit)下实现“无损”压缩。

二、TurboQuant 的核心技术原理

TurboQuant 并非单一算法,而是由两阶段协同机制构成:

▶ 阶段 1:PolarQuant —— 高质量主干压缩

核心思想:将高维向量从笛卡尔坐标系(Cartesian)转换为极坐标系(Polar Coordinates)。

向量 v ∈ ℝᵈ 被分解为:

半径 r = ‖v‖₂(表示强度)

方向 θ = v / ‖v‖₂(表示语义方向)

优势:

方向向量天然位于单位球面,几何结构更规则,易于量化;

半径可单独用低比特编码(因动态范围小);

彻底消除传统量化所需的 per-channel 缩放因子(scale)和零点(zero-point),节省额外内存开销。

压缩效果:承担约 95% 的压缩任务,将向量压缩至 3.5-bit 左右。

🌰 类比:

传统坐标:“向东 3 街区,向北 4 街区” → 需两个数字

极坐标:“沿 37° 方向走 5 街区” → 仅需角度+距离,更简洁

▶ 阶段 2:QJL(Quantized Johnson-Lindenstrauss)—— 1-bit 误差校正

问题:PolarQuant 仍会引入微小残差误差,影响注意力分数准确性。

解决方案:

利用 Johnson-Lindenstrauss (JL) 引理 的随机投影思想;

用 仅 1-bit(+1 或 -1)对残差向量进行符号化编码;

在注意力计算时,将该校正项叠加回原始分数。

效果:

几乎不增加内存(1-bit/向量);

显著提升召回率(Recall@k)和生成连贯性;

在 “Needle in a Haystack” 测试中,100% 定位成功率得以保持。

💡 QJL 本质是一个数学误差检查器,确保压缩后注意力机制仍能精准聚焦关键信息。

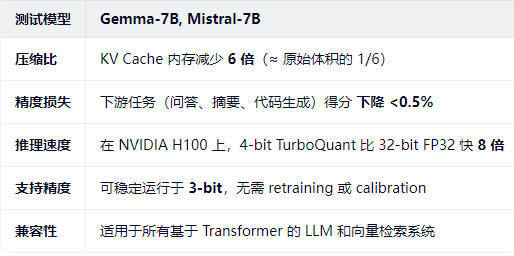

三、关键性能指标(实测数据)

📊 在 LongBench、ZeroSCROLLS 等长上下文基准测试中,TurboQuant 全面优于 KIVI、QuaRot 等现有 KV 压缩方案。

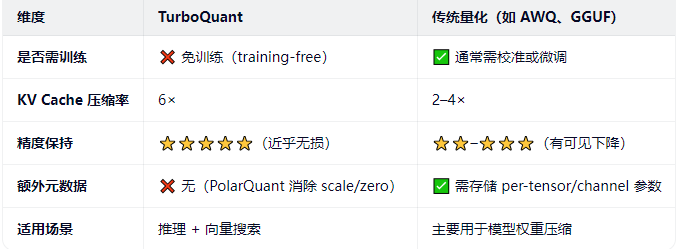

四、技术优势总结

五、应用场景与行业影响

. 云端 AI 服务降本

相同 GPU 可支持 4–8 倍更长上下文,或 大幅提升 batch size;

谷歌估算:若全球 LLM 服务采用 TurboQuant,年节省内存成本超百亿美元。

. 移动端与边缘设备

使 iPhone、Android 手机能在本地运行 32K 上下文模型,无需联网;

车载系统可实时处理长对话(如导航+娱乐+客服一体化)。

. 向量搜索引擎优化

FAISS、Pinecone 等系统可将索引内存压缩 6 倍,同时保持高召回率;

支撑更大规模的语义搜索(如全网文档实时检索)。

. 资本市场反应

发布当日,美光(MU)、西部数据(WDC)等存储芯片股下跌 3–6%;

但摩根士丹利指出:这是“杰文斯悖论”(Jevons Paradox)——效率提升将刺激更多 AI 应用,长期反而增加总内存需求。

六、局限与未来方向

当前局限:

仅优化 KV Cache,不压缩模型权重;

对多模态(图像、音频)KV 结构支持待验证;

尚未在千亿参数模型上大规模部署。

谷歌计划:

年 4 月在 ICLR 2026 会议正式发表论文;

开源参考实现(预计 Q2 2026);

探索与 MoE(Mixture of Experts)架构的结合。

七、总结

TurboQuant 不是一次渐进式改进,而是一次范式跃迁。

它通过极坐标变换 + 1-bit 数学纠错的巧妙组合,在3-bit 极低位宽下实现了近乎无损的 KV Cache 压缩,打破了“压缩必损精度”的行业认知。

这项技术将加速大模型从“云端专属”走向“人人可用”,并重新定义 AI 推理的成本曲线。

正如 Cloudflare CEO 所言:“TurboQuant 是 AI 的 DeepSeek 时刻——效率创新正在终结算力军备竞赛。”

🔗 官方技术博客(示例):

https://ai.googleblog.com/2026/03/turboquant.html

(实际链接请关注 Google Research 官网更新)

相关链接

- 📂 大模型技术专栏: 欢迎您到访 「大模型系列」。 在这个由参数驱动、以数据为燃料的新智能时代,大语言模型(LLM)已不再是实验室里的前沿概念,而是正在重塑搜索、办公、编程、教育、医疗乃至整个数字世界的底层引擎。从 GPT 到 Llama,从 Claude 到 Qwen,从推理到多模态,大模型正以前所未有的速度进化——它们既是工具,也是平台,更可能是下一代人机交互的“操作系统”。 本系列将带你:

- 🔍 深入原理:从 Transformer 架构、注意力机制到训练范式(预训练、微调、RLHF);

- ⚙️ 动手实践:本地部署、模型微调、RAG 构建、Agent 设计等实战指南;

- 🧠 理解边界:幻觉、偏见、安全对齐、推理瓶颈与当前能力天花板;

- 🌍 洞察趋势:开源 vs 闭源、端侧部署、MoE 架构、世界模型与 AGI 路径;

- 💼 落地应用:如何在企业中安全、高效、低成本地集成大模型能力。

无论你是想写代码调用 API 的开发者,设计 AI 产品的 PM,评估技术路线的管理者,还是单纯好奇智能本质的思考者,这里都有值得你驻足的内容。 不追 hype,只讲逻辑;不谈玄学,专注可复现的认知。 让我们一起,在这场百年一遇的智能革命中,看得更清,走得更稳 https://cloud.tencent.com/developer/column/107314

- 👤 关于作者: 专注技术落地,深耕硬核干货 本文作者致力于大模型相关技术的生态建设与实战落地。不同于浅层的概念科普,作者坚持 “手算 + 代码” 的深度分享模式,主张通过手动推演理解算法本质,结合生产级代码验证理论可行性。 请关注我主页:https://cloud.tencent.com/developer/user/2276240

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读